相機模型介紹及相機模型在自動駕駛中的作用及使用方法

相機模型是計算機視覺中的核心概念,用于描述真實世界中的點如何投影到圖像平面上。在自動駕駛系統中,相機模型用于環境感知,如物體檢測和場景理解。下面我將詳細介紹針孔相機模型和魚眼相機模型,然后討論它們在自動駕駛中的作用及使用方法。

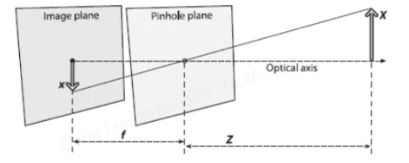

1. 針孔相機模型

針孔相機模型是最基本的相機模型,基于小孔成像原理。它假設光線通過一個無限小的孔(針孔)投影到成像平面上,形成倒立的圖像。這種模型忽略了鏡頭畸變,適用于理想化場景。

原理:

- 光線從場景中的點通過針孔投射到像平面。

- 投影過程是線性的,使用透視投影方程描述。

- 數學模型涉及齊次坐標和投影矩陣。

數學模型:

- 設世界坐標系中的點為 P=[X,Y,Z,1]?\mathbf{P} = [X, Y, Z, 1]^\topP=[X,Y,Z,1]?(齊次坐標),相機坐標系中的點為 p=[x,y,z]?\mathbf{p} = [x, y, z]^\topp=[x,y,z]?。

- 透視投影方程:

p=1ZKP \mathbf{p} = \frac{1}{Z} \mathbf{K} \mathbf{P} p=Z1?KP

其中 K\mathbf{K}K 是相機內參矩陣:

K=[fx0cx0fycy001] \mathbf{K} = \begin{bmatrix} f_x & 0 & c_x \\ 0 & f_y & c_y \\ 0 & 0 & 1 \end{bmatrix} K=?fx?00?0fy?0?cx?cy?1??

這里 fxf_xfx? 和 fyf_yfy? 是焦距(以像素為單位),cxc_xcx? 和 cyc_ycy? 是主點坐標(圖像中心)。 - 圖像坐標 (u,v)(u, v)(u,v) 計算為:

u=fxXZ+cx,v=fyYZ+cy u = \frac{f_x X}{Z} + c_x, \quad v = \frac{f_y Y}{Z} + c_y u=Zfx?X?+cx?,v=Zfy?Y?+cy?

這表示 uuu 和 vvv 是歸一化后的坐標。

優點和缺點:

- 優點:模型簡單,計算高效,適用于大多數標準相機和算法。

- 缺點:視野有限(通常小于90度),忽略鏡頭畸變,導致在廣角場景中失真嚴重。

2. 魚眼相機模型

魚眼相機模型是一種廣角相機模型,專為捕捉大視野(通常180度或更大)設計。它使用非線性投影來處理鏡頭畸變,常見于車載相機或監控系統。魚眼鏡頭會產生桶形畸變,需要通過數學模型校正。

原理:

- 光線通過魚眼鏡頭投射,產生徑向畸變(圖像邊緣彎曲)。

- 投影模型基于角度映射,如等距投影或等立體投影。

- 數學模型包括畸變參數來校正圖像。

數學模型:

- 設歸一化圖像坐標為 (x,y)(x, y)(x,y),實際畸變坐標為 (xd,yd)(x_d, y_d)(xd?,yd?)。

- 徑向畸變模型:

r=x2+y2 r = \sqrt{x^2 + y^2} r=x2+y2?

rd=r(1+k1r2+k2r4+k3r6+??) r_d = r (1 + k_1 r^2 + k_2 r^4 + k_3 r^6 + \cdots) rd?=r(1+k1?r2+k2?r4+k3?r6+?)

其中 k1,k2,k3k_1, k_2, k_3k1?,k2?,k3? 是畸變系數。 - 畸變坐標計算為:

xd=xrdr,yd=yrdr x_d = x \frac{r_d}{r}, \quad y_d = y \frac{r_d}{r} xd?=xrrd??,yd?=yrrd?? - 最終圖像坐標 (ud,vd)(u_d, v_d)(ud?,vd?) 通過內參矩陣映射:

[udvd1]=K[xdyd1] \begin{bmatrix} u_d \\ v_d \\ 1 \end{bmatrix} = \mathbf{K} \begin{bmatrix} x_d \\ y_d \\ 1 \end{bmatrix} ?ud?vd?1??=K?xd?yd?1??

這里 K\mathbf{K}K 與針孔模型相同。

優點和缺點:

- 優點:視野廣闊(可達180度以上),適合捕捉大范圍場景。

- 缺點:畸變嚴重,需要復雜的校正算法,計算開銷較大。

相機模型在自動駕駛中的作用

在自動駕駛系統中,相機模型是環境感知的關鍵組件,主要用于:

- 環境感知:檢測車輛、行人、交通標志和車道線。例如,使用針孔模型進行精確對象定位,魚眼模型提供全景視野以覆蓋盲區。

- 場景理解:結合深度學習模型(如YOLO或SSD)進行語義分割,識別道路結構和障礙物。

- 傳感器融合:與激光雷達、雷達和IMU數據融合,提高感知魯棒性。相機提供豐富的紋理信息,而其他傳感器補充深度和運動數據。

- 定位與導航:基于視覺的SLAM(Simultaneous Localization and Mapping)使用相機模型構建環境地圖并估計車輛位置。

總體作用:提升自動駕駛的安全性和可靠性,通過實時圖像處理實現決策支持。

相機模型在自動駕駛中的使用方法

在自動駕駛應用中,相機模型的使用涉及以下步驟:

-

相機標定:

- 目的:確定相機內參(如焦距 fx,fyf_x, f_yfx?,fy?、主點 cx,cyc_x, c_ycx?,cy?)和畸變系數(如 k1,k2k_1, k_2k1?,k2?)。

- 方法:使用標定板(如棋盤格)采集多張圖像,通過優化算法(如OpenCV的

calibrateCamera函數)求解參數。例如,針孔模型標定最小化重投影誤差,魚眼模型額外優化畸變系數。 - 工具:常用OpenCV庫實現。代碼示例(Python):

import cv2 import numpy as np# 加載標定圖像 images = [cv2.imread(f'image_{i}.jpg') for i in range(10)] obj_points = [] # 3D點 img_points = [] # 2D點# 定義棋盤格尺寸 pattern_size = (9, 6) obj_p = np.zeros((pattern_size[0]*pattern_size[1], 3), np.float32) obj_p[:, :2] = np.mgrid[0:pattern_size[0], 0:pattern_size[1]].T.reshape(-1, 2)for img in images:gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)ret, corners = cv2.findChessboardCorners(gray, pattern_size, None)if ret:obj_points.append(obj_p)img_points.append(corners)# 標定相機(針孔模型) ret, K, dist, rvecs, tvecs = cv2.calibrateCamera(obj_points, img_points, gray.shape[::-1], None, None) # 對于魚眼模型,使用 cv2.fisheye.calibrate

-

畸變校正:

- 目的:消除魚眼畸變,使圖像符合針孔模型,便于后續處理。

- 方法:應用標定得到的參數進行圖像變換。針孔模型通常不需要校正,魚眼模型使用逆畸變映射。

- 工具:OpenCV的

undistort函數。代碼示例:# 針孔模型校正(可選) undistorted_img = cv2.undistort(img, K, dist) # 魚眼模型校正 map1, map2 = cv2.fisheye.initUndistortRectifyMap(K, dist, np.eye(3), K, img.shape[:2], cv2.CV_16SC2) undistorted_img = cv2.remap(img, map1, map2, cv2.INTER_LINEAR)

-

圖像處理與感知任務:

- 物體檢測:使用校正后的圖像輸入到神經網絡(如CNN)中。例如,YOLO模型檢測車輛和行人。

- 特征提取:提取車道線或邊緣特征,結合相機模型計算真實世界坐標。例如,從圖像坐標 (u,v)(u, v)(u,v) 反投影到3D空間:

[XYZ]=ZK?1[uv1] \begin{bmatrix} X \\ Y \\ Z \end{bmatrix} = Z \mathbf{K}^{-1} \begin{bmatrix} u \\ v \\ 1 \end{bmatrix} ?XYZ??=ZK?1?uv1??

其中 ZZZ 是估計的深度(來自其他傳感器或立體視覺)。 - 實時應用:在自動駕駛系統中,相機模型集成到感知模塊,每秒處理多幀圖像,輸出給規劃和控制模塊。

-

系統集成:

- 多相機系統:自動駕駛車輛通常使用多個相機(如前視針孔相機、側視魚眼相機),覆蓋360度視野。通過標定和融合,構建統一的環境模型。

- 挑戰與優化:處理動態光照、運動模糊和實時性要求。使用GPU加速和算法優化(如稀疏特征匹配)提高效率。

總結

針孔相機模型簡單高效,適合標準視野場景;魚眼相機模型提供廣角覆蓋,但需畸變校正。在自動駕駛中,它們通過標定、校正和感知任務實現環境理解。使用方法包括標定參數、校正圖像和集成到感知系統。這些模型是自動駕駛視覺感知的基石,結合其他傳感器可顯著提升系統性能。未來發展方向包括更高效的畸變模型和深度學習融合技術。

路由策略)

)

)

![[論文閱讀] 人工智能 + 軟件工程 | LLM協作新突破:用多智能體強化學習實現高效協同——解析MAGRPO算法](http://pic.xiahunao.cn/[論文閱讀] 人工智能 + 軟件工程 | LLM協作新突破:用多智能體強化學習實現高效協同——解析MAGRPO算法)