諸神緘默不語-個人CSDN博文目錄

諸神緘默不語的論文閱讀筆記和分類

論文名稱:How Can We Know What Language Models Know?

ArXiv網址:https://arxiv.org/abs/1911.12543

官方GitHub項目(prompt之類的都有):https://github.com/jzbjyb/LPAQA

本文是2020年TACL論文,作者來自卡耐基梅隆大學和博世北美研究所。

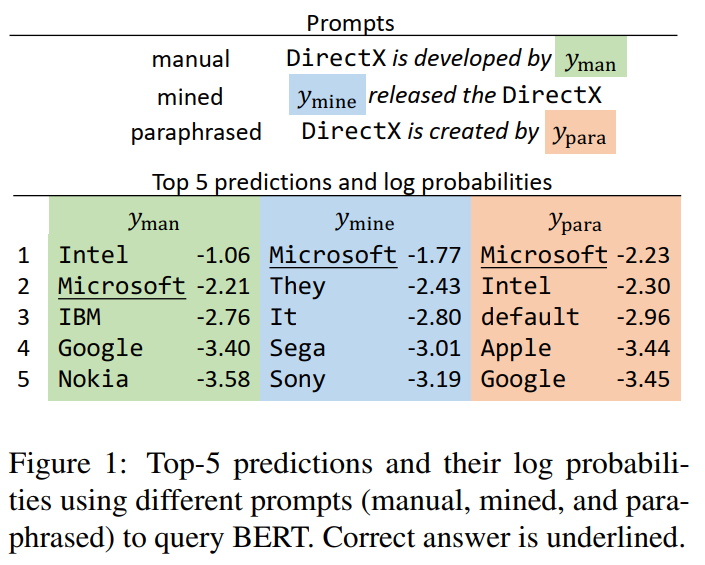

本文關注探索LM中蘊含的知識。以前已經有工作用完形填空的方式來探查知識(Obama is a __ by profession),但是這些填空模版(prompt)都是手工做的,因此可能是sub-optimal的(在上一篇論文最后也提及了),不能充分發揮LM的能力。

本文的解決方案是自動挖掘prompt(遠程監督、回譯、集成)

這篇工作的實驗真的多,這也太能做了。

文章目錄

- 1. 探查知識的方案

- 2. 實驗

- 1. 數據集

- 2. LM

- 3. baseline

- 4. 實驗設置

- 5. 主實驗結果

- 6. 實驗分析

- Prediction Consistency by Prompt

- POS-based Analysis

- Cross-model Consistency

- Linear vs. Log-linear Combination

- 7. 失敗trick集合

1. 探查知識的方案

從數據庫中獲取知識是deterministic的,但從LM中獲取知識(完形填空)是不可靠的。

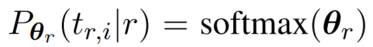

本文用的都是雙向LM,做填空題的那種。

- mining-based methods:遠程監督:從維基百科中找三元組出現的句子。

- 方法一:Middle-word Prompts(subject prompt object)

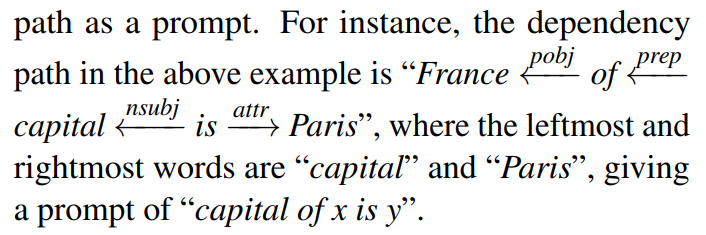

- 方法二:Dependency-based Prompts(句法分析→subject和object之間的依存路徑)

(句法分析這塊我也不懂總之大概是這么個意思吧)

- paraphrasing-based methods:對人工或挖掘得到的種子prompt進行回譯

- 挑選和集成prompt

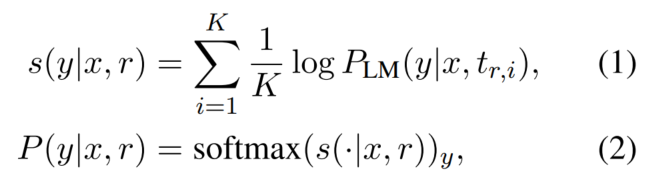

- Top-1 Prompt Selection:選擇在訓練集上準確率最高的prompt(這個準確率的公式定義比較復雜,但是反正就這個prompt對應的關系里object預測正確的占所有樣本的比例)

- Rank-based Ensemble:top-K概率求和

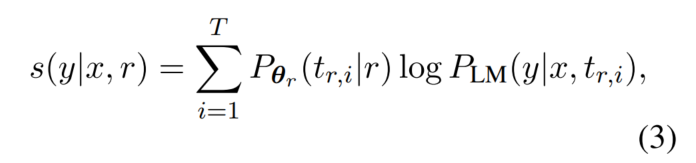

- Optimized Ensemble:大意是說對每個關系的T個prompt分別訓練權重

這篇paper里面還提及了BERT跟LM的標準定義嚴格來說不一樣這一茬:

感覺現在已經沒人在乎了=== 隨便吧==

2. 實驗

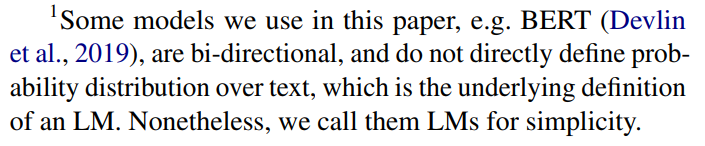

1. 數據集

2. LM

BERT-base

BERT-large

增強了外部的實體表征:

ERNIE

Know-Bert

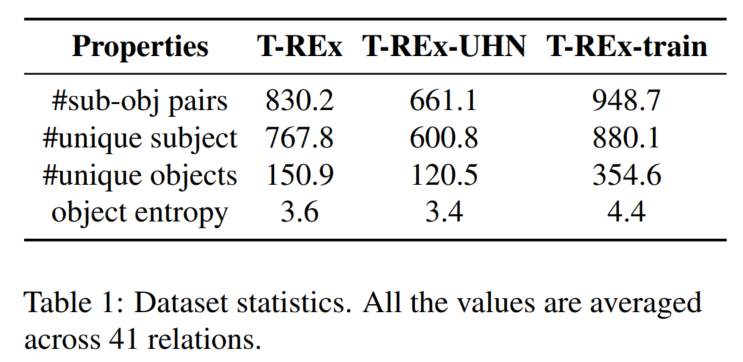

3. baseline

- Majority

- Man:手工prompt

- Mine

- Mine+Man

- Mine+Para

- Man+Para

- TopK:求平均

- Opti.:加權平均

- Oracle:所有prompt中有一個能預測正確,就算LM知道這個知識

4. 實驗設置

mine 40個prompts

回譯7個prompts

清洗噪音prompts

Adam

batch size: 32

5. 主實驗結果

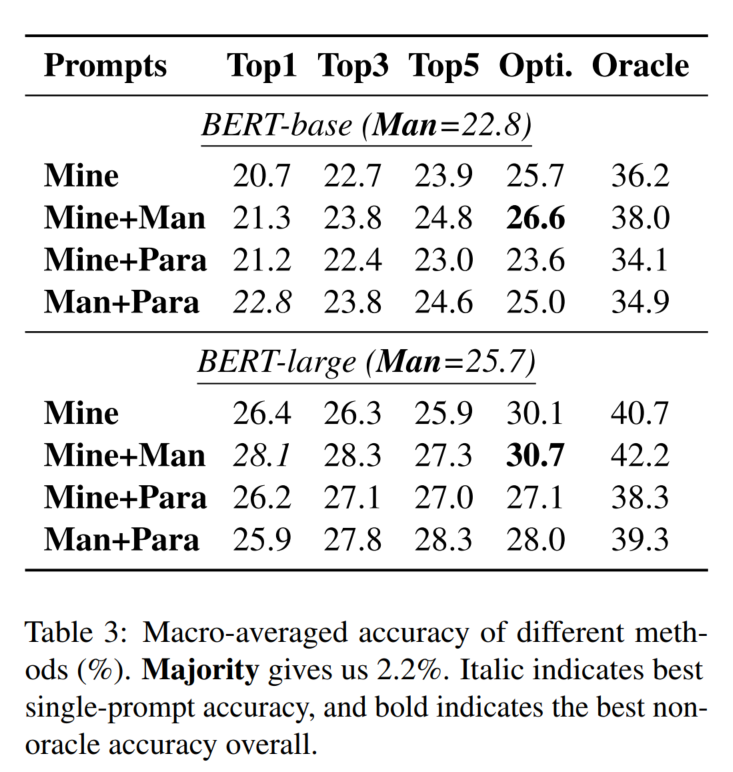

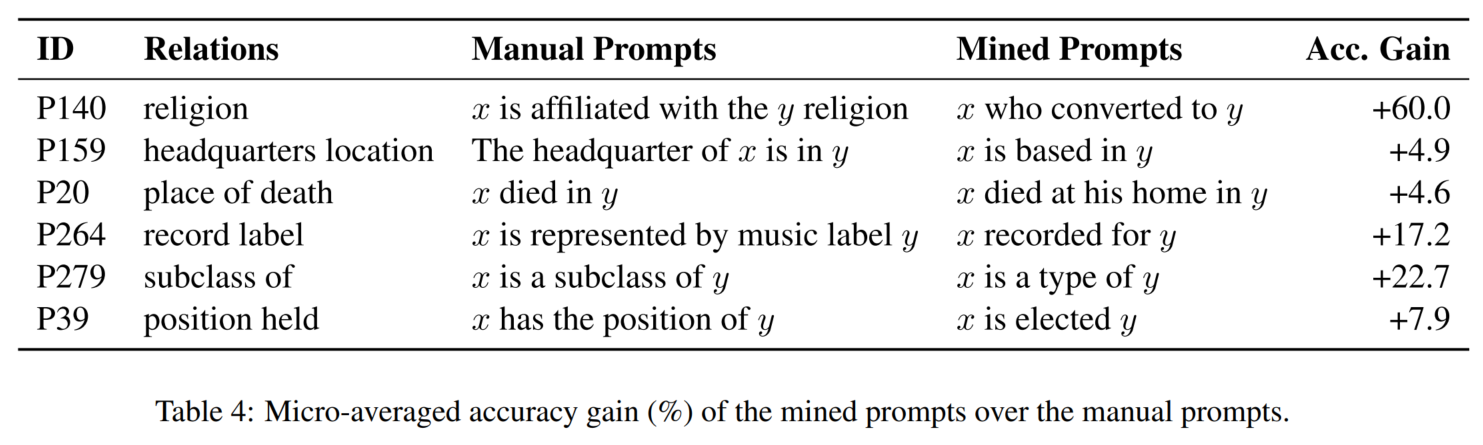

與手工prompt相比,效果得到了提升:

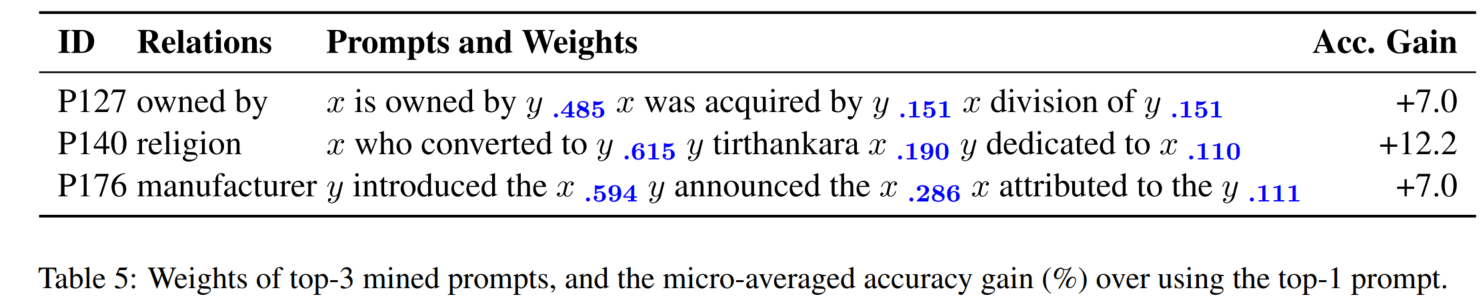

集成權重:

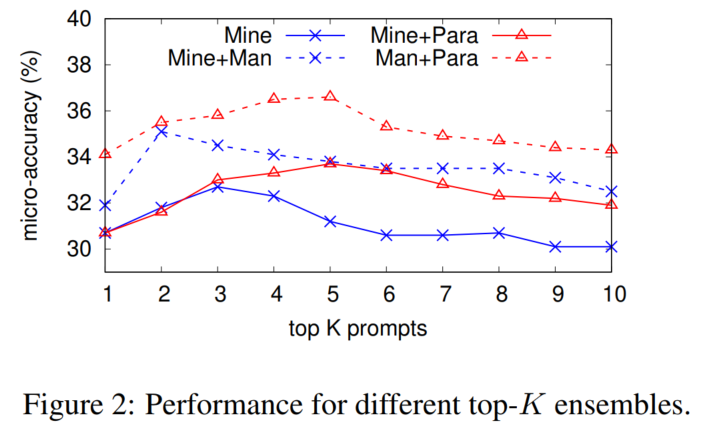

K的選擇:

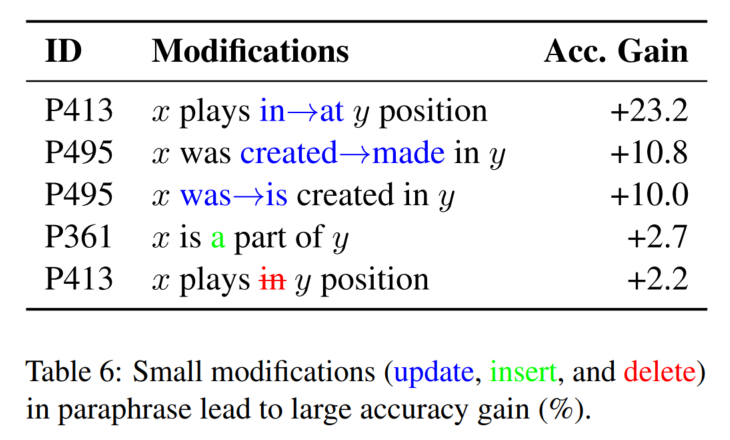

prompt做輕微修改也能改變效果:

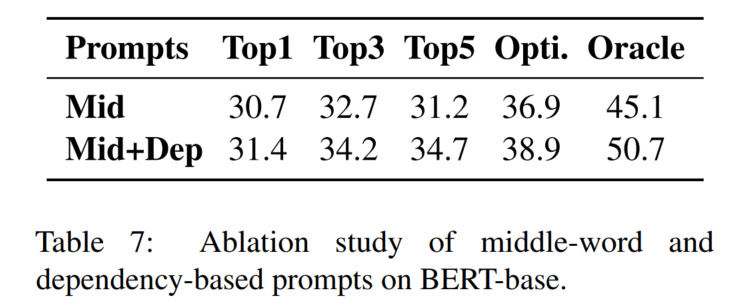

兩種遠程監督方案的對比:

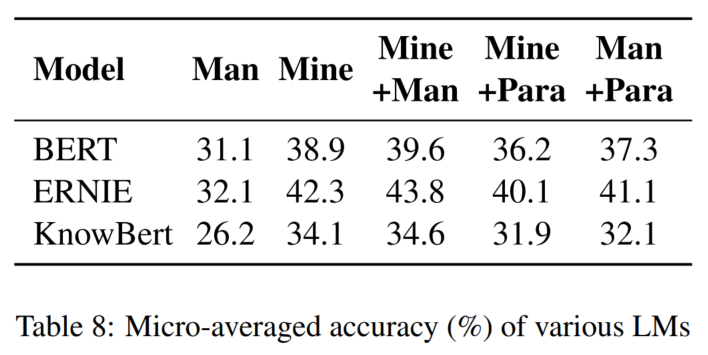

不同LM的實驗結果:

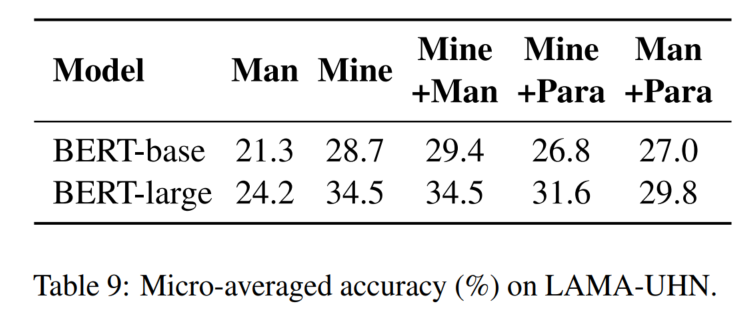

在LAMA-HUN(一個比LAMA更難的benchmark)上的表現:

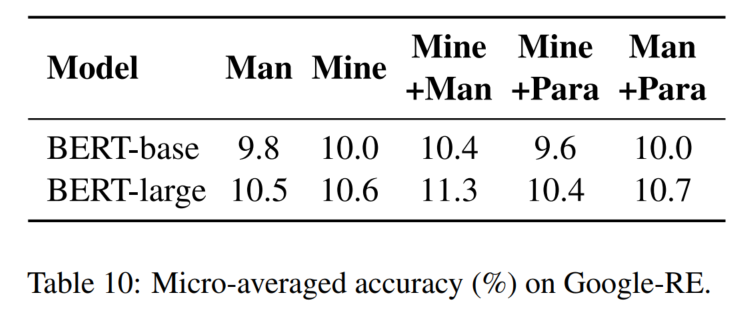

在Google-RE上的表現:

6. 實驗分析

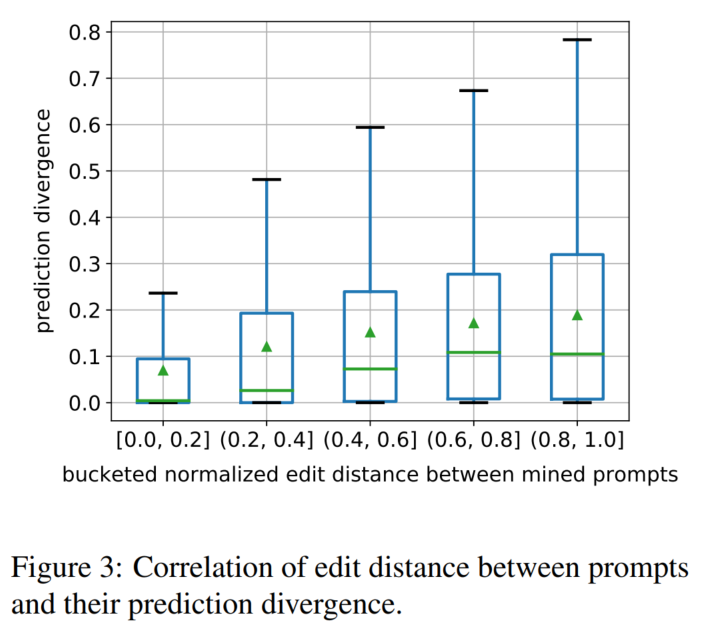

Prediction Consistency by Prompt

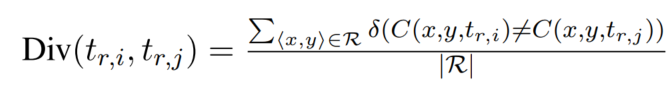

divergence是兩個prompt預測結果不同的程度:

皮爾森相關系數是0.25,說明編輯距離和divergence之間確實存在弱相關性(prompt差別越大,預測結果差別越大)

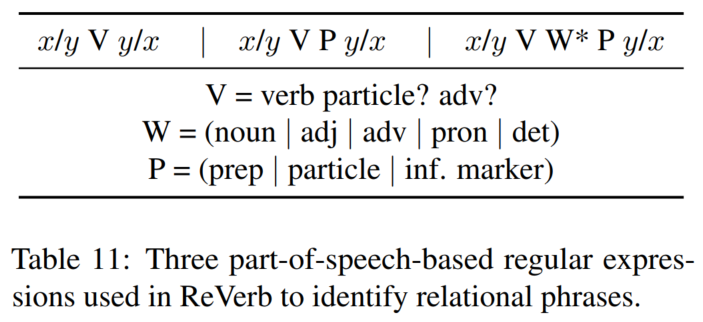

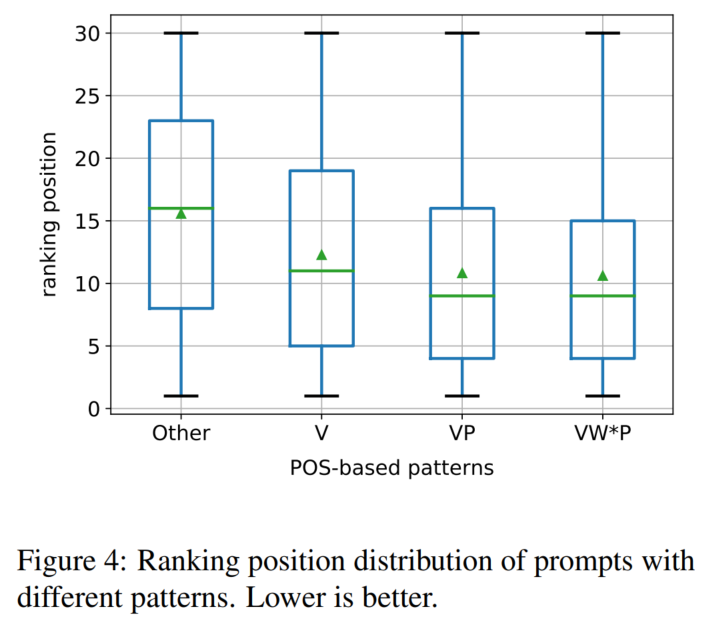

POS-based Analysis

用排名分布而不是準確率分布,在腳注解釋了一下是因為不同關系的準確率的量級不同

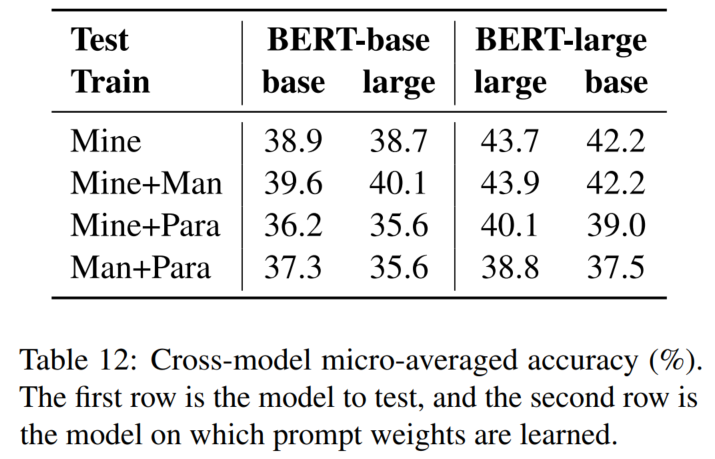

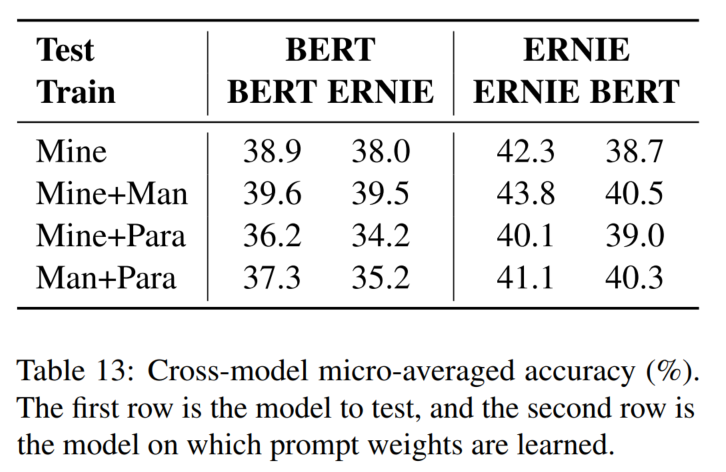

Cross-model Consistency

檢測prompts能不能跨模型通用

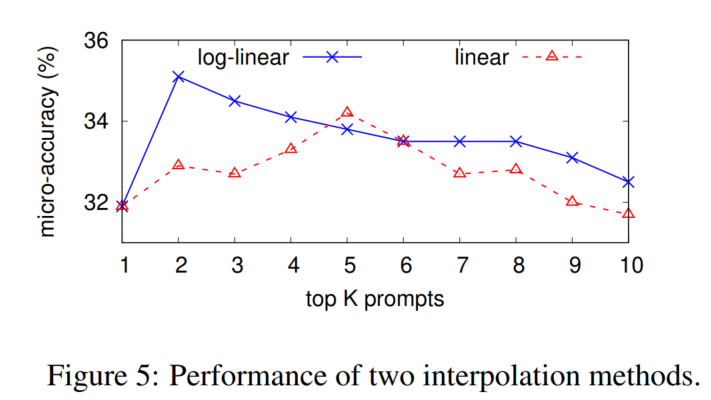

Linear vs. Log-linear Combination

求和的權重

7. 失敗trick集合

這塊真實誠啊

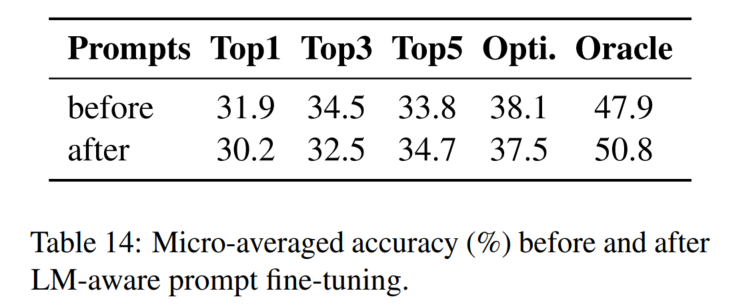

- LM-aware Prompt Generation

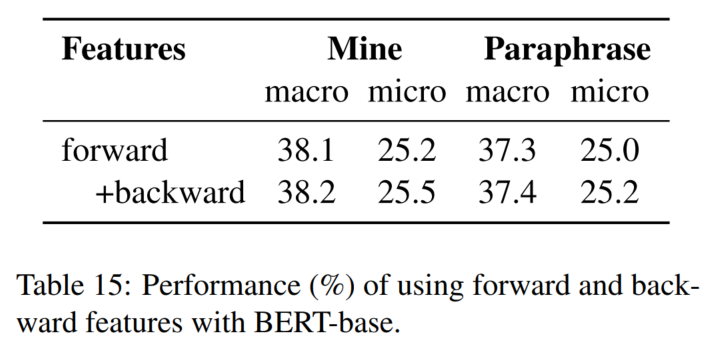

- Forward and Backward Probabilities

-進程創建)

)

)