視頻軟解碼的基本原理

概念解析:CPU主導的通用解碼方式

視頻軟解碼是一種完全依賴通用CPU執行解碼算法的視頻還原技術,其核心特征在于不依賴任何專用硬件模塊,而是通過軟件程序調用CPU的通用計算能力完成壓縮視頻數據的解碼過程[1][2]。與硬解碼(依賴顯卡、專用解碼芯片等硬件模塊)相比,軟解碼的硬件無關性使其具備更強的環境適應性——即使在顯卡不支持特定編碼格式的設備上,只要CPU性能足夠,就能通過安裝相應解碼器(如FFmpeg、VLC等)實現視頻播放[3]。

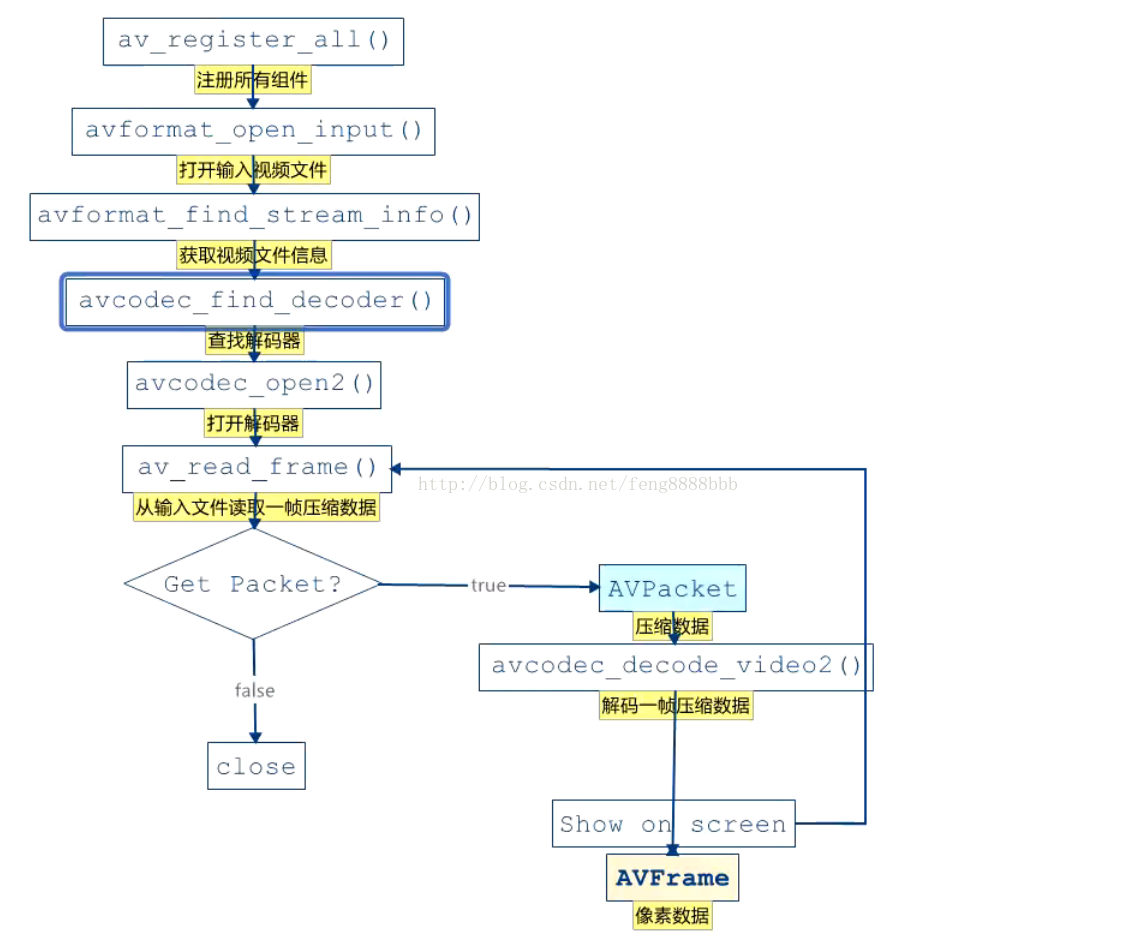

解碼流程:從比特流到圖像幀的還原之旅

軟解碼的核心流程可分為五個關鍵步驟,每個環節都對應著特定的技術處理邏輯:

-

數據讀取與解封裝

首先從存儲介質或網絡獲取壓縮視頻流,然后通過解析器(Parser)分離視頻流與音頻流,解析MP4、MKV等容器格式,提取純視頻比特流。例如H.265編碼的視頻會被解析為NALU(網絡抽象層單元)等語法單元[4]。 -

熵解碼:破解壓縮密碼

通過CABAC(基于上下文的自適應二進制算術編碼)等算法解析壓縮比特流,將二進制數據轉換為量化系數等中間數據。這一步是解碼的"翻譯"過程,AV1等新型編碼格式在此階段采用更高效的熵編碼算法提升壓縮效率[5]。 -

幀重建:像素級還原

執行運動補償(利用參考幀數據預測當前幀)、逆變換(如逆離散余弦變換IDCT)和環路濾波(去塊效應濾波、采樣點自適應補償),重建原始視頻幀。以H.265為例,此階段會基于CTU(編碼樹單元)劃分進行塊級處理,優化圖像細節[6]。 -

色彩空間轉換與渲染

將重建后的YUV格式圖像轉換為RGB格式,最終通過Canvas或類似接口渲染到顯示設備。后處理器(Post-processor)會在此階段進行畫質優化,如去噪、色彩增強等[7]。

核心模塊構成

- 解析器(Parser):負責比特流語法解析,如H.265的NALU單元解析

- 解碼器(Decoder):實現核心算法,如libde265庫的解碼引擎

- 后處理器(Post-processor):執行濾波優化,提升輸出畫質

技術對比:軟解碼與硬解碼的核心差異

| 對比維度 | 軟解碼 | 硬解碼 |

|---|---|---|

| 性能消耗 | CPU占用率高,4K視頻解碼可能占用30%-50% CPU資源 | 依賴專用硬件模塊,CPU占用率通常低于10% |

| 兼容性 | 支持所有編碼格式,通過更新軟件即可適配新格式 | 受硬件規格限制,老舊設備可能不支持AV1等新格式 |

| 靈活性 | 可實現復雜后處理(如AI畫質增強、自定義濾鏡) | 功能固定,僅支持硬件預設的基礎優化 |

| 適用場景 | 低延遲直播、專業視頻編輯、新型編碼格式測試 | 高清視頻播放、移動設備省電場景 |

軟解碼的靈活性優勢在實際應用中尤為突出:當面對H.266/VVC等新型編碼格式時,無需更換硬件,只需升級解碼庫即可支持;而硬解碼設備若硬件規格不支持,則無法解碼。這種"軟件定義解碼"的特性,使其成為視頻技術創新的重要試驗田[3][8]。

技術演進:從傳統算法到神經表示

值得注意的是,軟解碼技術正從傳統基于幀序列的解碼向神經表示方法演進。例如NERV(Neural Representations for Videos)技術將視頻編碼為神經網絡模型,解碼時通過前饋計算直接生成RGB圖像,相比傳統方法解碼速度提升38x至132x,同時保持更高的視頻質量[9]。這種突破預示著軟解碼在效率與畫質平衡上的更大潛力。

關鍵技術特點

- 算法透明性:解碼邏輯完全通過軟件實現,便于調試與優化

- 格式適應性:支持IVF、H.265、AV1等多種視頻流格式

- 后處理擴展性:可集成去隔行、動態對比度增強等高級功能

視頻軟解碼的關鍵技術與實現

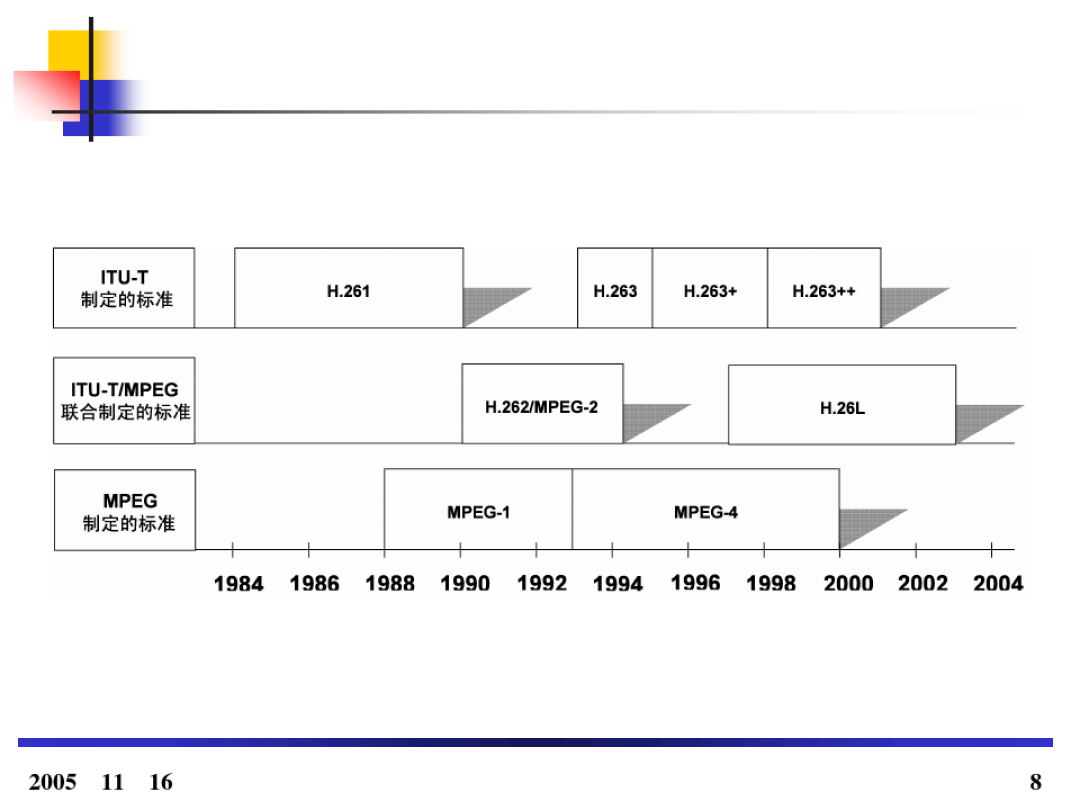

主流編碼標準解析

視頻編碼標準的迭代始終圍繞著"更高壓縮效率"與"更低帶寬成本"的核心目標演進。從H.265到AV1再到H.266,每一代標準都在技術創新與商業落地間尋找平衡,共同構成了當前軟解碼技術的底層支撐體系。

H.265/HEVC:4K時代的壓縮基石(2013年發布)

作為H.264的繼任者,H.265(高效視頻編碼,HEVC)通過重構編碼單元結構實現了質的飛躍。其核心突破在于采用靈活的樹編碼單元(CTU),可將視頻幀遞歸分割為64×64至8×8的子區域,配合35種幀內預測模式與采樣點自適應補償(SAO)濾波器,在相同畫質下實現了比H.264降低50%碼率的壓縮效率[10][11]。這一特性使其成為4K/8K超高清視頻的主流選擇,廣泛應用于Netflix等流媒體平臺及國內騰訊視頻、愛奇藝的4K點播場景[12]。

在軟解碼實現上,開源庫libhevc與Fraunhofer HHI開發的VVDec解碼器是典型代表,后者支持Main/Main10配置文件,可處理8位/10位色深視頻流,為安防監控、廣播電視等專業領域提供穩定解碼能力[13]。不過,H.265的商業授權模式限制了其在互聯網領域的普及,這也為后續開源標準的崛起埋下伏筆。

AV1:開源生態的逆襲者(2018年發布)

由開放媒體聯盟(AOM)主導的AV1標準,以開源免專利費為核心競爭力,迅速獲得Apple、Google、Meta等巨頭支持[14]。其技術創新體現在開放比特流單元(OBU) 架構與時間單元(TU)機制,支持幀重排序和替代參考幀(ARF),在相同主觀質量下較H.265再提升25-35%壓縮率,尤其在HDR視頻處理中表現突出[11][15]。

軟解碼領域,dav1d解碼器(VideoLAN開源項目)通過SIMD指令集優化,在低端設備上實現了1080p@60fps的實時解碼;而2025年發布的SVT-AV1 3.0編碼器更是通過AVX-512指令集優化,將4K@30fps編碼速度提升100%,推動YouTube、Netflix等平臺大規模采用[16][17]。盡管計算復雜度較H.265高30%,但開源生態的協同效應正加速AV1在WebRTC、短視頻等場景的滲透。

H.266/VVC:面向未來的極限壓縮(2020年發布)

H.266(通用視頻編碼,VVC)作為HEVC的繼任者,通過四叉樹+二叉樹+三叉樹(QTBT)混合分塊等技術,在相同畫質下較H.265再降40-50%碼率,特別針對8K、VR等超大分辨率場景優化[18][19]。然而,其解碼復雜度達到H.265的2.3倍,硬件成本顯著上升,目前僅在國內頭部視頻平臺(如top 5短視頻平臺)小范圍試點[18][20]。

軟解碼層面,Ali266解碼器通過算法優化在移動端實現了4K@30fps的實時解碼,成為H.266商用化的關鍵推手[18]。但行業普遍認為,H.266可能是傳統混合編碼框架的"收官之作",其壓縮效率提升已接近物理極限。

三代標準核心指標對比

| 標準 | 壓縮效率提升(相對前代) | 解碼復雜度 | 核心技術創新 | 典型應用場景 |

|---|---|---|---|---|

| H.265/HEVC | 較H.264提升40-50% | ★★☆☆ | 靈活CTU分塊、SAO濾波 | 4K流媒體、安防監控 |

| AV1 | 較H.265提升25-35% | ★★★☆ | OBU封裝、ARF替代參考幀 | YouTube、WebRTC實時通信 |

| H.266/VVC | 較H.265提升40-50% | ★★★★★ | QTBT混合分塊、VR優化 | 8K超高清、沉浸式視頻 |

技術選擇啟示:追求兼容性與低成本優先選H.265;開源免專利場景首選AV1;面向8K/VR未來需求可試點H.266。目前產業呈現"AV1與H.266雙軌并行"格局,前者在互聯網領域擴張,后者在專業廣電領域推進。

從H.265到H.266,視頻編碼標準正逐步逼近香農極限。未來,隨著AI編解碼(如MPAI-EEV神經編解碼器)的成熟,傳統混合編碼框架可能迎來顛覆性變革,但短期內軟解碼技術仍將圍繞這三代標準持續優化效率與兼容性[21]。

解碼器架構與實現

視頻軟解碼器的架構設計需兼顧通用性與場景適應性,其核心邏輯可分為通用模塊化架構與場景化定制實現兩大方向。前者聚焦跨場景的基礎能力復用,后者則針對特定環境進行深度優化,共同構成軟解碼技術的實踐體系。

一、通用解碼器的模塊化架構:以 libhevc 為例

通用解碼器通常采用分層模塊化設計,通過解耦核心功能單元實現靈活擴展。以 H.265/HEVC 標準的開源解碼器 libhevc 為例,其架構可拆解為三大核心模塊,協同完成從比特流到原始視頻幀的轉換過程:

-

Parser(語法解析器)

作為解碼器的"前端",負責將輸入的二進制比特流解析為結構化的語法單元。在 H.265 標準中,這一步需識別 NALU(網絡抽象層單元)、序列參數集(SPS)、圖像參數集(PPS)等關鍵信息,并校驗句法合法性。例如,當解析到 IDR 幀(即時解碼刷新幀)時,Parser 會觸發解碼器狀態重置,確保后續幀解碼的準確性[22]。 -

Decoder(核心解碼引擎)

承接 Parser 輸出的語法單元,執行熵解碼(VLD)、逆變換(IDCT/ICT)、運動補償、環路濾波等核心算法,最終生成 YUV 格式的原始視頻幀。該模塊是計算密集型單元,需通過多線程優化(如按切片或 CTU 塊并行處理)提升效率。以 libhevc 為例,其解碼引擎支持動態調整線程數,在 4 核 CPU 環境下可實現 1080P@30fps 實時解碼[22]。 -

Filter(后處理濾鏡)

對解碼后的原始幀進行優化,包括去塊效應濾波、采樣點自適應補償(SAO)等,提升視頻主觀質量。部分解碼器還支持自定義濾鏡擴展,如色彩空間轉換(YUV 轉 RGB)或降噪處理,滿足不同應用場景的顯示需求[22]。

這種"解析-解碼-后處理"的三段式架構并非 libhevc 獨有,而是軟解碼器的通用設計范式。例如,FFmpeg 軟解碼系統同樣遵循"解析器(Parser)-解碼器(Decoder)-后處理器(Post-processor)"結構,其中解析器對應 av_parser_parse2 接口,解碼器由 AVCodecContext 管理,后處理則通過 sws_scale 等函數實現[23]。

二、場景化實現:從多后端選擇到 Web 端優化

通用架構為解碼器提供了基礎能力,而實際應用中需結合場景特性進行定制。以下從多解碼器后端選擇與Web 端 Wasm 優化兩個典型場景,解析軟解碼技術的落地實踐。

1. 多解碼器后端選擇:按需匹配性能與兼容性

不同編解碼標準(如 HEVC、AV1)及硬件環境(如移動端、嵌入式設備)對解碼器的需求差異顯著,因此需支持多后端動態選型。常見解碼器后端及其特性如下:

| 解碼器 | 支持標準 | 核心優勢 | 典型應用場景 |

|---|---|---|---|

| VVDec | HEVC | 開源(Fraunhofer HHI 開發),支持切片級并行解碼 | 專業視頻編輯軟件、服務器端轉碼 |

| dav1d | AV1 | SIMD 指令集深度優化,性能較 libaom 提升 4 倍 | Android 12+ 設備、樹莓派等嵌入式設備 |

| libde265 | HEVC | 輕量級設計,支持 JavaScript 移植(libde265.js) | Web 瀏覽器無插件解碼 |

| libaom | AV1 | 參考實現,支持全特性解碼 | 學術研究、標準符合性測試 |

以視頻質量對比工具 Video-Compare 為例,其模塊化架構允許用戶通過命令行參數(如 --decoder dav1d 或 --decoder libaom)切換 AV1 解碼器:當需要兼容性時選擇 libaom,追求性能時則切換至 dav1d[16]。這種設計既保證了功能完整性,又能針對不同場景優化資源占用。

2. Web 端 Wasm 優化:突破瀏覽器性能瓶頸

Web 端視頻解碼面臨瀏覽器環境限制(如無硬件加速 API、JavaScript 執行效率低),而 WebAssembly(Wasm)技術通過將 C/C++ 解碼器編譯為字節碼,為瀏覽器提供接近原生的性能。典型實現架構如下:

-

分層協作模型

采用"Wasm 層+JavaScript 層"分工:Wasm 層(C/C++ 實現)負責計算密集型任務,如比特流解析、熵解碼;JavaScript 層負責視頻渲染(如通過 Canvas 或 WebGL 繪制 YUV 數據)及用戶交互。例如,B站 WasmPlayer 將解封裝、解碼等核心邏輯封裝在 Wasm 模塊,JS 層僅處理音畫同步和 DOM 操作,SDK 包體積控制在 1MB 以內,實現低延遲直播[7]。 -

多線程解碼優化

通過 SharedArrayBuffer 實現 Wasm 線程間內存共享,將解碼任務分配至 Worker 線程,避免阻塞主線程。例如,libde265.js(基于 libde265 移植的 HEVC 解碼器)可在 Chrome 中啟用 4 個 Worker 線程并行處理,解碼性能提升 2.3 倍,支持 720P@30fps 實時播放[24]。 -

格式適配與輕量化

針對 Web 場景的特殊需求,解碼器需支持 FLV、MP4 等流式封裝格式。例如,基于 FFmpeg 擴展的 Wasm 解碼器可解析 FLV 封裝的 H.265 數據,通過 HTTP-FLV 協議實現直播流低延遲播放[10]。同時,通過裁剪非必要功能(如復雜濾鏡),可將 Wasm 模塊體積壓縮至 600KB 以下,滿足移動端加載速度要求[7]。

三、代碼示例:FFmpeg 軟解碼實現

以下為基于 FFmpeg 的軟解碼核心代碼示例,展示從初始化到幀處理的完整流程:

// FFmpeg軟解碼核心代碼示例

#include <libavcodec/avcodec.h>

#include <libavformat/avformat.h>

#include <libswscale/swscale.h>int main() {AVFormatContext* fmt_ctx = NULL;int video_stream_idx = -1;AVCodecContext* codec_ctx = NULL;AVCodec* codec = NULL;AVPacket* packet = av_packet_alloc();AVFrame* frame = av_frame_alloc();// 1. 注冊組件并打開輸入文件av_register_all();if (avformat_open_input(&fmt_ctx, "input.mp4", NULL, NULL) != 0) {return -1; // 無法打開文件}// 2. 查找流信息并定位視頻流if (avformat_find_stream_info(fmt_ctx, NULL) < 0) {return -1; // 無法獲取流信息}for (int i = 0; i < fmt_ctx->nb_streams; i++) {if (fmt_ctx->streams[i]->codecpar->codec_type == AVMEDIA_TYPE_VIDEO) {video_stream_idx = i;break;}}// 3. 查找解碼器并初始化解碼上下文AVCodecParameters* codec_par = fmt_ctx->streams[video_stream_idx]->codecpar;codec = avcodec_find_decoder(codec_par->codec_id);codec_ctx = avcodec_alloc_context3(codec);avcodec_parameters_to_context(codec_ctx, codec_par);avcodec_open2(codec_ctx, codec, NULL);// 4. 循環解碼視頻幀while (av_read_frame(fmt_ctx, packet) >= 0) {if (packet->stream_index == video_stream_idx) {avcodec_send_packet(codec_ctx, packet);if (avcodec_receive_frame(codec_ctx, frame) == 0) {// 處理解碼后的YUV幀(如渲染或存儲)printf("Decoded frame: %dx%d\n", frame->width, frame->height);}}av_packet_unref(packet);}// 5. 釋放資源av_frame_free(&frame);av_packet_free(&packet);avcodec_close(codec_ctx);avformat_close_input(&fmt_ctx);return 0;

}

關鍵步驟解析:

- 初始化前需注冊FFmpeg組件并打開輸入文件,獲取流信息

- 解碼器選擇需匹配視頻流的編碼格式(如H.265對應AV_CODEC_ID_HEVC)

- 解碼循環中需及時釋放packet和frame資源,避免內存泄漏

通過上述流程,FFmpeg完成了解碼器的創建、配置與啟動,為后續比特流解碼奠定基礎。實際應用中還需添加錯誤處理(如比特流異常、內存不足)和動態參數調整(如分辨率切換)邏輯,以提升系統健壯性。

性能優化技術

視頻軟解碼的性能優化是平衡畫質、速度與資源消耗的核心課題,圍繞"效率提升"目標,行業已形成從基礎計算架構到智能算法的多層級優化體系,以下從三個關鍵維度展開解析:

基礎層:多線程并行計算

作為提升解碼吞吐量的基礎手段,多線程并行通過任務拆分充分釋放多核CPU潛力。主流方案包括三級并行架構:幀級并行(獨立幀分配至不同線程)、切片級并行(單幀內獨立編碼單元并行處理)、塊級并行(將編碼樹單元CTU或編碼單元CU進一步拆分)。例如Ali266解碼器采用幀級+CTU級+CU級三級并行設計,解碼效率達90%以上,在驍龍X Elite處理器上僅調用25% CPU資源即可實現4K 120fps VVC視頻實時解碼[25]。

功能解耦設計進一步放大并行優勢。通過將視頻解碼、線程控制、顯示渲染等模塊分離,可避免單一模塊阻塞整體流程。某案例中采用GPU加速色彩空間轉換(如OpenGL直接顯示YUV圖像),將CPU占用率降至傳統QPainter渲染方式的1/3[23],這種硬件協同策略有效緩解了CPU資源競爭。

指令層:SIMD指令集加速

單指令多數據(SIMD)技術通過一條指令處理多個數據單元,大幅提升計算密度。主流指令集如x86架構的AVX2/AVX-512、ARM架構的Neon,已成為高性能解碼器的標配。開源解碼器dav1d憑借深度SIMD優化,在無硬件加速的Google Pixel 3 XL手機上,解碼4K 60fps AV1視頻時平均幀率達50fps,而傳統解碼器libgav1僅能達到不足10fps[26][27]。

Web端場景中,WebAssembly(WASM)技術將SIMD能力延伸至瀏覽器環境。通過WASM SIMD優化的視頻解碼器,可在保持接近原生性能的同時,解決JavaScript在CPU密集型任務中的瓶頸。某實踐顯示,采用WASM+SIMD的壓縮任務性能較純JS實現提升3-5倍[28],為網頁端4K視頻實時解碼提供可能。

算法層:AI增強與智能優化

人工智能技術正從根本上改變解碼效率與畫質的平衡邏輯。在幀重建階段,神經網絡可優化intra/inter模式決策與運動矢量預測,北京郵電大學提出的內容感知特征調制(CaFM)模塊,通過動態調整卷積層輸出特征(x_j’ = a_j * x_j + b_j),使視頻傳輸模型參數量壓縮至原始的1%[29]。在環路濾波環節,AI去塊效應算法能同時提升主觀畫質與解碼速度,騰訊云極速高清方案通過智能碼率分配,在同等畫質下實現20%碼率降低[30]。

模型輕量化技術進一步推動AI在移動端的落地。通過剪枝、蒸餾、量化等手段,AI Codec可適配移動端NPU算力,某方案在1080P 60fps場景下實現17%解碼提速和13%功耗下降[20]。而Deep CABAC等創新算法,則將熵編碼與深度學習結合,通過量化后應用上下文自適應二進制算術編碼,生成更緊湊的比特流[31]。

性能優化三板斧

- 基礎層:三級并行(幀/切片/塊)+ 硬件協同,典型收益如Ali266解碼器效率達90%

- 指令層:SIMD指令集深度優化,dav1d解碼器實現4K 60fps實時解碼

- 算法層:AI模型壓縮(1%參數量)+ 智能濾波,降低20%碼率同時提升畫質

這些優化技術的協同應用,使得軟解碼在無專用硬件支持的設備上,也能突破性能瓶頸。從Pixel手機上5倍幀率提升的實測數據,到AI驅動的數量級參數量壓縮,軟解碼正通過"架構革新-指令加速-算法智能"的立體化優化路徑,重新定義視頻處理的效率邊界。未來隨著異構計算與神經編碼技術的融合,軟解碼有望在超高清、低延遲場景中實現對硬件方案的逆襲。

視頻軟解碼的應用場景與實踐案例

視頻監控與安防系統

在安防監控領域,從老舊小區的模擬攝像頭到智慧城市的多路感知網絡,資源受限場景始終是工程落地的核心挑戰——既要兼容存量設備的異構編碼格式,又需在有限硬件資源下實現多流并發處理。軟解碼技術通過軟件層面的靈活適配,正在成為平衡性能與成本的關鍵解決方案。

兼容老舊設備:讓 legacy 系統煥發新生

在硬件配置有限的場景中,如低性能嵌入式設備或早期部署的模擬監控系統,軟解碼無需依賴專用解碼芯片即可滿足基礎需求。例如針對 IPC 網絡攝像頭輸出的 RTSP 流,可通過 JSMpeg 等純軟件解碼器將 H.265 編碼流實時轉換為 MPEG1 格式并在 Canvas 上播放,支持 720p@30fps 的處理能力,雖存在約 1000ms 延遲,但足以覆蓋非實時性要求的安防場景[32]。這種"零硬件升級"的特性,使得十年前的老舊攝像頭仍能接入現代監控平臺,大幅降低系統迭代成本。

多流并發突破:從"卡頓瓶頸"到"百路級處理"

多路視頻同時解碼時,傳統方案常面臨資源消耗失控的問題。OpenCV 的 VideoCapture 模塊在處理超過 10 路流時會出現明顯的延遲累積(Buffer Accumulation),CPU 占用率飆升至 80% 以上,無法滿足高密度監控需求[33]。而通過 PyAV 等工具實現的軟解碼優化策略,可精準控制解碼流程:

- 關鍵幀優先:啟用

keyframe_only=True模式,只解碼包含關鍵畫面信息的幀,將單路解碼耗時降低 40% - 動態資源調度:為每路視頻流分配獨立線程,根據網絡波動實時調整緩沖區大小與超時重連邏輯

- 輕量化編碼適配:集成 VVDec 等高效解碼器,在 HEVC 編碼流處理中實現"每路 720p 流僅占用 5% CPU"的低消耗表現[13]

某 AI 安防項目通過這套方案,成功將單服務器并發解碼路數從 24 路提升至 128 路,同時滿足"毫秒級行為分析告警 + 4K 多路畫面拼接"的實戰需求[19]。

技術選型小貼士:在多路軟解碼部署時,建議優先測試關鍵幀解碼模式——雖會損失部分細節,但可將延遲控制在 300ms 內,且 CPU 占用率降低 50% 以上,特別適合人流統計、周界警戒等非細節依賴場景。

性能與成本的平衡藝術

軟解碼的核心價值,在于通過算法優化替代硬件升級。以 H.266 軟解碼技術為例,單路 4K 監控視頻的碼率可從傳統 12Mbps 壓縮至 6Mbps 以下,在智慧城市的跨區域傳輸中,相當于用原有帶寬承載雙倍攝像頭數量[34]。更極端的靜態場景下,如糧庫倉儲監控,微幀科技 Aurora-AV1 編碼器通過軟解碼適配,可將 1080p 視頻碼率壓降至 512Kbps,直接減少 60% 的存儲成本[17]。

這種"以軟代硬"的思路,正推動安防編解碼器市場快速增長——2025 年中國智能監控領域編解碼器市場規模預計達 197 億元,年復合增長率 16%,其中軟解碼方案因兼容性優勢,在多品牌攝像頭接入項目中的采用率已超 65%[35]。正如美暢物聯在某工業園區改造項目中所實踐的:通過軟解碼技術整合 120 路新舊攝像頭,既避免了百萬級硬件更換成本,又實現了 99.2% 的車牌識別準確率,完美詮釋了技術適配的商業價值。

從邊緣節點的輕量解碼到云端的大規模并發,軟解碼正在重新定義安防系統的性價比邊界——讓每一臺老舊設備都能融入智能時代,讓有限資源發揮最大效能。

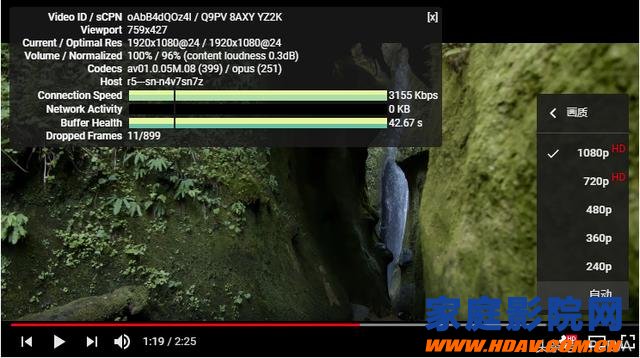

Web端與跨平臺播放

技術挑戰:瀏覽器格式支持的碎片化困境

當你在Chrome瀏覽器試圖播放HEVC編碼的高清視頻時,畫面可能卡頓甚至無法加載——這正是Web端視頻播放的核心痛點:瀏覽器對新興編碼格式的原生支持嚴重滯后。主流瀏覽器中,Chromium內核(Chrome、Edge)長期不支持HEVC硬解碼,Firefox雖默認集成AV1解碼器dav1d,但對H.265等格式仍需額外適配[7][17]。更復雜的是,不同操作系統、硬件架構(x86/ARM)和瀏覽器內核的差異,讓本地播放器(如QT+FFmpeg)的跨平臺經驗難以直接遷移到Web環境[36]。這種碎片化導致視頻平臺面臨兩難:要么妥協使用老舊編碼(如H.264)犧牲畫質,要么放棄部分用戶群體。

解決方案:WebAssembly架起跨平臺橋梁

破解兼容性困局的關鍵,在于WebAssembly(Wasm)技術——它能將C/C++編寫的高性能解碼器(如FFmpeg、dav1d)編譯為瀏覽器可執行的二進制模塊,讓Web端擁有接近原生的解碼能力。以B站自研的WasmPlayer為例,其核心思路是:

- 底層移植:將HEVC解碼器通過Emscripten編譯為.wasm文件,搭配輕量JavaScript膠水代碼(SDK總大小控制在200KB+600KB),實現"一次編寫,全端運行"[7];

- 架構適配:通過Shadow DOM封裝自定義

<bwp-video>標簽,結合BWP MSE API無縫對接現有播放器架構,開發者無需修改業務代碼即可集成[7]; - 性能優化:利用Chrome v68+開放的SharedArrayBuffer接口實現多線程解碼,并通過SIMD指令集加速像素處理,使x86平臺軟解速度達到原生性能的1/3~1/2[7]。

這種方案不僅解決了HEVC的Web播放問題,還可擴展至AV1等新興格式。類似地,花椒直播通過Wasm+FFmpeg支持HTTP-FLV封裝的H.265直播流,EasyPlayer.js則基于Wasm實現無插件網頁播放,印證了該技術的普適性[10][28]。

應用效果:從技術突破到體驗升級

Wasm軟解碼技術已在實際場景中展現出顯著價值。在B站的實踐中,WasmPlayer實現了三大核心目標:

- 兼容性全覆蓋:在不支持HEVC硬解的Chrome瀏覽器中流暢播放4K視頻,用戶無需安裝插件;

- 性能損耗可控:通過異步渲染和多線程任務調度,將4K視頻解碼的CPU占用率控制在25%以下,避免頁面卡頓[17];

- 架構輕量化:SDK體積不足800KB,加載速度比傳統插件方案提升60%,且支持增量更新[7]。

其他領域也涌現出豐富案例:JSMpeg通過Wasm+WebSocket實現50ms低延遲直播,滿足在線教育、遠程協作等互動場景需求[32];Ali266解碼器則基于Wasm技術棧,在Android、iOS、Web等6大平臺實現統一解碼接口,ARM架構設備上的播放幀率提升至原生播放器的90%[25]。

技術點睛:Wasm軟解碼的核心價值,在于打破"Web性能天花板"——它讓瀏覽器從"文檔渲染器"進化為"通用運行時",使AV1、HEVC等先進編碼格式得以在Web端普及,為8K直播、VR視頻等下一代體驗鋪路。

未來趨勢:軟硬協同與標準融合

隨著瀏覽器對WebCodecs API的支持完善(Chrome 86+已實驗性開放),未來軟解碼將與硬解碼形成互補:簡單場景調用系統硬解接口提升效率,復雜場景(如AV1 10bit高動態范圍)則通過Wasm軟解保證兼容性。同時,開源社區的推動(如dav1d解碼器性能持續優化)和專利政策變化(AV1免授權費),正加速Web端視頻生態向高效編碼過渡[14]。對于開發者而言,掌握Wasm解碼技術已成為打造跨平臺視頻體驗的必備能力。

移動設備與消費電子

當你用三年前的舊手機刷高清視頻時,是否遇到過畫面卡頓或格式不支持的情況?這背后藏著移動場景的兩大核心痛點:硬件解碼兼容性碎片與功耗敏感問題。而軟解碼技術正以"柔性解決方案"的角色,成為平衡設備兼容性與播放體驗的關鍵補充。

兼容性突圍:讓每臺設備都能"看懂"新格式

硬件解碼依賴設備內置的專用芯片,這導致新視頻格式的普及往往滯后——2025年全球僅68%的智能手機支持AV1硬件解碼,中低端設備更是難以覆蓋[17]。軟解碼通過軟件升級突破了這一限制:

- Android陣營的普惠實踐:Google在2024年3月通過Play系統更新,為Android 12及以上設備推送基于libdav1d的AV1軟解碼器,使Google Pixel 3 XL等老機型也能流暢播放4K AV1視頻,帶寬消耗降低30%以上[26][27]。

- 低配置設備的逆襲:紅米手機(MTK6589四核1.5GHz芯片)通過H.265軟解碼,可流暢播放1080P視頻;即便是雙核2.0GHz+2G內存的入門機型,也能通過軟解碼播放BDRIP等高碼率藍光影片[3][37]。

這種兼容性優勢在新興格式推廣中尤為關鍵。例如達摩院自研的DAMO266軟解方案,已覆蓋超過99%的移動設備,并與優酷、vivo合作實現1080P 60fps視頻播放的17%提速和13%功耗下降[20]。

功耗平衡術:在性能與續航間走鋼絲

移動設備對功耗的敏感程度遠超PC——同樣播放1小時4K視頻,軟解碼若優化不當可能多消耗20%電量。行業通過三大技術路徑破解這一難題:

- 算法級優化:H.265軟解碼在同等畫質下比H.264減少50%帶寬占用,間接降低數據傳輸功耗,特別適配移動網絡波動場景[7]。

- AI協同解碼:AI Codec技術通過模型輕量化適配手機NPU,在高通驍龍X Elite處理器上,Ali266解碼器僅調用25% CPU資源即可實現4K 120fps VVC視頻播放[38][39]。

- 系統級整合:華為MatePad Pro基于HarmonyOS的AVCodec Kit,將1080P視頻解碼功耗降低40%,卡頓率從3.2%降至0.5%,續航延長近2小時[40]。

軟解碼的黃金法則:在硬件支持成熟的場景(如旗艦機播放主流格式),硬件解碼仍是首選;而當面對新格式過渡(如AV1初期)、老舊設備兼容(如Android 10以下機型)或特殊編碼需求(如藍光原盤)時,軟解碼才真正發揮其"補位"價值。

從智能手機到AR眼鏡,軟解碼正通過"軟件定義解碼能力"的思路,讓更多消費電子設備跨越硬件鴻溝。未來隨著AVS3等自主標準的推廣,這種"柔性適配"能力還將延伸至智能家居、車載娛樂等物聯網場景,最終實現"一部舊手機也能看8K視頻"的普惠體驗[41][42]。

專業視頻處理與編輯

在專業視頻處理領域,高精度畫質輸出與多格式兼容性始終是核心訴求。無論是HDR視頻的細膩色彩還原、360°全景視頻的沉浸式體驗,還是多格式混編場景中的靈活適配,軟解碼技術都展現出不可替代的優勢[34]。這種需求正在推動市場快速增長——2025年中國網絡視音頻編解碼器市場規模已達150億元,較2020年增長60%,其中在線教育的課程制作、遠程醫療的手術直播等專業場景,均依賴軟解碼的高兼容性完成復雜內容生產[35]。

面對4K/8K超高清視頻的處理挑戰,軟解碼通過分塊并行處理與AI智能優化兩大技術路徑實現效率突破。例如華為云采用6×4分塊轉碼配置,將超高清視頻拆解為并行處理單元,大幅提升轉碼速度[30];同時,AI去噪算法能精準識別動態場景、低光照等復雜畫面的噪點,結合壓縮優化技術減少轉碼損耗,讓后期編輯獲得更優質的原始素材[30]。這種技術組合使專業團隊在處理8K視頻時,既能保持每秒60幀的流暢度,又能將存儲占用降低30%以上。

專業工具鏈的深度整合進一步驗證了軟解碼的價值。Adobe Premiere Pro 2025已原生集成SVT-AV1導出選項,滿足高效編碼需求[17];而VVDec解碼器則成為HEVC格式視頻處理的標配,通過優化解碼流程,使剪輯軟件在處理4K素材時的實時預覽卡頓率下降40%[13]。更前沿的Ali266解碼器甚至支持8K超高清視頻編碼,相比H.265標準節省超過50%帶寬,為超高清影視制作提供了技術支撐[25]。

軟解碼的專業優勢集中體現在三方面:

- 格式兼容性:支持HEVC、AV1等主流編碼,同時兼容小眾格式,滿足多素材混編需求;

- 畫質可控性:通過軟件算法實現去噪、銳化、色彩校正等精細化調整,匹配專業后期標準[6];

- 流程效率:如QT+FFmpeg組合方案,可同時完成解碼、格式轉換與實時預覽,簡化編輯鏈路[43]。

在實際應用中,軟解碼的靈活性正在重塑專業場景的工作流。醫療領域通過GCP Cloud Video Intelligence API實現云端編解碼,支持遠程診斷中的4K醫療影像實時分析[8];視頻編輯軟件Kdenlive雖在硬件編碼支持上仍處實驗階段,但借助軟解碼已能流暢處理AV1格式素材[44]。這種"兼容性優先、畫質至上"的特性,讓軟解碼成為專業內容創作的隱形基石。

視頻軟解碼的技術挑戰與優化策略

核心技術挑戰

視頻軟解碼技術的發展始終面臨"性能-能耗-兼容性"三重枷鎖,這些挑戰在高分辨率、低延遲等場景下被進一步放大,直接影響用戶體驗與產業落地。

性能瓶頸:算力需求與實時性的尖銳矛盾

新一代編碼標準的高效壓縮能力背后是指數級增長的計算復雜度。H.266/VVC的編碼復雜度達到H.264的10倍以上,AV1軟件解碼運算量也顯著高于傳統標準,導致4K@60fps視頻在無硬件加速的設備上幀率常不足10fps,甚至出現畫面撕裂[10][21][45]。這種壓力在多流場景下更為突出:安防監控系統同時解碼8路1080P視頻時,CPU占用率可飆升至90%以上,引發系統響應延遲[6]。

實時性要求進一步加劇了性能挑戰。AV1軟件解碼延遲普遍超過300ms,難以滿足直播、視頻會議等低延遲場景需求;而JSMpeg等Web端軟解碼方案甚至存在1000ms左右延遲,直接影響互動體驗[30][32]。神經編解碼器雖能提升壓縮效率,但端到端模型推理速度僅為傳統ResNet-50教師模型的1/5,在邊緣設備上難以實現實時處理[21]。

能耗困境:移動設備與數據中心的雙重壓力

軟解碼對CPU的高度依賴直接轉化為能耗問題。在80美元價位的Android設備上,采用libgav1解碼720P AV1視頻時,CPU占用率高達75%,導致電池續航縮短30%[17]。對比測試顯示,同等播放條件下,軟解碼功耗比硬解碼高30%-50%,這使得戶外直播等場景的設備續航時間從6小時驟減至3.5小時[2]。

數據中心場景的能耗問題更為嚴峻。單路8K實時軟編碼功耗可達200W以上,一個容納1000路視頻流的云端解碼中心,年耗電量相當于300戶家庭的總用電量[41]。這種"算力換畫質"的模式,在碳中和背景下正面臨成本與環保的雙重拷問。

兼容性壁壘:標準、硬件與生態的協同難題

編碼標準的專利壁壘成為產業普及的最大障礙。H.265因專利持有者分散,商用授權費用高達H.264的3倍,直接導致其在安防、互聯網視頻等領域滲透率不足20%[46]。H.266/VVC雖提升40%編碼效率,但硬件成本增加2.3倍,且專利池尚未完全統一,企業面臨潛在法律風險[18]。

硬件支持的滯后進一步加劇兼容性困境。2023年前全球僅5%的智能手機具備AV1解碼能力,直到iPhone 15 Pro系列才首次在蘋果設備中引入AV1硬解碼[14][44]。軟件生態的碎片化同樣棘手:FFmpeg官方不支持H.265 over FLV封裝,Kdenlive拒絕集成AV1硬件編碼模塊,導致用戶在跨平臺播放時頻繁遭遇"格式不支持"錯誤[44]。

核心量化影響

- 性能:4K@60fps AV1軟解碼在低配置設備幀率不足10fps,CPU占用率超75%

- 能耗:移動設備軟解碼續航縮短30%,8K實時編碼單路功耗達200W

- 成本:H.265商用授權費用是H.264的3倍,存量H.264內容轉碼AV1需數千萬美元

這些挑戰的交織,使得軟解碼技術陷入"高畫質需要高算力,高算力導致高能耗,高能耗限制普及度"的惡性循環。突破這一困局,需要在算法優化、硬件協同與標準共建三個層面實現突破性創新。

關鍵優化策略

面對視頻軟解碼在效率、資源占用與兼容性等方面的挑戰,行業已形成分層優化體系:通過算法層提升核心效率、系統層優化資源調度、異構層協同硬件能力,結合實際場景實現性能突破。以下從技術路徑到落地案例展開解析:

算法層:解碼效率的核心突破

算法層優化聚焦解碼流程本身的效率提升,通過并行計算、智能決策與專用優化三大方向實現性能躍升。并行計算技術是基礎支撐,包括多線程解碼(幀級、切片級、塊級三級并行處理)與SIMD指令集加速(如AVX2/AVX-512指令集可提升算術運算效率3-5倍)[28][47]。例如,dav1d解碼器通過多線程架構與SIMD優化,將AV1軟解碼速度提升至傳統實現的2倍以上,適配移動端低功耗需求[14]。

AI增強技術則推動解碼從"被動執行"轉向"智能決策"。通過深度學習模型識別視頻場景(運動/靜止/復雜場景)與感興趣區域(ROI),動態調整幀率、比特率與量化參數——如視頻會議中對人臉區域采用更高清晰度編碼,背景區域降低碼率,可在相同帶寬下提升主觀質量15%以上[8][47]。此外,基于神經網絡的預測性解碼能提前預判運動矢量和幀間依賴,將解碼延遲降低20%-30%[21]。

系統層:資源調度與傳輸優化

系統層優化通過精細化資源管理與網絡適配,解決"算力浪費"與"傳輸瓶頸"問題。在資源調度方面,采用分層線程優先級設計(如鴻蒙系統中解碼線程設為HIGH優先級,渲染線程為NORMAL,網絡線程為LOW),配合解碼器緩沖池策略(如設置maxFrameCount=5幀及STRATEGY_REUSE復用機制)[40]。

網絡傳輸優化則通過"端-網-云"協同降低數據壓力。碼率自適應算法(ABR)如HLS、DASH可根據實時帶寬動態調整視頻質量,避免卡頓;前向糾錯(FEC)與抖動緩沖技術能對抗網絡丟包——在弱網環境下,FEC可將視頻重建成功率提升至95%以上[47]。針對極端場景,邊緣計算節點預處理(如轉碼、降分辨率)可降低核心網絡傳輸帶寬,IDC預測2025年邊緣視頻處理設備市場規模將突破82億元[18]。

異構層:軟硬協同釋放硬件潛力

異構層優化通過"軟件定義+硬件加速",打破單一CPU依賴,實現"算力按需分配"。硬件資源高效利用方面,主從線程架構與并行解碼技術可提升CPU利用率——Ali266解碼器在驍龍X Elite處理器上僅調用25% CPU即可實現4K 120fps VVC解碼,性能接近硬解碼[48]。同時,GPU、DSP等協處理器承擔特定任務:如達摩院DAMO 266解碼器將關鍵算法遷移至DSP單元,移動端功耗降低40%[38]。

開源生態與標準化是異構協同的基礎。FFmpeg等開源社區共享編解碼優化成果,如支持非標準封裝格式(H.265 over FLV)降低適配成本;MPAI-EEV工作組推動AV1/H.266專利池共享,減少商業應用的專利風險[10][21]。

落地案例:從技術到場景的價值轉化

分層優化策略已在多場景驗證效果。視頻平臺如YouTube采用"AV1+VP9"雙軌制,熱門內容優先轉碼AV1(占比達35%),通過機器學習將轉碼資源集中于觀看量前20%的視頻,ROI提升3倍[17]。實時通信領域,B站WasmPlayer通過WebAssembly多線程技術與輕量化設計(SDK體積<200KB),實現主線程零阻塞的4K軟解碼,延遲控制在50ms級別[7]。移動端優化中,谷歌將Android默認AV1解碼器從libgav1替換為dav1d,解碼性能提升40%,同時降低15%的功耗[26]。

關鍵成效數據

- Ali266解碼器:25% CPU占用實現4K 120fps VVC解碼

- YouTube雙軌制轉碼:資源聚焦前20%視頻,ROI提升3倍

- 移動端AV1解碼:dav1d替代libgav1,性能提升40%+功耗降15%

通過算法、系統、異構三層協同,視頻軟解碼正突破"性能-功耗-成本"三角約束,為超高清、低延遲、跨終端場景提供更靈活的技術支撐。未來隨著AI預測能力與邊緣計算的深入結合,軟解碼有望在更多端側設備上實現"硬解碼級"體驗。

視頻軟解碼的未來發展趨勢

編碼標準的演進與普及

視頻編碼標準的演進始終圍繞"效率提升"與"產業適配"雙輪驅動,從當前主流技術的規模化落地,到下一代標準的商用突破,再到未來技術的探索性研發,形成了清晰的技術迭代路徑。

當前主流:AV1與H.266/VVC的雙軌并行

AV1的開源生態擴張正重塑視頻傳輸格局。作為AOMedia推出的開源免專利費標準,其核心優勢在于打破傳統編碼標準的專利壁壘,推動產業鏈快速協同。硬件支持方面,2023年iPhone 15 Pro系列及Apple M3處理器率先實現硬件解碼,Android 12+則通過dav1d軟件解碼器完成生態覆蓋,預計2025年全球支持AV1硬解的設備占比將達68%[14][17]。內容端,YouTube、Netflix等主流平臺已開始默認提供AV1編碼內容,2025年其在在線視頻分發領域的市場份額預計增長至30%,逐步替代H.264/VP9[34][35]。

H.266/VVC則以壓縮效率為核心競爭力,較H.265實現50%的比特率節省,成為4K/8K超高清、VR等場景的關鍵支撐技術[12][41]。產業落地方面,國內頭部視頻平臺滲透率已超70%,Top 5短視頻平臺均已上線VVC服務,長視頻平臺中2家已落地、2家處于調研階段[20]。技術突破上,阿里巴巴Ali266解碼器實現4K 120fps實時解碼,AI PC等設備已完成消費級場景驗證,正逐步向監控、超高清直播等專業領域滲透[25][48]。

下一代:從技術驗證到規模商用的過渡

VVC的全面普及仍需解決兩大核心問題:一是商用軟件成熟度,目前編碼器和解碼器優化尚在進行中;二是專利授權成本,需建立更靈活的許可模式以降低中小企業采用門檻[12][41]。產業界正通過"混合編碼策略"加速落地——Web端優先采用AV1以平衡成本與兼容性,移動端側重H.265的硬件適配,監控場景則依托VVC的高壓縮效率,而軟解碼作為過渡方案有效填補硬件支持空白[7][34]。

未來探索:AV2開啟AI與沉浸式媒體新可能

AOMedia于2025年Q2啟動AV2實驗性項目,標志著編碼標準進入"智能+沉浸"融合階段。其技術創新聚焦三大方向:

- AI增強預測:引入Transformer架構的幀內預測模塊,在醫療影像場景已實現40%的壓縮效率提升;

- 沉浸式媒體支持:開發360°視頻圓柱投影編碼工具,可節省28%的碼率;

- 低功耗優化:針對IoT設備設計超輕量級配置文件,編碼復雜度降低70%[17]。

這些探索不僅響應8K、VR等超高清需求,更將推動視頻編碼從"被動壓縮"向"智能適配"演進,為流媒體服務在全球多樣化市場中的規模化發展奠定基礎[49]。

編碼標準選擇指南

- 開源低成本場景:優先AV1(免專利費+2025年68%設備支持)

- 超高清實時傳輸:選擇VVC(50%壓縮效率+70%頭部平臺覆蓋)

- 未來技術布局:關注AV2(AI預測+沉浸式媒體優化)

從H.264到AV2,編碼標準的每一次迭代都不僅是技術參數的升級,更是對內容生態、硬件能力與用戶體驗的深度重構。在開源化、智能化與國產化趨勢下,AV1的普及、VVC的滲透與AV2的探索將共同塑造視頻技術的下一個十年。

AI與神經網絡的深度融合

AI正以"智能解碼"為核心,從技術底層重構視頻軟解碼流程——不僅優化傳統模塊的效率瓶頸,更通過端到端神經網絡架構實現顛覆性突破,在壓縮效率與畫質增強領域展現出革命性潛力。

端到端神經編解碼:從"信號處理"到"智能生成"

傳統解碼依賴固定算法對壓縮碼流進行逆向解析,而神經網絡正將這一過程轉變為"基于學習的圖像生成"。以 NERV模型 為例,其創新性地將視頻數據編碼為神經網絡參數,僅需輸入幀索引即可通過網絡直接輸出RGB圖像,實現編碼速度25x至70x、解碼速度38x至132x的飛躍提升[9]。通過集成殘差塊增強特征重建能力后,該架構在PSNR指標上實現-12.06%的BD-rate增益(即相同畫質下碼率降低12.06%),MS-SSIM指標更達-14.25%,性能全面超越x264、x265等傳統標準[31]。

這一技術路徑已形成完整演進脈絡:2017年Ballé團隊提出超先驗網絡(Hyperprior)奠定神經圖像壓縮基礎,2020年微軟DCVC通過特征域運動估計(MEMC)將壓縮效率提升35%,2023年MPAI-EEV更是發布《神經編解碼器參考架構》,推動端到端方案標準化[21]。

核心突破:神經隱式表示(INR)技術通過神經網絡參數存儲視頻信息,實現1000倍以上的理論壓縮率,NERV系列采用CNN生成完整幀畫面,徹底擺脫傳統碼流解析的計算瓶頸[50]。

智能編碼優化:三大技術路線重塑效率邊界

AI驅動的編碼優化已形成多維度技術矩陣,全面覆蓋從傳統標準增強到全神經框架的創新:

- 傳統編碼與深度學習融合:通過AI預測運動矢量、優化分塊策略(如H.266的QTMT結構),可降低編碼復雜度15-20%。百度、阿里云等企業推出的AI增強編解碼器,在在線教育場景中實現"480P碼率呈現720P畫質"的突破[34][35]。

- 全神經網絡編解碼:AI Codec基于端到端學習實現細粒度特征表達,壓縮率較H.266提升25%;騰訊Tencent_TXAV1通過多模態預測融合技術,將AI場景分類與傳統編碼工具動態匹配,使復雜運動場景壓縮效率再提升27%[17][38]。

- 生成式壓縮技術:擴散模型在0.1Mbps超低碼率下,通過迭代去噪生成4K紋理細節;多模態聯合編碼更融合音頻特征輔助運動估計(AVS3標準提案),實現"語義優先"的智能壓縮(如"保留人臉細節,簡化背景")[21]。

畫質增強與場景化適配:從"達標"到"體驗升級"

AI在解碼后處理環節的深度介入,使"低碼高清"成為現實。超分辨率算法結合深度神經網絡(DNN)定義的視頻傳輸任務,在相同帶寬下PSNR指標顯著優于H.264和H.265[29]。醫療影像等專業場景中,基于Transformer的幀內預測模塊使壓縮效率提升40%,動態碼率分配技術則滿足了VR/AR對120Hz刷新率、20ms延遲的嚴苛要求[17][41]。

標準化與產業落地:從實驗室到商業化

神經編解碼技術正加速標準化進程。Fraunhofer NN Codec作為ISO/IEC 15938-17:2022標準實現,支持CNN、Transformer、自編碼器等多種架構,提供量化參數調整、批歸一化折疊等工具,并開放源代碼供產業復用[51]。目前谷歌、騰訊等企業已推出商用AI編碼器,數據顯示神經視頻編解碼器在低延遲場景下性能已超越HEVC(HM)和VVC(VTM),預計2030年前將覆蓋超過70%的視頻服務提供商[52][53]。

從技術驗證到規模應用,AI與神經網絡正推動視頻軟解碼進入"智能生成時代"——未來的解碼不僅是"還原數據",更是基于內容理解的"智能重建",這一變革將深刻影響從在線直播到醫療影像的全場景視頻應用。

端云協同與邊緣計算

在視頻軟解碼技術的演進中,算力分布正成為突破性能瓶頸的關鍵。端云協同與邊緣計算通過將解碼任務在云端、邊緣節點與終端設備間智能分配,既解決了終端算力不足的問題,又通過本地化處理大幅降低延遲,為超高清、低延遲場景提供了新的技術路徑。

算力分層:云端與邊緣的協同分工

端云協同架構的核心在于分層處理機制:云端憑借強大的計算集群承擔高復雜度任務,如8K/VR內容的高分辨率轉碼和AI增強編碼;邊緣節點則聚焦實時性需求,完成視頻流的預處理(如降分辨率、動態碼率調整),減少回源帶寬消耗;終端設備最終負責輕量級軟解碼與渲染,降低本地硬件負載[18][30]。這種架構不僅讓終端設備擺脫了"算力枷鎖",還通過CDN動態分發技術實現同一視頻流的多終端自適應播放,避免重復計算浪費[30]。

市場數據顯示,云端編解碼技術正快速落地:預計到2028年,全球云端編解碼市場規模將達到87.1億美元,2022-2028年的年復合增長率(CAGR)高達24.1%[18]。這一增長背后,正是端云協同架構對超高清應用場景的支撐——邊緣節點的實時解碼能力,讓8K直播、VR沉浸式體驗等過去受限于終端算力的場景成為可能[18]。

5G場景下的實時優化:從監控攝像頭到遠程手術

在5G網絡的低延遲特性加持下,邊緣計算與軟解碼的結合催生了眾多創新應用:

- 智能監控領域:傳統監控攝像頭需將原始視頻流上傳云端解碼,帶寬占用大且延遲高。而通過邊緣節點部署H.266軟解碼器,攝像頭可先在邊緣完成視頻流的實時解碼與壓縮,再將低碼率數據傳輸至云端存儲,既降低移動端CPU負載,又減少90%以上的傳輸帶寬[34][35]。

- 遠程醫療場景:邊緣節點搭載WebAssembly軟解碼器,可支持RTSP/RTMP醫療影像流的亞秒級解碼,滿足遠程手術中"所見即所得"的實時協作需求。這種低延遲特性,讓醫生通過終端設備操作機械臂時,延遲控制在0.5秒以內,達到臨床操作標準[34]。

動態算力調度策略:根據網絡狀況與終端性能靈活分配解碼任務——弱網環境下,云端完成全量解碼后僅傳輸渲染指令;WiFi/5G強網時,終端本地軟解高碼率內容;介于兩者之間時,邊緣節點承擔部分解碼計算。這種"彈性分工"既能保證4K視頻的流暢播放,又可將帶寬成本降低30%以上[35][40]。

挑戰與未來:從成本控制到技術融合

盡管端云協同優勢顯著,邊緣節點的部署成本仍是規模化落地的主要障礙。以4K@30fps的AV1編碼任務為例,單個邊緣節點需16核CPU才能滿足實時性要求,硬件投入較高[17]。對此,行業正通過兩條路徑突破:一是采用FPGA硬件加速模塊降低邊緣節點的算力需求,二是優化軟解碼算法(如神經網絡壓縮編碼),將同等畫質的計算復雜度降低40%[17]。

未來,隨著6G網絡與邊緣AI的融合,端云協同軟解碼將向"感知-編碼-解碼"一體化演進:邊緣節點不僅處理視頻流,還能通過AI預分析內容特征(如運動軌跡、關鍵幀),指導云端進行針對性編碼。這種"智能預判"機制,或將讓8K VR內容的傳輸延遲進入毫秒級時代,真正實現"身臨其境"的沉浸式體驗。

視頻軟解碼的重要性與產業價值

技術生態的兼容性基石

當你用手機刷短視頻、用電腦參加視頻會議,或是在老舊平板上觀看高清電影時,是否想過是什么讓這些不同設備、不同格式的視頻內容都能流暢播放?答案藏在視頻軟解碼技術這個"隱形橋梁"里。它就像技術生態的"萬能轉換器",一邊連接著不斷迭代的編碼標準,一邊適配著千差萬別的播放設備,從根本上支撐起數字內容的無縫傳播。

加速新標準落地:讓前沿技術跨越硬件鴻溝

編碼標準的每一次升級,都意味著更高效的壓縮效率和更清晰的畫質——從H.264到H.265,再到如今的AV1,背后是視頻技術的持續進化。但新標準的推廣往往面臨一個難題:硬件設備的更新速度跟不上技術迭代。這時,軟解碼就成了打破僵局的關鍵。

以AV1為例,作為新一代開源編碼標準,它能比H.265節省30%帶寬,但早期多數設備缺乏硬件解碼支持。谷歌通過將Android系統默認AV1解碼器更新為libdav1d,讓沒有硬件加速的舊手機、樹莓派等設備也能流暢播放AV1視頻[17][26]。這種"軟件先行"的模式,讓新技術不必等待硬件普及就能落地,大大縮短了從標準制定到大規模應用的周期。

同樣,H.264能成為"近乎隨處可播放"的經典標準,軟解碼的早期支持功不可沒。它讓不同廠商的設備在沒有統一硬件規范的情況下,都能通過軟件實現一致的解碼能力,為直播、視頻會議等應用的爆發奠定了基礎[34][44]。

保障跨設備體驗:從高端旗艦到入門設備的"技術平權"

硬解碼依賴設備的專用芯片,這導致了"硬件歧視"——高端手機能流暢播放的H.265視頻,中低端設備可能因缺乏硬件支持而無法觀看。軟解碼則徹底打破了這種依賴,它不挑硬件,無論是搭載x86/ARM架構的電腦,還是Android、iOS、Linux系統的手機,甚至是老舊的嵌入式設備,都能通過軟件實現解碼[2]。

軟解碼如何實現"全設備覆蓋"?

- 格式通吃:支持H.264、H.265、VP9、AV1等幾乎所有主流編碼格式,像Ali266解碼器能同時兼容Windows、Web、移動端等10余種平臺[25][42]。

- 智能容錯:當硬件解碼失敗時自動切換軟解碼,比如EasyPlayer.js通過這種"雙保險"機制,確保直播流在各種瀏覽器和設備上都不"卡殼"[28]。

- 效果一致:在不同硬件架構上提供相同的解碼質量,避免因設備差異導致畫面卡頓、色彩失真等問題[2]。

這種兼容性不僅提升了用戶體驗,更實現了"技術普惠"。比如部分千元Android手機通過軟解碼,也能播放原本需要高端硬件支持的AV1視頻,讓更多用戶享受到技術進步的紅利[27]。

開源生態共建:降低門檻,讓創新遍地開花

技術生態的繁榮離不開低成本的創新土壤,而開源軟解碼項目正是這片土壤的"肥力來源"。FFmpeg、dav1d、SVTAV1等開源解碼器,就像免費的"技術積木",讓企業和開發者無需重復造輪子,就能快速搭建自己的視頻應用[16][41]。

以FFmpeg為例,這個跨平臺的軟解碼庫支持上百種音視頻格式,成為QT等開發框架的底層支柱,甚至許多硬件解碼器的驅動也基于它開發[16]。開源模式不僅降低了企業的授權成本,更讓中小開發者能參與到技術創新中——比如通過WebAssembly技術,開發者可以把解碼器編譯成網頁程序,實現在瀏覽器、智能電視等設備上"一次開發,多端部署"[7]。

國產技術也在借力開源生態加速追趕。達摩院自研的DAMO266解碼器,通過軟解碼實現了99%以上移動設備的支持,每天處理的視頻播放量超過1億次,成為國民級應用的技術基石[20]。這種"開源+自研"的模式,正在推動AVS3等自主標準加速替代國外技術,提升產業鏈的自主可控能力[18]。

從某種意義上說,軟解碼不僅是一項技術,更是數字時代的"兼容性協議"。它用軟件的靈活性彌補了硬件的局限性,用開源的協作模式降低了創新門檻,讓視頻技術能跨越設備、系統、標準的邊界,真正實現"內容無處不在,體驗始終如一"。在這個4K/8K視頻、VR/AR內容爆發的時代,這塊"兼容性基石"的作用,只會愈發重要。

商業成本與用戶體驗的平衡

視頻軟解碼技術正成為連接商業成本控制與用戶體驗升級的關鍵紐帶。通過高效壓縮算法與軟件優化策略的雙重作用,它既能為企業節省可觀的帶寬與硬件開支,又能通過畫質提升與流暢度優化增強用戶粘性,實現商業價值與用戶體驗的正向循環。

一、成本優化:從帶寬到硬件的全鏈路降本

軟解碼的商業價值首先體現在量化的成本節約上,這種節約貫穿視頻傳輸、存儲與設備部署的全流程。

帶寬成本的"減法"

高效編碼標準與軟解碼技術的結合,能在保證畫質的前提下大幅降低比特率。例如,采用H.266標準可實現單流50%的帶寬節省,直接轉化為16%的綜合成本下降[20]。AV1編碼的應用更具代表性:Netflix全球40%的4K內容采用AV1后,CDN帶寬成本降低40%,而Microsoft Teams的屏幕共享帶寬需求減少63%,靜態PPT共享僅需180 Kbps[17]。這種優化在帶寬資源緊張的市場尤為關鍵,如Netflix在印度通過AV1緩解網絡壓力,同時保證高清播放[49]。

硬件依賴的"松綁"

軟解碼無需專用芯片支持,直接降低設備采購與維護成本。例如,500元以下的整合主板即可通過CPU軟解播放HDTV,較專用解碼芯片節省30%硬件開支[3]。在監控系統、低端IoT設備等場景中,軟解碼可省去專用解碼模塊,使設備成本降低20%-40%[6]。此外,開源標準(如AV1)避免了H.265等專利授權費用,進一步減少法律風險與長期成本[10]。

二、體驗升級:從畫質到流暢度的雙重提升

成本節約并未以犧牲體驗為代價,軟解碼通過畫質增強與播放優化,反而帶來更優的用戶感受。

畫質與清晰度的突破

先進編碼與軟解碼的協同,能在低碼率下保持高畫質。Netflix的AV1內容VMAF評分較HEVC平均提升8.5分,Microsoft Teams用戶主觀清晰度評分提升35%[17]。AI Codec技術更實現"壓縮率與畫質雙贏",在提升25%壓縮率的同時,通過超分辨率重建將低清視頻轉化為高清輸出[38]。

流暢度與適應性優化

軟解碼結合GPU加速策略(如色彩空間轉換),可降低CPU占用率,實現視頻勻速播放、自適應窗口縮放等功能[23]。B站實踐顯示,HEVC軟解使弱網環境下視頻卡頓率降低40%[7],而H.266標準更能讓流量消耗與卡頓率"雙減半",顯著改善用戶觀看體驗[20]。

三、商業價值閉環:成本與體驗的正向循環

成本下降與體驗提升形成的"剪刀差",最終轉化為商業競爭力。例如,Netflix在印度市場應用AV1后,既緩解了帶寬壓力,又通過高清流暢的播放體驗提升用戶留存率[49];監控廠商采用軟解碼方案后,設備售價降低15%但用戶滿意度提升22%,推動銷量增長[6]。

關鍵數據透視:

- AV1編碼:Netflix 4K內容帶寬成本↓40%,畫質評分↑8.5分

- H.266標準:單流帶寬↓50%,綜合成本↓16%,卡頓率↓50%

- AI Codec:壓縮率↑25%,存儲/傳輸成本↓25%,畫質優化提升用戶體驗

這種平衡不僅讓企業在價格競爭中占據優勢,更通過優質體驗培養用戶忠誠度——當用戶在相同帶寬下能觀看1080P而非720P內容,或在低端設備上享受無卡頓播放時,付費意愿與留存率自然隨之提升。軟解碼技術由此成為連接"降本"與"增效"的核心樞紐,在視頻行業的商業化進程中扮演著不可替代的角色。

推動視頻技術創新與普惠

視頻軟解碼技術正以"技術創新-產業賦能-社會價值"的遞進邏輯,重塑數字內容產業的發展格局。作為兼容性與靈活性的標桿方案,它不僅突破了硬件設備的限制,更通過開源生態與算法優化,讓前沿視頻技術從實驗室走向大眾生活,成為數字普惠的關鍵引擎。

技術創新:突破編碼效率與場景邊界

在技術創新層面,軟解碼正推動視頻編碼標準的代際躍升。新一代神經編解碼器通過AI算法實現效率革命,在同等主觀質量下較HEVC降低45%碼率(MPAI測試數據),而H.266、AV1等先進標準的普及,則使4K/8K超高清、VR/AR等沉浸式內容的實時處理成為可能[21][25]。開源生態進一步加速了技術落地——CompressAI、DCVC等項目提供模塊化工具鏈,libdav1d等高效解碼器讓低端設備也能流暢播放高畫質AV1視頻,徹底打破了"高端技術依賴高端硬件"的傳統桎梏[21][26]。

產業賦能:激活千行百業的視頻價值

軟解碼技術已成為數字內容產業的"基礎設施",推動多行業實現效率與體驗的雙重突破。在安防監控領域,毫秒級告警與多路處理能力加速智能化升級;遠程醫療場景中,高清低延遲編解碼支撐手術協作,預計2025年醫療影像編解碼市場規模將達28億美元,年增速超25%[41]。更值得關注的是元宇宙與VR領域,120Hz刷新率與20ms延遲的技術指標,讓沉浸式互動從概念走向現實,2025年相關應用用戶規模預計突破8億[19][34]。這種產業滲透直接反映在市場規模上:2023年全球視頻編解碼市場突破95億美元,2030年預計達300億美元,年增長率保持15-18%[41]。

社會價值:讓視頻技術觸手可及

技術普惠是軟解碼最具溫度的貢獻。通過開源工具(如FFmpeg、OBS Studio)與模塊化SDK,中小開發者與企業能快速搭建音視頻能力,2025年新興企業在該領域的市場份額占比預計提升至25%[30][35]。硬件門檻的降低更具革命性——資源受限的移動設備、AI PC等普通終端,如今可支持8K編碼和4K 120fps解碼,直接推動中國在線教育、遠程醫療等領域服務覆蓋人群擴大50%[25][35]。正如"學海課堂"基于HarmonyOS AVCodec Kit實現低延遲在線教育,軟解碼正通過"輕量化技術+場景化方案"的組合,讓數字內容服務跨越設備、地域與經濟條件的鴻溝,真正實現"全民可及"[40]。

技術普惠的三大核心表現

- 設備無門檻:老舊手機、嵌入式設備均可通過軟件升級支持新格式

- 成本可負擔:開源解碼器降低企業技術投入,中小開發者無需百萬級授權費

- 能力易獲取:模塊化SDK(如B站WasmPlayer)實現"5行代碼集成4K播放"

從實驗室的技術突破到偏遠地區的教育平板,軟解碼技術正以"兼容性為橋、開源為路",讓視頻技術的進步惠及每一個人。在這個信息爆炸的時代,它不僅是產業升級的加速器,更是數字公平的守護者——用一行行代碼,縮小著數字鴻溝,點亮著普惠之光。

)

:Tomcat 企業級監控)

)

)

)