大型語言模型(LLM)在復雜任務中表現出令人印象深刻的推理能力。然而,LLM在推理過程中缺乏最新的知識和經驗,這可能導致不正確的推理過程,降低他們的表現和可信度。知識圖譜(Knowledge graphs, KGs)以結構化的形式存儲了大量的事實,為推理提供了可靠的知識來源。然而,現有的基于KG的LLM推理方法只將KG作為事實知識庫,忽略了其結構信息對推理的重要性。本文提出了一種稱為圖譜推理(RoG)的新方法,該方法將LLM與KGs協同使用,以實現可信和可解釋的推理。

1 三個步驟

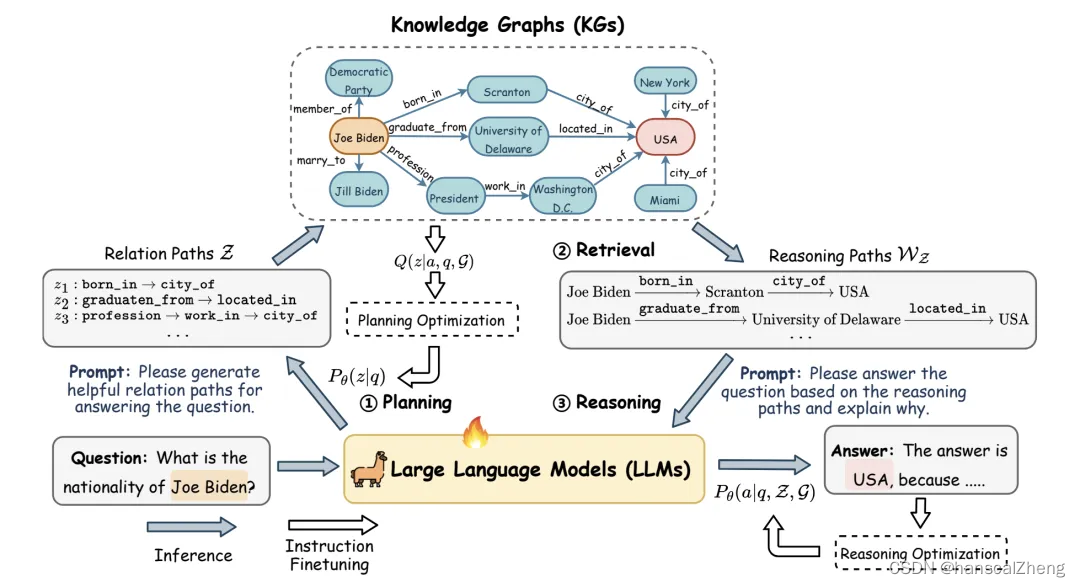

推理圖(Reasoning on Graphs, RoG)提出了一個計劃-檢索-推理框架,該框架的核心流程包括以下幾個步驟:

規劃生成(Planning Generation):給定一個問題,首先使用大型語言模型(LLM)生成若干個基于知識圖譜(KG)的關系路徑作為推理規劃。這些關系路徑捕捉了實體間的語義關系,并被用作推理答案的規劃。

路徑檢索(Path Retrieval):利用生成的推理規劃,從知識圖譜中檢索有效的推理路徑。這一步確保LLM能夠獲取最新的知識,并基于這些路徑進行推理。

推理(Reasoning):基于檢索到的推理路徑,LLM進行推理并生成答案,同時解釋推理過程。

RoG不僅可以從KGs中提取知識,通過訓練提高llm的推理能力,這個過程不僅提高了答案的可信度,還增強了解釋性。還可以在推理過程中與任意llm無縫集成。

2 兩個模塊

RoG包含兩個組成部分:1)一個規劃模塊,該模塊生成以KGs為基礎的關系路徑作為可信規劃;2)檢索推理模塊,首先根據計劃從KGs中檢索有效的推理路徑,然后根據檢索到的推理路徑進行忠實推理,生成具有可解釋解釋的答案。

盡管LLM具有將關系路徑生成為規劃的優勢,但LLM對KGs中包含的關系一無所知,因此LLM不能直接生成以KGs為基礎的關系路徑作為可信規劃。此外,LLM可能無法正確理解推理路徑,并基于它們進行推理。為了解決這些問題,RoG設計了兩個指令調優任務:

規劃模塊優化,將KGs中的知識提取到LLM中以生成忠實關系路徑作為規劃;

檢索-推理模塊優化,使LLM能夠基于檢索到的推理路徑進行推理。

3 結語

RoG通過將LLMs與KGs相結合,提出了一種新穎的規劃-檢索-推理框架,顯著提高了LLMs的推理能力和可解釋性,并在實驗中展示了其在處理高風險場景(如法律判決和醫療診斷)中的潛力,通過提供最新的知識和避免推理過程中的幻覺,RoG提高了LLMs在這些場景中的性能和可信度。

論文題目:Reasoning on Graphs: Faithful and Interpretable Large Language Model Reasonin

論文鏈接:https://arxiv.org/pdf/2310.01061(發表于ICLR2024)

PS: 歡迎大家掃碼關注公眾號_,我們一起在AI的世界中探索前行,期待共同進步!

)

)

)

))

:循環群的兩道例題)