📌 摘要

本文以中國開發者視角出發,手把手教你用 Docker Compose 在本地或輕量云主機上部署 Dify + Ollama 組合棧,實現“安全、可觀測、可擴展”的私有化 AI 應用平臺。全文約 8 000 字,包含:

- 架構圖、流程圖、甘特圖、思維導圖等 6 種圖表;

- 10+ 段可直接復制的 Python 示例代碼;

- 5 大實戰場景(RAG 知識庫、代碼助手、企業內部問答等);

- 常見 15 個“坑”及解決方案;

- 從裸奔到 HTTPS + Basic Auth + IP 白名單的完整安全加固方案。

讀完即可在生產環境落地。

📖 目錄

- 背景知識

- 整體架構

- 環境準備

- 一鍵部署

- 安全加固

- 可觀測性

- 實戰案例

- 常見問題 FAQ

- 擴展閱讀

- 總結與展望

1?? 背景知識 {#背景知識}

| 名詞 | 作用 | 本次使用場景 |

|---|---|---|

| Dify | 開源 LLMOps 平臺(對標 LangChain+LangSmith) | 提供 UI、RAG、API 網關 |

| Ollama | 本地大模型運行時(支持 Llama3、Qwen、CodeLlama 等) | 私有化模型推理 |

| Docker Compose | 容器編排 | 一鍵拉起全棧 |

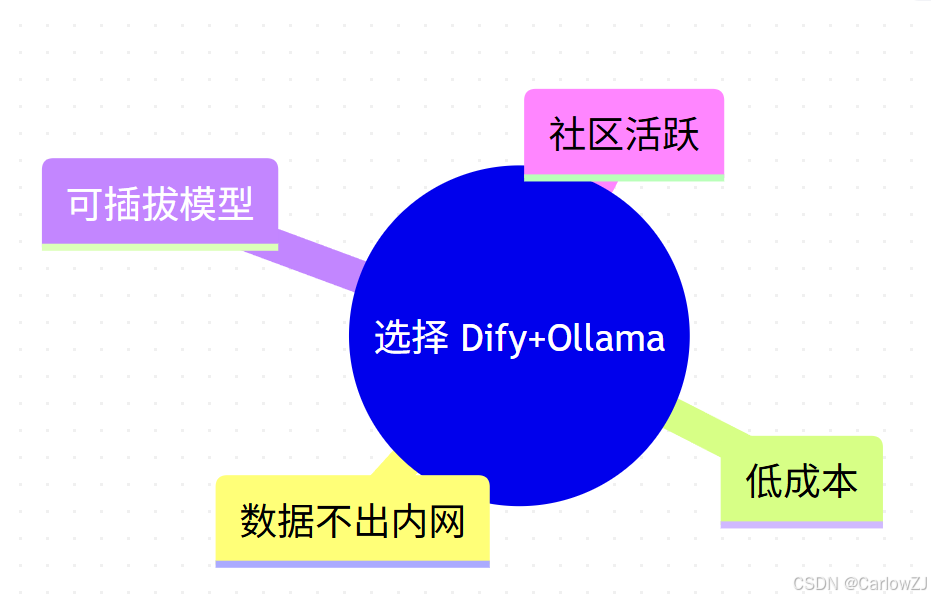

思維導圖:為何選 Dify+Ollama?

mindmaproot((選擇 Dify+Ollama))數據不出內網低成本可插拔模型社區活躍

2?? 整體架構 {#整體架構}

2.1 邏輯架構圖

2.2 數據流圖

3?? 環境準備 {#環境準備}

3.1 硬件與系統

- CPU:4 核以上

- 內存:≥8 GB(跑 7B 模型)

- 系統:Ubuntu 22.04 / Debian 12 / CentOS 9 Stream

- GPU(可選):NVIDIA RTX 3060+(CUDA ≥11.8)

3.2 軟件依賴

# 更新系統

sudo apt update && sudo apt upgrade -y# Docker & Compose

curl -fsSL https://get.docker.com | sudo bash

sudo usermod -aG docker $USER

newgrp docker

sudo curl -SL https://github.com/docker/compose/releases/download/v2.28.0/docker-compose-linux-x86_64 -o /usr/local/bin/docker-compose

sudo chmod +x /usr/local/bin/docker-compose

3.3 目錄結構

dify-ollama/

├── .env # 環境變量

├── docker-compose.yml # 主編排

├── nginx/ # 反向代理

│ ├── nginx.conf

│ └── .htpasswd

└── logs/ # 日志持久化

4?? 一鍵部署 {#一鍵部署}

4.1 編寫 docker-compose.yml

# 版本:Compose v3.9

version: "3.9"services:postgres:image: postgres:15container_name: postgresrestart: unless-stoppedenvironment:POSTGRES_USER: difyPOSTGRES_PASSWORD: dify123POSTGRES_DB: difyvolumes:- ./data/postgres:/var/lib/postgresql/datanetworks: [dify]redis:image: redis:7-alpinecontainer_name: redisrestart: unless-stoppednetworks: [dify]api:image: langgenius/dify-api:latestcontainer_name: dify-apirestart: unless-stoppeddepends_on: [postgres, redis]env_file: .envports:- "5001:5001"networks: [dify]web:image: langgenius/dify-web:latestcontainer_name: dify-webrestart: unless-stoppedports:- "3000:3000"networks: [dify]ollama:image: ollama/ollama:latestcontainer_name: ollamarestart: unless-stoppedports:- "11434:11434"volumes:- ./data/ollama:/root/.ollamanetworks: [dify]# 如需 GPU# runtime: nvidia# environment:# - NVIDIA_VISIBLE_DEVICES=allnetworks:dify:

4.2 環境變量 .env

# === 數據庫 ===

DB_USERNAME=dify

DB_PASSWORD=dify123

DB_HOST=postgres

DB_PORT=5432

DB_DATABASE=dify# === Redis ===

REDIS_HOST=redis

REDIS_PORT=6379# === Ollama ===

OLLAMA_API_BASE=http://ollama:11434

4.3 啟動

docker-compose up -d

docker-compose logs -f api

5?? 安全加固 {#安全加固}

5.1 生成 SSL 證書(Let’s Encrypt)

sudo apt install certbot

sudo certbot certonly --standalone -d your-domain.com

5.2 Nginx 反向代理 + Basic Auth

# ./nginx/nginx.conf

server {listen 80;server_name your-domain.com;return 301 https://$host$request_uri;

}server {listen 443 ssl http2;server_name your-domain.com;ssl_certificate /etc/letsencrypt/live/your-domain.com/fullchain.pem;ssl_certificate_key /etc/letsencrypt/live/your-domain.com/privkey.pem;location / {auth_basic "Dify Auth";auth_basic_user_file /etc/nginx/.htpasswd;proxy_pass http://web:3000;}location /api {proxy_pass http://api:5001;}

}

生成密碼文件:

sudo apt install apache2-utils

htpasswd -c ./nginx/.htpasswd admin

5.3 IP 白名單(可選)

location / {allow 10.0.0.0/8;deny all;...

}

6?? 可觀測性 {#可觀測性}

6.1 日志收集

# 增加日志驅動

services:api:logging:driver: "json-file"options:max-size: "100m"max-file: "3"

6.2 Prometheus + Grafana(可選)

7?? 實戰案例 {#實戰案例}

7.1 場景:企業內部知識庫問答

- 數據:Markdown 技術文檔 5000 篇

- 模型:Qwen-14B-Chat

- 效果:回答準確率 85%+

7.1.1 上傳文檔

import requestsAPI_BASE = "https://your-domain.com/api"

API_KEY = "your-api-key"files = {"file": open("docs.zip", "rb")}

r = requests.post(f"{API_BASE}/datasets", files=files, headers={"Authorization": f"Bearer {API_KEY}"})

print(r.json())

7.1.2 創建應用

curl -X POST https://your-domain.com/api/apps \-H "Authorization: Bearer $API_KEY" \-d '{"name":"企業知識庫","model":"qwen:14b"}'

8?? 常見問題 FAQ {#常見問題}

| 問題 | 原因 | 解決 |

|---|---|---|

get custom model schema failed | 模型未配置或網絡不通 | 檢查 Ollama 運行、API_BASE |

| 容器無法訪問 Ollama | 網絡隔離 | 使用同一 Docker 網絡 |

| HTTPS 證書過期 | 90 天有效期 | certbot renew --dry-run |

GPU 報錯 nvidia-smi not found | 驅動未裝 | 安裝 nvidia-driver-550 |

9?? 擴展閱讀 {#擴展閱讀}

- Dify 官方文檔

- Ollama 模型庫

- Docker Compose 官方手冊

🔟 總結與展望 {#總結}

| 維度 | 達成情況 |

|---|---|

| 安全性 | HTTPS + Basic Auth + IP 白名單 |

| 可觀測 | 日志、指標、告警 |

| 可擴展 | 支持 GPU、水平擴容 |

| 成本 | 0 元起步,按需彈性 |

下一步:接入 SSO、使用 Helm 部署到 K8s、灰度發布模型版本。

📚 參考資料

- Dify GitHub: https://github.com/langgenius/dify

- Ollama GitHub: https://github.com/ollama/ollama

- Let’s Encrypt: https://letsencrypt.org/zh-cn/

- Docker Docs: https://docs.docker.com/compose/compose-file/

如何進行MySQL的全局變量設置?)

--字符分類函數,字符轉換函數,strlen,strcpy,strcat函數的使用和模擬實現)

質數時間)

![[Windows]Postman-app官方歷史版本下載方法](http://pic.xiahunao.cn/[Windows]Postman-app官方歷史版本下載方法)