本文參考:

[1]文心一言回答;

一、核心原理與數學框架

雙重機器學習(Double Machine Learning, DML)由Chernozhukov等學者于2018年提出,是一種結合機器學習與傳統計量經濟學的因果推斷框架。其核心目標是在高維數據和非線性關系下,無偏估計處理變量(如政策、治療)對結果變量(如收入、健康)的因果效應。

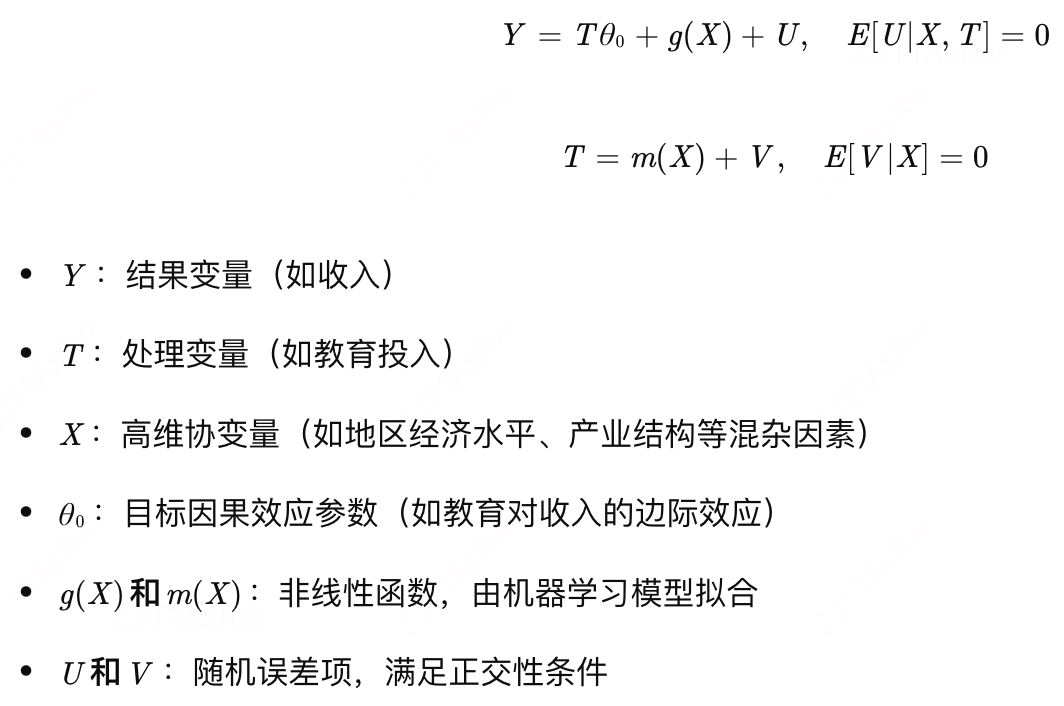

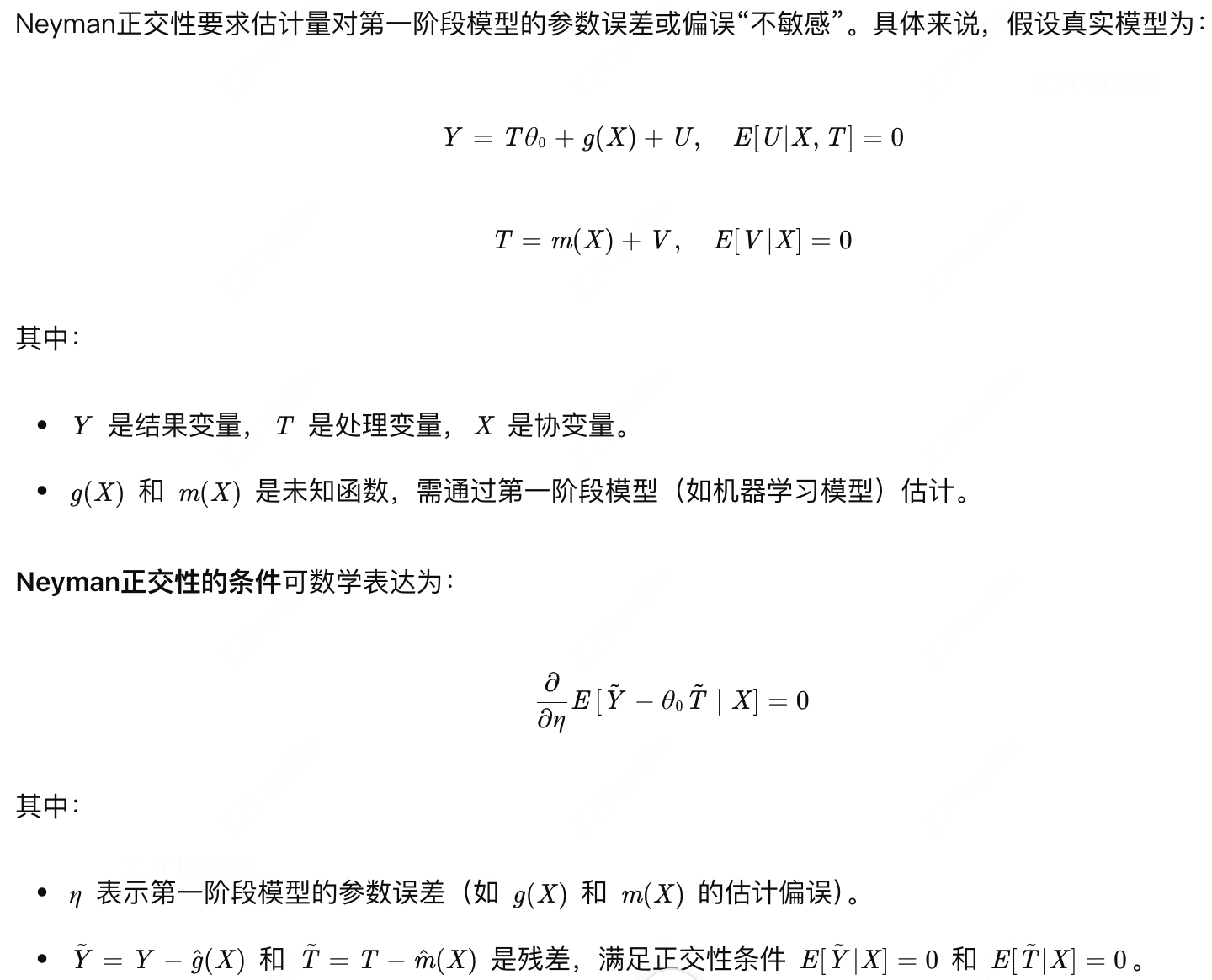

1. 基本模型設定

DML通常基于部分線性模型(Partially Linear Model, PLR):

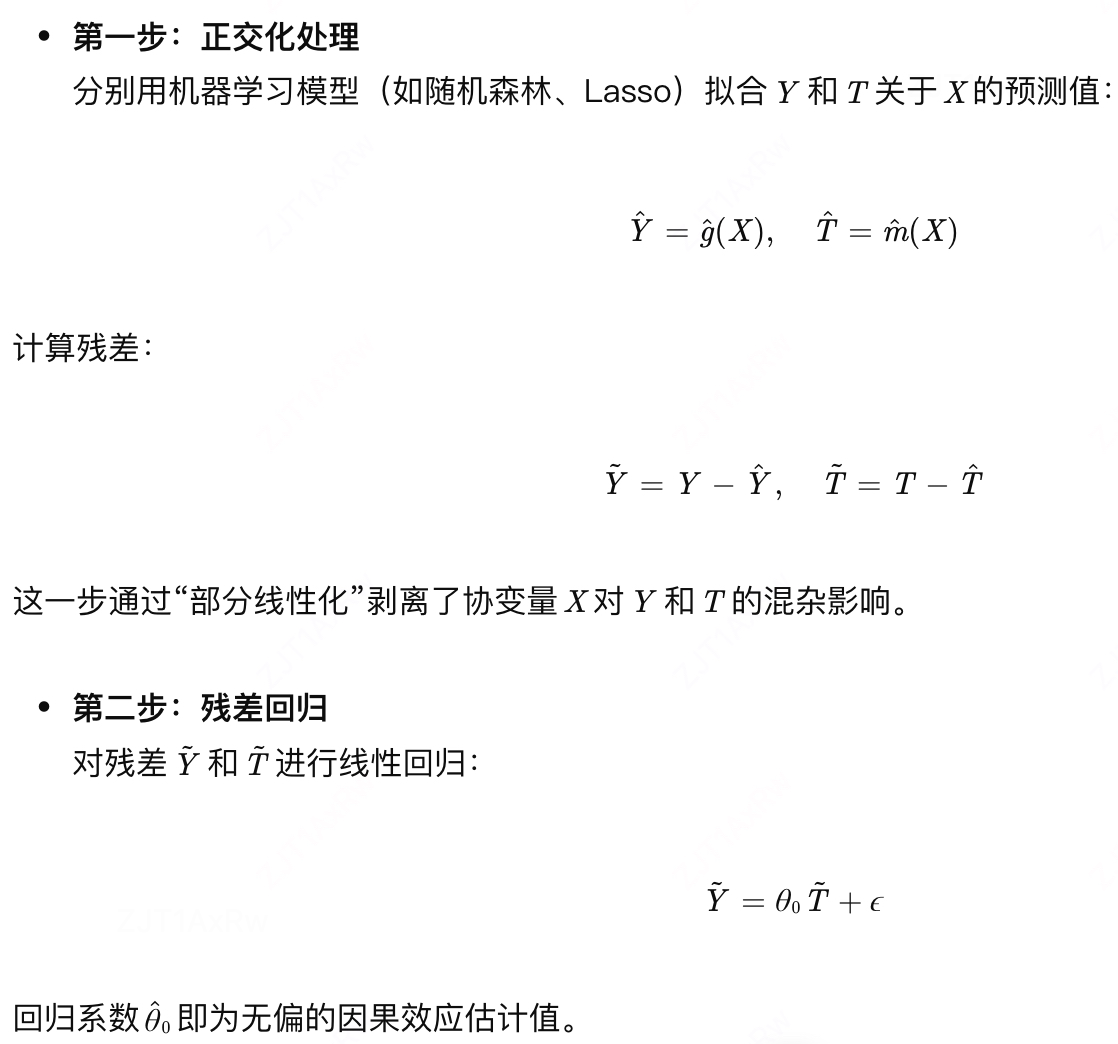

2. 核心步驟:兩階段殘差回歸

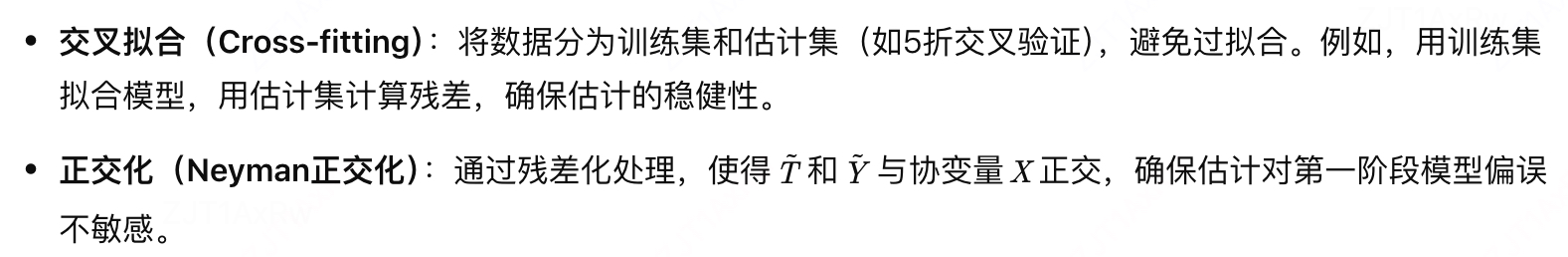

3. 關鍵技術:交叉擬合與正交化

4.DML的優勢

處理高維數據:通過機器學習自動篩選重要協變量,避免“維度詛咒”。

非線性關系建模:支持隨機森林、神經網絡等非線性模型,適應復雜數據結構。

穩健性:交叉擬合和正交化技術降低過擬合風險,確保估計無偏。

二、DML無偏的數學原理

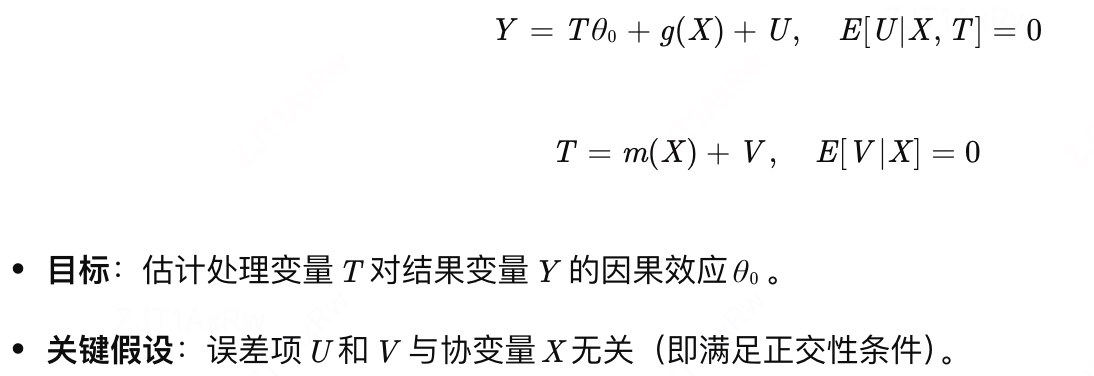

1.數學框架:部分線性模型(PLR)

DML的核心基于以下部分線性模型:

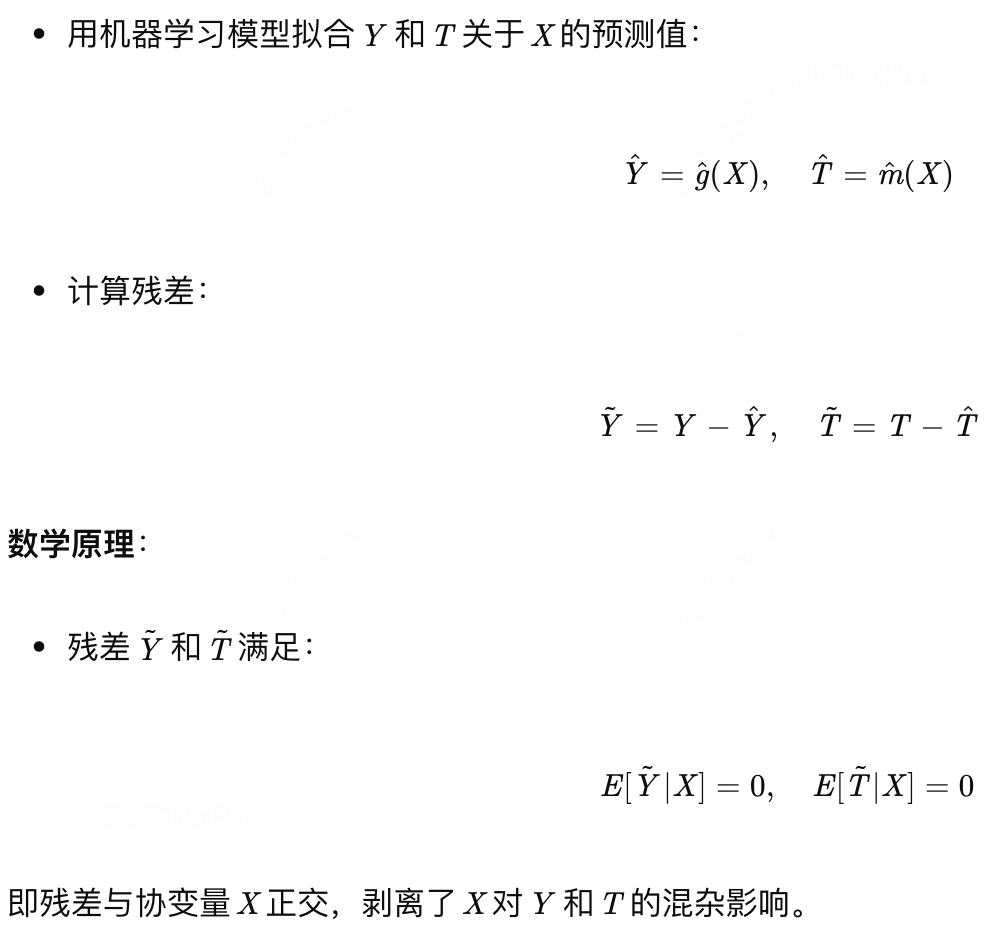

2. 正交化:剝離協變量影響

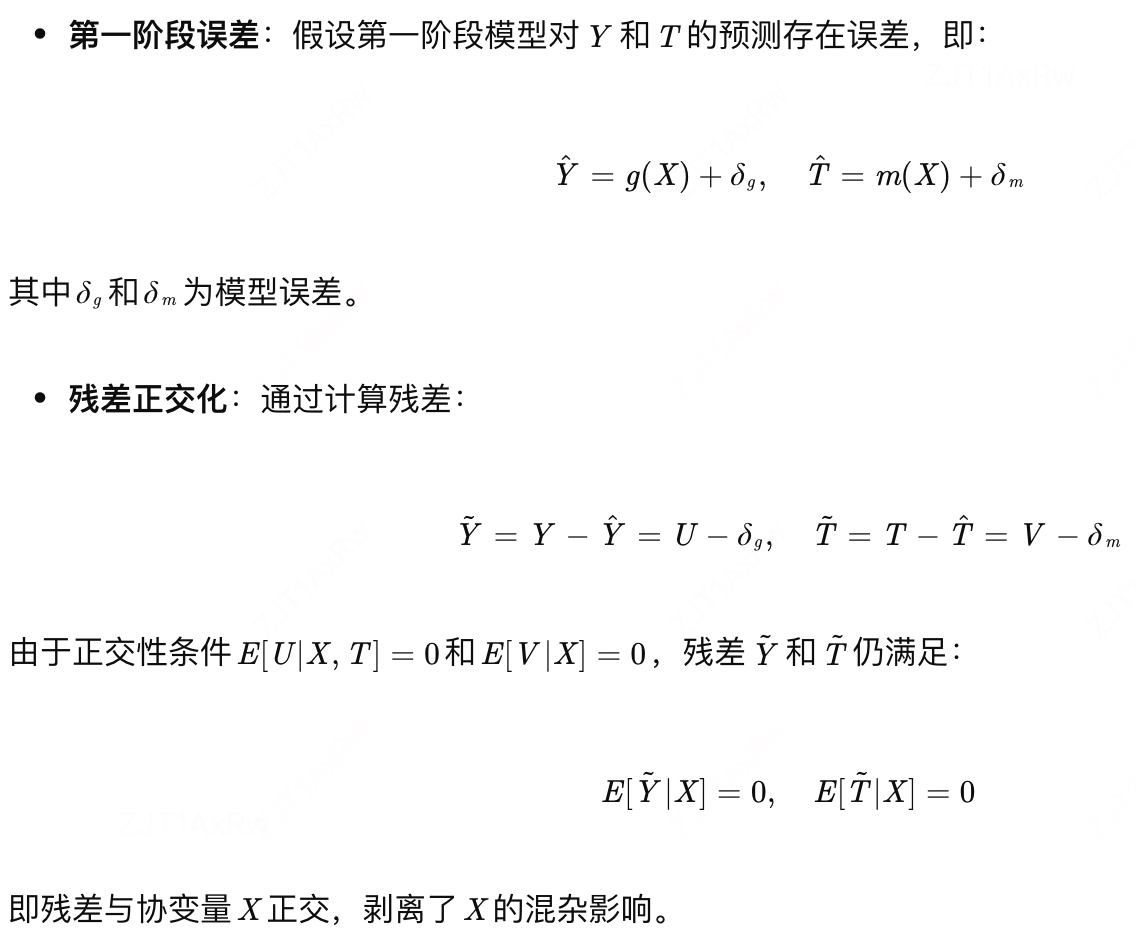

步驟1:殘差化處理

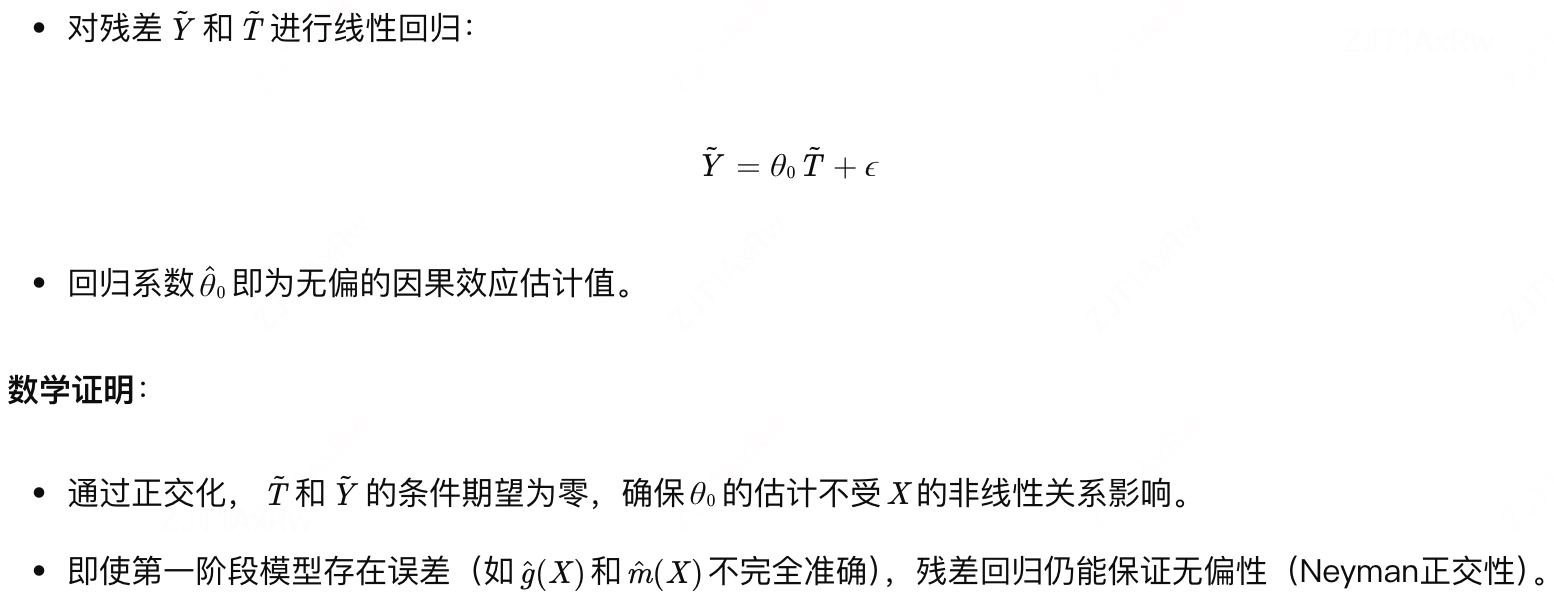

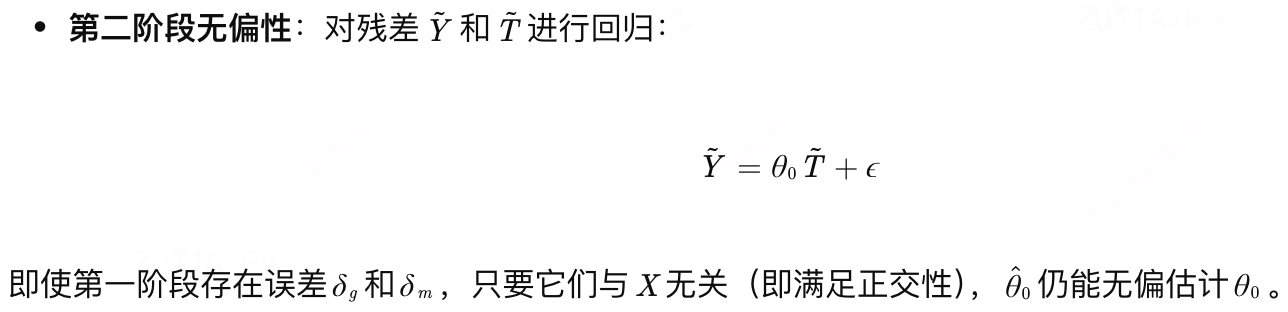

步驟2:殘差回歸

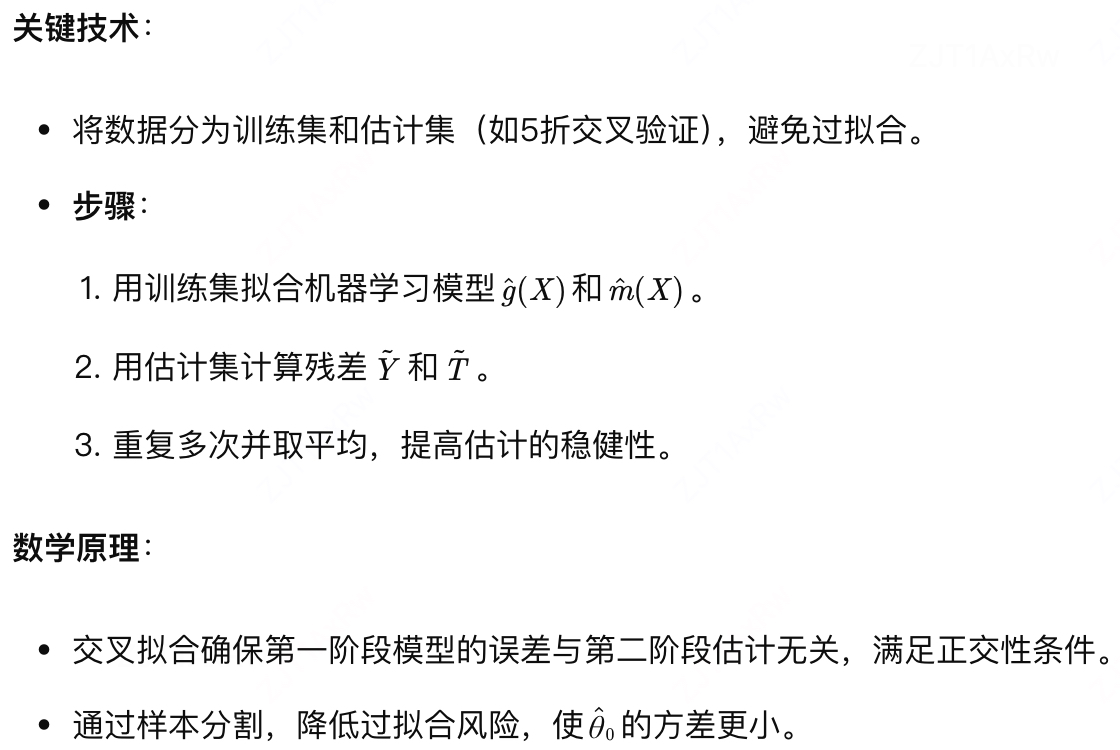

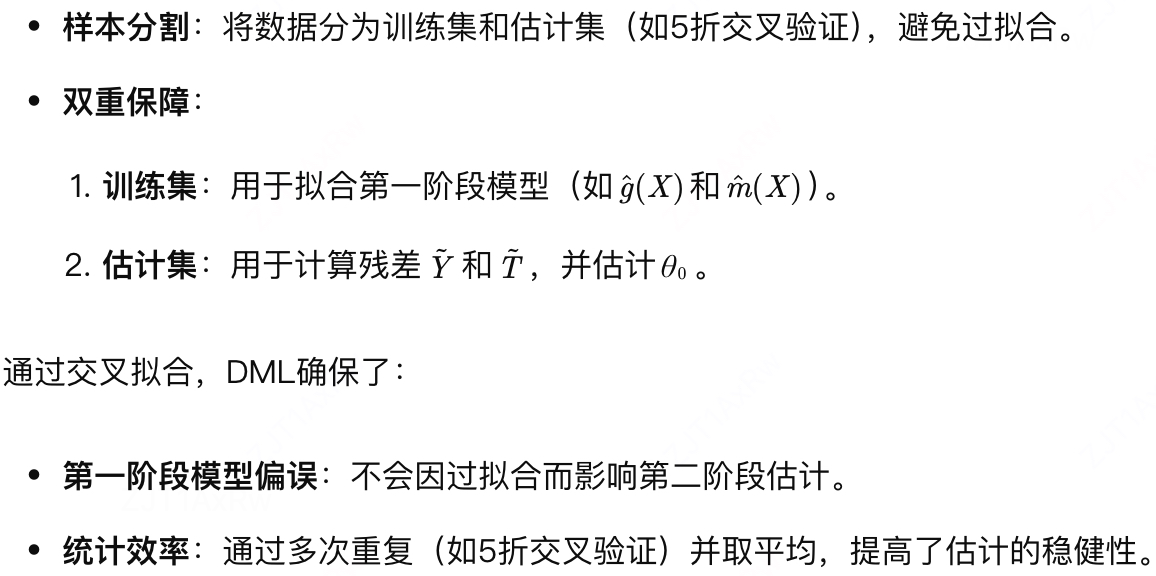

3. Cross-fitting:避免過擬合

4.Neyman正交性:對模型偏誤不敏感

5. 關鍵點總結

正交化:通過殘差化剝離協變量X的影響,確保T~ 和 Y~ 與X正交。

交叉擬合:避免過擬合,提高估計的穩健性。

Neyman正交性:對第一階段模型偏誤不敏感,保證無偏性。

機器學習靈活性:支持非線性模型(如隨機森林、神經網絡),適應復雜數據結構。

三、DML的雙重穩健體現

雙重機器學習(DML)的“雙重穩健”性體現在其對兩種獨立誤差來源的穩健性,以及通過正交化與交叉擬合技術實現的雙重保障。以下是具體體現:

對第一階段模型偏誤的穩健性:即使第一階段模型存在誤差,只要滿足正交性條件,第二階段估計仍無偏。

對模型選擇的穩健性:無論使用線性還是非線性模型,只要正確應用正交化和交叉擬合,估計量都是無偏的。

交叉擬合的雙重保障:通過樣本分割和交叉驗證,避免過擬合并提高穩健性。

3.1.對第一階段模型偏誤的穩健性

DML的核心思想是通過兩階段殘差回歸剝離協變量X的影響。其雙重穩健性首先體現在:即使第一階段模型(用于擬合Y和T關于X的預測值)存在誤差,只要滿足正交性條件,第二階段的估計仍能保持無偏。

3.2.對模型選擇的穩健性

DML的雙重穩健性還體現在:無論使用線性模型還是非線性機器學習模型,只要正確應用正交化和交叉擬合,估計量都是無偏的。

3.3.交叉擬合的雙重保障

DML通過交叉擬合(Cross-fitting)技術進一步強化了穩健性:

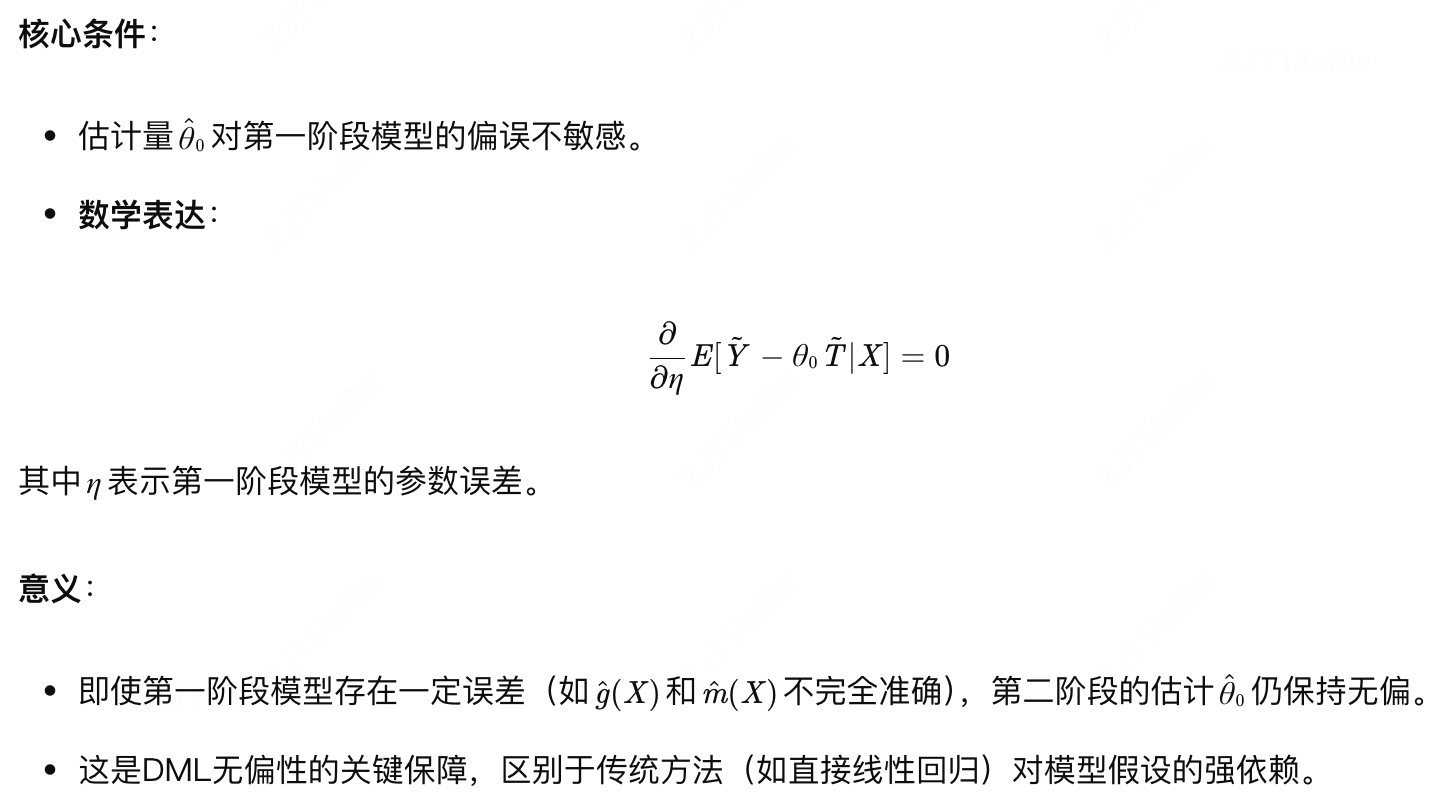

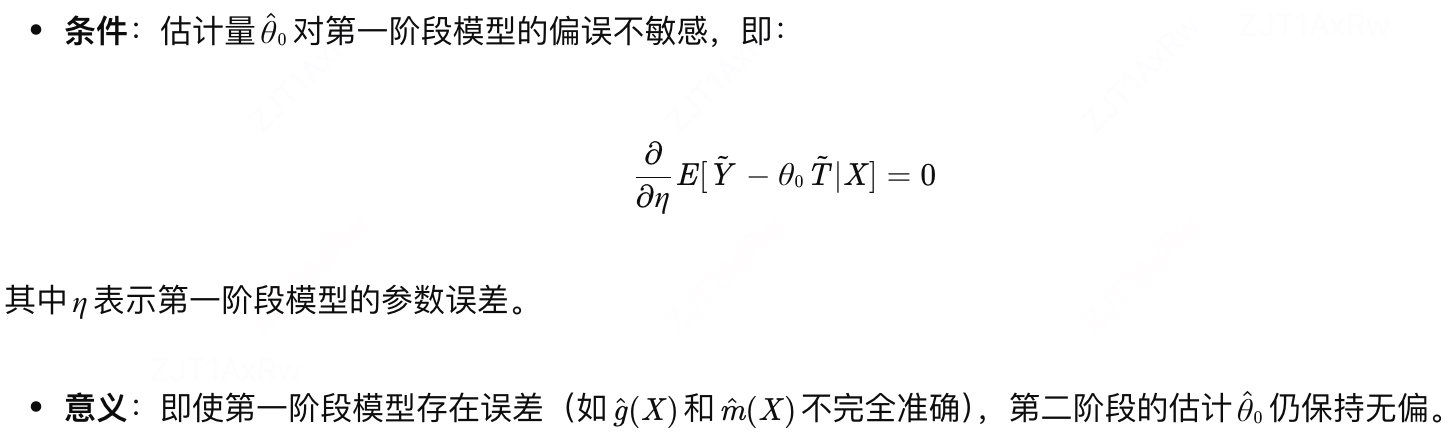

3.4.數學證明:Neyman正交性

DML的雙重穩健性可嚴格證明為Neyman正交性:

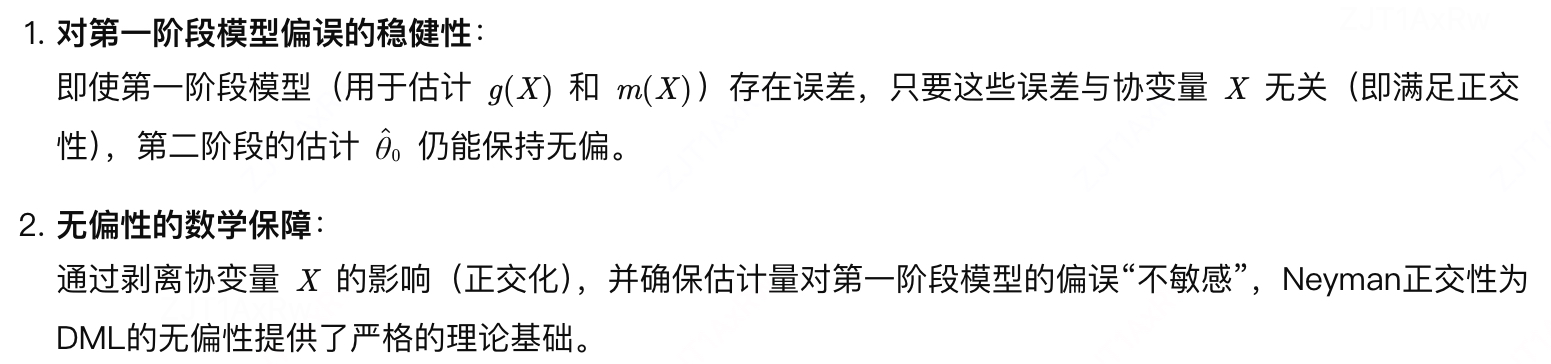

四、Neyman正交

Neyman正交性(Neyman Orthogonality)是統計學和計量經濟學中的一個核心概念,尤其在因果推斷和雙重機器學習(DML)中扮演關鍵角色。其核心思想是確保估計量對第一階段模型偏誤不敏感,從而保證估計的無偏性。以下是詳細解釋:

4.1.定義與數學表達

4.2.核心意義

Neyman正交性確保了以下兩點:

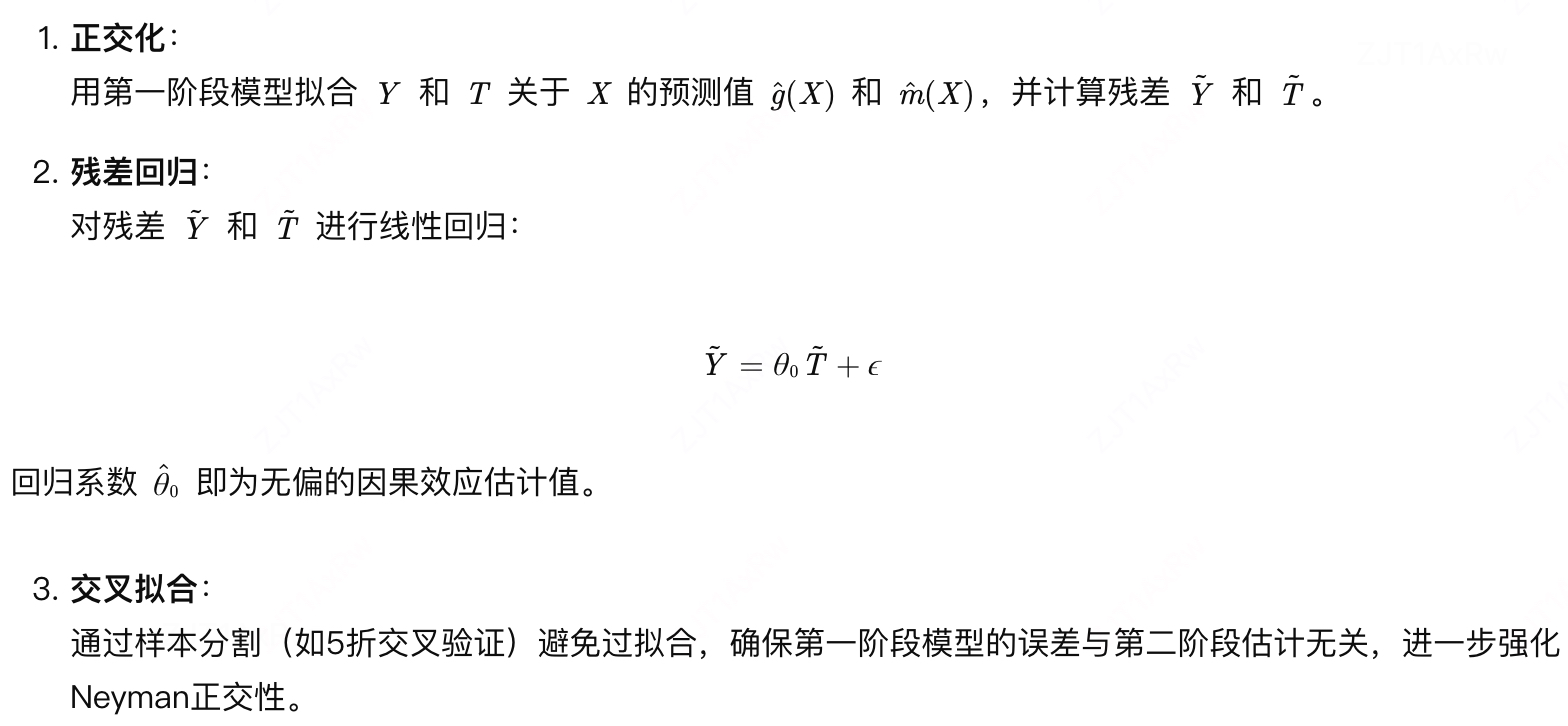

4.3.在DML中的作用

在雙重機器學習中,Neyman正交性通過以下步驟實現:

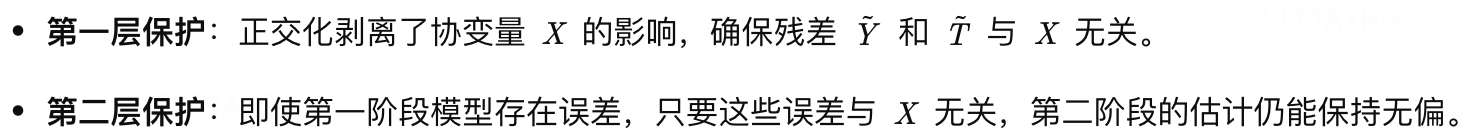

4.4.直觀理解

Neyman正交性可理解為一種“雙重保護”:

總結

Neyman正交性是雙重機器學習(DML)無偏性的核心數學保障。它通過要求估計量對第一階段模型的偏誤“不敏感”,并結合正交化和交叉擬合技術,確保了在高維數據和非線性場景下因果效應的準確估計。

)

8.21)

)

)

理論)

)