B站維度之言:

B 站 2025 新聲計劃:IndexTTS 全維度拆解

——從開源血統到中文特調的架構復盤

1:打破邊界:Index-TTS 的技術動因

場景野心:直播實時口播、無障礙字幕、AI 虛擬 UP 主……B 站需要一把“聲音瑞士軍刀”,于是 IndexTTS 立項。

1.1站在巨人的肩膀上:Index-TTS的起點

如果把 IndexTTS 比作一輛性能跑車,那它的底盤就是 Coqui 的 XTTS 與 Tortoise——前者負責“多語言漂移”,后者主打“高保真聲浪”。可惜,這套原廠配置在上中文賽道時暴露出兩大硬傷:

? 多音字陷阱:中文的“長/長、行/行”像連續發卡彎,原版引擎經常讀錯彎心。 ?

? 實時性瓶頸:Tortoise 的“高保真”等于“慢工出細活”,在 B 站直播這種“零延遲”賽道里明顯掉隊。

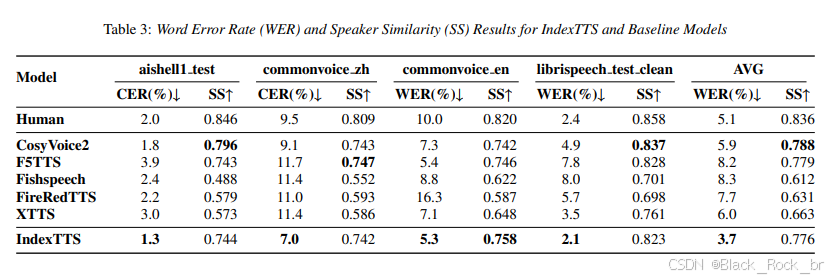

再加上 CosyVoice2、Fish-Speech、F5-TTS 等國產改裝件仍留有 WER 偏高、音色發澀的小毛病,B 站干脆自己下場調校——把彈幕、虛擬主播、實時口播這些“極端工況”統統寫進需求表,于是 IndexTTS 應運而生:既能在彈幕雨里精準咬字,又能在直播間一腳油門瞬時出音。

1.2需求翻譯機:IndexTTS 想一口氣解決哪些難題

1.3時間卷軸 & 彈幕回聲:IndexTTS 進化日志

- 音質飛躍,聲如其人:全面優化音色克隆能力與語音自然度,讓合成聲音在情感、語調和細節上更貼近真實人聲,實現高保真語音輸出。

- 精準發音,告別“讀錯字”:引入拼音引導機制,有效解決中文多音字識別難題,顯著降低詞錯誤率,提升語音表達的準確性和可懂度。

- 高效引擎,規模落地:在不犧牲音質的前提下,大幅優化訓練與推理效率,降低資源消耗,支持高并發、低延遲的工業級大規模部署。

項目關鍵里程碑(基于公開線索與技術趨勢推測):

2024年末:B站正式啟動 IndexTTS 研發項目,融合 XTTS 的高效架構與 Tortoise-TTS 的高自然度優勢,致力于打造新一代開源中文語音合成系統。 2025年2月:項目在社交平臺 X 上首次預熱,官方透露 IndexTTS 在詞錯誤率(WER)等關鍵指標上已超越主流模型,引發社區廣泛關注。 2025年3月:預計正式開源發布,時間點契合當前技術節奏,有望迅速成為中文語音合成領域的重要力量。

社區反響與潛力預期:

早期曝光后,X 平臺用戶熱議其創新的拼音糾錯機制,尤其在處理多音字和生僻詞方面表現突出。不少開發者表示期待將其集成至語音助手、有聲內容生成等場景。IndexTTS 不僅展現了技術實力,更有望樹立中文TTS的新標準。

1.4聲臨其境:Index-TTS 賦能的智能生態版圖

它能讓虛擬主播秒換聲線,也能給短視頻一鍵“開口說話”;在課堂里化身 AI 朗讀助教,在直播間充當實時彈幕播報員。開源社區把它當“新基建”瘋狂二創,投資方則盯上了它背后的 SaaS 收費、廣告配音、IP 聲庫等商業化金礦。

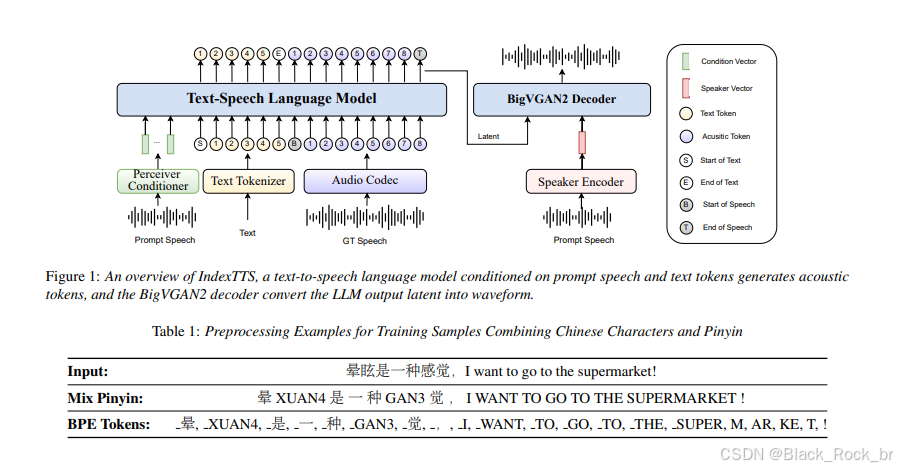

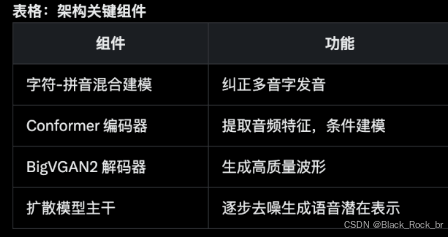

IndexTTS 采用先進的擴散模型與深度神經網絡架構,融合了 XTTS 的高效推理能力與 Tortoise-TTS 的高保真語音生成優勢,并針對中文語音特點進行了多項創新性改進。通過引入定制化模塊,顯著提升了語調自然度、多音字處理和音色還原能力。以下是其核心架構與關鍵技術解析:

1.5漢拼混血引擎:讓漢字與拼音同桌飆戲

難題突破:精準攻克中文多音字發音難題

中文中大量存在多音字(如“長”可讀作“zhǎng”或“cháng”),其正確發音高度依賴上下文,傳統TTS系統常因語義理解不足而誤讀,影響語音自然度與可懂度。IndexTTS 創新性地引入拼音引導的混合輸入建模機制,讓用戶可通過顯式標注拼音來精確控制發音,實現“想怎么讀,就怎么讀”。

實現方案:

靈活輸入層:支持純文本輸入,也支持“文本+拼音”混合模式。用戶可在關鍵位置標注拼音(如“長大”寫作“zhǎng大”),系統將拼音作為強先驗條件注入生成流程。 智能預處理管道:若未提供拼音,系統自動調用內置語言模型進行上下文感知的拼音預測;若已標注,則優先采用用戶指定發音,兼顧自動化與精準控制。

實際效果:

在多音字密集場景下,詞錯誤率(WER)顯著下降,發音準確率大幅提升。無論是“重”(chóng / zhòng)、“行”(xíng / háng)還是復雜成語與古詩詞,IndexTTS 均能穩定輸出符合預期的讀音,真正實現“讀得準、聽得懂”。

1.6聲波變形器:Conformer 條件編碼的魔法內核

核心架構:基于 Conformer 的多模態特征融合

采用 Conformer(卷積增強型 Transformer)作為骨干網絡,融合卷積層的局部感知能力與自注意力機制的長程依賴建模優勢,能夠高效捕捉語音信號在時間與頻域上的復雜特征,為高質量語音合成奠定基礎。

? 工作原理:

音色與語調提取:從參考音頻中提取聲學特征(如梅爾頻譜、音高輪廓等),精準捕捉說話人的音色特質和自然語調模式。 條件融合機制:將提取的音頻特征與文本及拼音編碼進行多層次對齊與融合,作為擴散模型的強引導條件,實現個性化語音的高保真重建。

? 核心優勢:

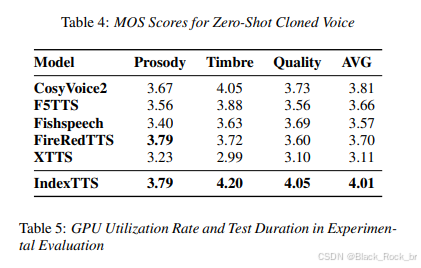

顯著提升生成語音的說話人相似度與韻律自然度,讓合成聲音不僅“像真人”,還能準確還原情感起伏與說話風格,尤其適用于音色克隆、情感化播報等高要求場景。

1.7BigVGAN2:高保真語音重建的核心解碼引擎

BigVGAN2:把擴散模型吐出的“草圖”瞬間渲染成 Hi-Fi 聲波 ?

? 身份:GAN 家族的 2.0 號音效師,BigVGAN 的極速升級版 ?

? 工作流程: ?

① 接過擴散模型生成的中間聲紋“線稿” ?

② 用對抗訓練這把“超清畫筆”填補細節、銳化音質 ?

? 戰績:同 WaveNet 這類“老工匠”相比,聲線更通透、渲染耗時砍半,推理像開倍速播放一樣快。

1.8從噪聲到波形:擴散主干的“去噪魔法陣”

傳承與進化:基于 XTTS 擴散架構的深度優化

IndexTTS 很可能繼承自 XTTS 的核心生成機制,采用去噪擴散概率模型(Denoising Diffusion Probabilistic Models, DDPM),通過逐步從噪聲中恢復語音的潛在表示,實現高保真語音合成。

關鍵改進:

在原始擴散架構基礎上,引入 Conformer 編碼器增強上下文建模能力,并融合拼音級語言信息作為強條件引導,顯著提升去噪過程中的語義連貫性與發音準確性。這一優化不僅加快了生成收斂速度,更有效避免了語音斷續、錯讀或多音字混淆等問題,使合成語音在自然度和可懂度上實現雙重躍升。

1.9從數據到模型:IndexTTS 的訓練體系解析

燃料與靶心 ?

? 燃料:B 站自家 UP 主的海量語音 + 公開 AISHELL,全部打上拼音標簽,像給每段音頻配了“發音說明書”。 ?

? 靶心:同時瞄準三發十環——詞錯率壓到最低、音色 MOS 逼近真人、推理延遲砍到毫秒級。

2:從創新到落地:IndexTTS 的高光時刻與現實約束

2.1從痛點出發,打造真正懂中文的TTS

三大殺招,一次說清: ?

1. 拼音外掛:遇到多音字直接“點名”,讀音零踩坑。 ?

2. Conformer+BigVGAN2 雙劍合璧:前者精準建模,后者秒級出高清聲線,既好聽又不卡。 ?

3. 成績單刷新:WER 把 CosyVoice2 等前輩甩在身后,直接立起中文 TTS 新標桿。

2.2現階段的不足與未來優化空間

拼音外掛雖好,卻像強制“帶身份證”——用戶得先給句子注音,步驟多一步。

中文專精是把雙刃劍:英文、日語等場景暫時“口音生疏”,多語言版圖比 XTTS 小一圈。

速度確實快了,但離直播級“150 ms 內響槍”仍有小半步,實時黨依舊想再擠一擠性能牙膏。

相關文獻

github地址:https://github.com/index-tts/index-tts?tab=readme-ov-file

arxv論文:https://arxiv.org/pdf/2502.05512

)