AGI

AGI(Artificial General Intelligence),中文名為“通用人工智能”或“強人工智能”,是指通過機器學習和數據分析等技術,使計算機具有類似于人類的認知和學習能力的技術.

多模態的大模型

(Multimodal Large Language Models,MuLLMs)是一種新興的人工智能技術,它能夠理解和生成多種類型的數據,包括文本、圖像、視頻等。這些模型通常基于Transformer架構,并使用大規模的數據集進行訓練。

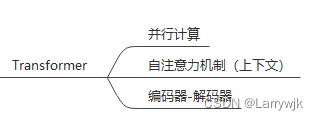

Transformer

Transformer是一種基于注意力機制的深度學習模型。Transformer模型主要用于處理序列數據,如文本、語音、圖像等,其核心思想是通過自注意力機制來捕獲輸入序列中的依賴關系,從而實現更好的建模和預測能力。

Transformer模型主要由兩部分組成:編碼器和解碼器。編碼器將輸入序列轉換為一個表示,這個表示可以被解碼器用來生成輸出序列。解碼器使用編碼器的輸出和目標序列(如果有的話)來生成輸出序列。

Transformer模型的優點包括:

1.并行計算:Transformer模型可以并行處理輸入序列中的多個元素,這使得它在處理長序列時能夠更快地完成計算。

2.更好的捕獲長距離依賴:Transformer模型通過注意力機制來捕獲輸入序列中的長距離依賴,這使得它在處理長文本、語音、圖像等長序列時能夠取得更好的效果。

3.更好的泛化能力:Transformer模型通過自注意力機制來學習輸入序列的全局依賴,這使得它在面對新的、未見過的輸入時能夠更好地進行泛化.

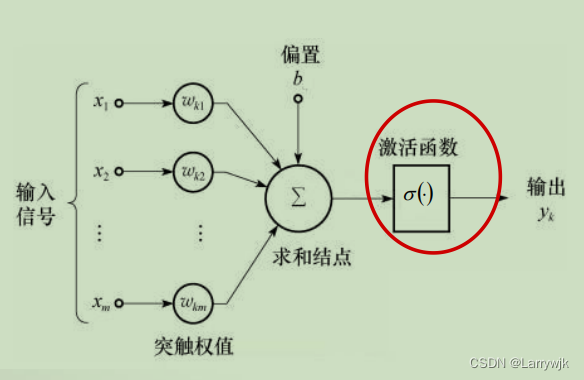

基于注意力機制

在注意力機制中,模型會為每個輸入元素分配一個權重,這個權重表示了該元素對于當前任務的重要性。通過這種方式,模型可以專注于最重要的元素,從而提高整體性能。

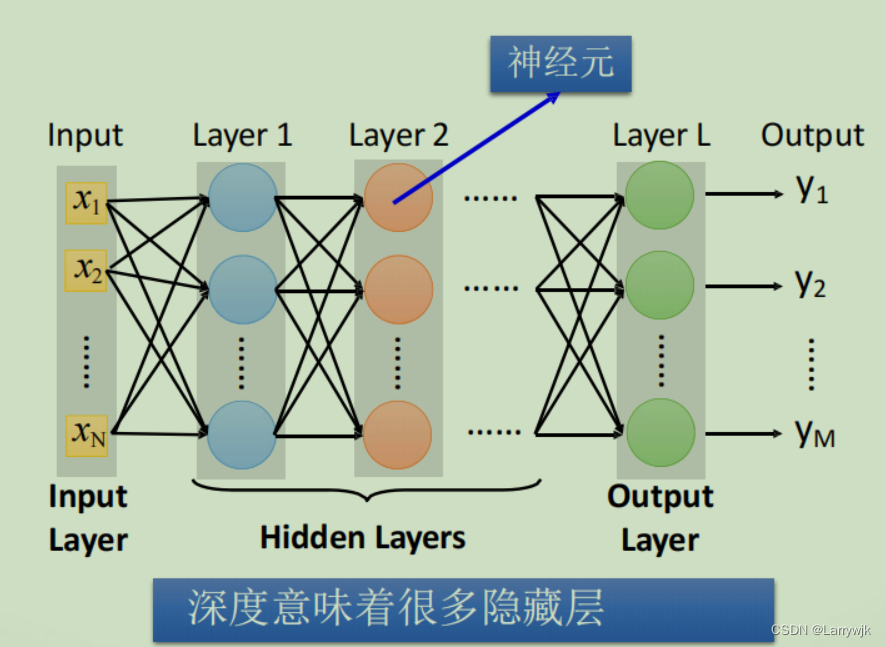

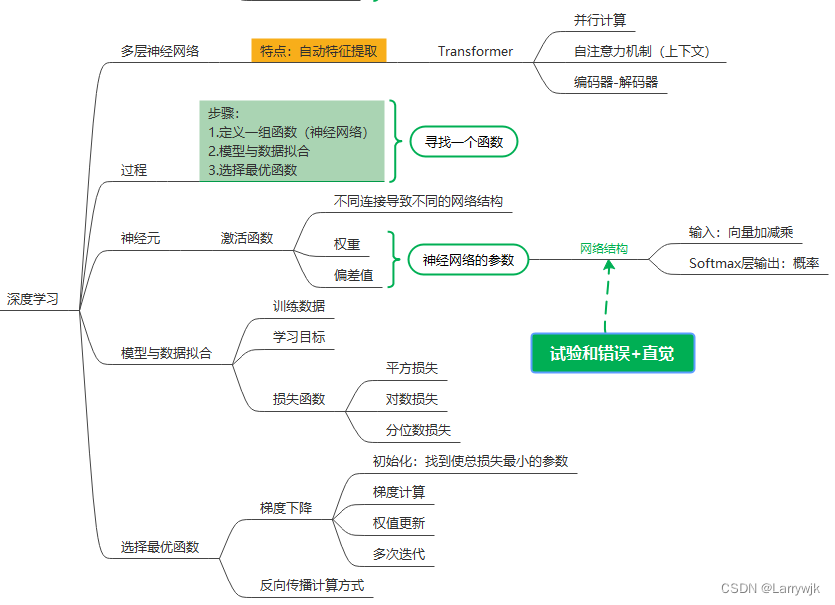

深度學習

)

)

)

——Netty入門)