文章目錄

- 固定部分層參數

- 固定指定層的參數

- 不同層設置不同的學習率

固定部分層參數

class RESNET_attention(nn.Module):def __init__(self, model, pretrained):super(RESNET_attetnion, self).__init__()self.resnet = model(pretrained) # 這個model被固定for p in self.parameters():p.requires_grad = Falseself.f = nn.Conv2d(2048, 512, 1)self.g = nn.Conv2d(2048, 512, 1)self.h = nn.Conv2d(2048, 2048, 1)self.softmax = nn.Softmax(-1)self.gamma = nn.Parameter(torch.FloatTensor([0.0]))self.avgpool = nn.AvgPool2d(7, stride=1)self.resnet.fc = nn.Linear(2048, 10)

但是注意需要在optimizer中添加上這樣的一句話

filter(lambda p: p.requires_grad, model.parameters())。

optimer =

固定指定層的參數

for k,v in model.named_parameters():if k.startswith ='XXX':v.requires_grad=False#固定參數

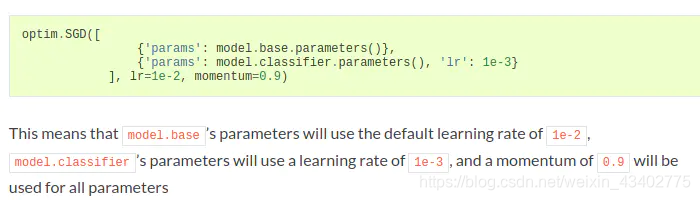

不同層設置不同的學習率

,torch.cuda.device_count(),torch.cuda.get_device_name(0))

)

)

)