一、邏輯回歸多分類

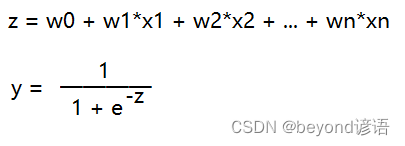

假設激活函數使用的是sigmoid函數

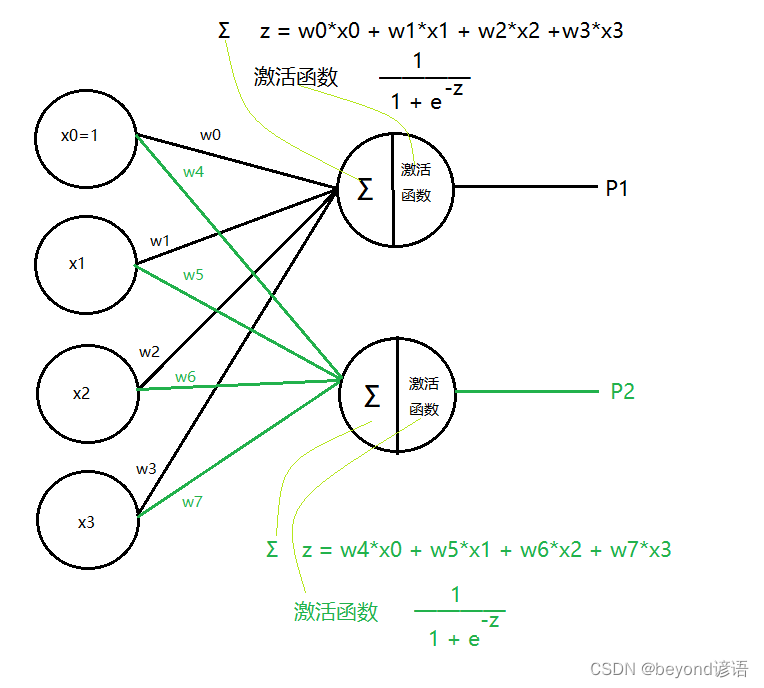

邏輯回歸多分類其實是多個二分類而已,若求三分類問題需要對訓練的數據樣本進行適當的修改調整即可,如何修改樣本數據可以參考邏輯回歸二分類和多分類本質區別,內容都一樣,這里就不在過多的贅述。

最后計算處的p1和p2是個概率,范圍在0-1直接,因為這里的激活函數是sigmoid函數

誰大就是誰,就歸于那一類。邏輯回歸的二分類實際就是softmax多分類的一個特例而已!!!

邏輯回歸多分類是可以單獨分層幾個部分,各部分模塊互不干涉互不影響。

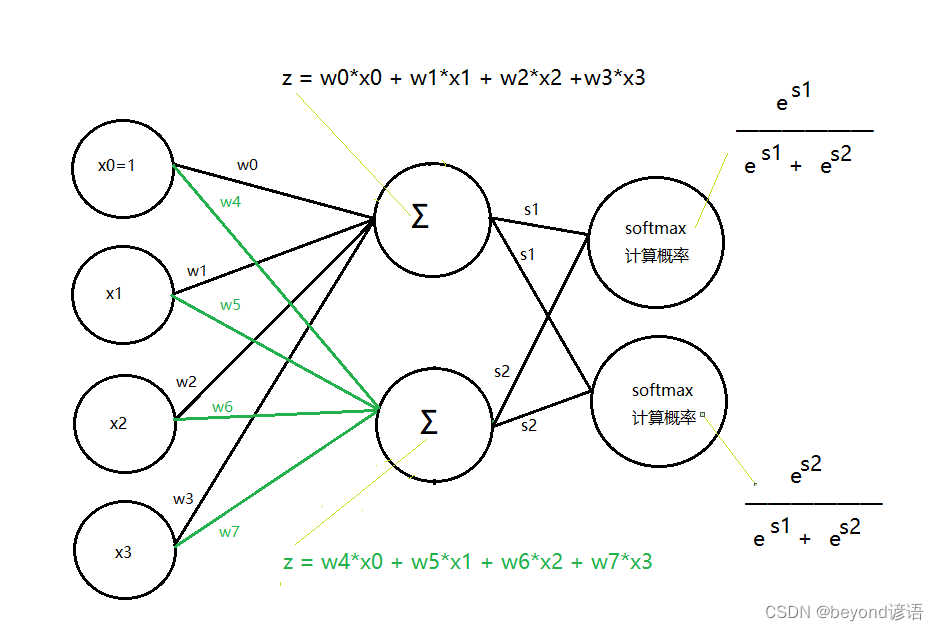

二、softmax多分類

softmax最后得出的計算概率,所有的計算概率之和為1,這一點是很棒的。這幾個不會單獨分開,是一個整體,要求第一個softmax計算概率必須得到s1和s2的值,通常情況我們把傳遞s1和s2的這一層稱之為softmax層

當然,softmax模型同樣是計算w0-w7這些參數

)

將cocos2dx項目從VS移植到Eclipse)

-數據類型)

:使用@Component 來簡化bean的配置...)