大多數的 LLM 應用程序都會有一個會話接口,允許我們和 LLM 進行多輪的對話,并有一定的上下文記憶能力。但實際上,模型本身是不會記憶任何上下文的,只能依靠用戶本身的輸入去產生輸出。而實現這個記憶功能,就需要額外的模塊去保存我們和模型對話的上下文信息,然后在下一次請求時,把所有的歷史信息都輸入給模型,讓模型輸出最終結果。

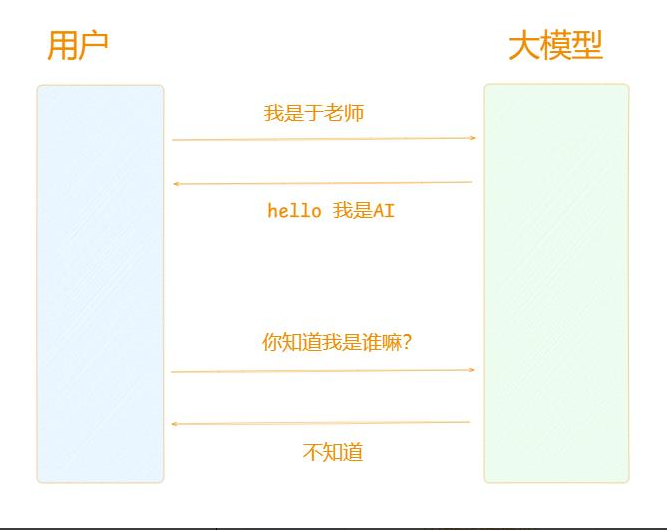

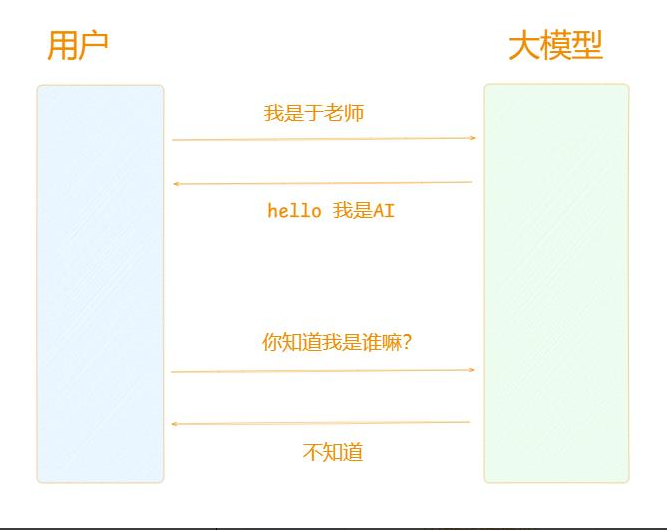

在沒有使用Memory的的情況下,大模型記憶上一次的回答,每次的回答都不相干。如下圖:

大多數的 LLM 應用程序都會有一個會話接口,允許我們和 LLM 進行多輪的對話,并有一定的上下文記憶能力。但實際上,模型本身是不會記憶任何上下文的,只能依靠用戶本身的輸入去產生輸出。而實現這個記憶功能,就需要額外的模塊去保存我們和模型對話的上下文信息,然后在下一次請求時,把所有的歷史信息都輸入給模型,讓模型輸出最終結果。

在沒有使用Memory的的情況下,大模型記憶上一次的回答,每次的回答都不相干。如下圖:

本文來自互聯網用戶投稿,該文觀點僅代表作者本人,不代表本站立場。本站僅提供信息存儲空間服務,不擁有所有權,不承擔相關法律責任。 如若轉載,請注明出處:http://www.pswp.cn/web/81404.shtml 繁體地址,請注明出處:http://hk.pswp.cn/web/81404.shtml 英文地址,請注明出處:http://en.pswp.cn/web/81404.shtml

如若內容造成侵權/違法違規/事實不符,請聯系多彩編程網進行投訴反饋email:809451989@qq.com,一經查實,立即刪除!