學習視頻**:第4章-決策樹_嗶哩嗶哩_bilibili

西瓜書對應章節: 第五章 5.1;5.2;5.3

文章目錄

- MP 神經元

- - 感知機模型 (分類模型)

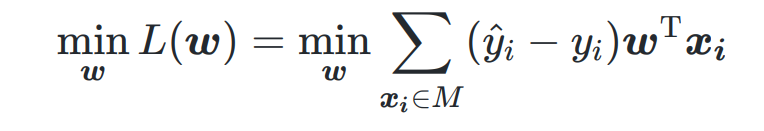

- -- 損失函數定義

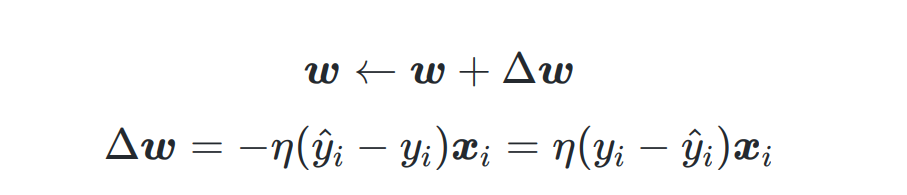

- --- 感知機學習算法 - 隨機梯度下降法

- - 神經網絡需要解決的問題

- - 誤差逆傳播算法

MP 神經元

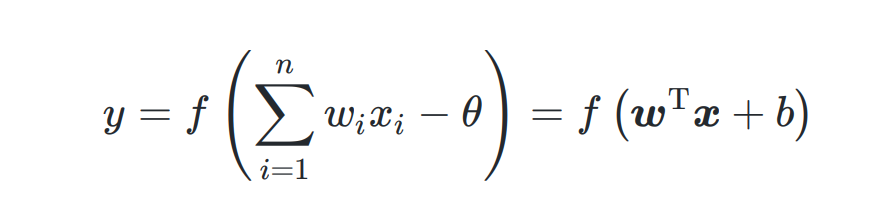

接收n個收入,并給各個輸入賦予計算加權和,并且和自身特有的閾值進行比較(作減法),最后經過處理得到輸出。

- 單個MP神經元:感知機 (sgn 感知函數) ; 對數幾率回歸 (sigmoid)作為激活函數

- 多個MP神經元: 神經網絡

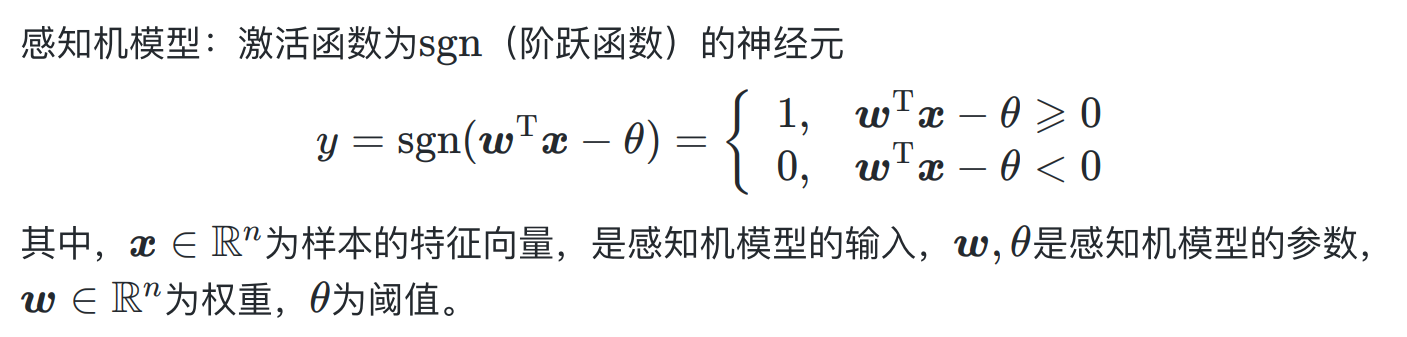

- 感知機模型 (分類模型)

從幾何的角度看,感知機的作用是 給定一個數據集D,求得對數據集中樣本進行二分類的超平面。

- 其超平面方程不唯一

- w 與超平面垂直

- w 和 b 確定唯一的超平面

- w 指向正的超平面

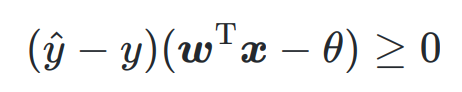

- 恒成立公式:

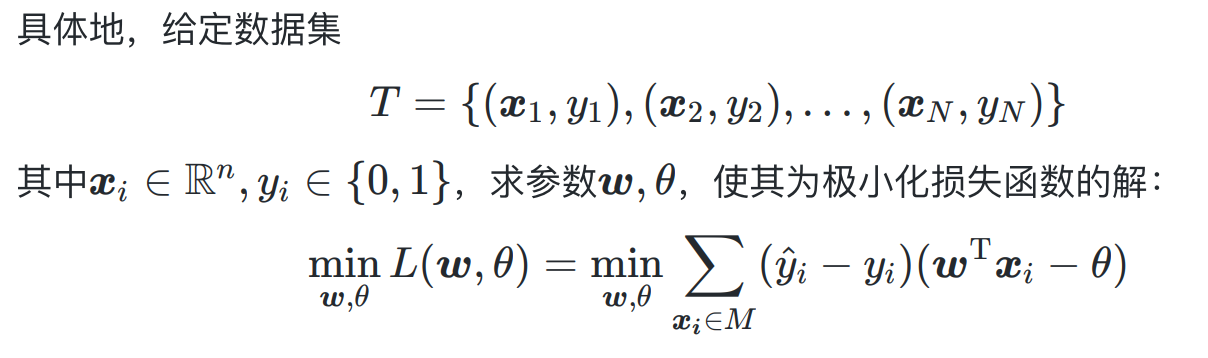

– 損失函數定義

特點:

- 永遠是非負的

- 沒有誤分類點,損失函數為0

- 誤分類點越少,離超平面越近,損失函數值越小

將其中的 ? Θ -\Theta ?Θ 看作一定值的變量,寫作 w T x i w^T x_i wTxi? 的形式作為第 n+1 位,可將上式簡化為

— 感知機學習算法 - 隨機梯度下降法

- 神經網絡需要解決的問題

- 面對一個具體場景,神經網絡該做多深?多寬?

- 面對一個具體場景,神經網絡的結構該如何設計才最合理?

- 面對一個具體場景,神經網絡的輸出結果該如何解釋?

-

原則上, 神經網絡能夠以 任意精度 逼近 任意復雜度 的 連續 函數。

-

神經網絡能夠自己比較好的處理特征的問題

- 誤差逆傳播算法

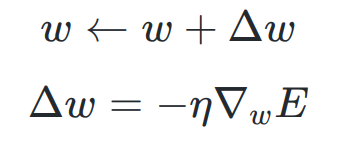

BP算法 基于隨機梯度下降的參數更新算法

- 隨機梯度下降 不能保證一定走到 全局最小點, 大部分情況下走到的是 局部最小點。

收藏這一篇就夠了!)

)

)

)

)

——git的使用)

)