什么是Ai?

AI的全拼是(Artificial Intelligence)人工智能,使機器能夠像人類一樣思考、學習和解決問題的技術。

在AI的應用情況下我們更多的是學習自然語言處理。

在自然語言處理(Natural Language Processing,NLP)中,有一項關鍵技術叫Transformer,這是一種先進的神經網絡模型,是現如今AI高速發展的最主要原因。

我們所熟知的大模型(Large Language Models,LLM),例如GPT、Deepseek底層都是采用Transformer神經網絡模型。

Transformer:最早由Google 團隊發表 《Attention Is All You Need》提出了這一模型架構,采用 自注意力機制(Self-Attention)簡單來說就是計算輸入序列中每個詞與其他詞的關聯權重進行輸出,實現并行計算。

大模型的底層原理就是通過上下文的計算,生成下一個可能出現token,通過Transformer的神經網絡,通過大量的數據訓練,掌握自然語言規律。

大模型應用

大模型應用是基于大模型的推理,分析,生成能力,結合傳統編程能力,開發出各種應用。

傳統編程和AI大模型之間是有不同的側重點的。

傳統程序對于確定性邏輯處理和精確控制和高可靠性,比方說數學計算和內存管理,是擅長的。

AI大模型是對模糊性問題有很強的處理能力,比方說識別圖片。

當我們把AI大模型和傳統程序相聯合在一起的時候,我們就得到了大模型應用。比方說AI大模型是沒有記憶能力的,它實際上是在用戶傳遞過來之后,在后臺進行了傳統編程使它緩存下來,然后再和你新的問題一起發送回大模型,這樣就達到了AI大模型的記憶功能了。

注意!!!

大模型和大模型應用是不一樣的,比方說deepseek是大模型應用,是基于大模型進行開發的,像deepseek-R1就是大模型像這樣的還有很多,基于大模型應用的就是大模型產品也就是我們在網站上使用的對話產品,比如ChatGPT,文心一言。

AI應用開發技術架構

AI應用開發技術是圍繞大語言模型構建應用程序所涉及的一系列技術和方法。

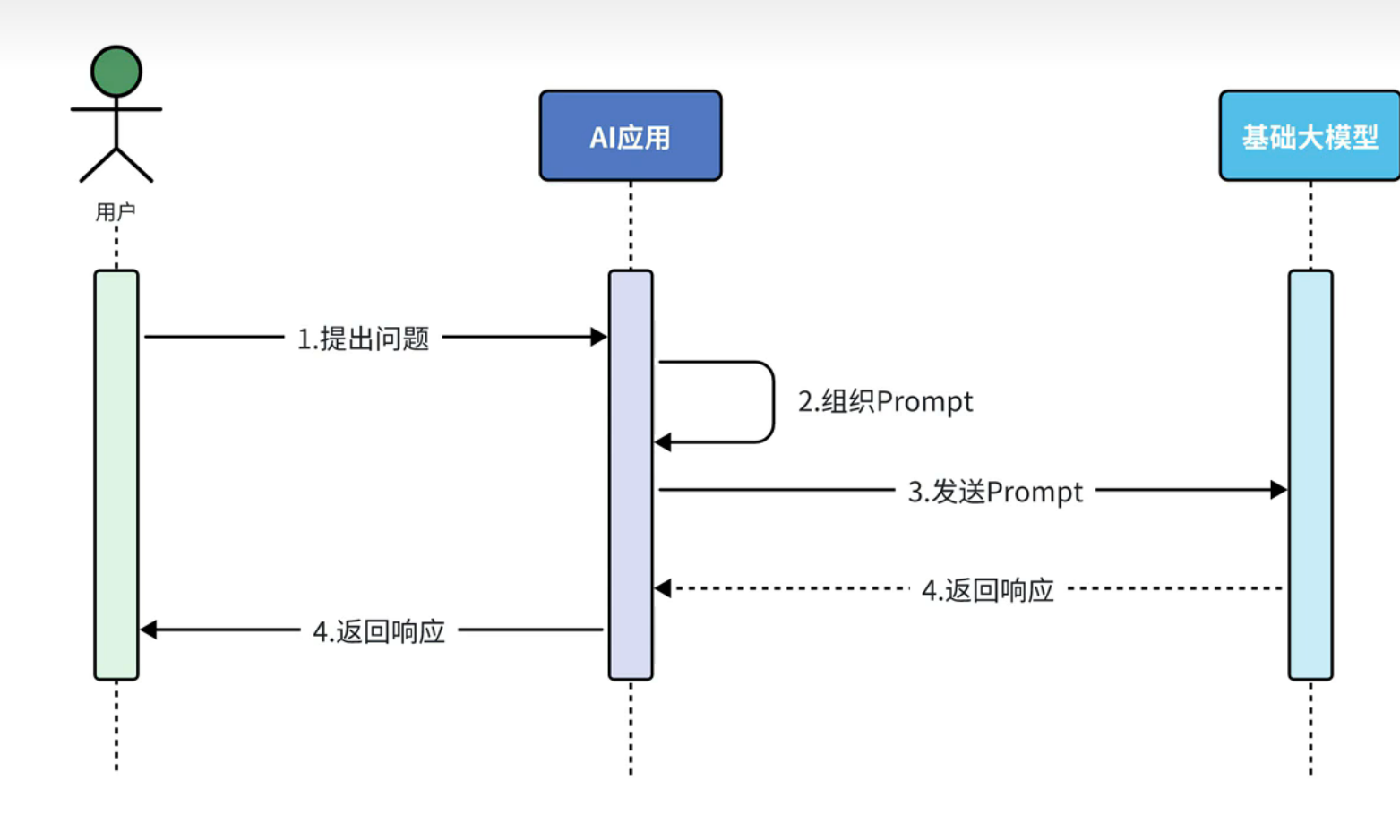

純 Prompt 問答(Pure Prompt Q&A):利用大模型推理能力,通過 Prompt 指令完成業務

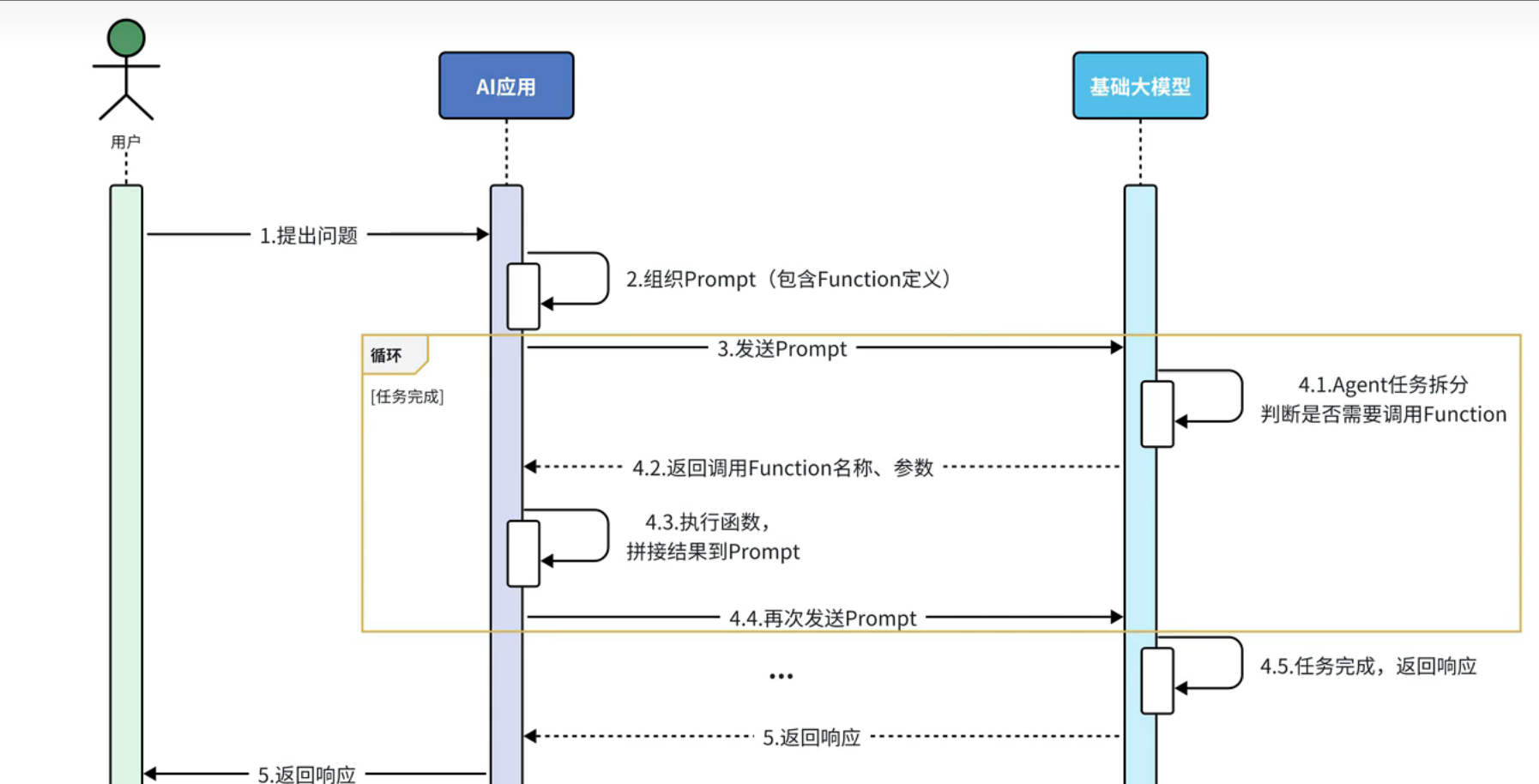

Agent + Function Calling:AI 拆解任務,調用業務端接口實現復雜業務

Fine - tuning(微調):針對特有業務場景,對基礎大模型做數據訓練、微調,滿足特定場景需求

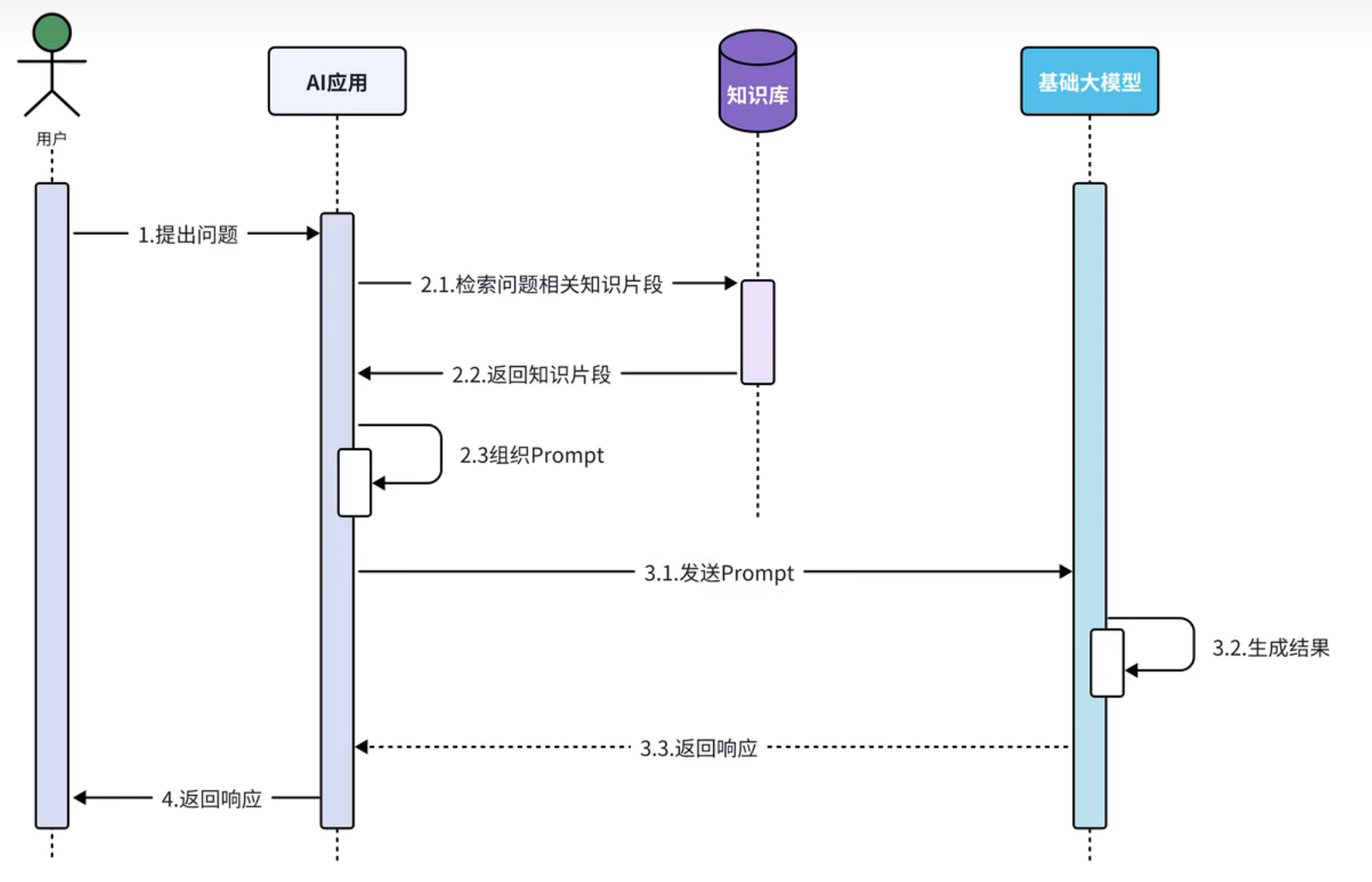

RAG(Retrieval Augmented Generation,檢索增強生成):給大模型外掛知識庫,基于知識庫內容推理、回答 ,這些模式用于不同業務場景下借助大模型能力開展工作 。

應用場景:

純 Prompt 問答:通過簡潔指令讓大模型直接響應,適用于智能客服快速答疑、簡單文本創作輔助等輕量場景 。

Fine-tuning(微調):針對醫療、金融等垂直領域,用專業數據優化模型,滿足醫療診斷輔助、金融風險評估等深度需求 。

Agent + Function Calling:借助智能體拆解復雜任務并調用外部接口,在自動化辦公流程(如跨系統報表生成)、智能家居聯動控制等場景,高效完成多步驟業務 。

RAG(檢索增強生成):外掛知識庫補充實時 / 專業信息,常用于企業內部知識問答(精準調用企業文檔)、新聞寫作(結合最新資訊)等對內容準確性、時效性要求高的場景 。

)