【默子AI】萬字長文:MCP與A2A協議詳解

引言:

讓一個大模型憑空解決所有問題,就像讓一個書呆子不借助工具就去修汽車

即便他腦子里裝滿了理論知識,也缺少實踐的“手腳”。

長期以來,AI助手(尤其是LLM)面對兩個難題:一是無法訪問外部工具和實時數據,二是無法與其他AI協作。前者導致模型往往成為“閉門造車”的孤島,后者則讓每個AI都各自為戰,無法組團發揮特長。

好消息是,業界針對這兩點推出了兩個重量級的開放協議:MCP(Model Context Protocol)和A2A(Agent-to-Agent)

也是我們今天文章的標題關鍵詞:MCP和A2A

可以打個比方:MCP相當于給AI裝上了Tpye-C,在21世紀到處亂插 ;

而A2A則是教會AI使用標準的“社交禮儀”,讓不同廠商、不同能力的AI代理人之間也能無縫對話協作 。

今天,默子將以幽默風趣的方式,深入解析MCP和A2A的技術原理,包括它們的底層設計思路、標準接口和通信流程,并結合大量國內外知名項目實例穿插講解。從高德地圖的導航助手,到一鍵部署網頁、智能問答、虛擬試衣等應用場景,我們將看看這些協議是如何讓AI如虎添翼的。

最后,默子也來和大家也一起展望一下未來:當AI擁有了**“拿起工具的手”和“召喚伙伴的嘴”**,又會激發出怎樣的新玩法呢?

一、MCP:Model Context Protocol — AI的萬能接口

說起MCP,它是Anthropic公司在2024年開放推出的一項協議標準 。全稱就是《模型上下文協議》,顧名思義,“模型上下文協議”旨在為AI模型提供上下文和工具接口。

這個MCP可以讓我們親愛的大模型們能安全、便捷地獲取外界的信息和工具。

像電腦有了USB-C插口后,隨便什么設備都能即插即用 。(但隨便的即插即用到現在真的便利了嗎?默子下一篇文章會詳細講一講這個通用的代價)

MCP解決了什么問題?

在MCP出現之前,讓一個AI助手連接某個新數據源或API,開發者往往需要為每種工具寫定制的集成代碼。

比如想讓AI讀取Google Drive里的文件、調用Slack消息、查詢數據庫,得分別寫各自的接口邏輯。

這不僅麻煩,而且每換一個模型或應用還得重來,缺乏統一性。

MCP的誕生正是為了解決這一痛點 。它提供了一個開放且統一的規范,讓所有這些外部數據源、應用工具都可以用同一種方式接入AI系統 。

開發者**“一次對接,處處適用”**:只要實現了MCP協議,任何MCP客戶端都能連接上你的服務,反之亦然 。

換句話說,MCP就像給AI世界造了一根又穩又通用的“數據線”。以前每個工具有不同的插頭(不同的API格式、鑒權方式、字段名等等),現在通過MCP這個“轉接頭”,模型和工具之間的通信被標準化了 。

這讓擴展AI能力變得像裝樂高一樣簡單

需要新技能?插上對應的MCP模塊即可,無需擔心各種奇葩接口差異。

MCP的架構與通信流程

那MCP到底是怎么做到這些的呢?它采用的是典型的客戶端-服務器(Client-Server)架構。這里有幾個角色需要介紹:

- Host(宿主):運行LLM應用的主體環境,負責發起和管理連接。可以理解為AI助手所在的“操作系統”或應用,如Claude Desktop或者是Cursor這樣的程序。(實測來說,Cursor是真好用)

- MCP Client(客戶端):宿主中的一部分,用來與外部MCP服務器建立連接、轉發請求和響應,進行編排。它與服務器保持一對一的長連接,管理所有LLM對該服務器的調用 。

- MCP Server(服務器):包裝了某個外部數據源或功能模塊的服務端,實現MCP接口規范。它向客戶端暴露出標準化的功能**(比如工具函數)或數據(比如資源內容)。本質上,每個MCP服務器就代表一個可供AI訪問的外部能力**(如一座知識庫、一個應用的API等)。

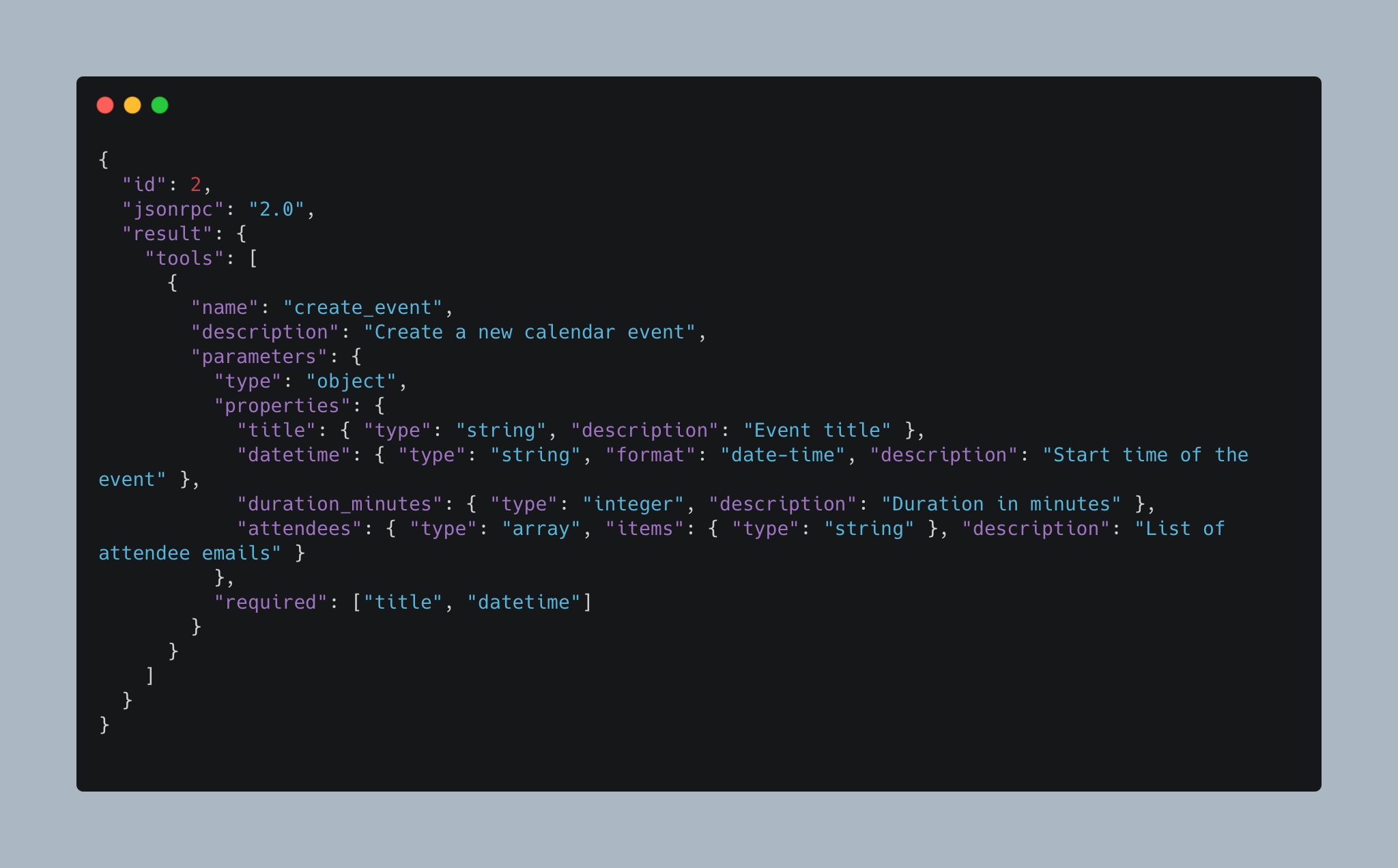

- Protocol(協議本身):規定了客戶端和服務器之間如何交換消息的格式和規則 。MCP使用JSON-RPC 2.0作為基礎的消息封裝格式,在客戶端和服務器之間建立雙向通信。二者可以持續對話,雙方首先會交換各自支持的能力說明(類似于握個手溝通“我會哪些招式”),確保互相了解能干什么,再開始正式通信。

值得一提的是,MCP深受軟件領域**“語言服務器協議(LSP)”**的啟發 。(笑死,誰第一個想到了老S批,出來挨打)

LSP讓各種IDE都能用統一方式支持不同編程語言的智能提示,而MCP則試圖讓各種AI應用用統一方式支持不同工具和數據源 。

所以可以把MCP看作是LLM世界里的LSP,讓“增加新技能”這件事標準化、模塊化。

提供的能力類型

按照規范設計,MCP服務器可以向客戶端提供三類主要能力 :

- Resources(資源):提供靜態或動態數據給模型作為上下文。例如服務器可以暴露出一本文檔、一組圖片、數據庫中的記錄等,讓模型將它們視作閱讀材料或知識庫。

- Tools(工具):提供可執行的操作函數,相當于讓模型可以調用一些動作。比如“查詢地圖坐標”、“發送一封郵件”、“調用計算器”等等,都可以作為Tool由服務器實現并供模型調用。

- Prompts(提示):提供預設的提示模板或對話流程,幫助模型更好地完成某些交互。比如一個Prompt模版可以指導模型去執行某種任務的步驟。這有點像給模型提供劇本片段,在需要時套用。

另一方面,MCP客戶端本身也可以向服務器提供一種特殊能力叫Sampling(采樣) 。簡單理解,就是允許服務器“反過來”請求客戶端讓模型幫忙處理一些內容(比如要求模型對一段文本總結一下)。這使得交互不再總是模型主動調用工具,有時工具也能請求模型做事,實現更復雜的雙向配合。但出于安全考慮,這種機制通常需要用戶明確授權方可進行 。

消息流程舉例

要更直觀地理解MCP通信,我們來看一個簡單的工作流程例子:讓AI日程助理給我在日歷上安排一個會議。

建立連接: 用戶在AI應用中啟用了“Google日歷MCP服務器”。宿主的MCP客戶端于是與該服務器建立了連接。

建立好連接后,就要獲取到服務器提供的工具列表(比如有一個名為create_event的日歷事件創建工具)。

注入上下文: MCP客戶端會告訴模型“我現在幫你接上了Google日歷,你可以調用create_event工具來創建會議”。模型于是將這視為自己能力的一部分。

模型決定調用工具: 當用戶對AI說“在本周四下午3點幫我安排一個團隊同步會”時,模型分析請求,判斷需要使用日歷工具。它依據MCP定義的接口格式,填充create_event所需的參數(日期、時間、標題等)。

客戶端發送RPC請求: MCP客戶端拿到模型準備的調用指令,代表模型向Google日歷MCP服務器發送一個JSON-RPC請求,調用create_event工具。

服務器執行并返回: 日歷MCP服務器收到請求后,使用用戶授權過的API憑證,在Google Calendar創建了相應的日程事件。隨后它按照協議構造響應,附帶結果(比如成功創建的會議ID或詳情),發回給客戶端。

模型繼續對話: MCP客戶端把結果交給模型,模型據此生成對用戶的回答:“好的,我已經在本周四15:00安排了團隊同步會議。” 用戶看到的只是AI助手一句話,背后實際完成了一系列API調用。整個過程對用戶透明而流暢。

通過這樣的標準流程,MCP讓AI助手具備了一定程度的“行動力”:它不再只是被動回答,還能主動幫用戶執行操作、查詢信息。更妙的是,這一切并不需要為每個工具寫死在模型里——只要連上新的MCP服務器,模型就自動拓展了新能力。這種即插即用的擴展性,正是MCP最大的價值所在 。

MCP的安全與開放生態

當然,讓AI直接訪問外部工具和數據,安全性是不容忽視的。不然之后一些購物網站出一個MCP豈不是要逆天了

MCP協議在設計時就強調了用戶控制和安全授權的重要性 。比如,宿主應用在暴露用戶數據給服務器前必須獲得用戶明確同意,調用危險操作(如寫文件、執行代碼的工具)時也應二次確認 。

所有這些都需要在實現中做好防護——協議本身提供了機制(如連接握手時聲明權限范圍),但具體執行還得靠開發者遵守安全最佳實踐 。MCP給了AI一把“萬能鑰匙”,但我們可得始終握著鑰匙的使用權限,防止AI“小鐵匠開鎖”亂來。

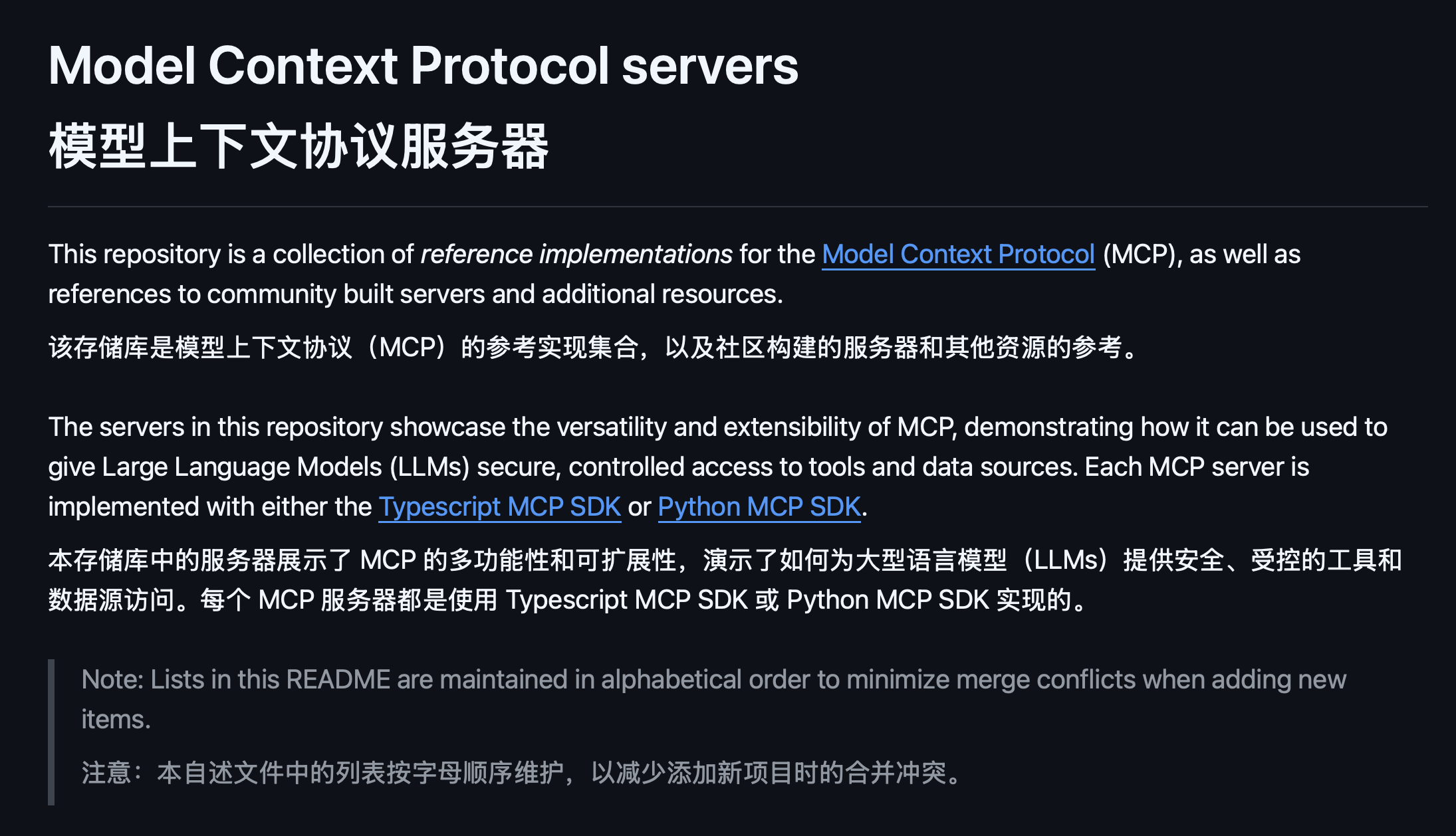

安全是前提,而開放生態則是MCP真正威力的來源。截至目前,MCP已經吸引了廣泛的社區參與。

Anthropic開源了大量參考實現和SDK,包括TypeScript和Python版本,方便開發者快速創建自己的MCP服務器 。

官方提供了一些基礎的參考服務器實現(例如文件系統訪問、GitHub集成、網頁抓取、數據庫查詢等) 。

更令人驚喜的是,開源社區和各大廠商也紛紛加入,貢獻了五花八門的MCP服務器:

- 有的用于信息檢索,如AWS知識庫檢索、Brave Search搜索引擎接口等 。

- 有的用于內容生成,例如EverArt圖像生成 、Sequential Thinking邏輯推理輔助 。

- 主流開發平臺也在跟進,如Google Drive、GitHub、Slack等都有對應的MCP連接器,讓AI能讀寫云盤文件、倉庫代碼,發送消息等等 。甚至連GitLab、Sentry錯誤日志、PostgreSQL數據庫都已在列表中 。

- 不少官方集成由廠商直接維護。例如AgentQL公司提供了AgentQL MCP服務器,使AI能從非結構化網頁中提取結構化數據 ;Apify開放了Actors MCP Server,AI可以通過它使用多達3000+個現成的爬蟲和數據提取工具 ;就連國內的騰訊云也推出了EdgeOne Pages MCP作為官方集成(后文會詳述)。

有實力的讀者可以去GitHub上自己挑一些MCP服務器提供的服務玩玩。

可以說,MCP正快速成為一個**“AI能力商店”**的基石協議。越來越多的工具和服務正以MCP插件的形式涌現,供AI調用。

而對開發者來說,這意味著不用每次重新造輪子,只需“掛載”好MCP接口,就等于給AI裝上了對應的新功能。

難怪有人把MCP稱作AI領域的「USB接口」,讓模型連接外部世界變得前所未有地簡單 。

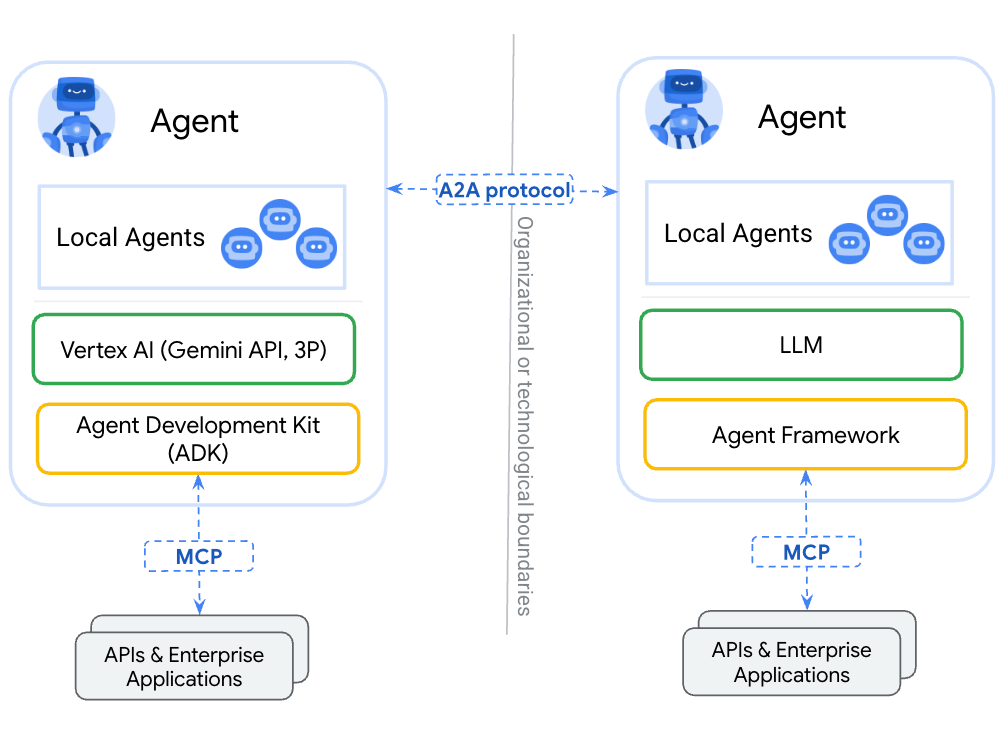

二、A2A:Agent-to-Agent Protocol — AI的協同語言

如果說MCP解決的是“AI如何用工具”的問題,那么A2A解決的就是“AI如何和同伴協作”。

Agent-to-Agent協議由谷歌在2025年推出,得到了數十家科技公司的支持聯合制定 。

它的目標是:讓不同的AI代理人能夠彼此通信、協作,無論它們背后的架構、廠商有多么不同 。

A2A可以看作是給AI代理人們創造了一種共同的“語言”和通訊協議,從而打造出一個多智能體協作的生態系統。

A2A要解決的痛點

設想一下未來的場景:你有一個AI個人助理,它擅長整理日程和郵件。但當你讓它幫忙規劃旅行行程時,或許會希望它能找一個旅游專家AI合作;當涉及財務決策時,又希望它咨詢一下財經顧問AI。

在沒有A2A之前,這些不同領域的AI很難直接對話配合——每家AI各干各的,缺乏標準接口互通。這就像每個人說著不同的語言,沒有翻譯的話就雞同鴨講。

A2A協議的出現,就是為AI代理人提供了“翻譯官”和“通信線路”。

谷歌明確表示,A2A是對MCP的有益補充:MCP關注于AI連接工具和數據,而A2A關注于AI與AI之間的互操作 。通過A2A,一個AI可以發現別的AI有哪些本領,進而發送任務請求,讓擅長者去執行,再安全地拿回結果。

這種多代理協同,可以顯著擴大AI系統的能力邊界——畢竟**“一個好漢三個幫”**,多個專長各異的AI如果能聯手解決問題,必定比單打獨斗更有效率 。

A2A的設計原則

要讓不同源頭的AI代理互通有無,A2A的設計遵循了幾項核心原則 :

- 開放和廠商無關: 協議必須是開放標準,任何框架和廠商都能實現支持,不被某一家壟斷。谷歌拉來了超過50家合作伙伴共同制定A2A,就是為了保證它的中立性和通用性 。這讓A2A成為AI代理人的一門“世界語”。

- 支持真正的自主智能體行為: A2A強調讓代理人以自然、非結構化的方式交流,而不強制要求共享內存或工具 。每個AI都保持各自的獨立,只通過交流來協同,就像人在協作時各自有獨立大腦,只是溝通商量,不需要腦電波連在一起。

- 構建在現有成熟技術之上: A2A并沒有另起爐灶設計全新傳輸協議,而是充分利用了Web現有的**HTTP、JSON-RPC和SSE(Server-Sent Events)**等標準 。

- 安全和權限管理內置: 企業級安全是A2A的重中之重。它支持像OpenID Connect那樣的認證/授權機制來驗證代理身份和權限 。此外還有發現機制(類似于服務發現),比如通過.well-known/agent.json公開一個AI代理的能力說明,方便安全地檢索和連接 。

- 任務生命周期與長時協作: 考慮到有些任務可能很復雜,甚至需要人類介入,A2A設計了任務的完整生命周期管理 。代理之間可以發送任務對象,任務可以即時完成也可以長時間掛起。對于耗時的任務,雙方能夠一直用A2A溝通狀態進展、部分結果、通知等,不會因為一次請求就中斷協作 。這就像項目管理一樣,任務從創建、進行到完成都有跡可循,而不是“一錘子買賣”。

- 多模態消息和UI協商: A2A的信息交換不局限于文本,可以包括圖像、音頻、視頻等多種內容 。消息被拆分成不同的部分(parts),每個部分標明內容類型,比如一句話、一張圖或一個表格 。這樣代理之間可以協商用什么格式呈現給用戶,比如如果用戶界面能顯示富文本、表單甚至嵌入網頁,代理就可以直接傳相應格式的數據 。這一點可以確保最終用戶體驗更友好——兩個AI不會一個給純文本、一個給HTML亂燉,而是事先說好用哪種格式交流。想必大家之前肯定有被AI生成的格式折磨的時候吧

A2A的工作機制

A2A的核心在于讓一個“客戶端代理”去委托一個“遠程代理”完成任務 。為了實現這一點,A2A包括了幾項關鍵能力:

- 能力發現(Discovery): 一個代理需要知道別的代理能干啥,才能決定“找誰幫忙”。A2A通過Agent Card(代理名片)的方式,讓代理公開自己的技能清單和接口 。這通常是一個JSON文件(如前述的agent.json),里面寫明代理的名稱、描述、擅長領域、支持的輸入輸出模態等。就好比AI代理在網上掛了份“簡歷”,別的AI可以檢索這些簡歷來找到合適的合作伙伴。

- 任務委派與生命周期管理: 當客戶端代理選定了一個遠程代理后,它可以通過A2A發起一個任務(Task)請求,描述想讓對方做什么 **。遠程代理接到任務后,會嘗試執行并不斷通過消息反饋進展,最后產出結果產物(稱為**artifact) 。如果任務很快完成,那artifact直接隨回復返回;如果是長期任務,比如等待一個外部事件或人工確認,那么雙方會保持通訊,期間遠程代理可以發送中間狀態更新,客戶端代理也可以詢問進度 。任務完成后,artifact作為最終成果交付給客戶端代理。這個過程類似于項目外包:甲方(客戶端代理)下需求給乙方(遠程代理),乙方匯報進度,最終交付成果。

- 協作對話: 在任務執行過程中,代理之間可以隨時交換消息來共享上下文或提問澄清 。比如遠程代理可能問:“你要我查找的報告具體是哪一年?”——這在A2A里就是一個消息往返。通過這樣的對話機制,代理協作可以變得更加靈活,不一定非“一次性把信息都給全”才能開始任務。

- 用戶體驗協商: 如前所述,消息可以包含不同類型內容。如果遠程代理能生成圖片而本地客戶端無法展示,那么雙方需要降級協商格式。A2A允許代理明確說明自己支持的UI呈現能力,然后在消息交流時協商出雙方都接受的內容形式 。比如,遠程代理本想發一段視頻,但發現客戶端只能顯示文本,那它可能退而求其次發送一個視頻鏈接或描述。這有點像兩個應用在協商數據格式以兼容對方的播放能力。

綜合起來,A2A建立了一套完整的多智能體合作框架。引入一個類比的話:如果MCP讓每個AI都裝備了各種工具,那么A2A就是建立了一支“AI聯盟通信網”,讓每個全副武裝的AI戰士能夠通過無線電一起打團隊戰。而且這通信網還是加密安全、秩序井然的,保證“友軍”才能接入,“敵軍”和閑雜人等進不來搗亂 。

A2A實例:AI代理組團作戰

為了更形象地理解A2A的作用,默子來給大家來看一個應用場景的小故事:

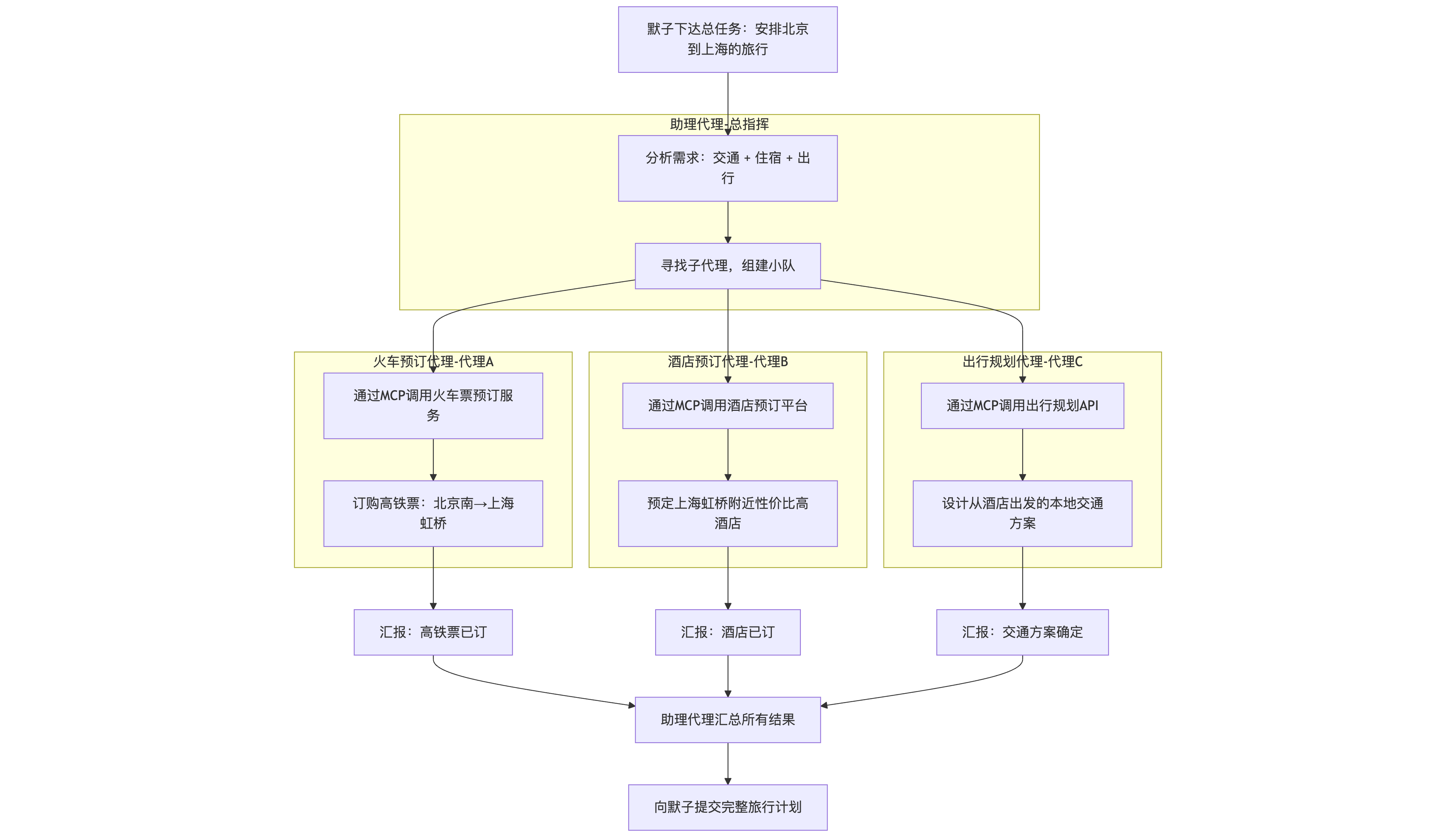

場景1:AI旅游團策劃

默子對他的AI助理說:“幫我計劃一趟從杭州到云南大理的旅行,訂高鐵票,在車站附近找家酒店,還要安排當地交通。” 這個任務其實包含了交通、住宿、市內出行三個子任務,一個AI未必全都精通。于是助理通過A2A召集“小隊”:

- 助理首先發現一個火車預訂AI(代理A)擅長購票,于是發任務請它訂北京到云南大理的高鐵;

- 同時還找到一個酒店預訂AI(代理B)熟悉各類酒店信息,請它選車站附近性價比高的酒店;

- 最后還有一個出行規劃AI(代理C),擅長本地交通和導航,委托它安排從酒店到目的地的出行方案,比如叫車或公交路線。(這個現在高德的MCP就可以實現)

這三位代理各司其職,通過A2A匯報進展:火車票訂好了【“已訂XX次列車,出發時間…”】、酒店鎖定了【“預訂了XX酒店,兩晚…”】、出行方案也有了【“建議使用滴滴打車,大約¥XX”】。最后,助理代理匯總各路信息,給默子呈現一份完整的旅行計劃。整個過程中,多個AI代理臨時組隊,各顯神通,最終完成了復雜任務。這正體現了A2A帶來的模塊化、多智能協同優勢 。

在這個例子里,我們看到A2A和MCP是如何配合的:A2A負責讓多個Agent交流、分工,而每個Agent完成自己任務時,往往又需要通過MCP去調外部工具或數據(比如查詢數據庫、調用搜索API)。正如開發者所說:“A2A負責Agent之間的對話,而MCP負責連接Agent和應用” 。二者結合,真正形成了一個強大的AI代理網絡:既能接通外部世界,又能相互協同合作。

雖然現在這些協議還不太成熟,但這個我們這個暢想不是已經有了嗎?哈哈哈

A2A特別好玩的例子還不太多。默子下次多體驗幾個再給大家說說,今天先來看MCP實力精選!

三、MCP實例精選:讓AI插上工具的翅膀

理論講了這么多,讓我們看看在現實中,哪些項目已經用上了MCP,將其威力發揮得淋漓盡致。下面通過幾個國內外知名的案例,來體會MCP是如何賦能各種應用場景的,每個案例我們都會簡要介紹項目本身,以及使用MCP帶來的改變和好處。

高德地圖 Amap Maps MCP:AI的實時導航助手

項目簡介: 高德地圖是中國最流行的數字地圖和導航服務之一,而Amap Maps MCP是高德官方推出的MCP服務器(插件),旨在讓AI能直接訪問其地圖服務功能。通過這個插件,AI助手相當于有了高德地圖的“超級賬號”,可以使用地圖API提供的各種能力,包括坐標轉換、地點搜索、路線規劃等 。

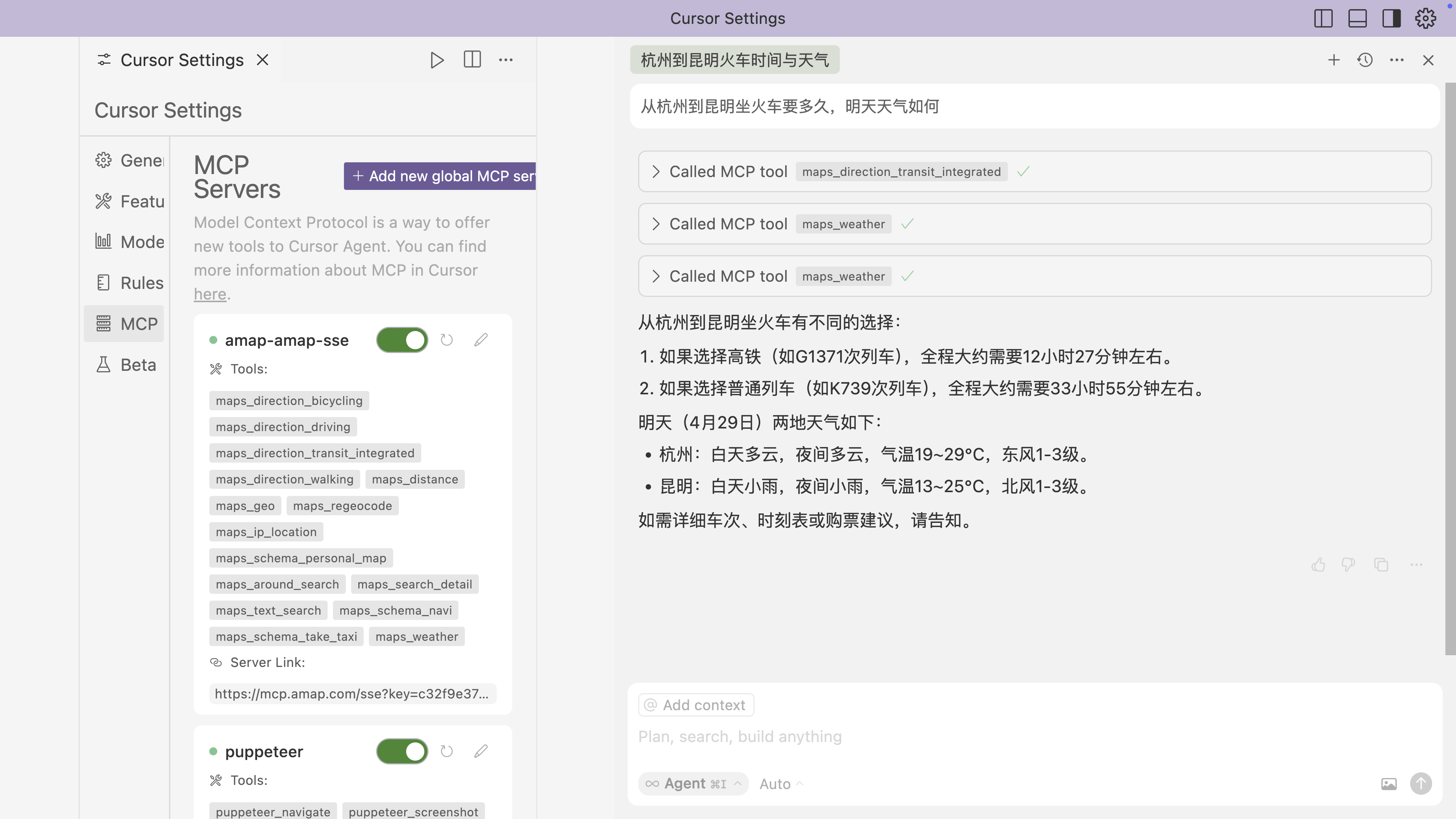

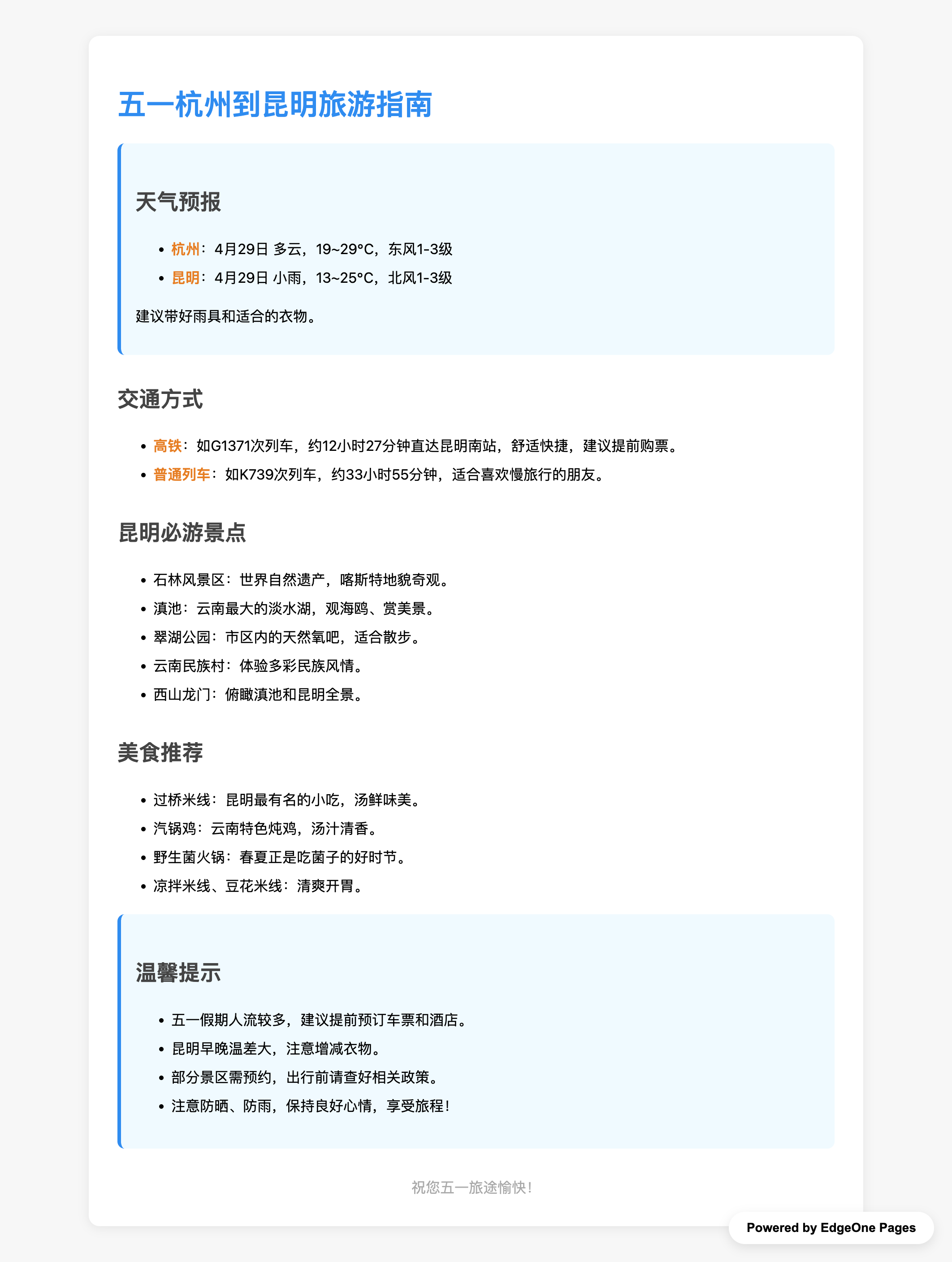

默子這里給出在Cursor里配置amap-amap-sse服務器、調用不同MCP工具來查詢交通和天氣的實際例子

以圖中示例為例,高德地圖開放了一個MCP服務器(amap-amap-sse),將原本復雜的高德API統一封裝成了一組標準化工具,供AI直接調用。 這些工具包括但不限于:

maps_regoecode:根據地名查詢經緯度;maps_around_search:根據關鍵詞搜索周邊地點;maps_direction_transit_integrated:規劃跨城市的公共交通路線;maps_weather:查詢實時天氣信息;maps_direction_driving:規劃駕車導航路徑;maps_distance:計算兩地之間的直線或駕車距離。

比如在圖中,用戶詢問“從杭州到昆明坐火車要多久,明天天氣如何”,AI不需要自己拼HTTP請求,而是直接調用了:

maps_direction_transit_integrated工具查詢火車路線時間;- 兩次

maps_weather工具分別查詢杭州和昆明的天氣。

MCP服務器負責幫AI隱藏底層復雜的HTTP調用、API鑒權、參數拼接細節。AI只需用標準的MCP RPC格式發送請求,幾秒鐘內就能收到結構化的返回結果。

帶來的變化和好處: 以前,聊天機器人如果被問到“附近哪里有奶茶店?” 這種問題,要么老老實實回答“對不起我不能訪問地圖”,要么胡亂編造一個(結果常常不靠譜)。現在,有了高德MCP接口,AI助理可以實時查詢最新的地圖數據并給出準確答案。例如默子問:“從我現在的位置到最近的地鐵站怎么走?” AI借助MCP立即調用高德的路線規劃,一次對話就可以反饋具體步行路徑和所需時間,讓回答像導航儀一樣精確。對于出行導航、位置查詢這類強依賴實時數據的場景,這無疑是革命性的提升。

從開發者角度看,這也節省了大量工作——不用再針對每個AI單獨對接高德API,只要AI支持MCP,它就能用上高德地圖。一位社區開發者已實現了這樣一個插件,并指出其功能覆蓋了地點搜索、路徑規劃等常見場景 。

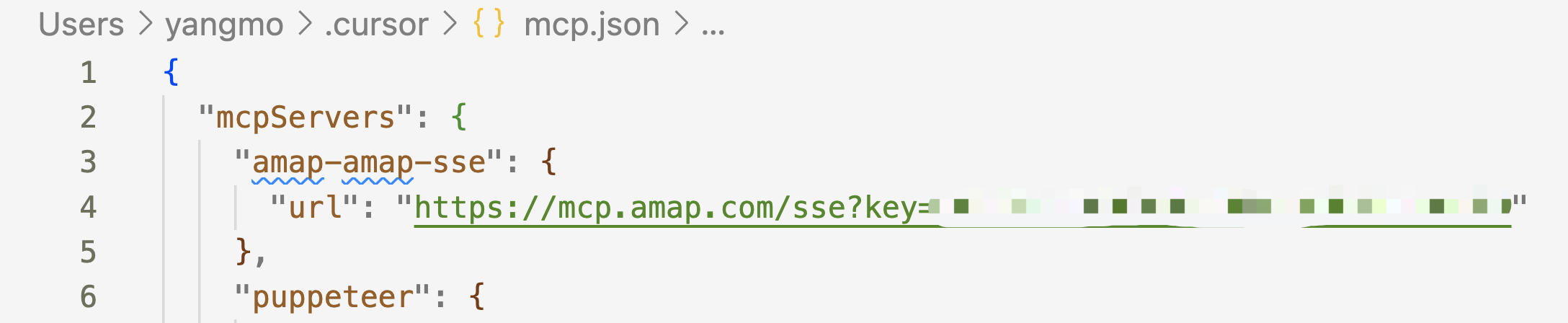

如何使用呢

大家要先去高德開放平臺申請一個Key,也就是告訴高德一聲,我要來用你的服務了,相當于注冊了一個MCP高德的賬號,然后你可以像默子這樣在Cursor中添進去這四五行代碼,就可以直接使用了**(具體教程默子后面會出一個更全面的,適配更多IDE的版本,不要忘了關注我哦!)**

EdgeOne Pages MCP:一鍵部署網頁,AI秒變站長

項目簡介: EdgeOne Pages是騰訊云旗下的邊緣網頁托管平臺,類似于Netlify或Cloudflare Pages,方便開發者快速部署靜態網站。EdgeOne Pages MCP則是騰訊云團隊提供的一個MCP服務器,專為將HTML內容部署到EdgeOne Pages而設計 。簡單來說,它讓AI可以自己當站長,實時發布網頁并獲得一個可訪問的URL鏈接。

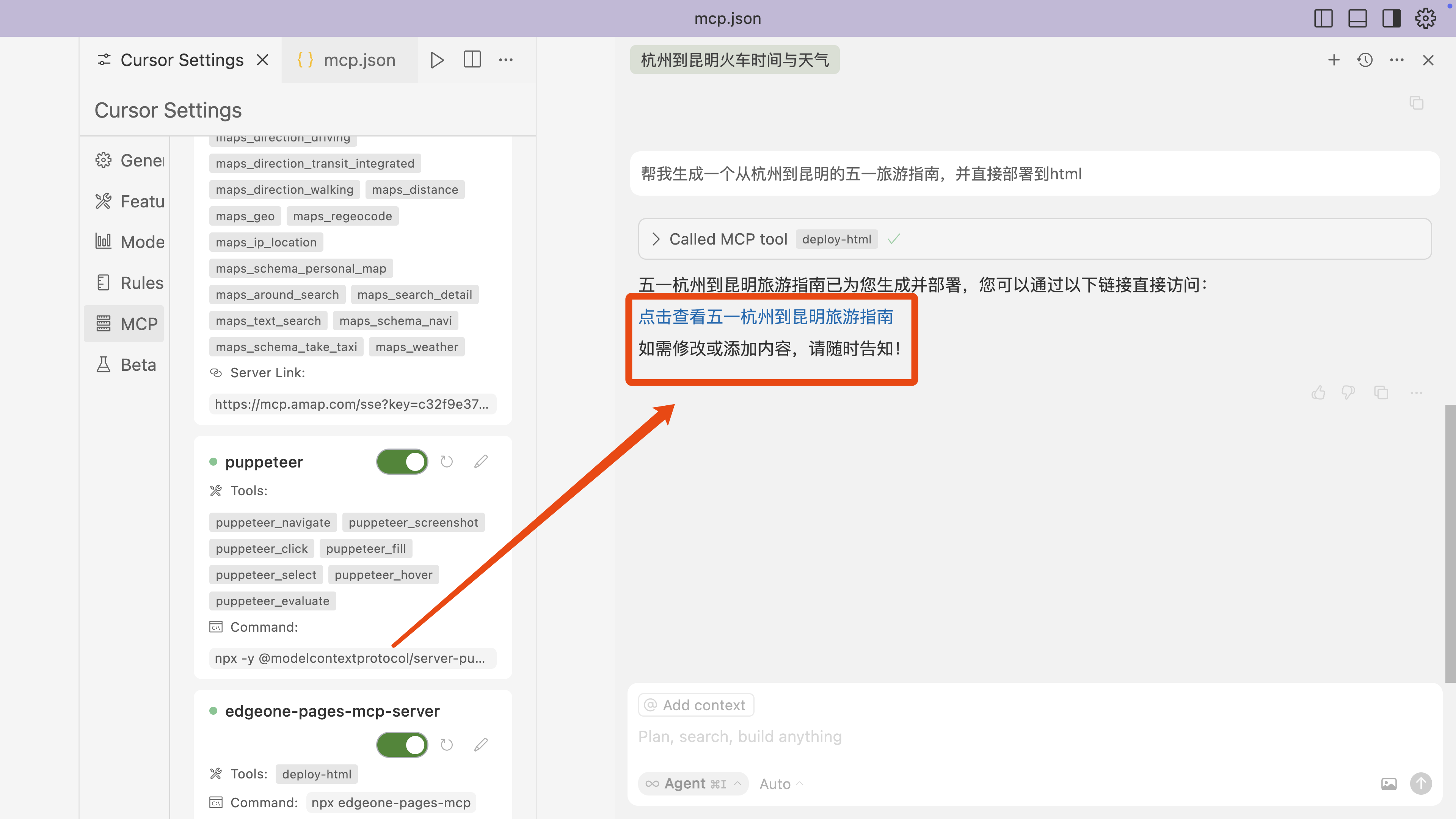

就還是默子的杭州到昆明旅游指南嘛,直接讓他發布分享到網頁去(方便給小伙伴查看嘛)

那我們就可以直接對他說:幫我生成一個從杭州到昆明的五一旅游指南,并直接部署到html

使用MCP的方式: EdgeOne Pages MCP提供了一個關鍵工具,比如deploy_html。AI可以將一段HTML內容打包,通過MCP請求發送給EdgeOne服務端。服務器收到后,會自動將該內容部署到邊緣節點,生成一個公開的URL返回給AI 。這個過程包括:將HTML推送到EdgeOne的邊緣函數執行環境,內容存儲到KV存儲以便快速分發 ,然后返回一個地址。整個流程對AI來說透明且高效,從提交到拿到URL往往只需幾秒。

我們來看一下效果:??

還是蠻不錯的吧!

雖然只是一個簡單的小網頁,但是用對了可以節省非常多的精力和時間!

默子暢想一下,這個可以帶來的變化和好處: 想象一下,你讓AI助手寫一篇產品更新公告博客,以往它只能把Markdown或HTML文本拋給你,然后你還得手動上傳發布。有了EdgeOne Pages MCP,AI寫完后可以直接幫你發布!它會告訴你:“我已經替您生成了網頁,您可以在這個鏈接查看。” 點開鏈接,更新公告網頁已經上線。

對于內容創作和分享來說,這是質的飛躍——AI不僅能生成內容,還能自動“交付”內容,省去了人工上傳、托管的步驟。

從此AI可以勝任簡單的前端發布工作,比如幫企業快速生成活動頁面、把分析報告變成網頁分享給同事等等。效率提升顯而易見:過去從內容到上線可能要幾個人協作半天,現在AI幾秒鐘自助搞定。

正如官方所言,這是利用MCP實現HTML內容的快速上線和公開訪問 。

對于希望將AI輸出無縫融入業務流程的場景,這種一鍵發布能力意義重大。

當然,從安全角度看,部署網頁也需要謹慎控制,但EdgeOne MCP通常會部署在受信環境下,加上內容多為靜態頁面風險較低。在實際應用中,我們大可以放心地讓AI去當它的小站長——說不定以后連公司內部wiki、知識庫的更新都交給AI自動完成了呢!

MiniMax MCP:多模態創作的AI百寶箱

項目簡介: MiniMax是一家新銳的AI創業公司,以提供多模態AI能力聞名(如文本生成、語音合成、圖像視頻生成等)。社區開發者構建了MiniMax MCP服務器,其特點是集成了強大的文本轉語音、圖像生成和視頻生成API,為AI助手打開了通往多媒體世界的大門。

使用MCP的方式: MiniMax MCP向AI暴露了一系列創作類工具。例如:

- text_to_audio:給定一段文字,調用高品質語音合成引擎,將文本轉換為音頻文件,讓AI能“開口說話”。

- text_to_image:提供一段描述,調用圖像生成模型(類似Stable Diffusion或DALL·E),返回對應的圖片。

- generate_video:輸入腳本或主題,調用視頻生成服務,生成一小段短視頻片段。

AI助手可以根據對話需要隨時調用這些工具。由于MCP的接口是統一的,AI并不需要了解每個工具背后的復雜模型或第三方API,它只管提出需求參數,MiniMax MCP服務器就會負責與實際的AI創作服務交互,并把結果交給AI。

帶來的變化和好處: 在傳統模式下,如果想讓聊天機器人輸出圖片或語音,往往需要開發者額外集成那些服務,再在對話邏輯里“插入”結果。而通過MCP,這種多模態輸出變得更加自主和靈活。舉例來說:

- 當默子問AI“這段文字念起來是什么感覺?” —— 過去AI只能回答“我想象可能語氣如何”,現在它可以直接調用text_to_audio,回復一段真人語音,讓默子親耳聽見。

- 默子請求“描述一只穿著宇航服的貓,并給我看看它的樣子”,AI除了文字描述外,還能調用text_to_image生成一張插圖,真正做到圖文并茂。

- 甚至默子說“給我講個笑話并配上相應的視頻”,AI也可以先產生日志臺詞,然后調用generate_video制作一個簡短搞笑視頻,一氣呵成。

這些能力的獲得都歸功于MiniMax MCP提供的工具接口。對于默子而言,聊天體驗從單一的文字對答升級成了視聽豐富的互動;對于AI而言,它仿佛從一個紙上談兵的軍師變成了多才多藝的全能藝人,會說會畫還會導演小視頻。

這背后實際上體現了MCP擴展AI能力的強大之處:模塊組合。MiniMax MCP本身可能內部對接了多個不同的第三方服務(語音由某云服務提供,圖像由某生成模型提供,視頻又是另一套引擎),但AI不用關心這些“幕后樂隊”成員,它看到的只是統一的指揮入口。這樣高度的解耦,使得開發者可以不斷升級每個子能力而不影響AI使用。

Perplexity Ask MCP:內置搜索達人,信息檢索一步到位

項目簡介: Perplexity.ai是國外知名的即時問答搜索引擎,它能結合大語言模型與網上搜索結果,為用戶問答提供精準且附帶引用來源的答案。Perplexity Ask MCP則是一個將Perplexity的能力封裝為MCP服務器的項目,相當于給AI助手內置了一個**“小佩搜搜”**搜索助手,能在對話中直接進行網絡信息檢索和問答。

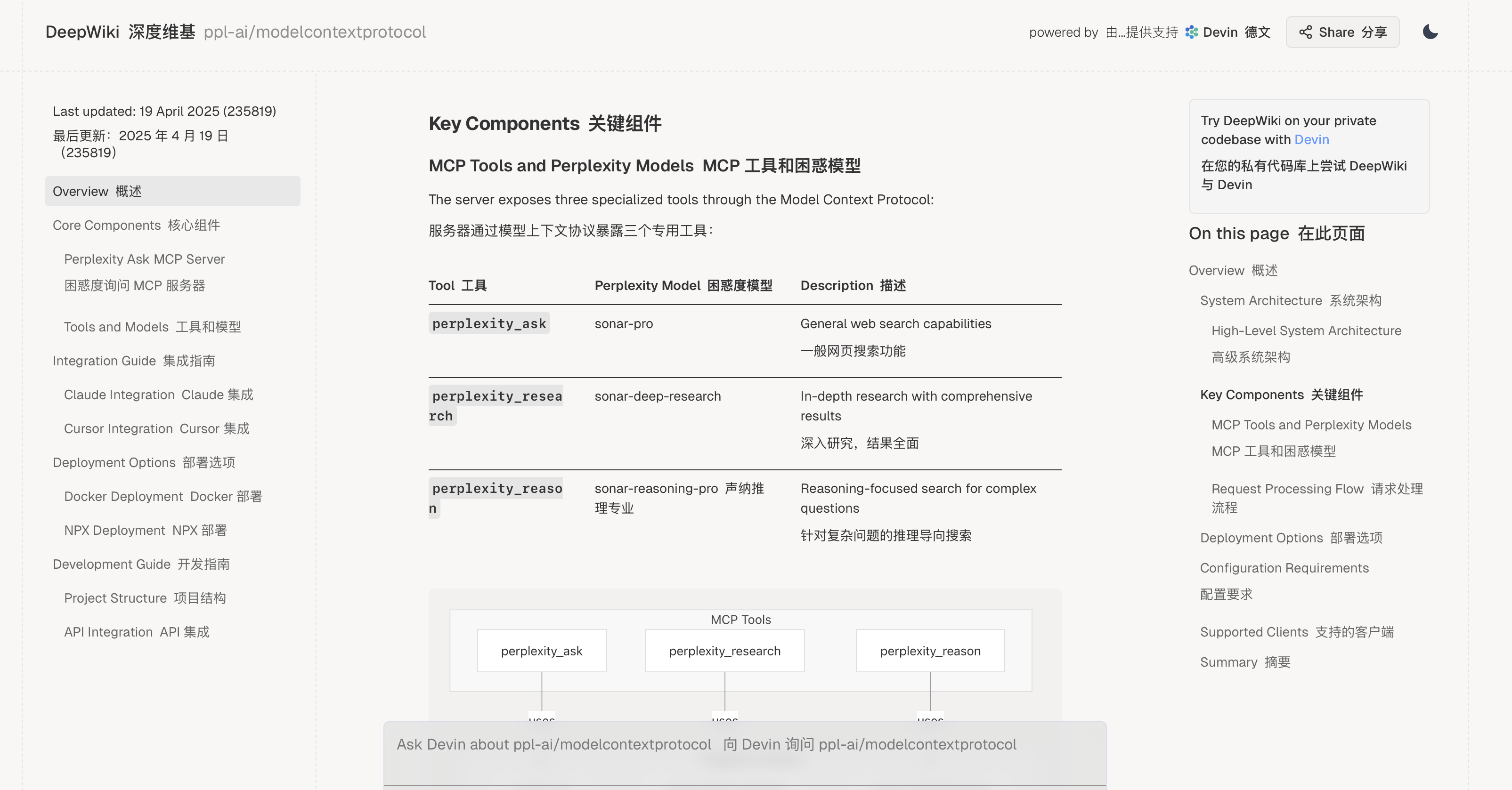

Perplexity MCP連接的是Perplexity提供的Sonar模型家族,包括 sonar-pro、sonar-deep-research 和 sonar-reasoning-pro,通過MCP協議統一暴露出三個專用工具:

perplexity_ask:面向一般網絡搜索,快速回答常規查詢;perplexity_research:面向深入調研,生成更全面、詳細的搜索結果;perplexity_reason:面向復雜推理類問題,專注于深度邏輯分析和綜合推理。

AI在調用這些工具時,不需要直接操作底層API。只需向MCP服務器發送標準格式的調用請求(如提問、關鍵詞搜索、研究主題),服務器自動轉發到Perplexity的后端系統,執行聯網搜索與推理,并將生成的結果(通常包含引用來源)打包返回給AI。

從用戶視角來看,整個聯網搜索過程是完全無感的,體驗上就是——AI突然具備了實時獲取最新信息、引用來源的能力。

引入Perplexity MCP后,AI助手的知識廣度、時效性與事實準確性得到了極大提升:

-

打破知識截止日期:

傳統大語言模型(如GPT)通常有固定的訓練數據截止點,無法了解之后發生的事件。有了Perplexity接口,即使是最新的新聞、科研成果也能即時掌握。 -

標準化聯網搜索能力:

過去如果想讓AI“上網查資料”,需要專門開發爬蟲、解析網頁,非常復雜。而MCP機制讓聯網搜索標準化、模塊化,幾分鐘內就能擴展到新的搜索源。 -

提升事實可靠性:

每次搜索返回的結果,通常都會包含明確的引用鏈接,極大增強了AI回答的可驗證性和可信度。

舉例:

-

用戶問:“2023年諾貝爾化學獎得主都有誰?”

? AI調用perplexity_ask快速搜索最新名單,返回正確答案并附帶新聞來源。 -

用戶咨詢:“蘋果(Apple Inc.)當前股價是多少?值得買入嗎?”

? AI調用perplexity_research獲取實時股價和專業分析摘要,再結合自身理解給出回答。 -

用戶提出:“幫我找幾篇關于2024年量子計算進展的最新研究論文。”

? AI調用perplexity_research執行深度文獻檢索,匯總相關論文并逐條概述。 -

用戶提出更復雜的問題,比如:“列舉三家在量子加密領域快速發展的初創公司,并分析他們的優勢。”

? AI則可能調用perplexity_reason,進行綜合推理式搜索,得出更具洞察力的總結。

用戶提問 ? MCP請求 ? Perplexity執行搜索 ? AI收到結構化答案 ? 呈現給用戶

Perplexity MCP相當于給AI助手安了一個即時搜索引擎的大腦。它帶來的好處首先是準確性提升:AI不再憑記憶硬湊答案,可以查證后再答復,減少了胡扯的概率。其次是時效性:無論今天發生了什么新事,只要能搜到新聞,AI立馬就知道 。最后對用戶來說,引用來源也增加了可信度——這一點Perplexity一直很重視,也延續到了MCP的使用中。

可以想見,有了這樣的檢索能力,AI助手開始真正變成了“百科全書 + 新聞頻道 + 智能分析師”的合體,幾乎無所不知。

當然,凡事有度,我們還是得注意AI給出的信息真實性,不過至少現在它有途徑去獲取真資料了,而不是閉門造車(AI,無限幻覺啟動!)

總結

以上這些案例只是冰山一角。除了上述提到的地圖導航、內容發布、內容生成、信息檢索等場景,社區和企業還開發了許多其他類型的MCP集成:

比如控制Github倉庫的版本管理MCP、遠程執行代碼的沙箱MCP、查詢天氣和日歷的MCP,

甚至連接IoT設備、調用金融交易接口的都有出現。

可以說,哪里有工具需求,哪里就有人嘗試用MCP去打通。

AI的觸角,正通過一個個MCP插件,延伸進各行各業的角落。

四、未來展望:當AI擁有“協作網絡”

看完了MCP和A2A,你可能會想象未來的AI系統會是什么樣子?讓我們大膽暢想一下:

1. AI App Store和Agent網絡的崛起: MCP的出現有望催生一個繁榮的AI技能商店生態。開發者可以發布各種MCP模塊,供用戶的AI助手下載使用;用戶則可以根據自己的需要,像給手機裝App一樣給AI加能力。而A2A則把這些“裝備了不同App”的AI連接成網絡。也許不久的將來,我們每個人都會有一個主AI助手,根據任務需要去調用無數專業小Agent的服務。那個場景有點像漫威的復仇者聯盟——需要打怪時,鋼鐵俠招呼一下,身邊瞬間圍過來雷神、綠巨人等各路英雄助陣,各顯其能。這次AI版“復聯”,靠的正是A2A的通信號角,把英雄們喚到一起,再加上MCP提供的各類“超能力”,最終完成任務。

2. 無縫的跨平臺AI協作: 有了A2A,不同公司的AI不再是信息孤島,而更像加入了同一個互聯網。試想一下,也許你的Slack聊天機器人很快就能直接呼叫你的微軟小娜開會助手,讓它在Outlook日歷上安排會議;或者你的手機語音助手可以與汽車的導航AI對話,提前設置好路線和車內空調溫度。這種跨平臺協作以前難以實現,但A2A提供了標準的溝通管道,AI代理將可以跨越應用和設備邊界合作。這對企業尤為重要——他們可以部署各部門專用的AI,又能確保這些AI通過A2A無縫協同,提高整個業務流程的自動化和效率 。

3. 更復雜任務的自治代理團隊: 隨著A2A的發展,未來可能出現自治的AI團隊來處理超復雜的項目。比如一個大型工程項目,主AI負責總體協調,它可以動態發現和雇傭多個專長Agent:法律Agent審合同、財務Agent管預算、工程Agent監控進度、營銷Agent籌劃發布…這些Agent彼此交流進展、共享信息,各自完成自己的子任務,偶爾還集體開個“AI會議”討論下一步方案。這聽起來像科幻,但技術上并非不可及——A2A已經定義了任務生命周期、消息協作等機制 ,唯一要解決的是讓AI懂得更高層面的規劃和自我組織。不過以當前LLM的推進速度,也許在特定垂直領域先實現這樣的Agent團隊不是難事。

4. 人在回路的協同共生: AI代理網絡并不意味著人被排除在外。相反,A2A非常注重Human-in-the-loop(人的介入) 。未來我們可能會看到一種新工作模式:人類主管多個AI代理,每個代理負責不同模塊工作。A2A讓人類可以方便地在一個界面下監控所有代理的對話和任務進展,必要時通過某個代理插入自己的指令或修改決策。這有點類似現在項目經理管理團隊,只不過團隊成員里有不少AI。通過這樣人機協作的方式,AI網絡將變成我們強大的助手,而人仍負責掌控方向和關鍵判斷。理想情況下,這種協作會產生一種“1+1>2”的效應:AI提供效率和專業擴展,人提供創意和最終把關。

當然,未來并非沒有挑戰。首先是標準競爭與融合的問題——目前Anthropic的MCP和Google的A2A可以說各司其職,但難保不會出現其他競爭標準或變種。如果每家公司又搞一套不兼容的協議,那就重回碎片化老路。不過鑒于雙方都開源開放了規范,又定位明確互補(MCP側重工具接入,A2A側重代理協同 ),業界大概率會選擇兼容并蓄,而不是另起爐灶。或許將來我們會看到一些統一的更高層框架,把MCP和A2A打包起來供開發者直接用,就像今天的web框架封裝了底層協議細節一樣。

另一個挑戰是安全與治理。當AI能調用各種工具、還能彼此聯手行動時,確保它們“不作惡”就更重要了。所幸MCP和A2A一開始就在規范中嵌入了安全機制,如授權、沙盒和用戶確認 。未來還需要建立更完善的信任體系:比如某個第三方提供的MCP插件是否安全可靠、代理聲稱的能力是否屬實(Agent Card可能需要類似數字簽名的認證),等等。我們人類或許需要為AI代理制定一些**“社交規則”和“法律法規”**,以防出現AI作弊、濫用資源甚至結伙干壞事的情況——聽上去有點科幻陰謀論,但未雨綢繆總是好的。

總的來說,MCP和A2A的出現標志著AI從單機走向網絡化的起點。模型不再是封閉運行在自己CPU上的過程,而是逐漸成為網絡中可以交互的節點:既能訪問別的節點資源,又能和別的節點對話協作。有人將這種趨勢稱為*“AI應用的互聯網時刻”*——就像計算機互聯產生了互聯網一樣,AI代理互聯也會產生一個全新的智能網絡 。在這個網絡中,AI不再孤單,每個AI都是更大系統的一部分,可以共享知識、互補長短。

對于我們普通用戶來說,這一切技術進步最終體現為更貼心、更強大的數字助手。未來的AI助手也許同時是你的管家、秘書、司機、翻譯、醫生、老師……他背后是無數專業“小助手”在協同配合,通過標準協議各盡其職。你只需要面對這一個AI,就像只需要和一個團隊領導溝通,他自會安排手下的一群專家為你服務。這幅美好的圖景,正隨著MCP和A2A從科幻走向現實。

最后用一句輕松的話收尾:當我們的AI既能拿起MCP這把瑞士軍刀,又能吹響A2A的集結號角時,曾經那個兩眼一抹黑只會聊天的“小憨憨”,終將成長為上知天文下曉地理、呼朋引伴、無所不能的“智慧管家”。

也許再過些年,我們每天的日常都將在一張龐大的AI代理人網絡中高效運轉,而我們要做的,就是放心地把繁瑣事務交給這群不會抱怨加班的AI伙伴們,然后安心去享受更有創造力和樂趣的生活了!

默子今日睡了,大家晚安~

更多內容請關注默子??

——動態規劃)

)

)

)

——環境搭建)

)

采樣)

)