目錄

1.算法仿真效果

2.算法涉及理論知識概要

2.1?太赫茲信道特性

2.2?Q-learning強化學習基礎

2.3?基于Q-learning 的太赫茲信道信號檢測與識別系統

3.MATLAB核心程序

4.完整算法代碼文件獲得

1.算法仿真效果

matlab2024b仿真結果如下(完整代碼運行后無水印):

仿真操作步驟可參考程序配套的操作視頻。

2.算法涉及理論知識概要

? ? ? ?太赫茲頻段(0.1 - 10THz)擁有豐富的頻譜資源和高速的數據傳輸能力,在未來無線通信、雷達探測等領域展現出巨大的應用潛力。然而,太赫茲信道存在路徑損耗大、分子吸收強、多徑衰落嚴重等問題,使得太赫茲信道信號的檢測與識別面臨挑戰。傳統的信號檢測與識別方法往往依賴于先驗知識和特定的信號模型,在復雜多變的太赫茲信道環境中性能受限。強化學習作為一種智能決策方法,通過智能體與環境進行交互,不斷嘗試不同的動作以最大化累積獎勵,能夠自適應地學習最優策略。

2.1?太赫茲信道特性

? ? ? ?太赫茲頻段的電磁波在大氣中傳播時,會受到分子吸收、散射等因素的影響,導致信號強度衰減。此外,太赫茲信道的多徑效應明顯,信號經過不同路徑傳播后到達接收端,會產生時延擴展和頻率選擇性衰落。太赫茲信道的路徑損耗可以用如下公式表示:

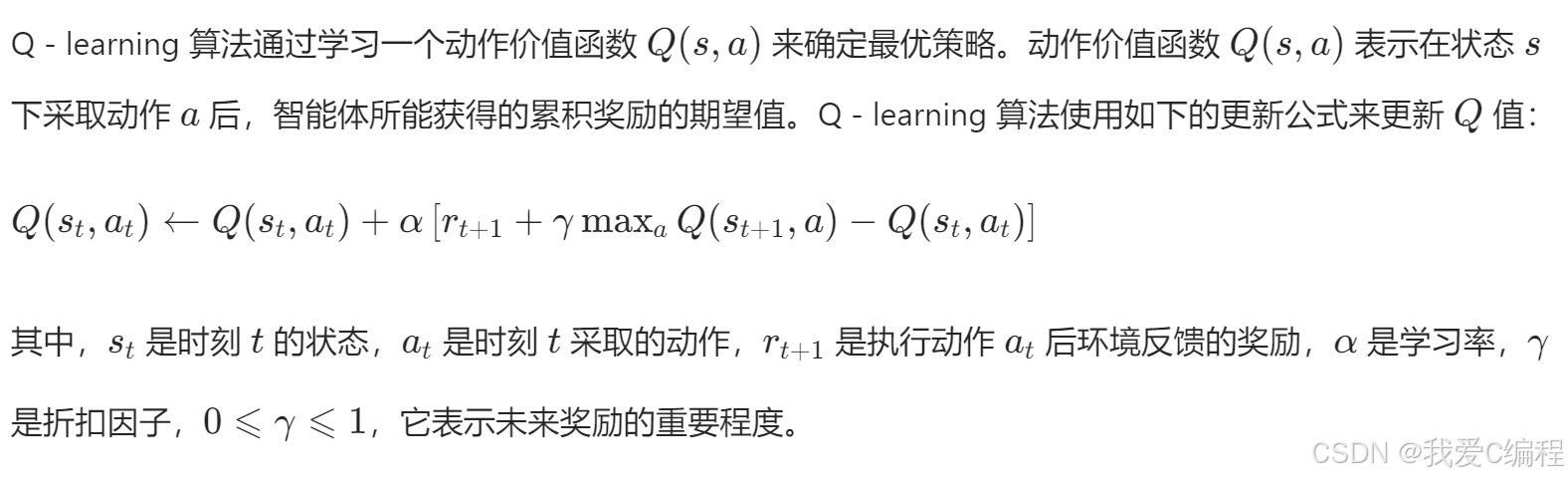

2.2?Q-learning強化學習基礎

? ? ? ?強化學習由智能體(Agent)、環境(Environment)、狀態(State)、動作(Action)和獎勵(Reward)等要素組成。智能體在環境中根據當前狀態選擇動作,環境根據智能體的動作反饋新的狀態和獎勵。智能體的目標是通過不斷與環境交互,學習到一個最優策略,使得累積獎勵最大化。

? ? ? ? 在Q-learning 算法中,智能體通常采用?-貪心策略來選擇動作。以概率1??選擇當前Q值最大的動作,以概率?隨機選擇一個動作,這樣可以在探索新的動作和利用已知的最優動作之間進行平衡。

2.3?基于Q-learning 的太赫茲信道信號檢測與識別系統

狀態定義

? ? ? ?在太赫茲信道信號檢測與識別系統中,狀態?s?可以由接收信號的特征向量來表示。例如,可以提取接收信號的功率譜特征、時域特征(如均值、方差等)和頻域特征(如中心頻率、帶寬等)。

動作定義

? ? ? ?動作a可以定義為不同的信號檢測與識別方法或參數設置。例如,動作可以包括選擇不同的檢測閾值、采用不同的信號處理算法(如匹配濾波、能量檢測等)。

獎勵設計

? ? ? ?獎勵r的設計應能夠反映智能體采取的動作在信號檢測與識別任務中的優劣。以下是幾種常見的獎勵設計方法:

? ? ? ?基于Q-learning強化學習的太赫茲信道信號檢測與識別系統利用強化學習的智能決策能力,能夠自適應地選擇最優的信號檢測與識別方法,在復雜多變的太赫茲信道環境中具有較好的性能。通過合理定義狀態、動作和獎勵,Q-learning算法可以有效地學習到最優的動作價值函數,提高信號檢測的準確率和降低誤檢率。

3.MATLAB核心程序

.....................................................

snrRanges = [1:1:25]; % 信噪比范圍(dB)

fc = 0.3e12; % 載波頻率300GHz

fs = 1e12; % 采樣率1THz% 生成發送信號

........................

% 通過太赫茲信道

........................

% 特征提取和狀態獲取

........................

% ε-greedy動作選擇

........................

% 計算獎勵

........................

% Q-table更新

Q(state, action) = Q(state, action) + alpha*(reward + gamma*max(Q(state, :)) - Q(state, action));figure;

plot(snrRanges,movmean(mean(accuracy,2), 5),'-b<',...'LineWidth',1,...'MarkerSize',6,...'MarkerEdgeColor','k',...'MarkerFaceColor',[0.4,0.8,0.3]);

xlabel('SNR');

ylabel('識別率');

grid on;%結果可視化

figure;

plot(Rwd1,'LineWidth',2)

hold on

title('訓練過程獎勵變化');

xlabel('訓練回合數');

ylabel('平均獎勵');

grid on;

0Z_018m4.完整算法代碼文件獲得

V

)

——THORChain退款邏輯漏洞)

:使用屬性表(Property Sheet)實現自動化Qt編譯流程)