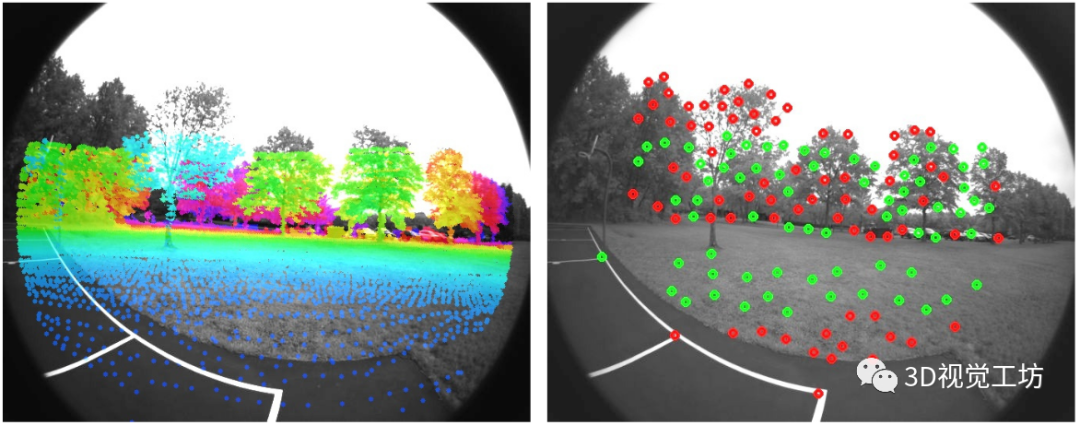

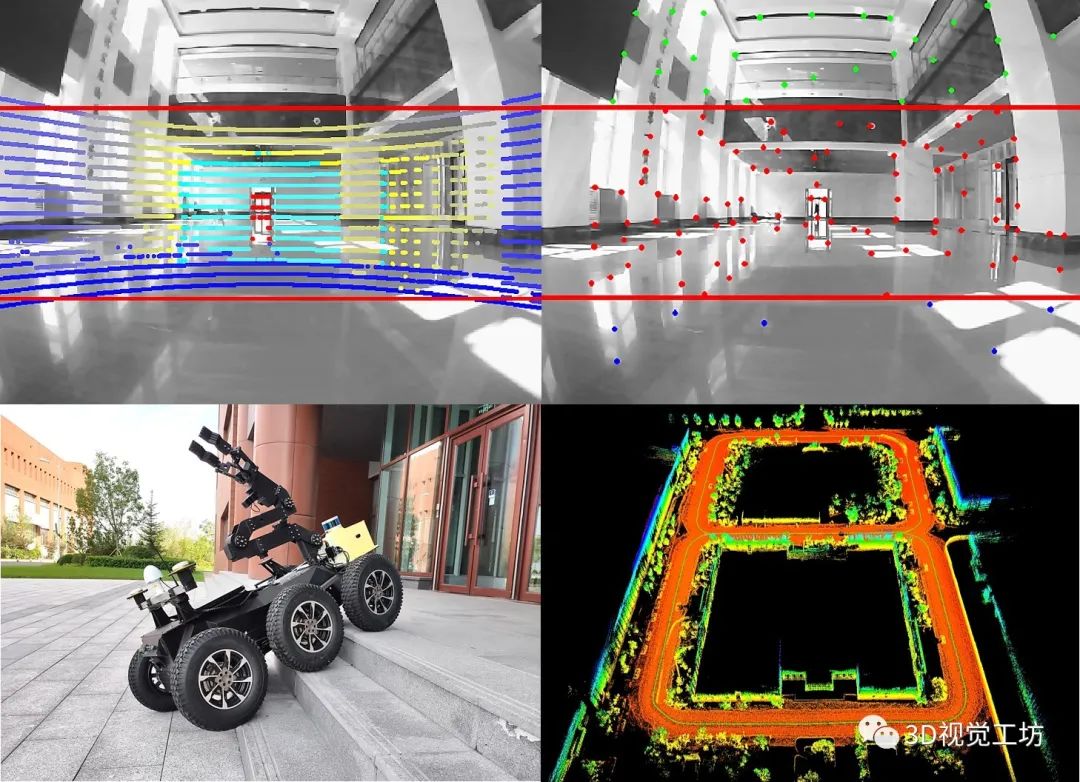

自主導航是機器人與自動駕駛的核心功能,而SLAM技術是實現自主導航的前提與關鍵。現有的機器人與自動駕駛車輛往往會安裝激光雷達,相機,IMU,GPS等多種模態的傳感器,而且已有許多優秀的激光SLAM與視覺SLAM算法。但是每種模態的傳感器都有其優點和缺點,如相機只能測量2D圖像,且容易受光照和夜晚的影響;激光雷達獲取的3D點云較為稀疏,而且在長走廊,隧道,以及開闊場景中容易發生退化;GPS測量極易受到環境的干擾;每種模態的傳感器只能在適當的環境中發揮積極的作用。因此,我們希望以適當的方式融合多種模態的測量,通過優勢互補,使SLAM算法能夠在各種挑戰性環境下持續輸出魯棒且精確的估計結果。因此無論是學術界還是工業界,多模態融合是未來SLAM發展的必然趨勢。

相關崗位要求及待遇

目前各個機器人和自動駕駛的企業常年有SLAM算法的崗位需求,對于多傳感器融合SLAM算法崗位更是開出高薪,而且優秀人才緊缺。下面是招聘網站上對多傳感器融合崗位的要求和待遇:

如何快速從入門到精通

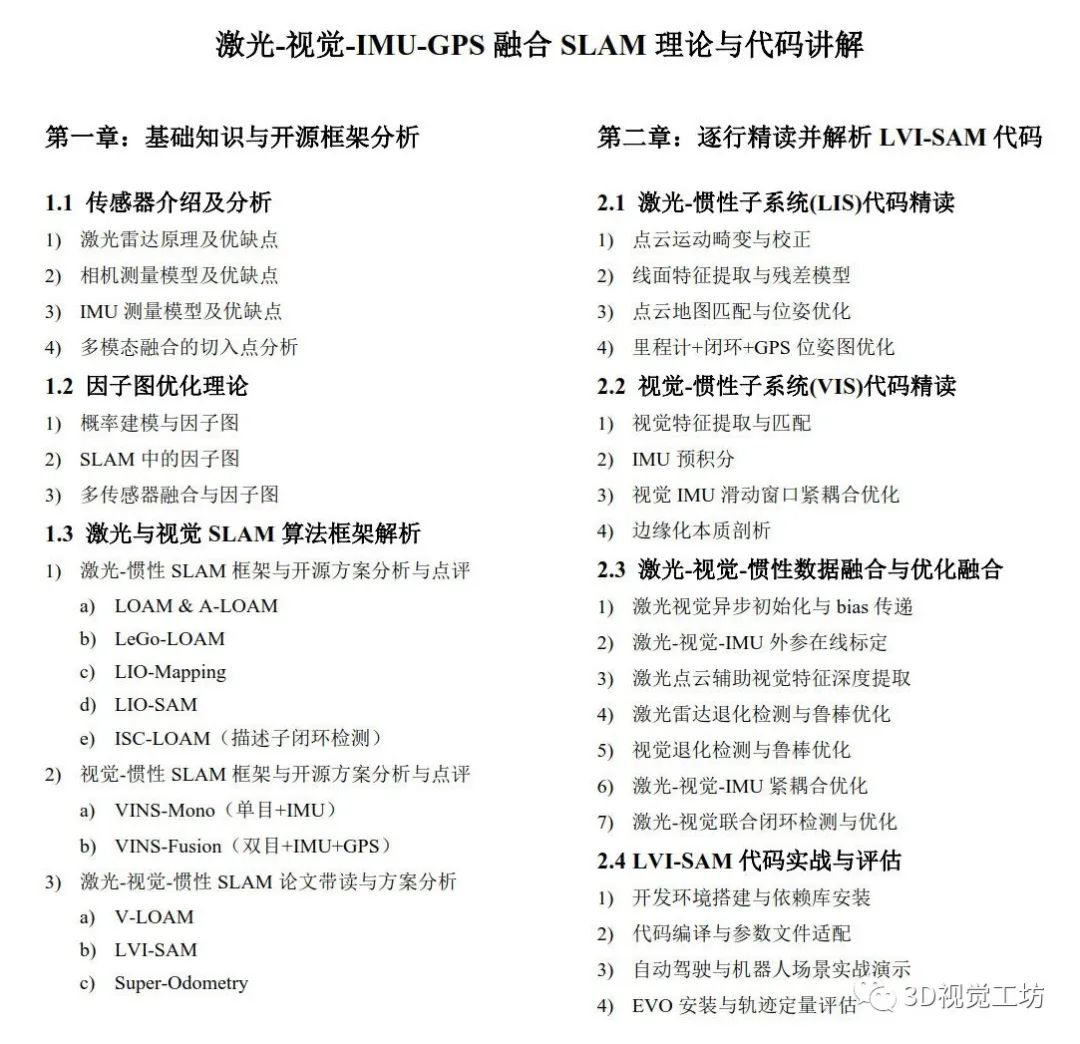

然而多模態融合SLAM的門檻較高,在需要視覺SLAM與激光SLAM的基礎之外,還會遇到不同模態測量的融合,不同傳感器的時間同步,多傳感器的外參標定,多傳感器異常檢測等問題,使得各位同學做這塊的時候遇到諸多障礙。因此我們聯合機器人學國家重點實驗室的博士大佬推出這門課程,從理論和代碼實現兩個方面對激光雷達-視覺-IMU-GPS融合的SLAM算法框架和技術難點進行講解,并且博士大佬會根據自己多年的機器人工程經驗,向大家講解在實際機器人應用中多模態融合的方法和技巧。課程大綱如下:

講師介紹

蘇赟博士,碩博畢業于機器人學國家重點實驗室,在IROS,RAS等機器人領域頂級會議和期刊發表論文多篇,精通主流視覺SLAM和激光SLAM框架代碼,曾收割大疆,華為等大廠offer。本課程將以LVI-SAM為框架對多模態融合的SLAM進行講解,助力各位同學對多模態融合的SLAM更快的入門和更深的理解。

課程亮點

1. 國內首個多模態融合SLAM課程;

2. 循序漸進,從理論框架,到逐行代碼講解;

3. 專屬的學習交流群,可以與講師,各大院校和企業的人才進行溝通交流,一起分析和討論遇到的難題,防止閉門造車;

4. 真正能面向工業落地的內容分享;

學后收獲

1. 掌握各個傳感器模型,傳感器標定與數據同步;

2. 對激光SLAM與視覺SLAM的框架,各自的優勢與劣勢,適應的場景有深刻的理解;

3. 能夠掌握多模態融合的切入點,真正手動實現多模態融合優化的代碼,可以后續擴展到其他模態傳感器的融合;

4. 可以建立良好的交流圈子,隨時與相同方向的同學和同行進行交流;

課程要求與面向對象

1. 有一定C++編程功底,對Linux,ROS等工具比較熟悉;

2. 熟悉SLAM相關的基礎知識,對概率論、線性代數、非線性優化有一定基礎;

3. 主要面向機器人和自動駕駛領域的本科生,碩士生,博士生,以及從事SLAM算法的企業人員;

課程咨詢

點擊購買與咨詢

▲微信掃碼可查看、購買、學習課程

▲添加小助理微信:cv3d007,了解更多

)

)

)

![[linux] matplotlib plt畫training dynamics指標曲線時,標記每個點的值](http://pic.xiahunao.cn/[linux] matplotlib plt畫training dynamics指標曲線時,標記每個點的值)