一、介紹

????????在新興的人工智能 (AI) 領域,深度神經網絡 (DNN) 是一項里程碑式的成就,突破了機器學習、模式識別和認知模擬的界限。這一技術奇跡的核心是一個與認知科學本身一樣古老的思想:聯結主義。本文深入探討了聯結主義的基本原理,探討了它對深層神經網絡的發展和功能的影響,并說明了它在模擬反映人類智能的復雜認知任務中的重要性。

在神經元和突觸錯綜復雜的舞蹈中,深層神經網絡體現了聯結主義的本質,用簡單的線索編織了一幅認知的掛毯。

二、背景知識

????????深度神經網絡 (DNN) 的主要基本思想確實是聯結主義,這是認知科學中的一個概念,它提出人類思維的認知過程是大腦中簡單單元(神經元)之間龐大連接網絡的結果。這一思想通過以下方式反映在深度神經網絡的架構和功能中:

- 來自生物神經網絡的啟發:?DNN 的基本單元是人工神經元或節點,它模仿大腦中生物神經元的功能。這些人工神經元接收輸入,對其進行處理,然后將輸出傳遞到下一層神經元,類似于生物神經元傳輸信號的方式。

- 分層結構:深度神經網絡由多層神經元組成,包括輸入層、隱藏層和輸出層。這種分層結構允許對信息進行抽象和分層處理,從早期層的簡單模式到較深層的復雜概念。這反映了在大腦中觀察到的分層處理。

- 連接權重:?DNN 中神經元之間的連接由權重表示,權重在訓練過程中進行調整。這種學習過程類似于大腦從經驗中學習時突觸的加強或減弱。

- 并行處理:正如大腦通過神經元的并行操作處理信息一樣,DNN 利用現代計算硬件的并行處理能力來同時處理大量數據。

- 從經驗中學習:深度神經網絡從大量數據中學習,其方式類似于人類從經驗中學習的方式。通過稱為反向傳播的過程,DNN 根據輸出誤差調整連接權重,隨著時間的推移逐漸提高其任務性能。

????????在深度神經網絡中實現的連接主義強調分布式表示和并行計算以實現學習和泛化的能力。這使得 DNN 在圖像和語音識別、自然語言處理等許多其他任務中特別有效,它們可以捕獲數據中的復雜模式和關系。

三、歷史背景和理論基礎

????????聯結主義的根源可以追溯到早期的心理學理論和計算模型,這些理論和計算模型試圖理解人腦如何處理信息。它假設認知過程源于一個巨大的簡單單元網絡的相互作用,類似于大腦中的神經元。這種觀點與經典的符號人工智能形成鮮明對比,后者依賴于基于明確規則的符號操作來模仿智能。聯結主義提供了一種更細致、受生物學啟發的方法,表明智能是從相互關聯的單元的集體動態中產生的。

四、深度神經網絡的架構

????????深度神經網絡通過人工神經元或節點的結構化層體現了聯結主義的原理。這些層包括輸入層、隱藏層和輸出層,每個層都包含執行簡單計算的單元。DNN 中的“深度”是指存在多個隱藏層,這些隱藏層使網絡能夠對數據中復雜的分層模式進行建模。這種架構允許逐漸抽象特征,從初始層的基本形狀或聲音到更深層次的復雜概念和表示,反映了在人腦中觀察到的認知分層。

五、通過聯系學習

????????DNN 中學習的本質以及擴展連接主義在于神經元之間連接權重的調整。這些權重決定了一個神經元對另一個神經元的強度和影響,類似于生物神經元之間的突觸強度。通過稱為反向傳播的過程,DNN 根據其輸出與期望結果之間的差異迭代地調整這些權重。這種學習機制反映了人腦的可塑性,可根據新的經驗和信息進行自我調整和重組。

六、并行處理和分布式表示

????????連接主義強調并行處理和分布式表示的重要性,這兩者都是 DNN 操作所固有的。正如大腦通過其神經網絡同時處理多個刺激一樣,DNN 利用現代計算能力同時執行大量計算。此外,DNN 中的信息并不局限于單個神經元。相反,它分布在整個網絡中,從而實現信息處理的穩健性和靈活性。這種表示和計算的分布式特性使 DNN 能夠處理數據中的歧義、噪聲和復雜性,就像人類認知系統一樣。

七、影響和啟示

????????深度神經網絡的聯結主義基礎推動了人工智能的重大進步,使機器能夠執行以前被認為是人類智能獨有的任務。從掌握復雜的游戲到駕駛自動駕駛汽車、實時翻譯語言和診斷醫療狀況,DNN 的功能不斷擴展。這些成就強調了聯結主義作為人工智能研究指導原則的力量,凸顯了 DNN 模擬并在某些方面超越人類認知能力的潛力。

八、參考代碼

????????為了使用 Python 說明深度神經網絡中的連接主義概念,我們可以創建一個簡單的示例,其中涉及構建深度神經網絡來對合成數據集進行分類。此示例將涵蓋生成合成數據集、使用 TensorFlow 和 Keras 構建神經網絡模型、訓練模型、使用指標評估其性能以及使用繪圖可視化結果。

第 1 步:生成綜合數據集

我們將首先創建一個適合分類問題的合成數據集。我們可以使用 scikit-learn 的make_moons函數生成一個包含兩個類之間具有非線性邊界的數據集,這可以有效地展示深度神經網絡捕獲復雜模式的能力。

第 2 步:構建深度神經網絡

對于神經網絡,我們將使用 TensorFlow 和 Keras 定義多層模型。這將通過神經元的互連層來說明聯結主義的概念。

第 3 步:訓練模型

我們將編譯模型,指定損失函數和優化器,然后在合成數據集上對其進行訓練。此步驟將根據訓練數據調整網絡中連接的權重。

第 4 步:評估模型

訓練后,我們將使用準確性作為指標來評估模型在測試集上的性能。

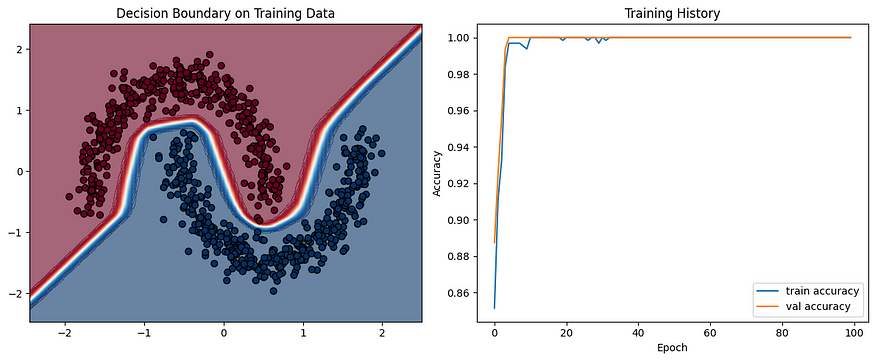

第 5 步:可視化結果

最后,我們將繪制網絡學習的決策邊界和訓練歷史,以直觀地評估模型如何學習對合成數據集進行分類。

讓我們用 Python 來實現這些步驟:

import numpy as np

import matplotlib.pyplot as plt

from sklearn.datasets import make_moons

from sklearn.model_selection import train_test_split

from sklearn.preprocessing import StandardScaler

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense

from tensorflow.keras.optimizers import Adam# Step 1: Generate a synthetic dataset

X, y = make_moons(n_samples=1000, noise=0.1, random_state=42)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)# Standardize the data

scaler = StandardScaler()

X_train_scaled = scaler.fit_transform(X_train)

X_test_scaled = scaler.transform(X_test)# Step 2: Build the deep neural network

model = Sequential([Dense(64, activation='relu', input_shape=(2,)),Dense(64, activation='relu'),Dense(1, activation='sigmoid')

])# Step 3: Train the model

model.compile(optimizer=Adam(learning_rate=0.01), loss='binary_crossentropy', metrics=['accuracy'])

history = model.fit(X_train_scaled, y_train, epochs=100, verbose=0, validation_split=0.2)# Step 4: Evaluate the model

test_loss, test_acc = model.evaluate(X_test_scaled, y_test, verbose=0)

print(f"Test Accuracy: {test_acc:.4f}")# Step 5: Visualize the results

# Plotting the decision boundary

def plot_decision_boundary(model, X, y):x_min, x_max = X[:, 0].min() - 0.5, X[:, 0].max() + 0.5y_min, y_max = X[:, 1].min() - 0.5, X[:, 1].max() + 0.5xx, yy = np.meshgrid(np.linspace(x_min, x_max, 100), np.linspace(y_min, y_max, 100))Z = model.predict(np.c_[xx.ravel(), yy.ravel()])Z = Z.reshape(xx.shape)plt.contourf(xx, yy, Z, levels=np.linspace(Z.min(), Z.max(), 100), cmap='RdBu', alpha=0.6)plt.scatter(X[:, 0], X[:, 1], c=y, s=40, cmap='RdBu', edgecolors='k')plt.xlim(xx.min(), xx.max())plt.ylim(yy.min(), yy.max())plt.figure(figsize=(12, 5))

plt.subplot(1, 2, 1)

plot_decision_boundary(model, X_train_scaled, y_train)

plt.title("Decision Boundary on Training Data")# Plotting training history

plt.subplot(1, 2, 2)

plt.plot(history.history['accuracy'], label='train accuracy')

plt.plot(history.history['val_accuracy'], label='val accuracy')

plt.title('Training History')

plt.xlabel('Epoch')

plt.ylabel('Accuracy')

plt.legend()

plt.tight_layout()

plt.show()測試精度:1.0000

313/313 [================================] - 1s 1ms/步

????????此代碼片段演示了從數據準備到模型評估和可視化的整個過程。通過執行它,您可以觀察深度神經網絡如何學習對非線性可分離數據集進行分類,從而展示聯結主義的實際原理。

九、結論

????????連接主義強調互連單元的涌現屬性,為理解和開發深度神經網絡提供了一個令人信服的框架。通過從人腦的結構和功能中汲取靈感,DNN 融合了計算效率和認知深度,彌合了人工智能和自然智能形式之間的差距。隨著我們不斷探索聯結主義的深度,深度神經網絡的進化有望進一步闡明認知的奧秘并開啟人工智能的新領域。

有案例!)

)

)