Uncertainty Quantification of Collaborative Detection for Self-Driving

- 摘要

- 引言

- 方法

- 問題定義

- 方法概覽

- Double-M

- 實驗

- 結論

摘要

在聯網和自動駕駛汽車(CAVs)之間共享信息從根本上提高了自動駕駛協同目標檢測的性能。然而,由于實際挑戰,CAV 在目標檢測方面仍然存在不確定性,這將影響自動駕駛中的后續模塊,例如規劃和控制。因此,不確定性量化對于 CAV 等安全關鍵系統至關重要。我們的工作是第一個估計協作目標檢測的不確定性的工作。我們提出了一種新的不確定性量化方法,稱為雙 M 量化,它通過直接建模邊界框每個角的多變量高斯分布來調整移動塊引導 (MBB) 算法。我們的方法通過基于離線雙 M 訓練過程的一次推理傳遞來捕獲認知不確定性和任意不確定性。它可以用于不同的協作對象檢測器。通過對綜合協同感知數據集進行了實驗,我們表明與最先進的不確定性量化方法相比,我們的 Double-M 方法在不確定性得分上提高了 4× 以上,準確率提高了 3% 以上。我們的代碼在 https://coperception.github.io/double-m-quantification/

引言

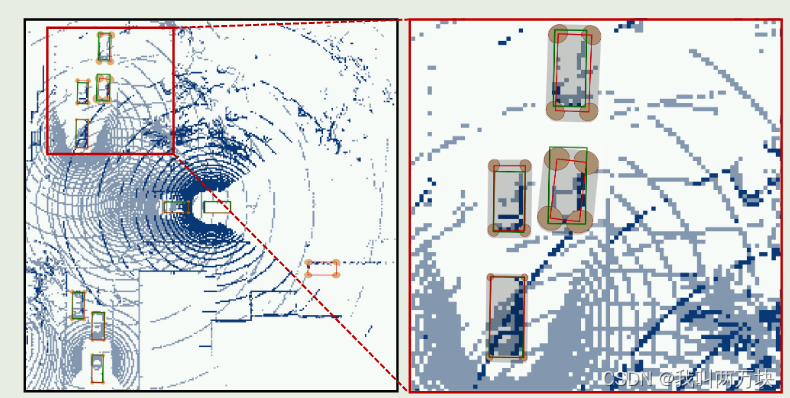

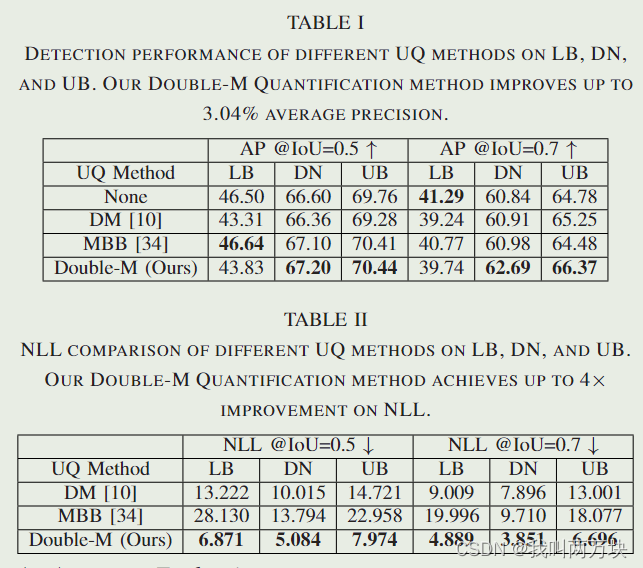

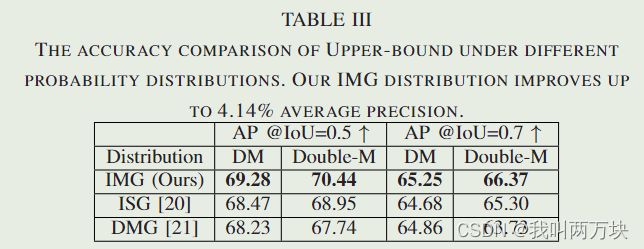

在本文中,我們提出了一種新的用于協同目標檢測的不確定性量化方法,稱為DoubleM量化(直接建模移動塊自舉量化),它只需要一個推理通道即可捕獲認知和任意不確定性。我們的方法為每個檢測到的目標構建的不確定性集有助于后續模塊完成自動駕駛任務,如不確定性傳播的軌跡預測[25]和魯棒規劃與控制[26],[27]。從圖1可以看出,采用我們的不確定性量化方法,檢測精度低的目標往往具有較大的不確定性,構建的不確定性集在大多數情況下覆蓋了ground-truth bounding box。與目前的現狀[20],[21]相比,我們的Double-M Quantification方法在綜合協同感知數據集V2X-SIM上的不確定性評分提高了4倍,準確率提高了3.04%[1]。

圖1:左圖為鳥瞰圖(BEV)中間協同的檢測結果,右圖對特定部分進行放大,顯示兩種檢測的魯棒范圍。紅框代表預測,綠框代表事實。橙色橢圓表示每個角的協方差。陰影凸包表示被檢測對象的不確定性集。在大多數情況下,陰影凸包覆蓋綠色邊界框,這有助于后續模塊完成自動駕駛任務,如不確定性傳播的軌跡預測[25]和魯棒規劃與控制[26],[27]。采用我們的Double-M量化方法,檢測精度低的目標往往具有較大的不確定性。

我們的貢獻:

1)據我們所知,我們提出的Double-M量化是第一次嘗試估計協同目標檢測的不確定性。我們的方法定制了一種移動塊自舉算法來估計。在一個推理過程中,認知不確定性和任意不確定性同時存在。

2)設計了一種新的直接建模分量中邊界盒不確定性的表示格式,以估計任意不確定性。我們將邊界框的每個角視為一個獨立的多變高斯分布,每個角的協方差矩陣由一個輸出頭估計,而現有文獻主要假設每個角的每個維度都是單變高斯分布或所有角都是高維高斯分布。

3)我們驗證了基于V2X-SIM[1]的方法的優勢,并表明我們的雙m量化方法減少了不確定性,提高了精度。結果還驗證了在自動駕駛汽車之間共享中間特征信息有利于系統提高準確性和減少不確定性。

方法

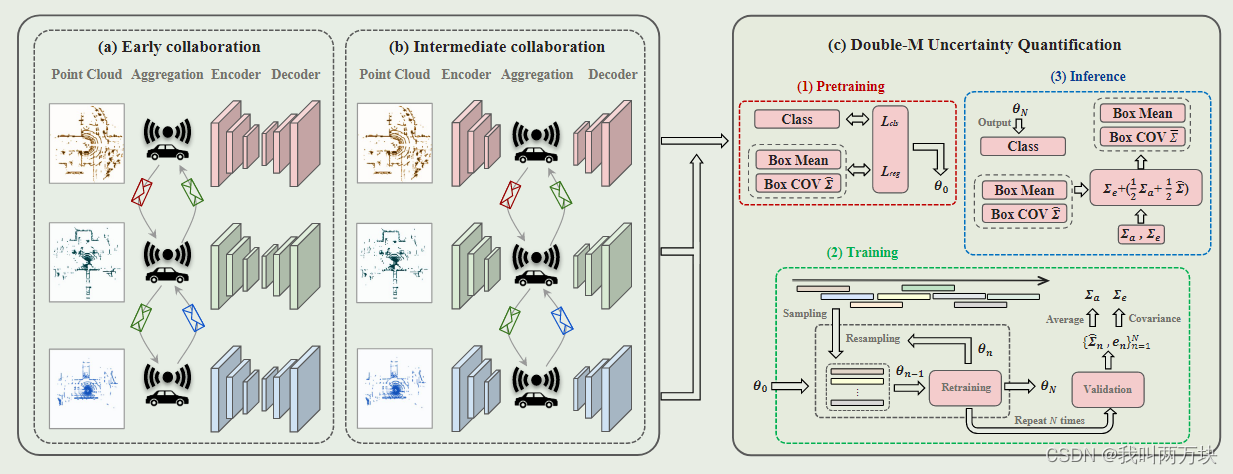

在本節中,我們首先定義了協作目標檢測的不確定性量化問題。然后,我們描述了我們的新型DoubleM量化(直接建模移動塊自舉量化)方法的總體結構,如圖2所示,然后是詳細的算法過程。最后,我們定義了神經網絡模型的損失函數。一個主要的新穎之處是首次定制了移動塊引導34算法,以解決協作對象檢測的不確定性量化挑戰,并在離線訓練過程中通過一次推理來估計認知和任意不確定性。該算法不依賴于特定的神經網絡模型或結構,可以與不同的協作對象檢測器(如DiscoNet[1])一起使用。相應的損失函數同時考慮預測精度和協方差作為度量

圖2所示:協同目標檢測的雙m量化方法。(a)早期協作與其他代理共享原始點云,(b)中間協作與其他代理共享中間特征表示。?雙m量化方法估計每個角的多變量高斯分布。我們的雙m量化方法可用于不同的協同目標檢測。在訓練階段,Double-M Quantification定制了一種移動塊自舉算法來獲得最終的模型參數,Σa作為驗證數據集的平均任意不確定性,Σe作為所有殘差向量的協方差,用于認知不確定性。在推理階段,將Σa、Σe與目標檢測器預測的協方差矩陣↓Σ結合,計算出分布的協方差矩陣↓Σ = Σe + (1 2 Σa + 1 2↑Σ)

問題定義

在每個點云數據X中,有J個對象。對于每個對象j∈{1,…, J},我們建議預測邊界框的I個角。每個角i∈{1,…, I}由BEV映射中的d維向量表示。真實的邊界框集合Y表示為Y ={cj, {yij}I I =1}J J =1,其中c是分類標簽,而yij∈RD,?(I, J)。預測邊界框集合y表示為y ={pj, {yj, {Σij}I I =1}J J =1,其中p是預測分類概率,將邊界框的每個角建模為多元高斯分布。這里,我們假設邊界框的每個角的概率分布是獨立的。在訓練過程中,通過最小化檢測損失Ldet(Y, Y^)來共同學習編碼器E、聚合器和解碼器D的神經網絡參數,Ldet(Y, Y^)包括分類損失和考慮預測準確性和不確定性的回歸損失。

方法概覽

我們設計了一種新的不確定性量化方法,稱為直接建模移動塊自舉量化(Double-M量化),通過將MBB算法與DM方法相結合來估計認知和任意不確定性。雙m量化在協同目標檢測上的概述如圖2所示。在訓練階段,我們在重采樣的運動塊上訓練目標檢測器。經過N次bootstrap,我們得到目標檢測器f θ(其中,θ為最終模型參數),計算驗證數據集的平均任意不確定性Σa,計算所有殘差向量的認知不確定性協方差Σe。在推理階段,我們以輸入點云X為例,結合Σa、Σe和f θ (X)的預測協方差矩陣- Σij,計算多元高斯分布的協方差矩陣- Σij = Σe +(1 2 Σa + 1 2 Σij)。

【bootstrap】Bootstrap 是一種統計方法,通過從原始數據集中抽取多個樣本并對這些樣本進行重新采樣,以生成多個訓練集。這些訓練集會用于訓練多個模型,從而生成多個預測結果。這種方法可以用于評估模型的穩定性和魯棒性,以及估算預測誤差。

Double-M

Monte-Carlo dropout[23]和deep ensembles[24]被用來估計認知不確定性。然而,它們都沒有考慮數據集中的時間序列特征,而時間特征對cav來說很重要。我們設計了一種新的不確定性量化方法,稱為Double-M量化,用于在考慮數據集中的時間特征時估計認知和任意不確定性。特別是,我們的設計在時間序列數據上定制了一個移動塊引導[34]過程,該過程通過在訓練過程中從構建的數據塊中采樣數據來捕獲數據內的自相關性。

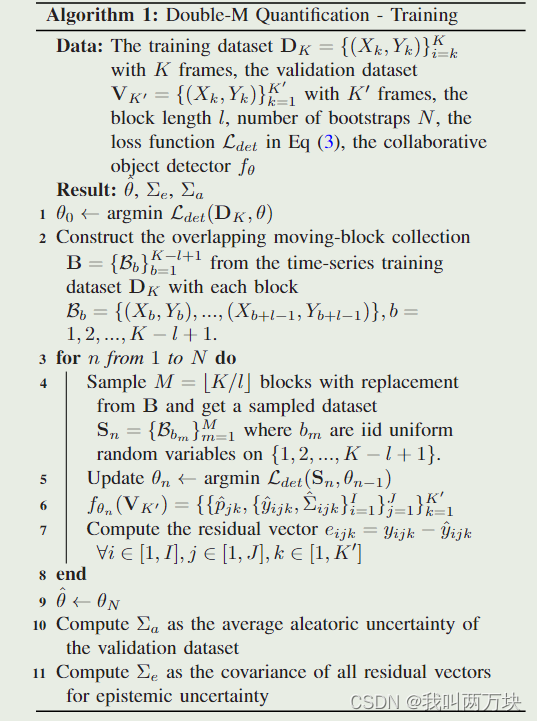

在算法1中給出了雙m量化方法的訓練階段。

- 我們首先初始化協同目標檢測器的參數θ,并使用訓練數據集對模型進行預訓練。然后,我們從包含K幀的時間序列訓練數據etdk中構造定長時間序列塊集B,注意,塊集b通過保持同一塊內幀的順序來保持時間特性 (參見第2行)

- 然后,在每次迭代中,我們使用采樣數據集重新訓練模型,該數據集包含M個從塊集B中以替換和均勻隨機概率采樣的塊 (參見第4-5行)。

- 在每個訓練迭代n的最后一步,我們在驗證數據集VK′上測試保留的模型fθn (見第6行),并將殘差向量計算為地面實況向量yijk和預測的平均向量vx yijk之間的差,?i∈[1,i],j∈[1],j],k∈[1、k′](見第7行)

經過N次迭代后,我們得到了最終的模型參數θ,以通過模型f θ來預測協方差。除了最終訓練的模型之外,我們還通過使用驗證數據集的殘差和預測協方差矩陣來估計算術和認知的不確定性。我們首先通過計算∑a來估計算術不確定性,∑a是所有預測協方差矩陣的平均值。為了估計認知不確定性,我們計算所有殘差向量的協方差矩陣,用∑e表示。

一方面,我們的雙M量化方法通過對驗證數據集上N次迭代的多個模型進行聚合,提供了袋裝算術不確定性估計。另一方面,它近似殘差的誤差分布,以便我們可以量化認識上的不確定性。

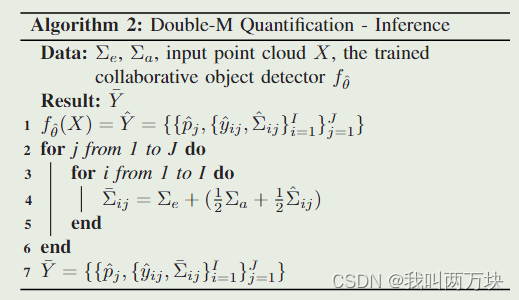

我們的雙m量化方法的推理階段如算法2所示

實驗

1)下限(LB)[1]:不需要協作的單個目標探測器,只使用單個激光雷達的點云數據。

2) DiscoNet (DN)[2]:中間協同目標檢測器,利用邊緣權值為矩陣值的有向圖,通過抑制噪聲空間區域,增強信息區域,自適應聚合不同agent的特征。它通過共享緊湊和上下文感知的場景表示,顯示了良好的性能-帶寬權衡。

3)上界(UB)[1]:早期協同目標檢測器使用來自所有聯網車輛的原始點云數據,如圖2(a)所示。它通常具有良好的信息無損性能,但占用較高的通信帶寬。

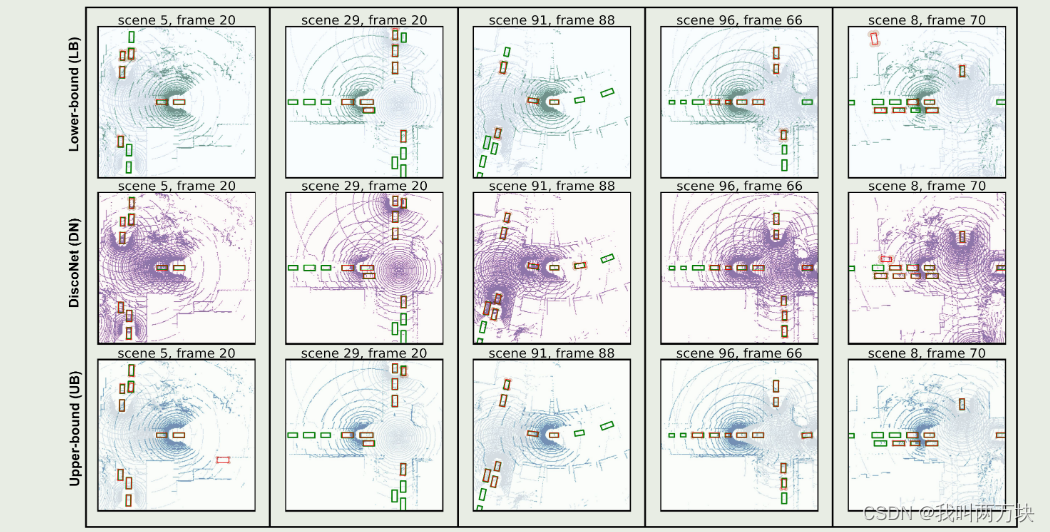

圖3所示。我們的雙m量化結果在V2X-Sim不同場景下的可視化[1]。LB、DN和UB的結果分別顯示在第一行、第二行和第三行。紅框代表預測,綠框代表事實。橙色橢圓表示每個角的協方差。我們可以看到,當紅色邊界框和對應的綠色邊界框之間的差異很大時,我們的Double-M Quantification預測了較大的橙色橢圓,這意味著我們的方法是有效的。例如,在場景29第20幀的DiscoNet子圖中,對于右上方的對象O1,紅色和綠色邊界框之間的差異很大,因此Double-M Quantification預測出較大的橙色橢圓。對于O1左側的三個對象,它們的紅色和綠色邊界框之間的差異很小,因此Double-M量化預測了小的橙色橢圓

結論

這項工作提出了首次嘗試估計協作目標檢測的不確定性。本文提出了一種新的不確定性量化方法,即雙不確定性量化方法,可以通過一次推理同時預測認知不確定性和任意不確定性。關鍵的新穎之處是定制的移動塊引導訓練過程,以及為邊界盒的每個角估計一個獨立的多變量高斯分布的損失函數設計。在不同的協同目標檢測器上驗證了我們的不確定度量化方法。實驗表明,該方法具有較好的不確定度估計和精度。在未來,我們將把我們的方法應用于更多的協同感知數據集,并通過不確定性量化來提高軌跡預測的性能。

)

)

——修飾詞靜態(static)的用法詳解)