自2022年11月公開發布以來,ChatGPT已成為許多企業和個人的必備工具,但隨著該技術越來越多地融入我們的日常生活,人們很自然地想知道:ChatGPT是否是保密的。

問:ChatGPT保密嗎?

答:否,ChatGPT會記錄每段對話,包括用戶共享的任何個人數據,并將其用作訓練數據。

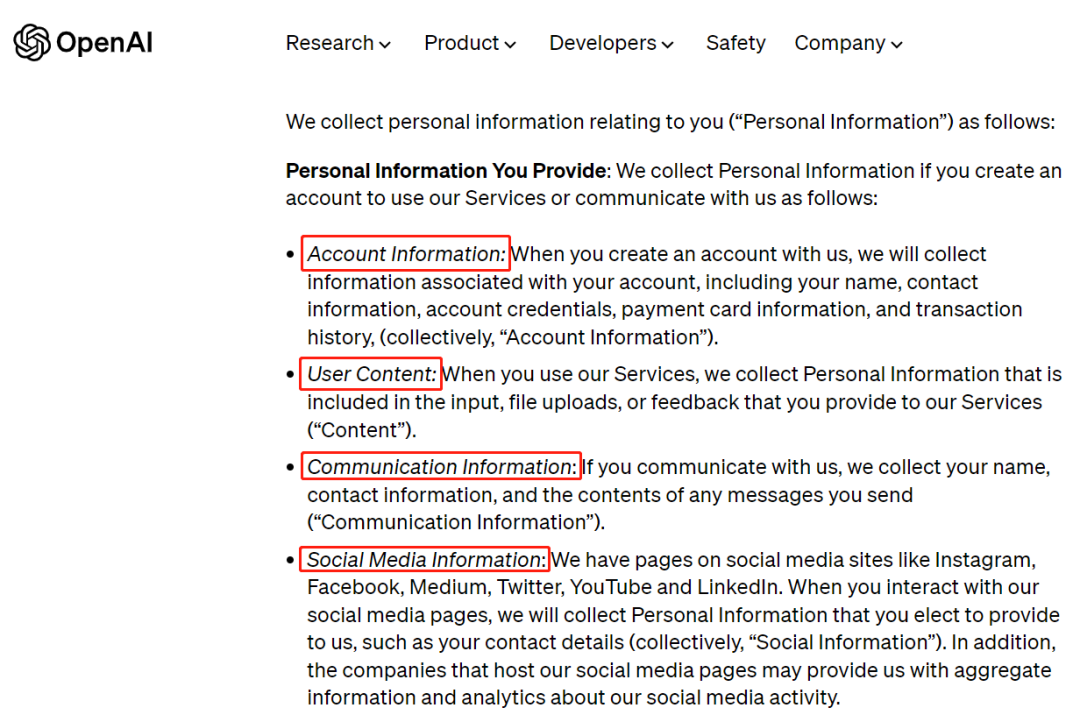

OpenAI的隱私政策規定,該公司收集用戶向ChatGPT及其其他服務提供的“輸入、文件上傳或反饋”中包含的個人信息。

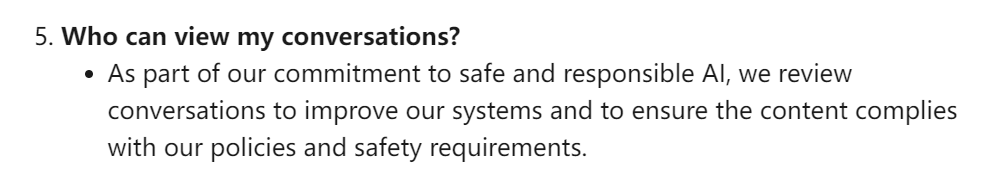

公司的常見問題解答明確指出,它將使用用戶的對話來改進其人工智能語言模型,并且用戶的聊天內容可能會由人工智能培訓師進行審查。

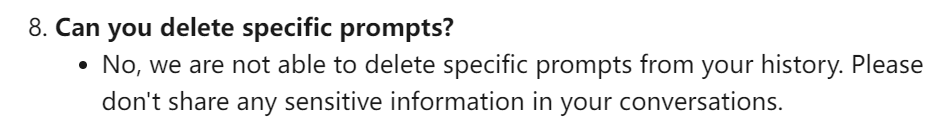

此,OpenAI無法從用戶的歷史記錄中刪除特定提示,因此請勿與ChatGPT共享個人或敏感信息。

2023年3月,韓國媒體報道稱三星剛引入ChatGPT還不到20天,就發生了3 起機密數據泄漏事件,其中涉及三星半導體設備測量資料、產品良率等信息。韓媒認為,一些三星的機密資料已傳給美國,被存入ChatGPT學習數據庫中。

針對此次事件,三星宣布正在制定安全措施,以防止通過ChatGPT進一步泄露信息,如果發生類似事件,可能會考慮禁止ChatGPT進入公司網絡。

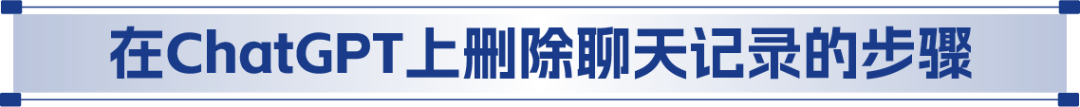

然而,當前ChatGPT提供了一種刪除聊天記錄的方法,用戶可以對其進行設置,以便它一開始就不會保存用戶的歷史記錄。

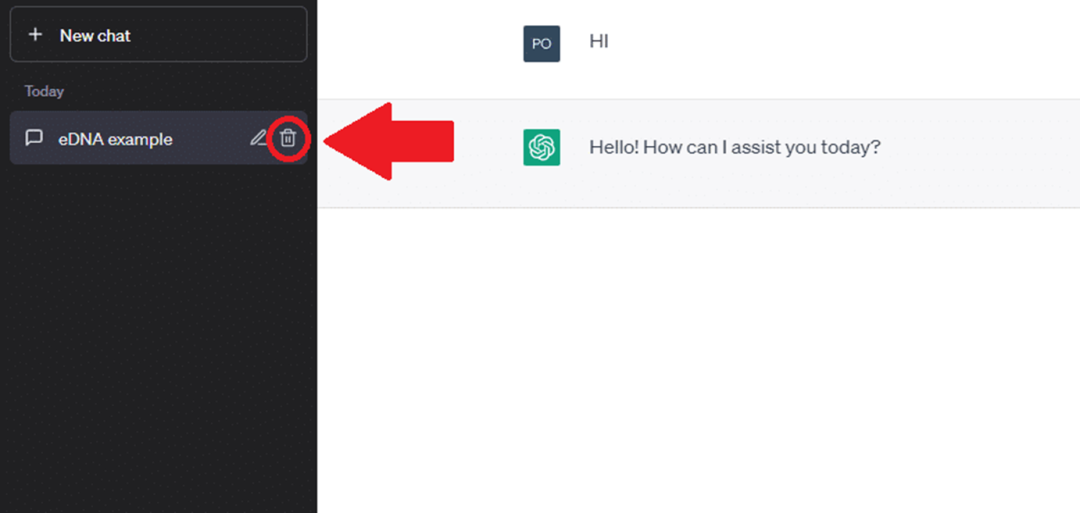

步驟1:從聊天記錄中選擇要刪除的對話,然后單擊垃圾箱圖標將其刪除

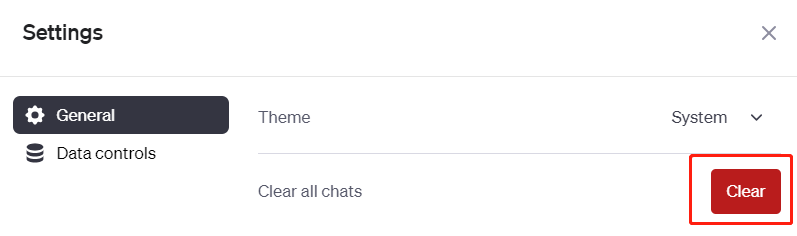

步驟2:要批量刪除對話,請單擊左下角電子郵件地址旁邊的三個點,然后從菜單中選擇“清除對話”

用戶與ChatGPT的聊天記錄不再存在了,用戶將不再看到它們,ChatGPT將在30天內將它們從系統中清除。

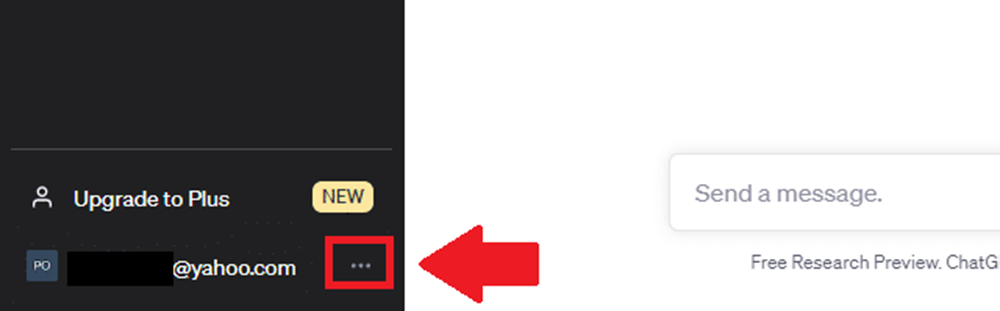

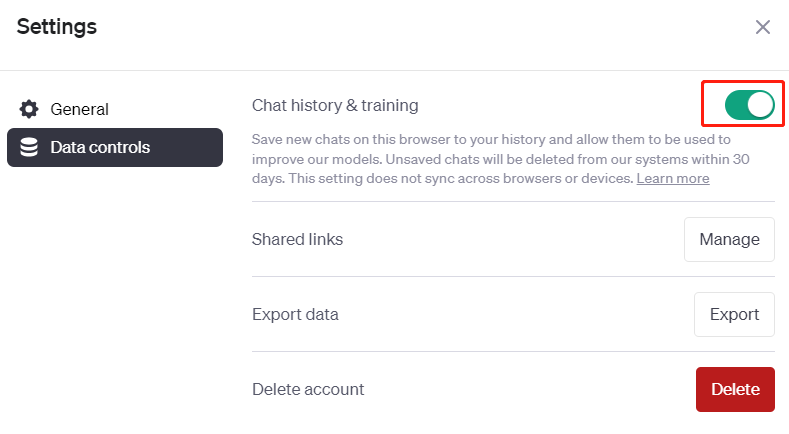

步驟 1. 單擊電子郵件地址旁邊的三個點打開設置菜單

步驟2:在數據控制下,關閉聊天歷史記錄和培訓

取消選中后,ChatGPT將不再將新聞聊天保存到用戶的歷史記錄中,也不會將它們用于模型訓練,未保存的對話將在一個月內從系統中刪除。

在評估經過語言模型訓練的聊天機器人的安全性時,重要的是要考慮企業和個人可能面臨的風險。

一些關鍵的安全問題可能包括數據泄露、未經授權訪問私人信息以及有偏見和不準確的信息。

![]()

使用任何在線服務,包括ChatGPT,數據泄露都是潛在風險。由于用戶無法下載ChatGPT,因此必須通過瀏覽器進行訪問。在這種情況下,如果未經授權的一方獲得對用戶的對話日志、用戶信息或其他敏感數據的訪問權限,則可能會發生數據泄露。

可能會產生幾個后果:

- 隱私泄露:如果發生數據泄露,用戶的私人對話、個人信息或敏感數據可能會暴露給未經授權的個人或實體,從而損害其隱私。

- 身份盜竊:網絡犯罪分子可能會利用暴露的個人信息進行身份盜竊或其他欺詐活動,從而對受影響的用戶造成財務和聲譽損害。

- 數據濫用:在數據泄露中,用戶數據可能會被出售或與惡意方共享,這些惡意方可能會將這些信息用于有針對性的廣告、虛假信息活動或其他惡意目的。

OpenAI似乎很重視網絡安全,并實施了各種安全措施來最大限度地降低數據泄露的風險。

然而,沒有一個系統能夠完全免受漏洞的影響,而現實情況是,大多數漏洞都是由人為錯誤而不是技術故障造成的。

![]()

如果員工或個人將敏感的商業信息(包括密碼或商業秘密)輸入ChatGPT,這些數據就有可能被不良行為者攔截或利用。

為了保護個人及企業,請考慮制定全公司范圍內的生成式人工智能技術使用政策。

幾家大公司已經向員工發出警告。例如,據報道,沃爾瑪和亞馬遜已告訴員工不要與人工智能分享機密信息。此外,摩根大通和Verizon,已徹底禁止使用 ChatGPT。

![]()

使用ChatGPT帶來的另一個風險是可能出現有偏見或不準確的信息。由于訓練的數據范圍廣泛,人工智能模型可能會無意中生成包含虛假信息或反映數據中現有偏差的響應。這可能會給依賴人工智能生成內容進行決策或與客戶溝通的企業帶來問題。因此需要批判性地評估ChatGPT提供的信息,以防止錯誤信息及有偏見的內容傳播。

問:ChatGPT和其他AI系統有法規嗎?

答:目前還沒有直接管理ChatGPT或其他人工智能系統的具體法規。

然而,包括ChatGPT在內的人工智能技術受到現有數據保護和隱私法規的約束。其中一些法規包括:

-?歐盟《一般數據保護條例》(General Data Protection Regulation,GDPR):GDPR是一項全面的數據保護條例,適用于在歐盟(EU)內運營或處理歐盟居民個人數據的組織。它涉及數據保護、隱私以及個人對其個人數據的權利。

-?美國《加州消費者隱私法》(California Consumer Privacy Act,CCPA):CCPA是美國加州的一項數據隱私法規,為消費者提供有關其個人信息的特定權利。它要求企業披露其數據收集和共享做法,并允許消費者選擇不出售其個人信息。

- 其他地區法規:各個國家和地區已經制定了可能適用于ChatGPT等人工智能系統的數據保護和隱私法。例如,新加坡的《個人數據保護法》(Personal Data Protection Act,PDPA)和巴西的《一般個人數據保護法》(Lei Geral de Prote??o de Dados,LGPD)。意大利因隱私問題于2023年3月禁止ChatGPT,但在OpenAI添加新的安全功能后一個月后解除了禁令。

直接針對ChatGPT等人工智能系統的具體法規的缺乏可能很快就會得到改善。2023年4月,歐盟立法者通過了《人工智能法案》草案,該法案要求開發 ChatGPT等生成型人工智能技術的公司披露其開發中使用的受版權保護的內容。擬議的立法將根據人工智能工具的風險級別對其進行分類,范圍從最小到有限、高和不可接受。主要問題包括生物識別監控、錯誤信息的傳播和歧視性語言。雖然高風險工具不會被禁止,但它們的使用需要高度的透明度。如果獲得通過,《人工智能法案》將成為全球首個針對人工智能的綜合性法規。

OpenAI實施了多項安全措施來保護用戶數據并確保AI系統的安全,但用戶在與ChatGPT交互時也應采用某些最佳實踐來最大程度地降低風險。

用戶可以遵循的一些最佳實踐:

- 限制敏感信息:避免在與ChatGPT的對話中共享個人或敏感信息。

- 查看隱私政策:在使用ChatGPT支持的應用程序或任何使用OpenAI語言模型的服務之前,仔細查看平臺的隱私政策和數據處理實踐,以深入了解平臺如何存儲和使用個人的對話。

- 使用匿名或假名帳戶:如果可以的話,在與ChatGPT或使用ChatGPT API的產品交互時使用匿名或假名帳戶。這有助于最大限度地減少對話數據與個人的真實身份的關聯。

- 監控數據保留策略:熟悉個人所使用的平臺或服務的數據保留策略,以了解自己的對話在匿名或刪除之前會存儲多長時間。

- 及時了解情況:及時了解OpenAI安全措施或隱私政策的任何變化,并相應地調整個人的做法,以在使用ChatGPT時保持高水平的安全性。

通過了解OpenAI實施的安全措施并遵循這些最佳實踐,用戶可以在與ChatGPT交互時最大程度地降低潛在風險并享受更安全的體驗。

參考鏈接:

[1]https://economist.co.kr/article/view/ecn202303300057?s=31

[2]https://www.bbc.com/news/technology-65139406

[3]https://www.reuters.com/technology/eu-lawmakers-committee-reaches-deal-artificial-intelligence-act-2023-04-27/

線程傳參詳解,detach()大坑,成員函數做線程函數)

)

)

)

詳解)

)

swagger-ui 測試controller)