代碼來源

unetr

模塊作用

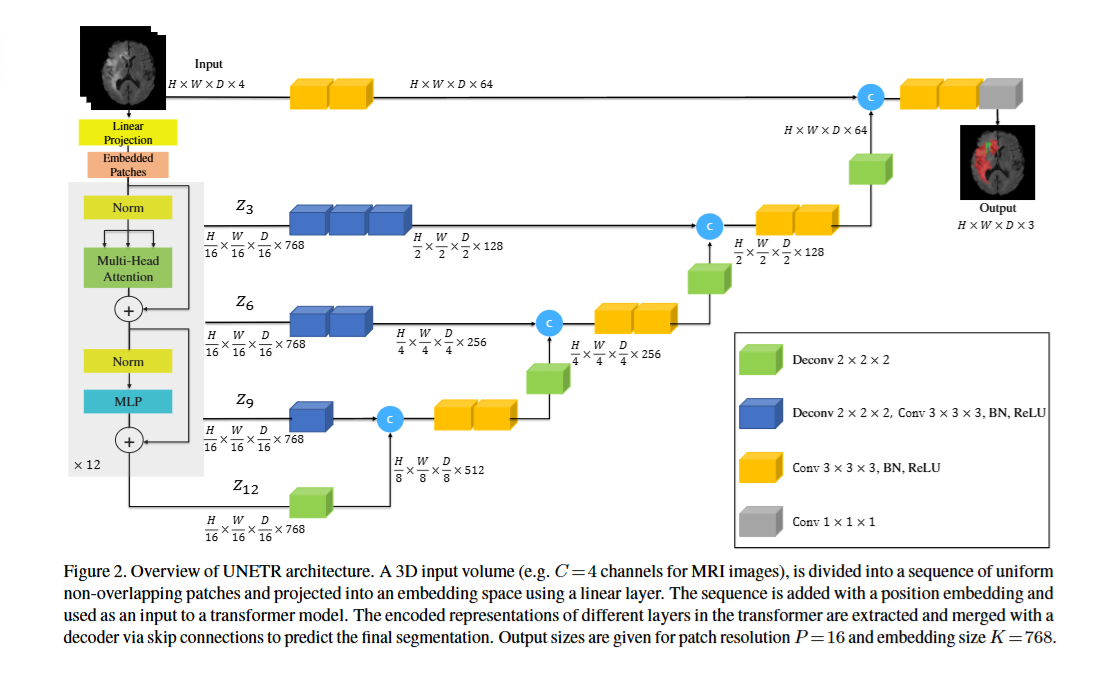

具有收縮和擴展路徑的全卷積神經網絡 (FCNN) 在大多數醫學圖像分割應用中表現出色,但卷積層的局部性限制了其學習長距離空間依賴性的能力。受 Transformer 在自然語言處理 (NLP) 領域近期在長距離序列學習方面取得的成功的啟發,本文引入了一種名為 UNEt Transformers (UNETR) 的全新架構,它利用 Transformer 作為編碼器來學習輸入體的序列表征,并有效捕捉全局多尺度信息。Transformer 編碼器通過不同分辨率的跳躍連接直接連接到解碼器,以計算最終的語義分割輸出。

模塊結構

- Transformer編碼器:

- 將3D圖像轉換為序列,學習長距離依賴和全局多尺度上下文,確保模型捕捉器官/腫瘤的變異形狀和位置。

- CNN解碼器:

- 通過上采樣和跳躍連接恢復空間分辨率,融合全局(編碼器)和局部(低級特征)信息,生成精確分割圖。

總結

本文提出了一種基于Transformer的新型架構,稱為UNETR,用于對體積醫學圖像進行語義分割,并將該任務重新表述為一維序列到序列的預測問題。研究人員提出使用Transformer編碼器來增強模型學習長距離依賴關系的能力,并有效地捕捉多尺度的全局上下文表征。研究人員驗證了UNETR在CT和MRI模式下不同體積分割任務中的有效性。UNETR在BTCV排行榜的標準賽和自由賽中均取得了多器官分割領域的新最高水平,并在MSD數據集上優于腦腫瘤和脾臟分割的競爭方法。總而言之,UNETR展現出了有效學習醫學圖像中關鍵解剖關系的潛力,這個方法可以作為醫學圖像分析中基于Transformer的新型分割模型的基礎。

)

)

Phantom-Data:邁向通用的主體一致性視頻生成數據集)

)