昇思25天學習打卡營第4天

文章目錄

- 昇思25天學習打卡營第4天

- 基于 MindSpore 實現 BERT 對話情緒識別

- 模型簡介

- 環境配置

- 數據集

- 數據加載和數據預處理

- input_ids

- attention_mask

- 模型構建

- 模型驗證

- 模型推理

- 自定義推理數據集

- 打卡記錄

基于 MindSpore 實現 BERT 對話情緒識別

模型簡介

BERT全稱是來自變換器的雙向編碼器表征量(Bidirectional Encoder Representations from Transformers),它是Google于2018年末開發并發布的一種新型語言模型。與BERT模型相似的預訓練語言模型例如問答、命名實體識別、自然語言推理、文本分類等在許多自然語言處理任務中發揮著重要作用。模型是基于Transformer中的Encoder并加上雙向的結構,因此一定要熟練掌握Transformer的Encoder的結構。

BERT模型的主要創新點都在pre-train方法上,即用了Masked Language Model和Next Sentence Prediction兩種方法分別捕捉詞語和句子級別的representation。

在用Masked Language Model方法訓練BERT的時候,隨機把語料庫中15%的單詞做Mask操作。對于這15%的單詞做Mask操作分為三種情況:80%的單詞直接用[Mask]替換、10%的單詞直接替換成另一個新的單詞、10%的單詞保持不變。

因為涉及到Question Answering (QA) 和 Natural Language Inference (NLI)之類的任務,增加了Next Sentence Prediction預訓練任務,目的是讓模型理解兩個句子之間的聯系。與Masked Language Model任務相比,Next Sentence Prediction更簡單些,訓練的輸入是句子A和B,B有一半的幾率是A的下一句,輸入這兩個句子,BERT模型預測B是不是A的下一句。

BERT預訓練之后,會保存它的Embedding table和12層Transformer權重(BERT-BASE)或24層Transformer權重(BERT-LARGE)。使用預訓練好的BERT模型可以對下游任務進行Fine-tuning,比如:文本分類、相似度判斷、閱讀理解等。

對話情緒識別(Emotion Detection,簡稱EmoTect),專注于識別智能對話場景中用戶的情緒,針對智能對話場景中的用戶文本,自動判斷該文本的情緒類別并給出相應的置信度,情緒類型分為積極、消極、中性。 對話情緒識別適用于聊天、客服等多個場景,能夠幫助企業更好地把握對話質量、改善產品的用戶交互體驗,也能分析客服服務質量、降低人工質檢成本。

下面以一個文本情感分類任務為例子來說明BERT模型的整個應用過程。

環境配置

mindnlp的github傳送門

%%capture captured_output

# 實驗環境已經預裝了mindspore==2.2.14,如需更換mindspore版本,可更改下面mindspore的版本號

!pip uninstall mindspore -y

!pip install -i https://pypi.mirrors.ustc.edu.cn/simple mindspore==2.2.14

# 該案例在 mindnlp 0.3.1 版本完成適配,如果發現案例跑不通,可以指定mindnlp版本,執行`!pip install mindnlp==0.3.1`

!pip install mindnlp

import osimport mindspore

from mindspore.dataset import text, GeneratorDataset, transforms

from mindspore import nn, contextfrom mindnlp._legacy.engine import Trainer, Evaluator

from mindnlp._legacy.engine.callbacks import CheckpointCallback, BestModelCallback

from mindnlp._legacy.metrics import Accuracy

# prepare dataset

class SentimentDataset:"""Sentiment Dataset"""def __init__(self, path):self.path = pathself._labels, self._text_a = [], []self._load()def _load(self):with open(self.path, "r", encoding="utf-8") as f:dataset = f.read()lines = dataset.split("\n")for line in lines[1:-1]:label, text_a = line.split("\t")self._labels.append(int(label))self._text_a.append(text_a)def __getitem__(self, index):return self._labels[index], self._text_a[index]def __len__(self):return len(self._labels)

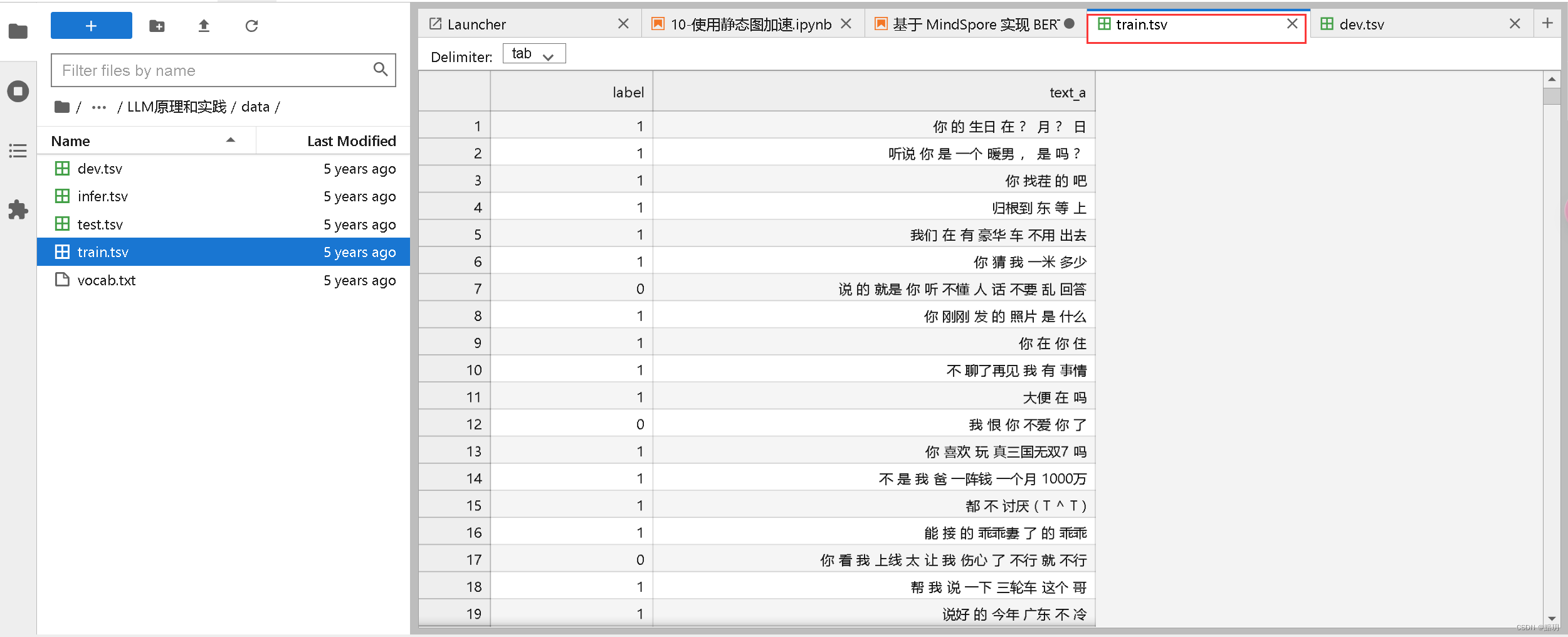

數據集

這里提供一份已標注的、經過分詞預處理的機器人聊天數據集,來自于百度飛槳團隊。數據由兩列組成,以制表符(‘\t’)分隔,第一列是情緒分類的類別(0表示消極;1表示中性;2表示積極),第二列是以空格分詞的中文文本,如下示例,文件為 utf8 編碼。

label–text_a

0–誰罵人了?我從來不罵人,我罵的都不是人,你是人嗎 ?

1–我有事等會兒就回來和你聊

2–我見到你很高興謝謝你幫我

這部分主要包括數據集讀取,數據格式轉換,數據 Tokenize 處理和 pad 操作。

# download dataset

!wget https://baidu-nlp.bj.bcebos.com/emotion_detection-dataset-1.0.0.tar.gz -O emotion_detection.tar.gz

!tar xvf emotion_detection.tar.gz

數據加載和數據預處理

新建 process_dataset 函數用于數據加載和數據預處理,具體內容可見下面代碼注釋。

import numpy as npdef process_dataset(source, tokenizer, max_seq_len=64, batch_size=32, shuffle=True):is_ascend = mindspore.get_context('device_target') == 'Ascend'column_names = ["label", "text_a"]dataset = GeneratorDataset(source, column_names=column_names, shuffle=shuffle)# transformstype_cast_op = transforms.TypeCast(mindspore.int32)def tokenize_and_pad(text):if is_ascend:tokenized = tokenizer(text, padding='max_length', truncation=True, max_length=max_seq_len)else:tokenized = tokenizer(text)return tokenized['input_ids'], tokenized['attention_mask']# map datasetdataset = dataset.map(operations=tokenize_and_pad, input_columns="text_a", output_columns=['input_ids', 'attention_mask'])dataset = dataset.map(operations=[type_cast_op], input_columns="label", output_columns='labels')# batch datasetif is_ascend:dataset = dataset.batch(batch_size)else:dataset = dataset.padded_batch(batch_size, pad_info={'input_ids': (None, tokenizer.pad_token_id),'attention_mask': (None, 0)})return dataset

input_ids

輸入 ID 通常是作為輸入傳遞給模型的唯一必需參數。它們是標記索引,是標記的數值表示,用于構建將用作模型輸入的序列。

每個分詞器的工作方式不同,但底層機制保持不變。下面是一個使用 BERT 分詞器的示例,這是一個 WordPiece 分詞器:

from transformers import BertTokenizer

tokenizer = BertTokenizer.from_pretrained("bert-base-cased")

sequence = "A Titan RTX has 24GB of VRAM"

分詞器負責將序列拆分為分詞器詞匯表中可用的標記。

tokenized_sequence = tokenizer.tokenize(sequence)

print(tokenized_sequence)結果輸出:

['A', 'Titan', 'R', '##T', '##X', 'has', '24', '##GB', 'of', 'V', '##RA', '##M']

然后,可以將這些token轉換為模型可以理解的 ID。這可以通過直接將句子提供給分詞器來完成,分詞器利用 huggingface/tokenizer 的 Rust 實現來實現最佳性能。

encoded_sequence = tokenizer(sequence)["input_ids"]

分詞器返回一個字典,其中包含其相應模型正常工作所需的所有參數。token索引位于鍵“input_ids”下:

print(encoded_sequence)結果輸出:

[101, 138, 18696, 155, 1942, 3190, 1144, 1572, 13745, 1104, 159, 9664, 2107, 102]

請注意,分詞器會自動添加“特殊tokens”(如果關聯的模型依賴于它們),這些tokens是模型有時使用的特殊 ID。如果我們解碼前面的 id 序列,

decoded_sequence = tokenizer.decode(encoded_sequence)

print(decoded_sequence)結果輸出:

[CLS] A Titan RTX has 24GB of VRAM [SEP]

attention_mask

注意掩碼是將序列批處理在一起時使用的可選參數。此參數向模型指示應注意哪些tokens,哪些不應注意。

例如,考慮以下兩個序列:

from transformers import BertTokenizer

tokenizer = BertTokenizer.from_pretrained("bert-base-cased")

sequence_a = "This is a short sequence."

sequence_b = "This is a rather long sequence. It is at least longer than the sequence A."

encoded_sequence_a = tokenizer(sequence_a)["input_ids"]

encoded_sequence_b = tokenizer(sequence_b)["input_ids"]

編碼版本具有不同的長度:

len(encoded_sequence_a), len(encoded_sequence_b)結果輸出:

(8, 19)

因此,我們不能按原樣放在同一個張量中。第一個序列需要填充到第二個序列的長度,或者第二個序列需要被截斷到第一個序列的長度。

在第一種情況下,ID 列表將通過填充索引進行擴展。我們可以將一個列表傳遞給分詞器,并要求它像這樣填充:

padded_sequences = tokenizer([sequence_a, sequence_b], padding=True)

我們可以看到,在第一句話的右邊添加了 0,使其與第二句的長度相同:

padded_sequences["input_ids"]結果輸出:

[[101, 1188, 1110, 170, 1603, 4954, 119, 102, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0], [101, 1188, 1110, 170, 1897, 1263, 4954, 119, 1135, 1110, 1120, 1655, 2039, 1190, 1103, 4954, 138, 119, 102]]

然后,可以在 PyTorch 或 TensorFlow 中將其轉換為張量。注意力掩碼是一個二進制張量,指示填充索引的位置,以便模型不關注它們。對于 BertTokenizer , 1 指示應注意的值,同時 0 指示填充值。此注意力掩碼位于分詞器返回的字典中,鍵為“attention_mask”:

padded_sequences["attention_mask"]

[[1, 1, 1, 1, 1, 1, 1, 1, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0, 0], [1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1, 1]]

昇騰NPU環境下暫不支持動態Shape,數據預處理部分采用靜態Shape處理:

from mindnlp.transformers import BertTokenizer

tokenizer = BertTokenizer.from_pretrained('bert-base-chinese')

tokenizer.pad_token_id

dataset_train = process_dataset(SentimentDataset("data/train.tsv"), tokenizer)

dataset_val = process_dataset(SentimentDataset("data/dev.tsv"), tokenizer)

dataset_test = process_dataset(SentimentDataset("data/test.tsv"), tokenizer, shuffle=False)

print(next(dataset_train.create_tuple_iterator()))結果輸出:

[Tensor(shape=[32, 64], dtype=Int64, value=

[[ 101, 2769, 4263 ... 0, 0, 0],[ 101, 872, 779 ... 0, 0, 0],[ 101, 7733, 4638 ... 0, 0, 0],...[ 101, 680, 872 ... 0, 0, 0],[ 101, 2769, 3300 ... 0, 0, 0],[ 101, 6432, 6413 ... 0, 0, 0]]), Tensor(shape=[32, 64], dtype=Int64, value=

[[1, 1, 1 ... 0, 0, 0],[1, 1, 1 ... 0, 0, 0],[1, 1, 1 ... 0, 0, 0],...[1, 1, 1 ... 0, 0, 0],[1, 1, 1 ... 0, 0, 0],[1, 1, 1 ... 0, 0, 0]]), Tensor(shape=[32], dtype=Int32, value= [2, 1, 0, 1, 1, 1, 1, 1, 0, 0, 1, 1, 0, 2, 1, 1, 1, 1, 1, 1, 1, 0, 1, 1, 0, 1, 1, 0, 1, 2, 1, 0])]

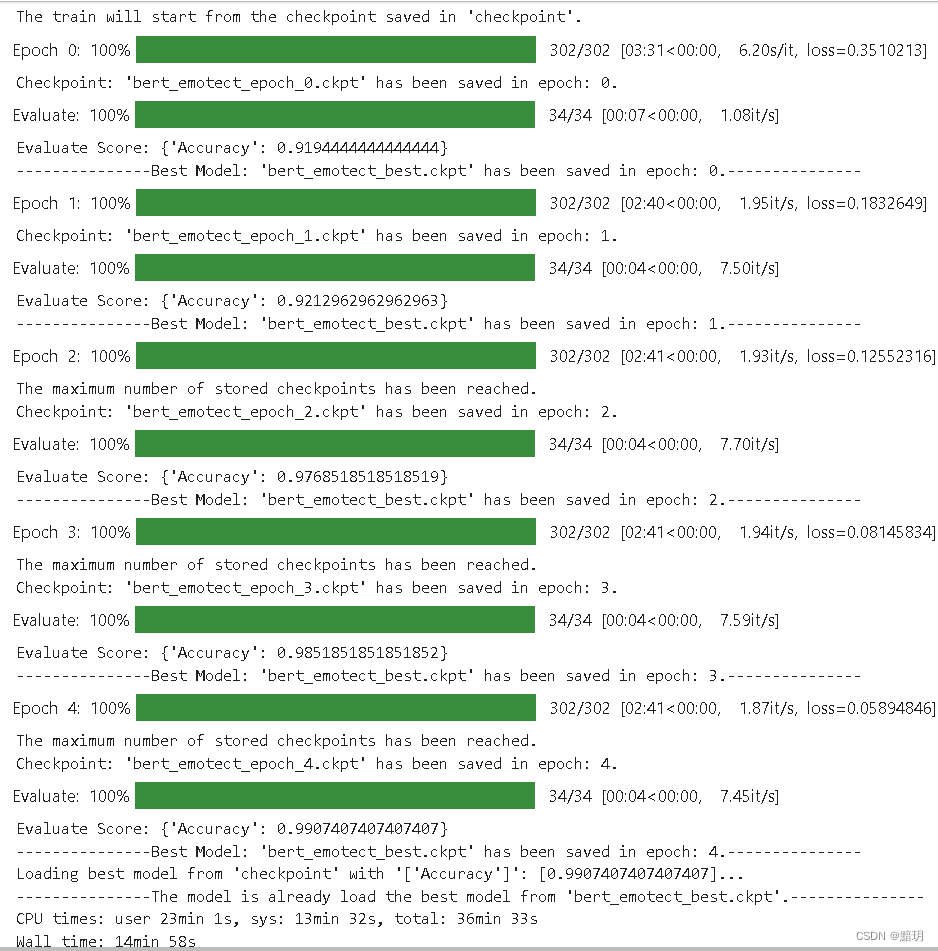

模型構建

通過 BertForSequenceClassification 構建用于情感分類的 BERT 模型,加載預訓練權重,設置情感三分類的超參數自動構建模型。后面對模型采用自動混合精度操作,提高訓練的速度,然后實例化優化器,緊接著實例化評價指標,設置模型訓練的權重保存策略,最后就是構建訓練器,模型開始訓練。

auto_mixed_precision傳送門

BertForSequenceClassification傳送門

from mindnlp.transformers import BertForSequenceClassification, BertModel

from mindnlp._legacy.amp import auto_mixed_precision# set bert config and define parameters for training

model = BertForSequenceClassification.from_pretrained('bert-base-chinese', num_labels=3)

model = auto_mixed_precision(model, 'O1')optimizer = nn.Adam(model.trainable_params(), learning_rate=2e-5)

metric = Accuracy()

# define callbacks to save checkpoints

ckpoint_cb = CheckpointCallback(save_path='checkpoint', ckpt_name='bert_emotect', epochs=1, keep_checkpoint_max=2)

best_model_cb = BestModelCallback(save_path='checkpoint', ckpt_name='bert_emotect_best', auto_load=True)trainer = Trainer(network=model, train_dataset=dataset_train,eval_dataset=dataset_val, metrics=metric,epochs=5, optimizer=optimizer, callbacks=[ckpoint_cb, best_model_cb])

%%time

# start training

trainer.run(tgt_columns="labels")

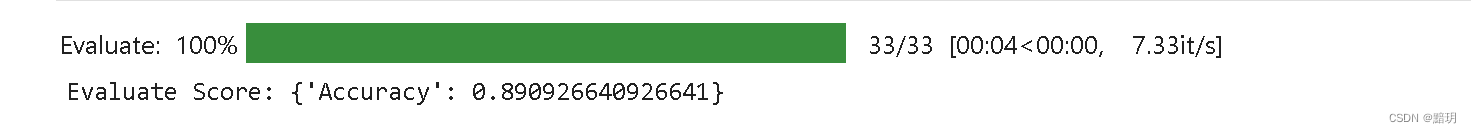

模型驗證

將驗證數據集加再進訓練好的模型,對數據集進行驗證,查看模型在驗證數據上面的效果,此處的評價指標為準確率。

evaluator = Evaluator(network=model, eval_dataset=dataset_test, metrics=metric)

evaluator.run(tgt_columns="labels")

模型推理

遍歷推理數據集,將結果與標簽進行統一展示。

dataset_infer = SentimentDataset("data/infer.tsv")

def predict(text, label=None):label_map = {0: "消極", 1: "中性", 2: "積極"}text_tokenized = Tensor([tokenizer(text).input_ids])logits = model(text_tokenized)predict_label = logits[0].asnumpy().argmax()info = f"inputs: '{text}', predict: '{label_map[predict_label]}'"if label is not None:info += f" , label: '{label_map[label]}'"print(info)

from mindspore import Tensorfor label, text in dataset_infer:predict(text, label)結果輸出:

inputs: '我 要 客觀', predict: '中性' , label: '中性'

inputs: '靠 你 真是 說 廢話 嗎', predict: '消極' , label: '消極'

inputs: '口嗅 會', predict: '中性' , label: '中性'

inputs: '每次 是 表妹 帶 窩 飛 因為 窩路癡', predict: '中性' , label: '中性'

inputs: '別說 廢話 我 問 你 個 問題', predict: '消極' , label: '消極'

inputs: '4967 是 新加坡 那 家 銀行', predict: '中性' , label: '中性'

inputs: '是 我 喜歡 兔子', predict: '積極' , label: '積極'

inputs: '你 寫 過 黃山 奇石 嗎', predict: '中性' , label: '中性'

inputs: '一個一個 慢慢來', predict: '中性' , label: '中性'

inputs: '我 玩 過 這個 一點 都 不 好玩', predict: '消極' , label: '消極'

inputs: '網上 開發 女孩 的 QQ', predict: '中性' , label: '中性'

inputs: '背 你 猜 對 了', predict: '中性' , label: '中性'

inputs: '我 討厭 你 , 哼哼 哼 。 。', predict: '消極' , label: '消極'

自定義推理數據集

自己輸入推理數據,展示模型的泛化能力。

predict("你怎么老是這樣,讓我很難受")結果輸出:

inputs: '你怎么老是這樣,讓我很難受', predict: '消極'

打卡記錄

用法詳解)