一、ID3 決策樹

1. 核心思想

使用信息增益(Information Gain)作為特征選擇的標準,遞歸地構建決策樹。

2. 特征選擇標準

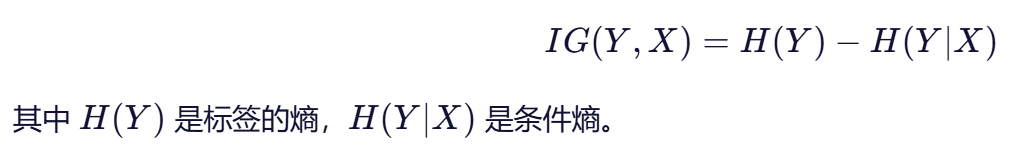

信息增益(IG):

????????? ?

選擇使信息增益最大的特征進行劃分。

3. 優點

- 算法簡單,易于理解。

- 能夠生成可解釋性強的規則。

4. 缺點

- 只能處理離散(分類)特征,不能直接處理連續特征。

- 偏向于選擇取值較多的特征(因為信息增益會偏高)。

5. 適用任務

僅支持分類任務。

二、C4.5 決策樹

1. 核心思想

在 ID3 基礎上改進,使用信息增益率(Gain Ratio)來克服信息增益的偏向性。

2. 特征選擇標準

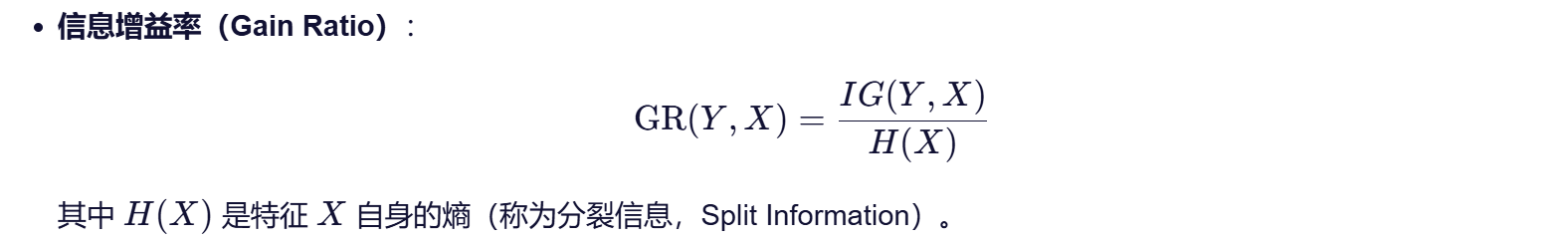

信息增益率(Gain Ratio):

???????????????????????? ? ??

使用增益率可以懲罰取值較多的特征,減少偏向。

3. 改進點(相比 ID3)

- ? 支持連續特征:通過二分法尋找最佳分割點。

- ? 支持缺失值處理:使用概率分布分配樣本。

- ? 引入剪枝(后剪枝):提高泛化能力。

- ? 支持不同代價的誤分類(代價敏感學習)。

4. 優點

- 適用于真實世界復雜數據。

5. 缺點

- 對噪聲敏感。

- 可能產生較多小分支。

7. 適用任務

僅支持分類任務。

三、CART 決策樹

1. 核心思想

使用基尼指數(分類)或平方誤差(回歸)作為劃分標準,構建二叉樹結構。

2. 特征選擇標準

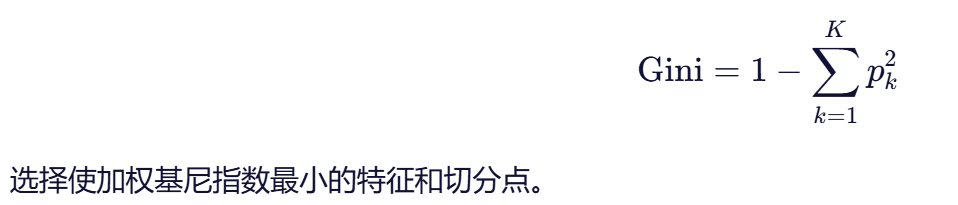

分類任務:使用基尼指數(Gini Impurity)

回歸任務:使用最小平方誤差(MSE),選擇使子集方差最小的劃分。

3. 樹的結構

- 必須是二叉樹:每個節點只分裂為兩個子節點。

- 對離散特征:相當于進行“是/否”判斷。

- 對連續特征:尋找最優分割閾值。

4. 優點

- 支持分類和回歸兩種任務。

- 輸出結果穩定,易于實現。

- 支持剪枝,防止過擬合。

5. 缺點

- 二叉樹可能導致樹較深。

- 對數據變化敏感(小變化可能導致樹結構大變)。

6. 適用任務

? 支持分類和回歸任務。

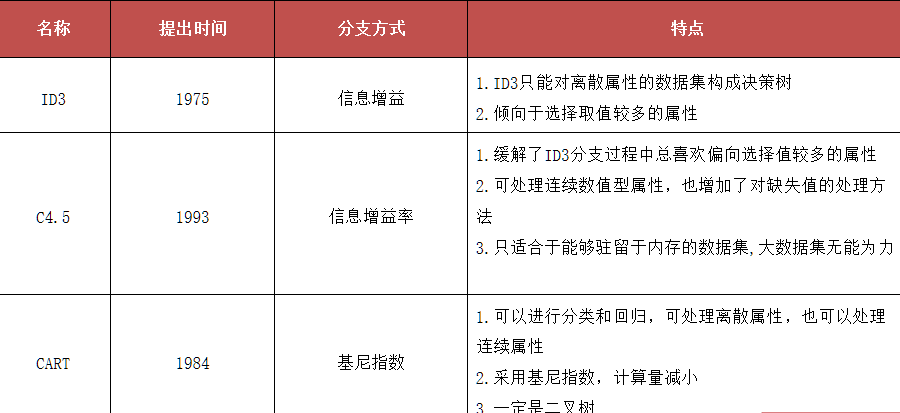

四、對比

五、小結

信息增益(ID3)、信息增益率值越大(C4.5),則說明優先選擇該特征。

基尼指數值越小(cart),則說明優先選擇該特征。

![[光學原理與應用-431]:非線性光學 - 能生成或改變激光波長的物質或元件有哪些?](http://pic.xiahunao.cn/[光學原理與應用-431]:非線性光學 - 能生成或改變激光波長的物質或元件有哪些?)

)

——多肽+蛋白質一級結構)