為什么要關注AI代理?

“Agentic AI”(智能代理)正在悄然改變我們的工作方式。想象一下,一個AI助手不僅能幫你查航班、訂機票,還能自動安排行程、發郵件、生成日報——就像一個效率極高的“虛擬助理”團隊。

對于測試工程師來說,AI代理不只是未來的趨勢,更是提升自動化、加速測試流程的新利器。比如自動生成測試用例、智能爬取網頁、自動填報測試結果等。

但搭建這樣的系統并不容易:你要處理流程控制、數據記憶、外部工具調用、任務分發等一堆“雜事”。好消息是,Python社區已經有不少現成的庫和框架,幫你快速上手,把精力集中在業務邏輯和創新上。

核心框架:智能AI代理的“發動機”

1. LangChain —— 萬能積木,輕松搭建

LangChain就像一盒“樂高積木”,你可以隨意組合各種AI能力:

- 模塊化設計:對話、數據庫、外部API等功能模塊隨意拼裝。

- 記憶管理:讓AI記住歷史對話,支持上下文聯想。

- 工具集成:比如快速接入天氣API、數據庫、甚至自動化測試平臺。

上手建議:先做一個能回答測試相關問題的聊天機器人,體驗AI的“記憶”功能和外部工具調用。

2. AutoGen —— 多代理協作,分工更高效

AutoGen適合模擬“團隊協作”場景:

- 多角色分工:比如一個代理寫代碼,另一個做代碼審查,還有一個自動補充文檔。

- 動態任務流:代理之間可自動傳遞信息、反饋結果。

- 可視化調試:方便你查看各代理的對話和決策過程。

實戰案例:可以搭建一個自動化測試團隊,AI一邊分析需求,一邊自動生成和執行測試代碼。

3. CrewAI —— 輕量級團隊,配置超簡單

CrewAI適合需要明確分工、流程清晰的小型“AI團隊”:

- 角色定義:比如“需求分析員”、“用例生成器”、“報告撰寫員”。

- 事件驅動:需要哪個角色時,自動上線工作。

- 極簡配置:幾行代碼就能跑起來。

入門思路:用CrewAI讓AI幫你自動收集bug、分析日志、輸出測試報告。

支持庫:讓AI代理更“聰明”的秘密武器

LLM模型集成

- Hugging Face Transformers:數千種預訓練大模型,開箱即用。

- OpenAI API:直接用GPT系列模型對話。

- Google AI SDK:調用Gemini等大模型處理復雜任務。

數據管理

- LlamaIndex:把企業內網文檔、測試報告變成可檢索的知識庫。

- Chroma/FAISS:高效存儲和檢索“向量”數據,做智能搜索。

- Redis:用來保存AI代理的狀態和緩存結果,速度飛快。

工具擴展

- Selenium:讓AI自動打開網頁、填寫表單,做端到端自動化測試。

- PyAutoGUI:模擬鼠標鍵盤,自動操作桌面應用。

部署方案

- FastAPI:快速搭建AI服務接口,方便和測試平臺對接。

- Streamlit:做交互式儀表盤,展示AI測試結果。

- LangFlow:拖拽式可視化,零代碼搭建AI流程。

如何選擇適合你的第一個庫?

| 應用場景 | 推薦框架 | 說明 |

|---|---|---|

| 聊天機器人/單一任務 | LangChain | 適合入門和基礎自動化 |

| 多角色協作 | AutoGen | 復雜流程和團隊分工 |

| 快速模擬團隊流程 | CrewAI | 小團隊任務分配、快速原型開發 |

| 知識庫問答 | LlamaIndex + Chroma | 文檔搜索、智能問答 |

| 網頁自動化 | Selenium | 自動操作網頁、表單填報 |

測試工程師的AI成長路線圖

- 基礎:用LangChain做一個能查詢bug狀態的聊天機器人,體驗AI記憶與API集成。

- 進階:用AutoGen模擬一個“自動化測試小組”,讓AI協作完成代碼生成、用例審查等工作。

- 專業:結合CrewAI和LlamaIndex,打造智能知識庫問答系統,支持自動檢索測試用例和歷史缺陷。

- 專家:自定義開發,靈活組合多個庫,實現更復雜的自動化測試和團隊協作。

未來趨勢

- 模塊化更強:各庫之間互通更方便,拼裝能力更高。

- 企業級落地:越來越多生產級的AI自動化方案出現。

- 低代碼平臺崛起:拖拽式可視化工具,讓非開發同事也能參與AI系統搭建。

簡單示例

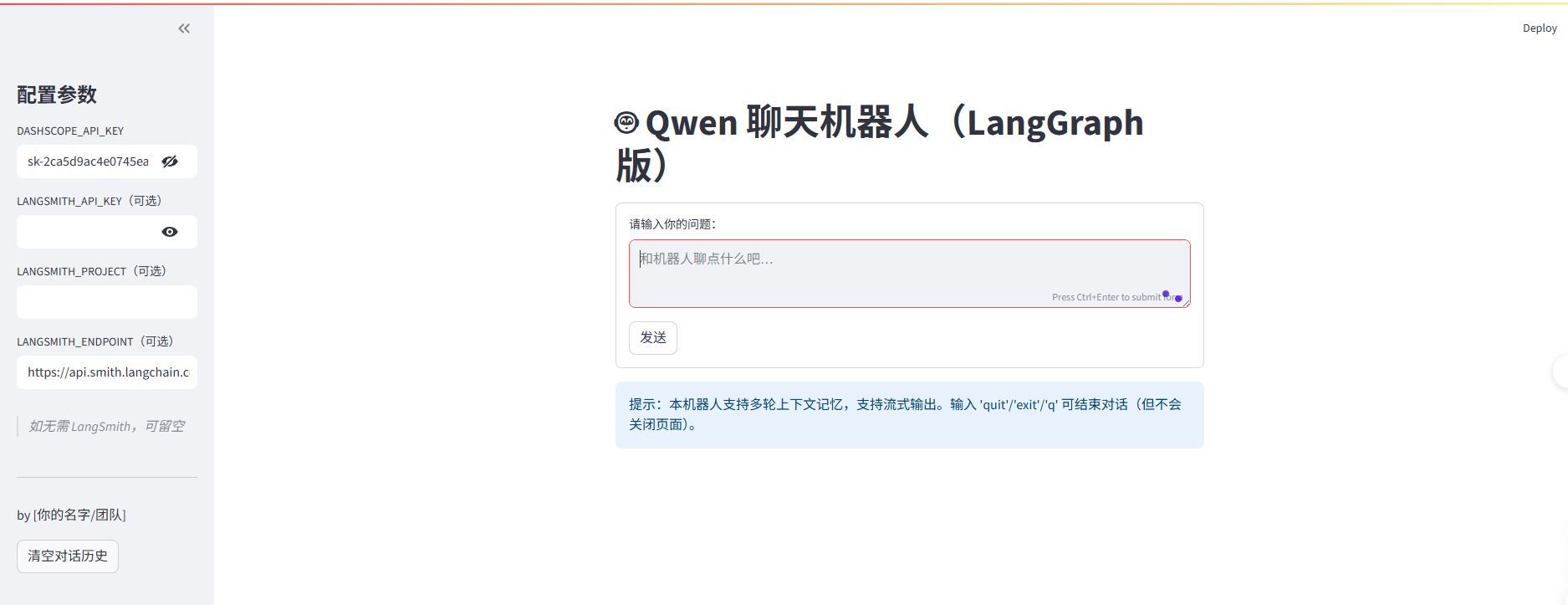

使用streamlit編寫一個簡易版chatbot,使用通義大模型,源碼如下:

import streamlit as st

import os

from typing import Annotated

from typing_extensions import TypedDict

from langgraph.graph import StateGraph, START, END

from langgraph.graph.message import add_messages

from langchain_community.llms import Tongyi# ---- 環境變量輸入區(可根據需求修改為硬編碼) ----

st.set_page_config(page_title="Qwen 聊天機器人", page_icon="🤖", layout="centered")with st.sidebar:st.title("配置參數")dashscope_api_key = st.text_input("DASHSCOPE_API_KEY", type="password", value=os.environ.get("DASHSCOPE_API_KEY", ""))langsmith_api_key = st.text_input("LANGSMITH_API_KEY(可選)", type="password", value=os.environ.get("LANGSMITH_API_KEY", ""))langsmith_project = st.text_input("LANGSMITH_PROJECT(可選)", value=os.environ.get("LANGSMITH_PROJECT", ""))langsmith_endpoint = st.text_input("LANGSMITH_ENDPOINT(可選)", value=os.environ.get("LANGSMITH_ENDPOINT", "https://api.smith.langchain.com"))st.markdown("> *如無需 LangSmith,可留空*")st.markdown("---")st.markdown("by [你的名字/團隊]")# 設置環境變量

if dashscope_api_key:os.environ["DASHSCOPE_API_KEY"] = dashscope_api_key

if langsmith_api_key:os.environ["LANGSMITH_API_KEY"] = langsmith_api_keyos.environ["LANGSMITH_TRACING"] = "true"

if langsmith_project:os.environ["LANGSMITH_PROJECT"] = langsmith_project

if langsmith_endpoint:os.environ["LANGSMITH_ENDPOINT"] = langsmith_endpoint# ---- 對話狀態定義 ----

class State(TypedDict):messages: Annotated[list, add_messages]# ---- 狀態機組裝 ----

@st.cache_resource(show_spinner="正在加載 Qwen 模型…")

def get_graph():graph_builder = StateGraph(State)llm = Tongyi(model="qwen-max",streaming=True,temperature=0.7,top_p=0.8,api_key=os.environ.get("DASHSCOPE_API_KEY"))def chatbot(state: State):return {"messages": [llm.invoke(state["messages"])]}graph_builder.add_node("chatbot", chatbot)graph_builder.add_edge(START, "chatbot")graph_builder.add_edge("chatbot", END)return graph_builder.compile()graph = get_graph()# ---- Streamlit 聊天 session 狀態維護 ----

if "history" not in st.session_state:st.session_state.history = []st.title("🤖 Qwen 聊天機器人(LangGraph 版)")with st.form(key="chat-form", clear_on_submit=True):user_input = st.text_area("請輸入你的問題:", value="", placeholder="和機器人聊點什么吧…", height=80)submitted = st.form_submit_button("發送")def stream_graph_updates(user_input: str, history: list):yield from graph.stream({"messages": history + [{"role": "user", "content": user_input}]})# 聊天歷史展示

for msg in st.session_state.history:if msg["role"] == "user":st.chat_message("user").write(msg["content"])else:st.chat_message("assistant").write(msg["content"])# 新問題處理

if submitted and user_input.strip():st.session_state.history.append({"role": "user", "content": user_input})response_placeholder = st.empty()full_response = ""# 流式顯示with st.spinner("Assistant 正在思考..."):for event in stream_graph_updates(user_input, st.session_state.history[:-1]):for value in event.values():resp = value["messages"][-1]# 僅展示assistant內容# if resp["role"] == "assistant":# full_response = respresponse_placeholder.chat_message("assistant").write(resp)# 更新歷史if full_response:st.session_state.history.append({"role": "assistant", "content": full_response})# 清空歷史按鈕

st.sidebar.button("清空對話歷史", on_click=lambda: st.session_state.pop("history", None))st.info("提示:本機器人支持多輪上下文記憶,支持流式輸出。輸入 'quit'/'exit'/'q' 可結束對話(但不會關閉頁面)。")

運行效果:

配置了DASHSCOPE_API_KEY后效果如下:

結語

這些Python庫為AI代理搭建提供了強大的底層能力,讓測試工程師把更多時間花在創新與優化上,而不是重復造輪子。建議你從LangChain入手,邊學邊用,親手做幾個小項目,比如自動查詢天氣并推薦穿衣。實踐中你會發現,AI代理就像樂高積木,拼出無限可能!

動手試試:用LangChain做個“小助手”,能自動查天氣并給出穿衣建議。你會學會AI如何記住歷史對話、調用外部API,邁出智能自動化的第一步!

,解決error: Arithmetic Underflow in createSubscription)

)