基礎智能體的進展與挑戰綜述

從類腦智能到具備可進化性、協作性和安全性的系統

【翻譯團隊】劉軍(liujun@bupt.edu.cn) 錢雨欣玥 馮梓哲 李正博 李冠諭 朱宇晗 張霄天 孫大壯 黃若溪

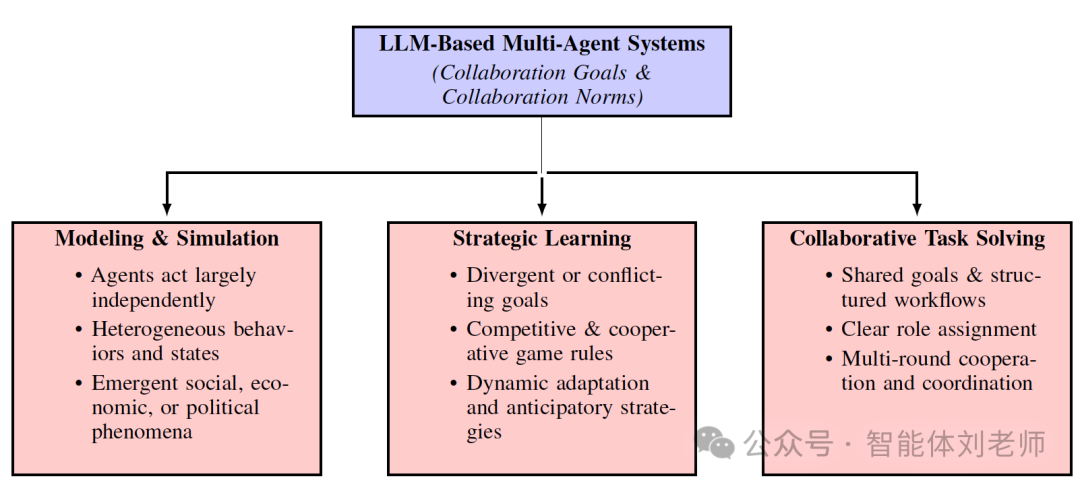

在基于大語言模型的多智能體系統(LLM-MAS)中,合作目標和合作規范作為基礎性元素,決定了系統的行為、交互模式和整體效果。合作目標明確規定了智能體旨在實現的具體目標——無論是單獨的、集體的還是競爭性的;而合作規范則定義了規范智能體在系統內交互的規則、約束和慣例。共同作用下,這些組件構建了一個強有力的框架,指導智能體之間的有效溝通、協調和合作。

本節根據合作目標和規范的不同組合,將LLM-MAS分為三大類:戰略學習、建模與仿真、以及協同任務解決。盡管這些類別并不詳盡,但它們涵蓋了廣泛的LLM-MAS設計,并清晰地反映了系統目標如何塑造智能體的交互和結果。

-

戰略學習系統將智能體嵌入博弈論背景中,智能體追求個人或部分沖突的目標。其交互可以是合作的、競爭的或混合的,并通過預定義的博弈規則和交互規范進行明確指導。這種設置通常與傳統博弈論中的非合作(戰略性)和合作概念相一致。有關詳細信息,請參見第13.1節。

-

建模與仿真環境側重于智能體根據多種環境或社會因素獨立行動。在這種背景下,智能體之間的交互自發產生,但不一定會朝著共同目標收斂,反映了大規模社會或經濟仿真中所見的復雜動態。有關詳細信息,請參見第13.2節。

-

協同任務解決強調智能體之間的系統化合作,以實現明確共享的目標。智能體通常采用結構化的工作流程、明確的角色定義以及高度預定義的合作規范,以協調行動,共同朝著集體目標邁進。有關詳細信息,請參見第13.3節。

在本章的剩余部分,我們將詳細討論每個類別,探討LLM如何在我們的范圍內促進、影響和增強智能體的行為、互動和集體智能。

接下來,我們將詳細探討這些類別,重點分析每個類別如何利用大語言模型的能力來塑造智能體的行為和互動。

13.1 戰略學習:合作與競爭

戰略學習指的是在博弈論環境中,智能體能夠動態地預判、解讀并影響其他智能體的行為—無論是競爭、合作還是混合型的環境[949]。智能體基于新信息反復調整其策略,通常使用諸如納什均衡[950]、貝葉斯博弈[951, 914, 952]或重復交互[953, 954]等基礎概念進行建模。隨著大語言模型(LLMs)支持更精細的語言推理,戰略學習越來越多地融入了“軟”信號——包括對話、勸說和隱性談判——從而豐富了傳統的博弈論推理框架[952, 955, 956, 957]。

圖13.1:基于LLM的多智能體系統三種主要協作類型,每種類型通過智能體協作目標和準則如何設定(獨立、發散或共享)以及智能體間如何合作

在經濟應用中,多智能體戰略模擬為市場行為和談判策略提供了寶貴的見解,突出了競爭與合作的動態。例如,[958]和[951]展示了如何通過大語言模型(LLM)賦能的智能體模擬招聘過程,在控制的經濟實驗中展現理性決策行為,甚至預測股市走勢。[959]引入了基于GPT-4的競爭環境,展示了餐廳和顧客智能體如何競爭以優化利潤和滿意度,呈現現實的競標和定價策略。同時,[960]研究了基于LLM的買賣雙方討價還價,[961]則使用最終通牒博弈模擬,闡明了基于人類戰略行為的政策決策過程。

超越傳統市場,戰略學習廣泛應用于資源分配、聯盟或競爭合作權衡的場景。例如,在多商品競爭中[962, 959],智能體通過戰略性談判條款來最大化個人利益,或在關注可持續性的情境中,智能體協調資源消費[963]。在游戲中,社交推理游戲,如狼人殺、變色龍、阿瓦隆和劇本殺,要求智能體管理欺騙與合作之間的復雜互動[964, 965, 966, 153, 919, 967, 968, 969, 970]。[971, 965]的研究突出了能夠巧妙協調欺騙與合作的LLM驅動智能體,而[967, 972, 968, 969]強調了在阿瓦隆中適應性、多輪策略的應用。[970]更進一步,展示了在劇本殺謀殺懸疑類型中,LLM驅動的多智能體互動,重現復雜的敘事。同樣,外交模擬([973]和[974])使用LLM驅動的智能體來模擬全球規模上復雜的地緣政治談判和聯盟形成動態。

總結:LLM驅動的戰略學習的一個關鍵優勢在于能夠有效地將嚴格的博弈論邏輯與自然語言推理相結合。這種融合使得智能體能夠解讀復雜的指令、進行有說服力的對話,并更靈活地適應新穎或非結構化的環境。因此,基于LLM的戰略智能體在準確建模復雜的現實世界互動(涵蓋經濟競爭、社會談判和地緣政治策略)方面,比傳統的基于規則或僅使用數字的方法具有更大的潛力。

13.2模擬現實世界動態

建模和仿真是基于大語言模型(LLM)的多智能體系統(LLM MAS)另一個重要的應用領域,旨在大規模地復制復雜的社會、經濟和政治現象。通過利用大語言模型在語言理解和上下文推理方面的高級能力,這些仿真可以展示具有高度異質性的智能體,其演化行為反映了現實世界的動態性。與強調明確競爭或合作目標的戰略學習環境不同,建模和仿真場景中的智能體獨立運作,受到其領域特定角色、偏好和與仿真環境互動的引導【975】。

例如,在醫療保健領域,[921]引入了“Agent Hospital”,其中由大語言模型驅動的醫生智能體通過與虛擬患者的真實互動,迭代優化治療策略。這使得研究人員能夠在受控且逼真的環境中測試管理協議、培訓范式和“假設情景”。類似地,在經濟學領域,[976]提出了 EconAgents,利用大語言模型驅動的智能體來真實地模擬個體行為,如就業決策、消費模式和經濟模擬,超越了傳統的數字化或嚴格規則驅動的方法,在適應性和現實性方面表現更佳【977】。此外,政治科學應用也從這種方法中受益。例如,[978]和[977]成功模擬了選舉過程和政策制定動態,揭示了公共話語、候選人策略和選民互動如何塑造現實世界的政治結果。

除了經濟學和政治學,大語言模型驅動的仿真還適用于各種社會和文化現象。例如,[979]和[255]通過模擬社交網絡中的語言和情感傳播,研究了在線上如何形成意見、信仰或情感集群。[980]的研究探討了在不同拓撲結構和互動模式下,意見動態如何演變,而[981]則研究了在異質智能體群體中,假新聞如何傳播或停滯的條件。大型仿真平臺,如 GenSim[982]和 OASIS[936],通過將用戶智能體的規模擴展到數萬甚至數百萬,進一步推動了這一領域的發展,從而能夠在現實約束下研究群體行為和系統效應的涌現——例如病毒信息傳播、回音室效應或群體極化等現象。

總結:基于大語言模型的仿真優勢在于能夠捕捉現實世界行為背后的結構動態(如網絡拓撲或制度規則)以及驅動這些行為的認知或語言細節。通過將基于語言的推理嵌入到智能體模型中,研究人員可以研究復雜的社會過程——如勸說、框架塑造或文化傳播——這些過程通過純數字化或規則驅動的方法很難捕捉到。

13.3 協作任務解決與工作流生成

協作任務解決通過結構化的工作流將多個智能體協調到一個明確定義的目標上。與戰略學習(可能涉及競爭利益)或開放式建模與仿真(智能體獨立行動)不同,協作智能體作為統一問題解決流程的一部分運作。智能體通常遵循明確定義的角色(例如,“規劃者”、“執行者”或“評估者”)以及基于階段的過程,以確保任務的高效和準確完成。

像 MetaGPT[626]、CAMEL[848]、Communicative Agents[983]以及[924]中描述的框架,展示了如何通過明確定義的角色、責任和決策流程,使基于大語言模型的智能體能夠有效協調。一個典型的工作流可能涉及一個智能體分析問題陳述,另一個提出解決方案概述,第三個實施部分解決方案,第四個驗證正確性。這些智能體之間的通信通常通過自然語言“對話”的迭代回合進行,利用大語言模型在語言生成方面的固有優勢。這種結構化的方法在擴展到更復雜的項目時也表現出了優勢,因為子任務可以委派給具有領域特定提示或訓練的專門智能體。

最近,協作任務解決系統在軟件開發場景中得到了廣泛的探索(例如,多智能體編碼、調試和測試)。然而,科學發現代表了一個特別突出且引人注目的應用。例如,Agent Laboratory[746]在結構化的科學工作流中使用智能體:提出假設、設計實驗、分析結果,并優化后續的調查,這有效地反映了科學研究的迭代性質。類似的多智能體設計可以應用于文獻綜述、政策草擬或大規模數據分析等任務,使用明確定義的協議來保持一致性并避免重復工作。

總結:與其他基于大語言模型的多智能體范式相比,協作任務解決本質上優先考慮清晰性和可預測性:每個智能體的角色和目標都是預定義的,從而限制了涌現或混亂行為。這種結構在需要精確性、責任感或順序決策的領域特別有優勢。同時,研究仍在進行,以在結構和靈活性之間找到合適的平衡,確保智能體既能擁有足夠的自主性來創造性地提供解決方案,又能遵循共享的工作流,最終保證任務的可靠且高質量的完成。

討論:上述三個維度——戰略學習、建模與仿真、以及協作任務解決——反映了基于大語言模型的多智能體系統的廣泛應用。每個類別都解決了不同的研究問題和現實世界應用,通過語言驅動的推理,克服了傳統的、純數字化或規則驅動的智能體設計所無法應對的挑戰。

13.4 組建AI智能體團隊

在多智能體系統(MAS)中,智能體是系統內進行互動的核心單元,對于系統的功能至關重要。根據智能體是否具有相同或不同的個性、能力和行動空間,這些智能體可以分為同質智能體或異質智能體。

-

同質智能體

同質智能體共享相同的能力、行動空間和觀察空間。與單一智能體系統相比,同質智能體的主要優勢在于任務的并行化,使得多個智能體能夠同時處理任務的不同部分,從而提高整體效率。它們通常用于較簡單的協調任務,在這些任務中,智能體之間的統一性能夠推動性能的提升。

一些研究將同質智能體應用于模擬游戲中的團隊合作,如《Overcooked》和《Minecraft》,以及現實世界中的任務,如家庭勞動分工。[924]提出了一個基于認知啟發的模塊化框架,使得基于大語言模型的智能體能夠通過自然語言進行溝通,執行勞動分工、相互請求幫助,并協作完成物品運輸任務。[984]將基于提示的組織結構引入該框架,減少了智能體之間的通信成本,并提高了在家庭任務中的團隊效率,如準備下午茶、洗碗和做飯。此外,一些研究[926, 925]在流行游戲如《Overcooked》和《Minecraft》中使用了多個基于大語言模型的智能體,實驗它們的合作能力和完成任務的效果。根據游戲設置,這些智能體也是同質的

-

異質智能體

智能體的多樣性在提高協作結果方面起著至關重要的作用。研究表明,智能體之間的異質性能夠增強問題解決能力,因為不同的智能體為任務帶來了多樣的視角和技能【985, 986】。異質性有助于提供更豐富的問題解決策略,并改善多智能體系統中的整體協作。智能體的異質性可以體現在以下幾個維度:個性層次異質性、觀察空間異質性和行動空間異質性。需要注意的是,這些異質性并不是互相排斥的——一個異質智能體可能表現出一個或多個這樣的特征。

-

個性層次異質性:指的是智能體個人檔案的多樣性,這會影響智能體如何解決問題以及它們如何相互互動。目前大多數基于大語言模型的異質多智能體系統都屬于這一類別【987, 627, 50, 970】。例如,在軟件開發中,智能體可能扮演程序員、產品經理或測試人員等角色。在醫療診斷中,智能體可能代表心臟病專家、腫瘤學家或兒科醫生,每個角色都有不同的專業領域。每個個性的獨特視角和專業知識有助于更強有力的決策。雖然這些異質智能體可能共享相同的行動空間——例如編寫文檔【626】(如代碼、需求報告或測試報告)或提供診斷建議【922】——但它們的個性會影響這些行動的結果,其中多智能體架構中的角色特定增強已被證明能夠顯著簡化和優化任務執行。例如,一個產品經理在執行寫文檔這一任務時,會產生需求報告,而一個程序員執行相同任務時,則會產生軟件實現代碼【626】。這種多樣性促進了更好的決策制定和創新,尤其是在復雜的多學科任務中。

-

觀察空間異質性:在多智能體系統中,智能體感知和解讀環境的能力可能存在差異。觀察空間異質性指的是智能體在其環境中能夠觀察或感知的內容的不同。例如,在游戲《狼人殺》中,一些智能體,如狼人,能夠看到隊友的身份,而先知可以獲得指定玩家的身份,而其他角色,如村民,則無法看到任何玩家的真實身份【971】。類似地,在《亞瑟王》游戲中,不同的角色擁有不同的觀察空間【919, 972】,從而影響玩家的策略和溝通。在這些設置中,每個智能體的感知能力或觀察空間與其在系統中的角色直接相關。在多智能體系統中,智能體能夠觀察到的內容的差異通常會影響它們的決策、溝通以及與其他智能體的協調。

-

行動空間異質性:另一方面,這指的是由于物理或功能性約束,智能體能夠執行的動作存在根本性的差異。在虛擬和物理環境中,這一點尤其相關,因為智能體可能根據其設計或目的具有不同的能力。在《狼人殺》【965, 971, 966】和《亞瑟王》【919, 967】等游戲的虛擬環境中,不同的角色具有不同的能力或技能【971, 919, 972】。例如,在《狼人殺》中,狼人可以互相秘密溝通,而村民則可能僅限于投票或觀察。這種動態要求智能體基于其獨特的能力進行合作,并促進策略學習,如團隊合作、信任和欺騙等交互策略。同時,在機器人學中,智能體可能展現出不同的物理能力。例如,在【988】中描述的情況,一些機器人缺乏移動能力,只能操作物體,而其他機器人則專門用于移動,但不能操作物體。在這種情況下,具有不同行動空間的智能體必須有效地分配任務,利用各自的能力來承擔適合自己的任務部分,最終協作完成整體任務。這種類型的異質性要求智能體高效地合作和協調行動,通常根據它們的個人優勢來分配任務。

-

從同質到異質的演變

在一些基于大語言模型的多智能體系統中,智能體具備自主演化的能力,并通過與環境的互動持續適應。由于大語言模型和環境本身的隨機性,這些智能體的演化通常會遵循不同的軌跡。這可能導致在多次仿真中,盡管智能體最初具有同質的個性和行動空間,仍然出現異質行為。例如,正如[989]所示,最初具有相同行動空間和個性的智能體,在與環境和其他智能體多輪互動后,發展出不同的角色。有些智能體專門從事食物采集,而其他智能體則專注于武器制作。類似地,[990]觀察到,最初同質的智能體在群體互動后,發展出了不同的語言使用模式、情感表達和個性。這些涌現的行為展示了從同質系統到異質系統轉變的可能性。

13.5 智能體互動協議

在本節中,首先會對典型的消息類型進行分類,明確智能體交互的內容和交換模式。接下來,將討論智能體與環境、智能體與智能體之間以及智能體與人類之間的通信接口設計。同時,也會涉及透明信息交換的架構問題和協議規范。特別會關注接口標準化,因為它對多智能體系統的互操作性、可擴展性和效率至關重要。最后,本節將總結通信協議的統一討論,涉及智能體與環境或智能體與用戶交互的設計原則和要求,并為基于大語言模型的系統提供清晰性、一致性和功能的協調,適用于各種應用

13.5.1 消息類型

-

結構化消息

結構化消息,通常采用 JSON([991, 992])、XML([993, 636])或代碼形式([626, 627, 994]),是基于大語言模型的多智能體系統通信中的關鍵組成部分。結構化消息的主要優勢在于其語法和語義結構明確,能夠避免歧義,并且易于解析。由于其沒有歧義,它們促進了高效的信息提取和處理,計算開銷較低,系統的可靠性也更高。例如,JSON 和 XML 可以表示特定任務的配置參數,或者作為機器可讀的方式促進數據交換,而以代碼形式編寫的消息甚至可以直接多次執行,這使得工作流和自動化更加簡便。

結構化消息特別適合高效、確定性的應用。它們在子任務分解、子任務分配和智能體之間的協調方面非常有用,特別是在協作型多智能體架構中,因為它們明確地表達了操作命令。此外,由于結構化消息具有規定的格式,數據的檢索和存儲變得更加便捷,系統優化和長期分析也變得可行。

-

非結構化數據

與此相對,非結構化信息,例如自然文本([971, 970, 919])、視覺數據(例如圖像、視頻)以及音頻信號(例如語音、環境聲音[995, 996, 762]),具有更高的信息密度和表現能力。這些模態最適合用于傳遞細致且依賴上下文的信息。例如,圖像可以傳達空間關系、光照條件和面部表情,而視頻則傳遞動態的時間組織序列,例如狀態或行為的變化。類似地,音頻信號不僅傳達語言信息,還包括副語言信息,例如語氣、情感和語調,這對于自然且具上下文感知的交互至關重要。

非結構化信息非常適合處理模糊任務以及復雜的現實世界環境。它們能夠表達抽象的思想、情感的細微差別或隱含的上下文暗示,這使得非結構化信息在創造性和探索性問題領域中非常適用。然而,非結構化數據的復雜性要求采用先進的處理技術,例如基于深度學習的特征提取,才能充分挖掘其潛力。借助預訓練的大型語言模型(LLM)以及多模態大型語言模型的進展,極大地減輕了這些復雜性,使得在多智能體系統中,非結構化通信的創新應用成為可能[533, 513, 997]。

-

總結

在基于大型語言模型(LLM)的多智能體通信中,非結構化信息和結構化信息各自扮演互補的角色。結構化信息提供準確性、一致性和計算效率,適用于操作性和確定性任務;而非結構化信息則提供豐富的、上下文化的表示,幫助智能體應對模糊、創造性和高度動態的情況。結合這兩種模式,為適應性強、有效的多智能體合作奠定了基礎。

13.5.2 通信接口

-

智能體-環境接口

基于大型語言模型(LLM)的智能體通常需要在其環境中執行一次或多次操作,以完成一系列任務。從智能體的角度來看,它對環境的輸出是其希望的內容,例如用戶界面點擊、網頁請求或計算機圖形角色的移動。不同的環境對于它們將接受的操作有所不同,因此,為了確保其操作能夠被執行,智能體必須了解在特定環境中可以執行的操作,并執行既適合特定任務又對特定環境有效的操作。當智能體輸出其選擇的操作后,它將收到來自環境的反饋。如果操作成功,將返回觀察結果;如果出現錯誤,則返回錯誤反饋。智能體必須根據這些反饋進行相應的操作。目前,存在多種類型的環境,智能體可以在其中執行操作,例如操作系統、計算機游戲、數據庫和電子商務網站。為了使智能體-環境接口共享一個通用接口,并使得基于各種大型語言模型(LLM)訓練的智能體能夠最小化適配后接入各種環境,已經提出了各種框架。這些框架使得在各種可執行環境中對智能體能力的測試更加簡便[706]。

-

智能體-智能體通信

在多智能體系統(MAS)中,自然語言通信占主導地位。這可能是因為大型語言模型通過在大量自然語言語料庫上的預訓練,具備了強大的語言能力。另一個可能的原因是,對于許多任務,自然語言通信已經足夠滿足需求。根據交換的信息類型,多智能體系統可以分為以下幾類:基于自然語言的系統在基于大型語言模型的多智能體系統中,基于文本的通信是最常見的[922, 924, 987, 970, 998]。也有一些系統使用語音作為通信媒介[996, 762, 999, 1000]。在這些系統中,智能體通過自然語言進行討論、談判、勸說或批評等行為,以實現其目標。基于結構化信息的系統與自然語言相比,結構化信息具有更高的一致性、較低的解析復雜性和減少的歧義性,這使其更適合用于智能體之間的高效、低成本通信[626]。在某些實現中,智能體之間交換的信息被結構化為不同的組件,以便接收方更容易解析和利用這些信息。例如,交換的信息可能包括指定發送方、接收方、消息類型以及有關接收方如何解析或使用內容的指令[929].

-

人類-智能體通信

開發多智能體系統的目的是擴展人類能力和認知的邊界,最終服務于人類福祉。雖然在某些社會模擬的多智能體系統中,人類主要作為觀察者存在[50, 1001],但大多數多智能體系統允許人類以各種形式參與。在這種參與過程中,人類需要與智能體進行通信,這種通信可以是自然語言或結構化信息的形式[924, 930]。當人類與智能體的通信主要依賴自然語言時,通常會有一個大型語言模型(LLM)作為中心,將人類的自然語言解析為智能體可以更有效處理的結構化信息,以便進行后續操作。這個中心LLM可以存在于多智能體系統內,也可以獨立于系統之外。為了節省時間并提高通信效率,人類還可以通過編程或類似方法使用結構化信息與多智能體系統進行通信。通過遵循預定義的通信協議,人類可以將包含所需數據的消息發送給多智能體系統。系統將根據其內部邏輯處理這些消息和數據,并返回結果[931]。

13.5.3 下一代通信協議

基于大型語言模型(LLM)的智能體領域仍處于初期階段。開發人員通常會設計針對特定領域或任務的智能體架構和通信機制,包括智能體與環境、智能體與人類以及智能體之間的交互。然而,大多數現有系統缺乏統一的通信框架,導致生態系統碎片化、孤立化。多智能體系統、工具、環境和數據源往往獨立運行,使得智能體之間的互操作性或共享能力變得困難。此外,學習和實施定制協議的負擔通常由人類承擔,而幾乎所有當前的協議都是手動設計的——這是一個勞動密集型的過程,通常缺乏語義靈活性或可擴展性。為了解決這些問題,已經提出了幾種新的智能體通信協議,每種協議都針對協議設計堆棧的不同方面。

-

智能體互聯網

智能體互聯網(IoA)[933]引入了一種受互聯網啟發的、類似即時消息的通信架構,支持動態團隊組建和任務驅動的協作。智能體通過注冊到中央協調服務器,該服務器負責身份管理和發現。通信流程通過基于有限狀態機(FSM)的對話模板進行編排。IoA支持多種消息類型,包括討論、任務分配和觸發機制,并提供結構化字段來控制發言輪次、嵌套小組形成和最大對話長度。這使得智能體能夠選擇并適應消息格式,以匹配特定的協調階段,在固定架構內提供靈活性。

-

模型上下文協議

模型上下文協議(MCP)[931]由Anthropic開發,專注于使LLM智能體能夠訪問結構化工具和數據。它采用基于OAuth身份認證的完全集中式方法,交互受限于JSON-RPC 2.0消息格式。雖然它缺乏元協議層或語義協商能力,但其簡單且嚴格的架構使其成為適用于具有明確API的工具使用場景的實際選擇。然而,MCP犧牲了靈活性和可擴展性,需要手動注冊支持的功能。

-

智能體網絡協議

智能體網絡協議(ANP)[1002]旨在實現完全去中心化。智能體通過符合W3C標準的去中心化標識符(DID)進行身份識別,并通過加密的點對點通道進行通信。該協議包含一個元協議層,使智能體能夠協商選擇采用哪種應用層協議,支持基于智能體能力的語義協議選擇。ANP還允許在應用層支持多協議(例如HTTP、JSON-RPC、自然語言),提供了強大的可擴展性和去中心化能力,但尚未明確支持公共協議重用。

-

Agora

Agora[932]提供了一種高度靈活且語言驅動的協議機制。智能體無需注冊預定義的API,而是可以生成和共享協議描述(PDs),這些描述是通信語義的自由文本。通過使用大型語言模型,智能體可以在運行時動態地解釋和執行任何協議描述。這使得協議能夠完全通過語言創建、部署和使用,無需任何手動注冊或配置。Agora避免了集中式注冊表,并支持去中心化的協議共享:智能體可以從對等分布式倉庫中發布或檢索協議描述,從而促進系統之間的累積學習和互操作性。

總結:如表13.1所示,下一代智能體通信協議在身份和安全機制、元協議協商能力、應用層靈活性以及去中心化程度等關鍵維度上存在差異。一個統一、安全、可擴展且動態的協議基礎設施——在其中智能體能夠即時協商和共同創建協議——對于實現大規模、可互操作的智能體生態系統至關重要。盡管目前的框架,如MCP、ANP、Agora和IoA,代表了早期但有前景的步驟,但協議設計仍然是智能體系統開發中的一個快速發展的前沿領域。

表13.1:四種智能體通信協議的比較

| 層級 | MCP | ANP | Agora | IoA |

| 身份與安全 | 基于 OAuth 的集中式身份認證 | 基于 DID 的去中心化身份,支持加密通信通道 | 無需集中注冊,身份從 PD 哈希中派生 | 代理通過中心服務器進行身份注冊與發現 |

| 元協議層 | 無元協議層;依賴預定義的接口 | 使用 DID 文檔通過語義協商選擇合適的協議 | LLM 解釋 PD 文本,實現通信協議的自動協商與部署 | 結合集中式發現機制與基于有限狀態機(FSM)的對話流程控制 |

| 應用協議層 | 僅支持 JSON-RPC 2.0 | 支持多種協議,如 HTTP 與自然語言 | 支持任意由 PD 驅動的協議,靈活性極高 | 任務驅動的協議協調,支持多種消息格式 |

| 中心化程度 | 高度中心化的架構 | 完全去中心化 | 去中心化:無注冊或固定 ID,可選的點對點 PD 共享 | 去中心化:無注冊或固定 ID,可選的點對點 PD 共享 |

| 協議靈活性 | 協議固定且剛性強;難以適應 JSON-RPC 之外的格式 | 協議高度靈活,支持語義協商 | 極其靈活;任何 PD 都可動態定義新協議 | 中等偏高的靈活性;代理可根據任務階段與協調需求選擇并適配消息格式 |

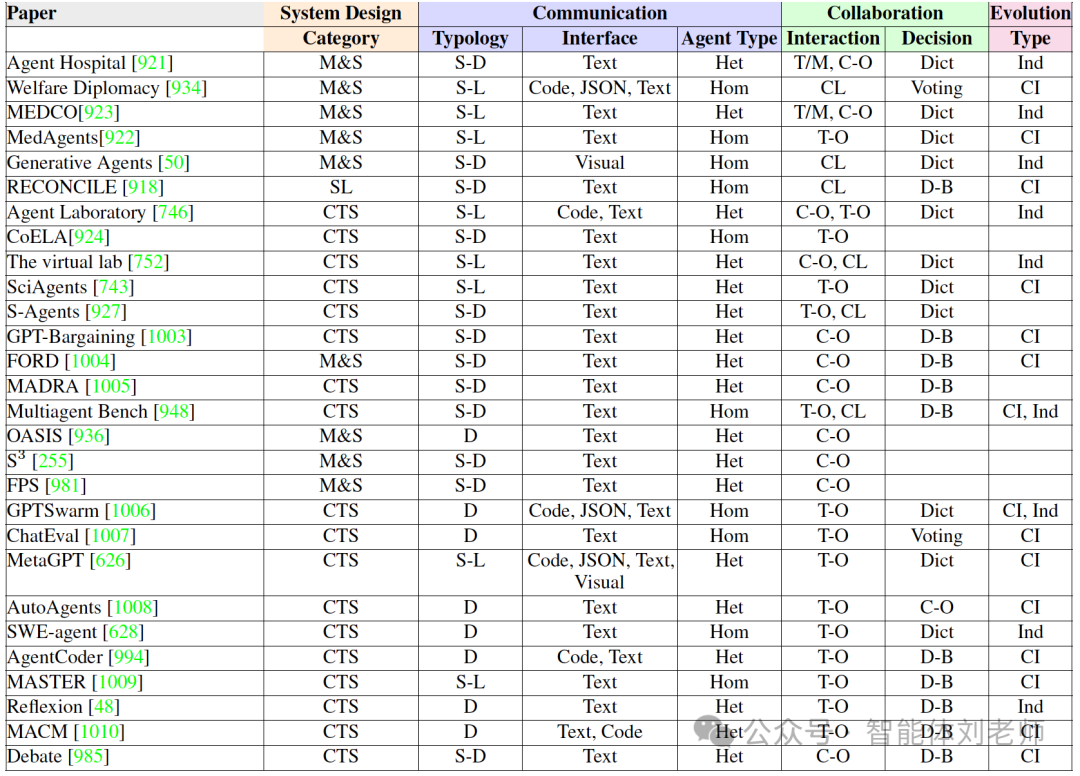

表13.2:基于LLM的多智能體系統分類框架

【往期回顧】

連載13:科學發現與智能進化

連載12:自我改進

連載11:持續優化

連載10:自我進化

連載9:行動系統

連載8:感知

連載7:情感模型

連載6:獎勵

連載5:世界模型

連載4:記憶

連載3:認知系統

連載2:綜述介紹

連載1:摘要與前言

![[Windows] 網絡檢測工具InternetTest v8.8.2.2503 單文件版_支持查詢IP_DNS_WIFI密碼一鍵恢復](http://pic.xiahunao.cn/[Windows] 網絡檢測工具InternetTest v8.8.2.2503 單文件版_支持查詢IP_DNS_WIFI密碼一鍵恢復)

:API接口層介紹)

)

模組性能測試和應用)