Large Language Model (LLM) 即大規模語言模型,是一種基于深度學習的自然語言處理模型,它能夠學習到自然語言的語法和語義,從而可以生成人類可讀的文本。

所謂 "語言模型",就是只用來處理語言文字(或者符號體系)的 AI 模型,發現其中的規律,可以根據提示 (prompt),自動生成符合這些規律的內容。

LLM 通常基于神經網絡模型,使用大規模的語料庫進行訓練,比如使用互聯網上的海量文本數據。這些模型通常擁有數十億到數萬億個參數,能夠處理各種自然語言處理任務,如自然語言生成、文本分類、文本摘要、機器翻譯、語音識別等。

本文對國內外公司、科研機構等組織開源的 LLM 進行了全面的整理。

🌍 1. 開源中文 LLM

🔹 ChatGLM-6B —— 雙語對話語言模型

ChatGLM-6B 是一個開源的、支持中英雙語問答的對話語言模型,并針對中文進行了優化。該模型基于 General Language Model (GLM) 架構,具有 62 億參數。結合模型量化技術,用戶可以在消費級的顯卡上進行本地部署(INT4 量化級別下最低只需 6GB 顯存)。

? 特點:

-

支持中英雙語問答

-

優化中文理解與生成

-

低顯存需求,適合本地部署

🔗 GitHub

🔹 ChatGLM2-6B —— 中英雙語對話模型第二代

基于 ChatGLM 初代模型的開發經驗,ChatGLM2-6B 全面升級了基座模型,支持更長的上下文,更高效的推理,更開放的協議。

? 升級點:

-

更長的上下文支持

-

更快的推理速度

-

更開放的協議

🔗 GitHub

🔹 VisualGLM-6B —— 多模態對話語言模型

VisualGLM-6B 是一個支持 圖像、中文和英文 的多模態對話語言模型,語言模型基于 ChatGLM-6B,視覺部分通過訓練 BLIP2-Qformer 構建起視覺與語言的橋梁。

? 特點:

-

支持圖像+文本多模態輸入

-

78億參數,增強視覺理解能力

🔗 GitHub

🔹 MOSS —— 支持中英雙語的對話大語言模型

MOSS 是一個支持中英雙語和多種插件的開源對話語言模型,moss-moon 系列模型具有 160 億參數,在 FP16 精度下可在單張 A100/A800 或兩張 3090 顯卡運行。

? 特點:

-

支持插件增強

-

在千億級中英文數據上預訓練

-

適用于多輪對話

🔗 GitHub

🔹 DB-GPT —— 數據庫大語言模型

DB-GPT 是一個開源的以 數據庫為基礎 的 GPT 實驗項目,使用本地化的 GPT 大模型與數據和環境進行交互,無數據泄露風險,100% 私密。

? 特點:

-

專為數據庫場景優化

-

支持本地部署,數據安全可控

🔗 GitHub

🔹 CPM-Bee —— 中英文雙語大語言模型

CPM-Bee 是一個 完全開源、允許商用 的百億參數中英文基座模型,采用 Transformer 自回歸架構,使用 萬億級高質量語料 進行預訓練。

? 特點:

-

開源可商用

-

中英雙語性能優異

-

超大規模訓練數據

🔗 GitHub

🔹 LaWGPT —— 基于中文法律知識的大語言模型

LaWGPT 是一系列基于 中文法律知識 的開源大語言模型,在通用中文基座模型的基礎上擴充法律領域專有詞表,增強法律語義理解能力。

? 特點:

-

法律領域優化

-

支持司法考試數據集

🔗 GitHub

🔹 伶荔 (Linly) —— 大規模中文語言模型

Linly 是目前最大的中文 LLaMA 模型之一(33B),支持 中文增量訓練,并提供量化推理框架。

? 特點:

-

支持 CPU/GPU 推理

-

提供 7B、13B、33B 版本

🔗 GitHub

🔹 Chinese-Vicuna —— 基于 LLaMA 的中文大語言模型

Chinese-Vicuna 是一個中文低資源的 LLaMA + LoRA 方案,支持 CPU 推理。

? 特點:

-

低成本微調方案

-

支持 C++ CPU 推理

🔗 GitHub

🔹 ChatYuan —— 對話語言大模型

ChatYuan 是一個支持中英雙語的功能型對話語言大模型,最低僅需 400M 顯存(INT4) 即可運行。

? 特點:

-

輕量化,適合移動端

-

優化指令理解

🔗 GitHub

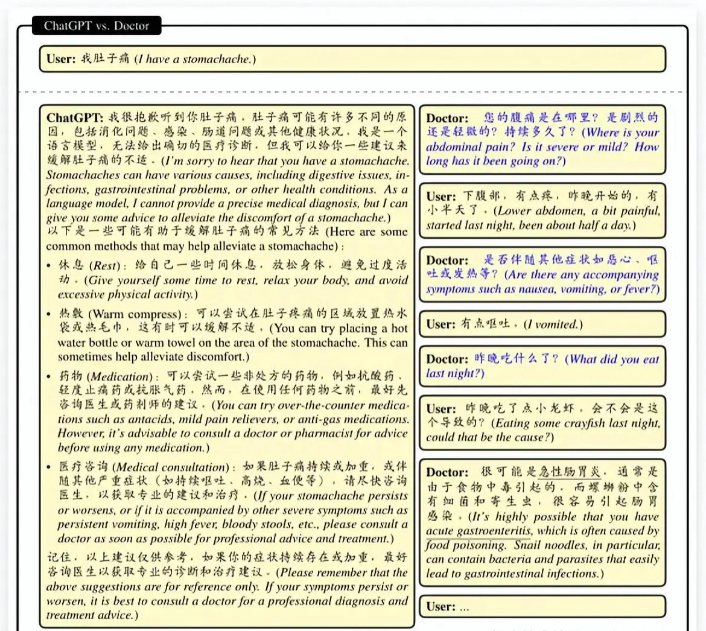

🔹 華佗 GPT —— 開源中文醫療大模型

HuatuoGPT(華佗 GPT)是開源中文醫療大模型,基于 醫生回復 + ChatGPT 數據 訓練,提供豐富的醫療問診能力。

? 特點:

-

醫療領域優化

-

支持診斷建議

🔗 GitHub

🔹 本草 (BenTsao) —— 基于中文醫學知識的 LLaMA 微調模型

本草(原名華駝)是基于 中文醫學知識 的 LLaMA 微調模型,適用于醫療問答。

? 特點:

-

醫學指令微調

-

支持知識圖譜

🔗 GitHub

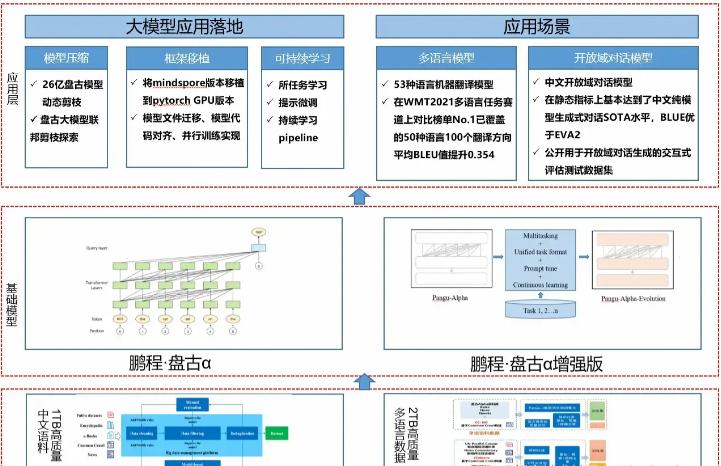

🔹 鵬程·盤古α —— 中文預訓練語言模型

「鵬程·盤古α」是業界首個 2000 億參數 的中文預訓練生成語言模型,支持知識問答、閱讀理解等任務。

? 特點:

-

超大規模訓練

-

支持少樣本學習

🔗 GitHub

🔹 悟道 —— 雙語多模態大語言模型

“悟道” 是 1.75 萬億參數 的雙語多模態預訓練模型,涵蓋 文本、圖像、蛋白質 等多個領域。

? 子模型:

-

CogView(文生圖)

-

BriVL(圖文檢索)

-

GLM(英文預訓練)

-

CPM(中文生成)

🔗 GitHub

🔹 BBT-2 —— 120 億參數大語言模型

BBT-2 是包含 120 億參數 的通用大語言模型,衍生出 代碼、金融、文生圖 等專業模型。

? 衍生模型:

-

BBT-2-12B-TC-001(代碼模型)

-

BBT-2-12B-TF-001(金融模型)

-

BBT-2-12B-Fig(文生圖)

🔗 GitHub

🔹 BELLE —— 開源中文對話大模型

BELLE 目標是促進 中文對話大模型 開源社區的發展,基于 BLOOM 優化中文能力。

? 特點:

-

使用 ChatGPT 生成數據微調

-

支持個性化訓練

🔗 GitHub

🔹 TigerBot —— 多模態大語言模型

TigerBot 是一個多語言多任務的大規模語言模型,TigerBot-7B 達到 OpenAI 同規模模型的 96% 性能。

? 特點:

-

支持多語言

-

高性能推理

🔗 GitHub

🔹 YuLan-Chat —— 大語言對話模型

中國人民大學發布的 中英文雙語對話模型,優化指令微調技術。

? 特點:

-

學術研究導向

-

支持多輪交互

🔗 GitHub

🔹 百聆 (BayLing) —— 中英雙語大語言模型

中國科學院計算技術研究所開發的 中英雙語大語言模型,性能達 ChatGPT 90%。

? 特點:

-

優越的中英生成能力

-

支持多輪交互

🔗 GitHub

🌎 2. 開源國際 LLM

🔹 通義千問-7B (Qwen-7B) —— 阿里云開源大模型

Qwen-7B 基于 Transformer 架構,支持 8K 上下文,覆蓋多種 NLP 任務。

? 特點:

-

大規模預訓練數據(2.2 萬億 token)

-

支持插件調用

🔗 GitHub

🔹 Code Llama —— 基于 Llama 2 的 AI 代碼生成模型

Meta 發布的 代碼生成大模型,支持 Python、C++、Java 等編程語言。

? 版本:

-

Code Llama(基礎代碼模型)

-

Code Llama-Python(Python 優化)

-

Code Llama-Instruct(指令理解)

🔗 GitHub

🔹 MiLM-6B —— 小米 AI 大模型

小米開發的 64 億參數 中文大模型,在 C-Eval 和 CMMLU 評測中表現優異。

? 特點:

-

中文優化

-

高性能推理

🔗 GitHub

🔹 LLaMA —— Meta 開源大語言模型

Meta 的 LLaMA 系列(7B/13B/33B/65B),性能超越 GPT-3。

? 特點:

-

高效推理

-

適合本地部署

🔗 GitHub

🔹 Falcon —— 阿聯酋開源語言模型

Falcon 40B 是目前 最強大的開源語言模型之一,性能優于 LLaMA。

? 特點:

-

400 億參數

-

高效推理

🔗 GitHub

🔹 Vicuna —— 基于 LLaMA 的微調模型

Vicuna-13B 達到 ChatGPT 90% 的質量,訓練成本僅 300 美元。

? 特點:

-

低成本微調

-

高性能對話

🔗 GitHub

🔹 BLOOM —— 1760 億參數多語言模型

BLOOM 支持 46 種自然語言 + 13 種編程語言,完全開源。

? 特點:

-

多語言支持

-

免費商用

🔗 GitHub

🔹 GPT-J —— 60 億參數開源模型

GPT-J 基于 GPT-3 架構,性能接近 OpenAI 的 67 億參數版本。

? 特點:

-

完全開源

-

支持代碼生成

🔗 GitHub

🔹 WizardLM —— 基于 LLaMA 的微調模型

WizardLM 使用 Evol-Instruct 方法自動生成訓練數據,優化指令理解。

? 特點:

-

70K 指令微調

-

高性能對話

🔗 GitHub

🛠? 3. LLM 相關工具

🔹 OpenLLM —— 大語言模型操作平臺

支持 Fine-tune、Serve、部署、監控 任何 LLM,兼容多種開源模型。

? 特點:

-

支持 RESTful API

-

簡化部署

🔗 GitHub

🔹 LangChain —— 構建 LLM 應用的工具

提供 Prompt 管理、LLM 接口、文檔加載、鏈式調用 等功能。

? 特點:

-

支持多種 LLM

-

靈活構建 AI 應用

🔗 GitHub

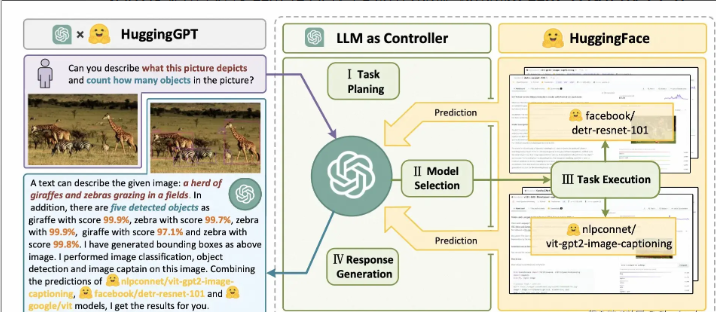

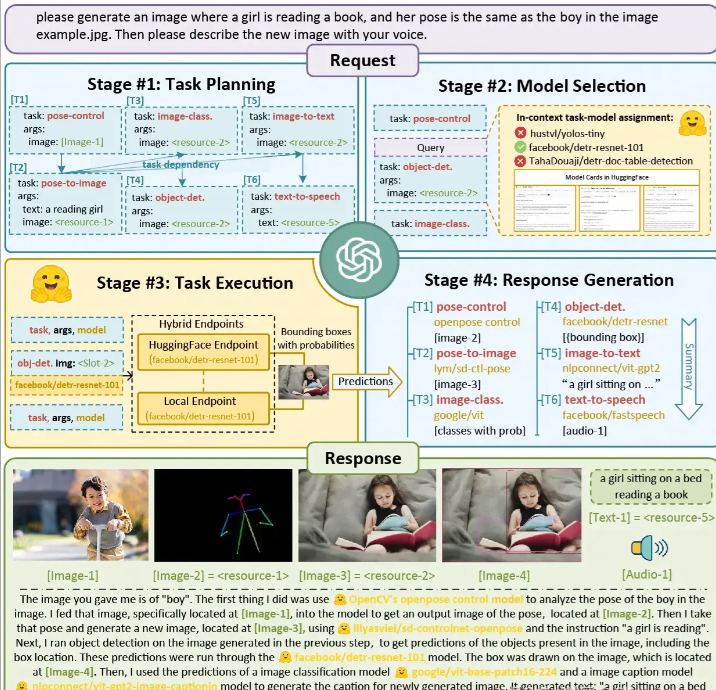

🔹 JARVIS —— 連接 LLM 和 AI 模型的協作系統

由 LLM 作為控制器,調用 HuggingFace 模型執行任務。

? 工作流程:

-

任務規劃

-

模型選擇

-

任務執行

-

生成響應

🔗 GitHub

🔹 Dify —— LLMOps 平臺

可視化編排 Prompt、數據集、API,支持 GPT-3/4、LLaMA 等模型。

? 特點:

-

開箱即用

-

支持私有化部署

🔗 GitHub

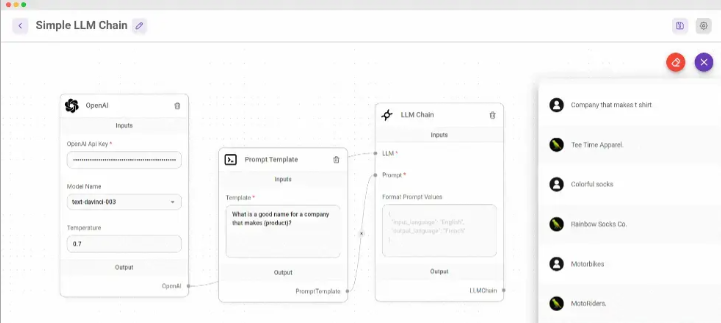

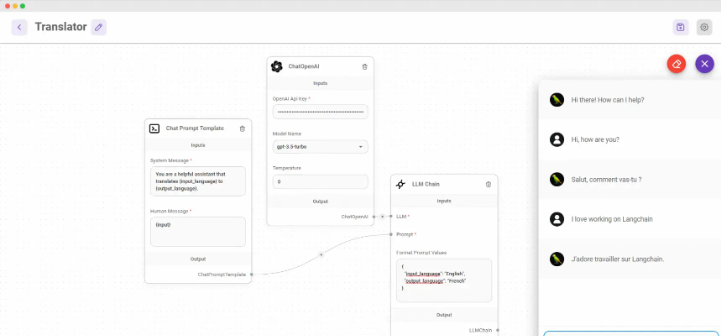

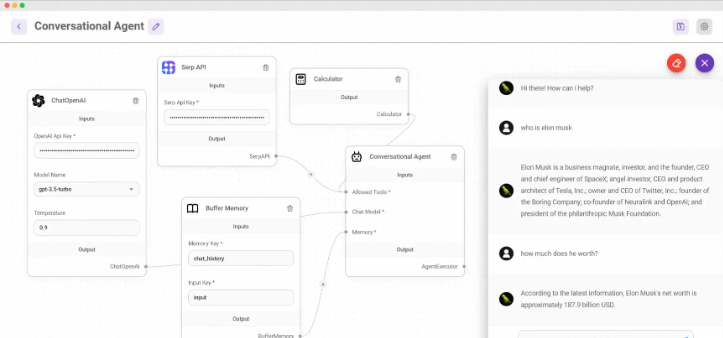

🔹 Flowise —— 可視化構建 LLM 應用

基于 LangChain 的低代碼工具,支持對話鏈、記憶代理等。

? 特點:

-

拖拽式 UI

-

快速原型開發

🔗 GitHub

🎉 總結

本文整理了 國內外 50+ 開源大語言模型及相關工具,涵蓋:

-

中文 LLM(ChatGLM、MOSS、DB-GPT 等)

-

國際 LLM(LLaMA、Falcon、BLOOM 等)

-

LLM 工具(LangChain、Dify、Flowise 等)

無論是 學術研究 還是 商業應用,這些開源項目都提供了強大的支持! 🚀

)

)

)