文章目錄

- 前言

- 1. 下載運行Ollama

- 2. 安裝大語言模型

- 3. 安裝Cpolar工具

- 4. 配置公網地址

- 5. 固定公網地址

- 6. MaxKB 添加Olama

- 7.創建問答應用

前言

目前大語言模型(LLM)已經成為了人工智能領域的一顆璀璨明星,從自然語言處理到智能問答系統,這些強大的模型正在逐步改變我們的生活方式和工作方式。然而,對于很多個人開發者或小型團隊來說,在本地運行這類復雜的模型似乎是一件遙不可及的事情。

不過別擔心!今天我要分享一個超實用的教程,教你如何在Windows上輕松搭建大語言模型框架Ollama,并通過MaxKB創建屬于你自己的智能問答應用。不僅如此,我們還將利用內網穿透工具cpolar來解決一些常見的技術難題,讓你無需公網IP或域名也能順利運行這個項目。

無論你是對AI充滿好奇的初學者,還是希望提升自己技能的技術高手,這篇教程都將為你打開一扇新的大門。讓我們一起動手吧!

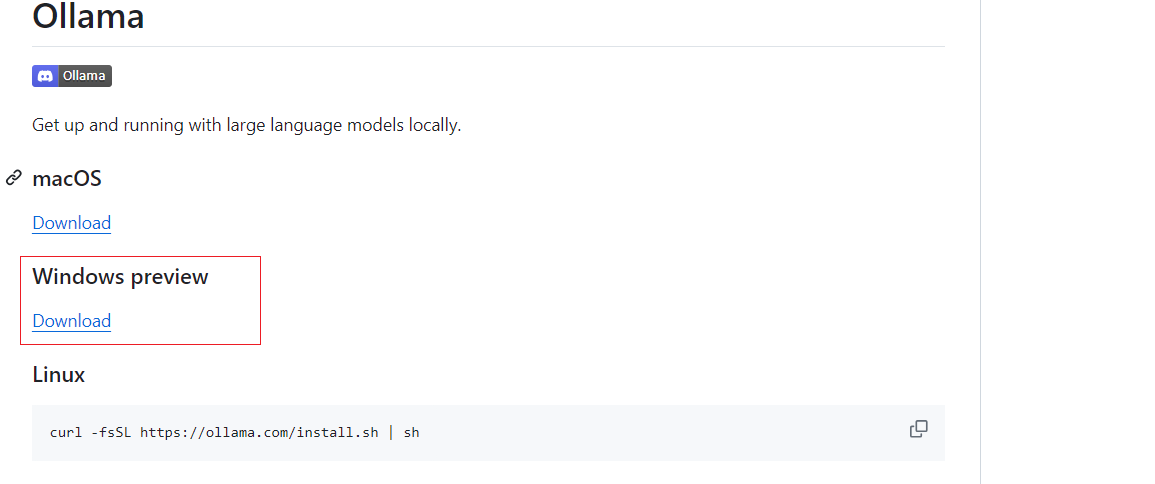

1. 下載運行Ollama

進入Ollama Github 界面:https://github.com/ollama/ollama?tab=readme-ov-file ,我們選擇windwos版本下載

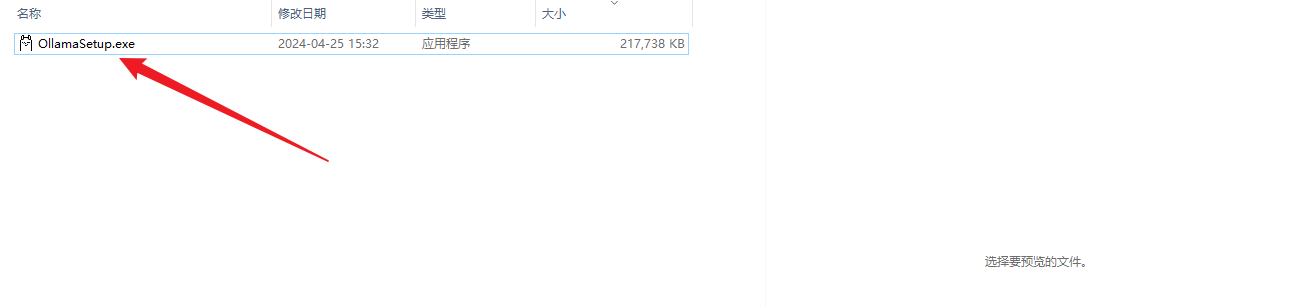

下載后,雙擊進行安裝,默認會安裝到C盤,然后等待安裝完成,安裝完成后正常會自動運行,如果沒有運行,可以去應用列表雙擊運行即可

然后打開命令窗口,輸入:ollama -v,可以看到版本信息

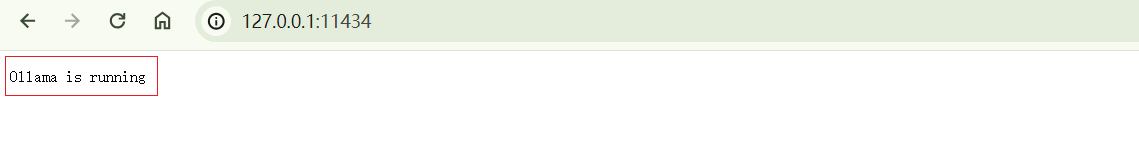

同樣,在瀏覽器輸入http://127.0.0.1:11434/訪問ollama服務,即可看到,運行的字樣,表示本地運行成功了,下面進行安裝大語言模型.

2. 安裝大語言模型

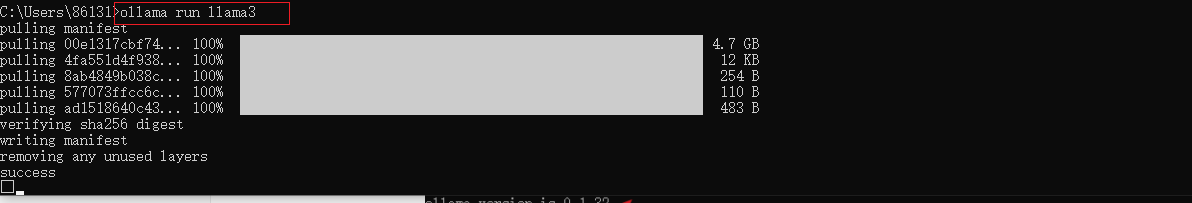

ollama安裝完成后,下面進行下載運行大語言模型,本例采用llama2模型,當然還有其他模型,可以到github上面選擇,命令窗口輸入下面命令

ollama run llama2

然后等待安裝完成即可,出現success 表示下載完成了,然后按ctrl+d 退出,

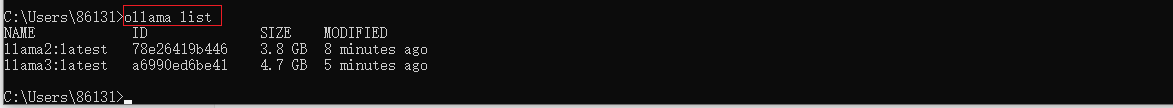

然后再輸入ollama list 即可看到下載的大語言模型列表,本例下載了兩個,所以顯示兩個,下面我們安裝cpolar內網穿透工具,實現遠程也可以調用Ollama這個大語言模型框架,遠程通信!

3. 安裝Cpolar工具

本例介紹的是windwos系統,所以cpolar安裝在windwos上,點擊下面地址訪問cpolar官網,注冊一個賬號,然后下載并安裝客戶端.

Cpolar官網:https://www.cpolar.com/

- windows系統:在官網下載安裝包后,雙擊安裝包一路默認安裝即可。

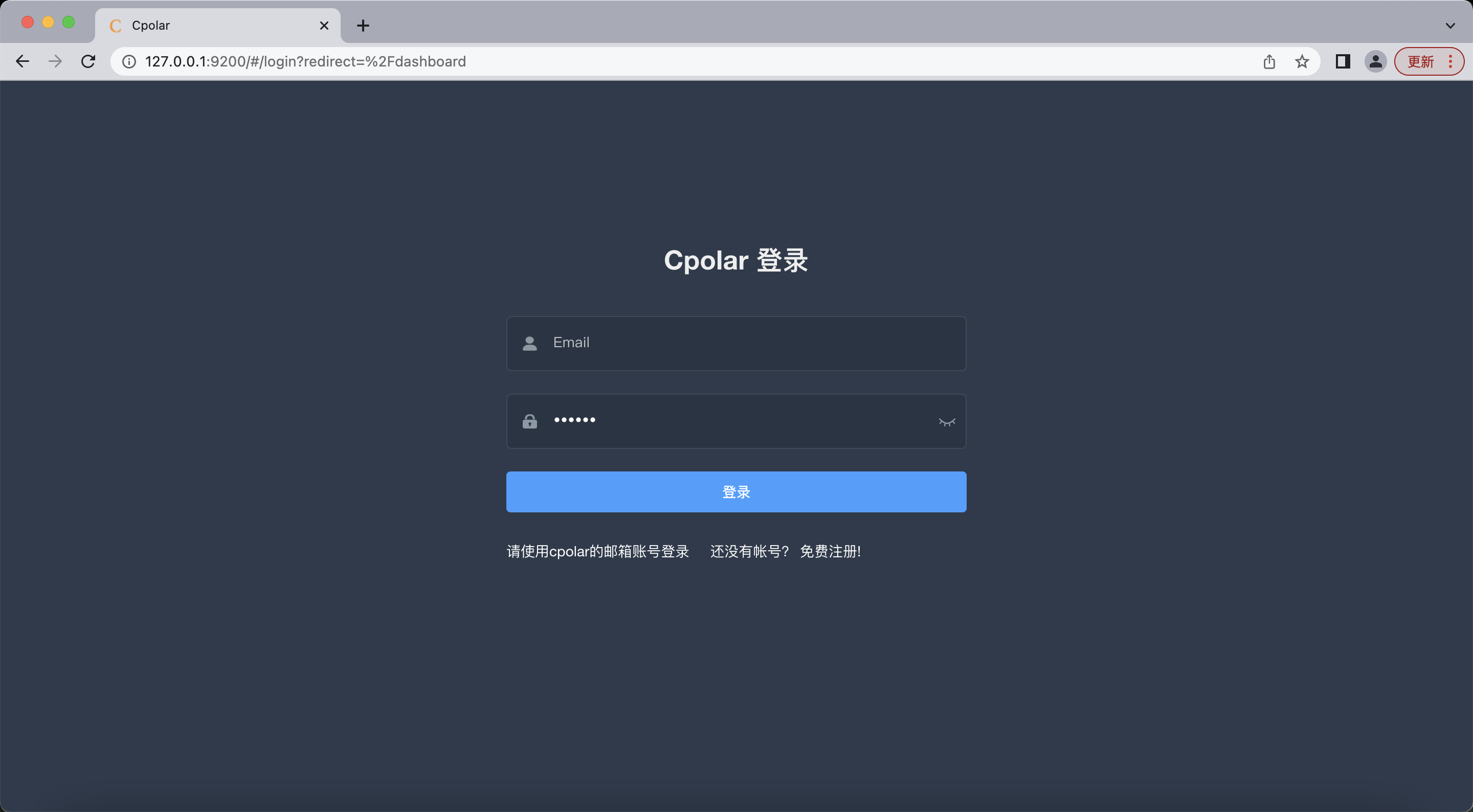

cpolar安裝成功后,在瀏覽器上訪問本地9200端口【http://localhost:9200】,使用cpolar賬號登錄,即可看到Cpolar 管理界面,然后一切設置只需要在管理界面完成即可!

4. 配置公網地址

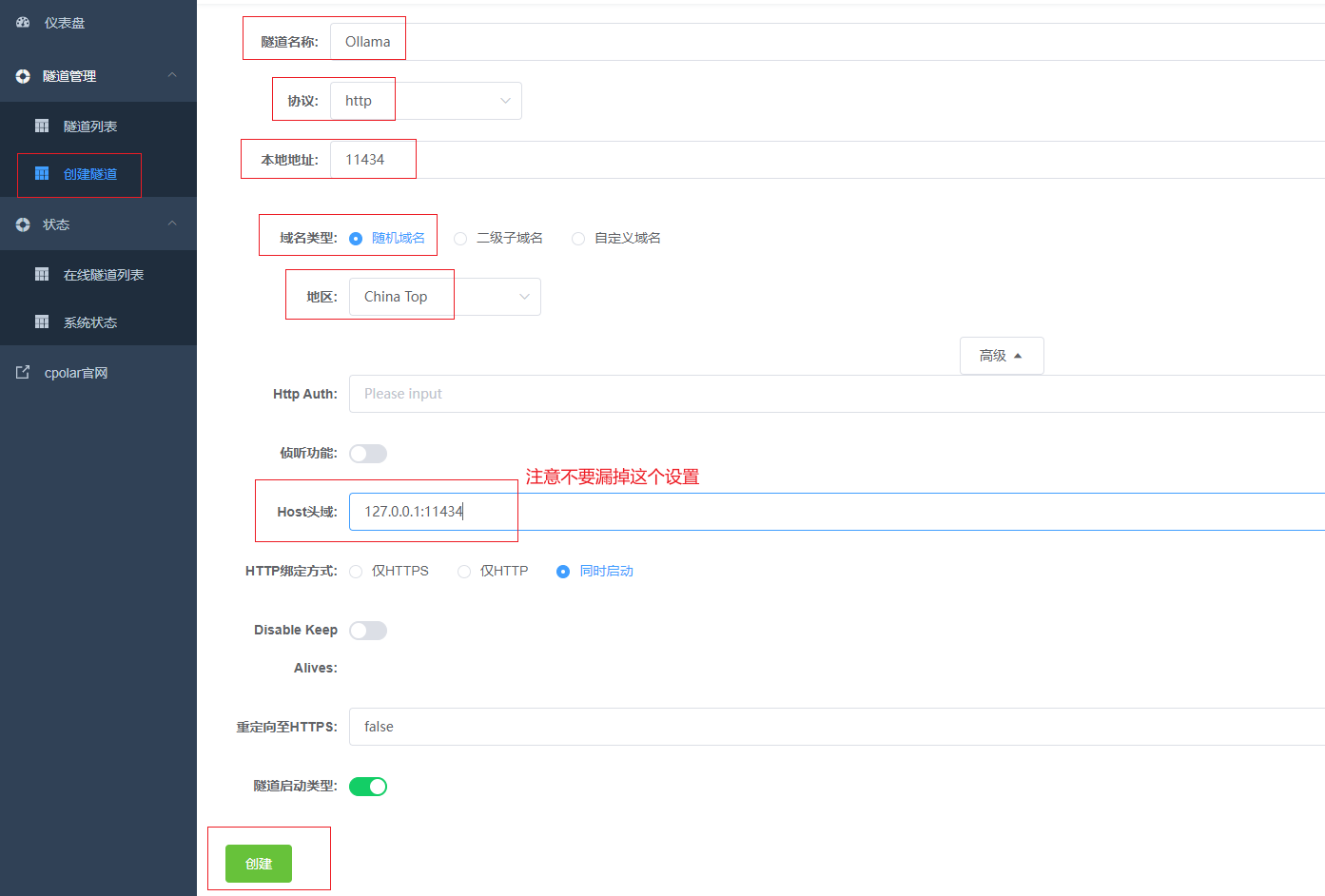

點擊左側儀表盤的隧道管理——創建隧道,創建一個ollama的公網http地址隧道!

- 隧道名稱:可自定義命名,注意不要與已有的隧道名稱重復

- 協議:選擇http

- 本地地址:11434

- 域名類型:免費選擇隨機域名

- 地區:選擇China

- host頭域: 127.0.0.1:11434

點擊創建(點擊一次創建按鈕即可,不要重復點擊!)

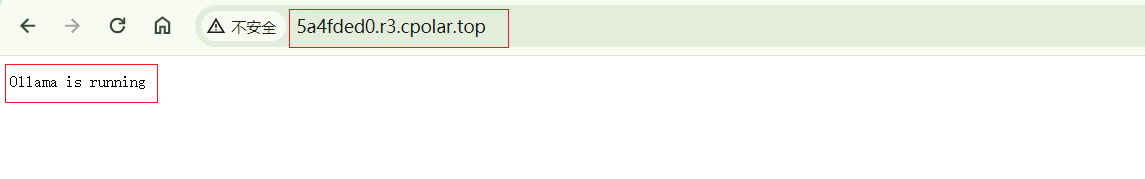

隧道創建成功后,點擊左側的狀態——在線隧道列表,查看所生成的公網訪問地址,有兩種訪問方式,一種是http 和https,兩種都可以訪問,下面選擇其中一種進行遠程訪問

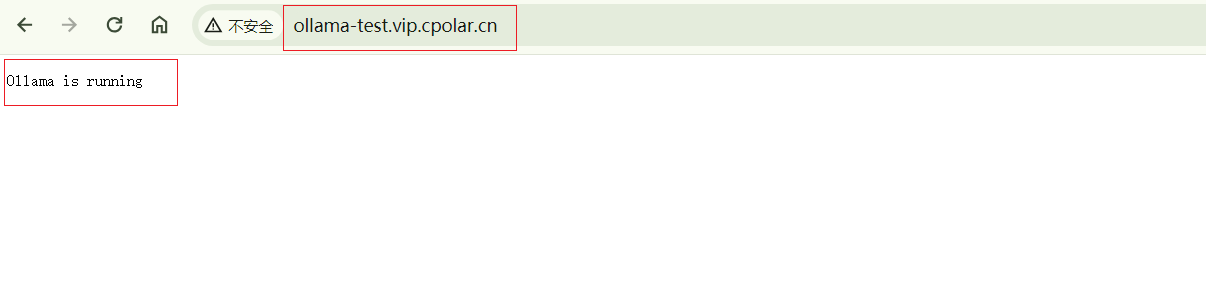

在瀏覽器輸入創建的公網地址,我們可以看到,同樣看到了ollama 運行的字樣,表示公網訪問成功了!

小結

為了更好地演示,我們在前述過程中使用了cpolar生成的隧道,其公網地址是隨機生成的。這種隨機地址的優勢在于建立速度快,可以立即使用。然而,它的缺點是網址由隨機字符生成,不太容易記憶。另外,這個地址在24小時內會發生隨機變化,更適合于臨時使用。

我一般會使用固定二級子域名,原因是我希望將網址發送給同事或客戶時,它是一個固定、易記的公網地址(例如:ollama.cpolar.cn),這樣更顯正式,便于流交協作。

5. 固定公網地址

由于以上使用cpolar所創建的隧道使用的是隨機公網地址,24小時內會隨機變化,不利于長期遠程訪問。因此我們可以為其配置二級子域名,該地址為固定地址,不會隨機變化。

登錄cpolar官網,點擊左側的預留,選擇保留二級子域名,設置一個二級子域名名稱,點擊保留,保留成功后復制保留的二級子域名名稱

保留成功后復制保留成功的二級子域名的名稱

返回登錄cpolar web UI管理界面,點擊左側儀表盤的隧道管理——隧道列表,找到所要配置的隧道,點擊右側的編輯

修改隧道信息,將保留成功的二級子域名配置到隧道中

- 域名類型:選擇二級子域名

- Sub Domain:填寫保留成功的二級子域名

點擊更新(注意,點擊一次更新即可,不需要重復提交)

更新完成后,打開在線隧道列表,此時可以看到公網地址已經發生變化,地址二級名稱變成了我們自己設置的二級子域名名稱

下面我們打開瀏覽器,輸入cpolar中固定的公網地址,即可看到同樣是訪問成功了,這樣一個固定的公網訪問ollama 的公網地址就設置好了,下面我們在MaxKB中添加調用我們本地模型

6. MaxKB 添加Olama

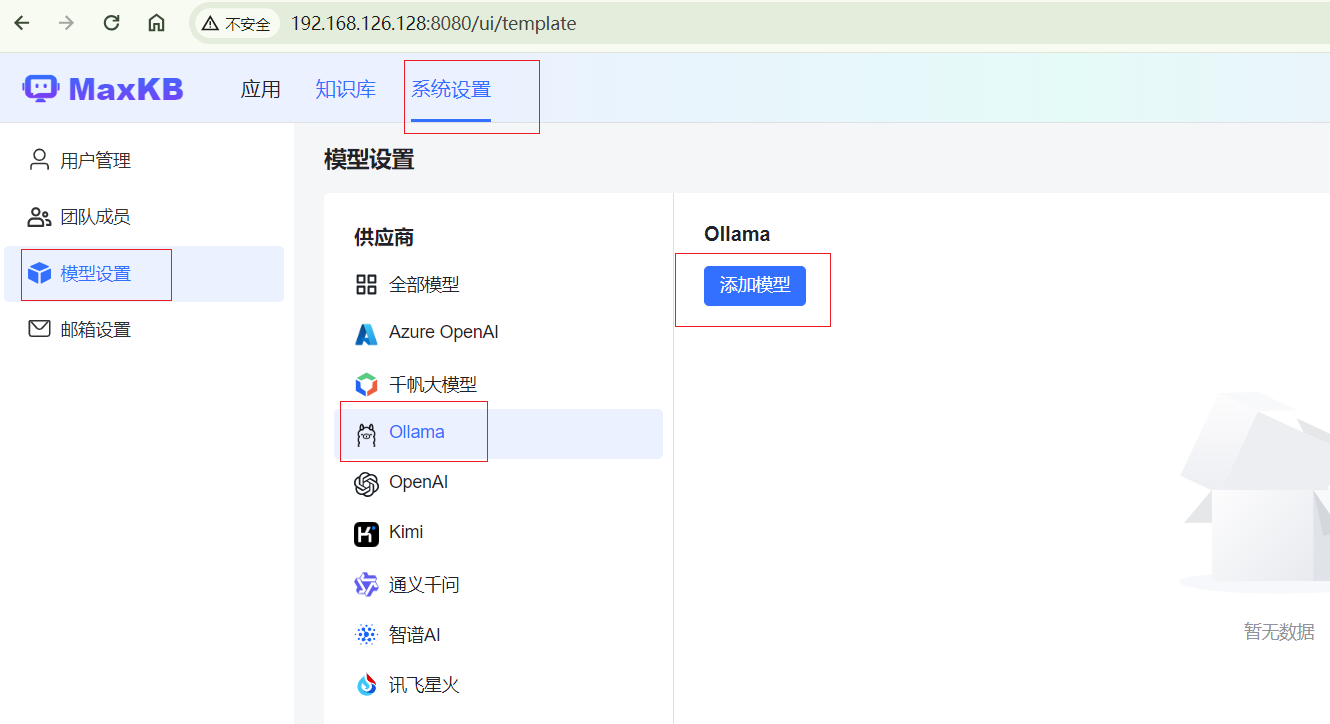

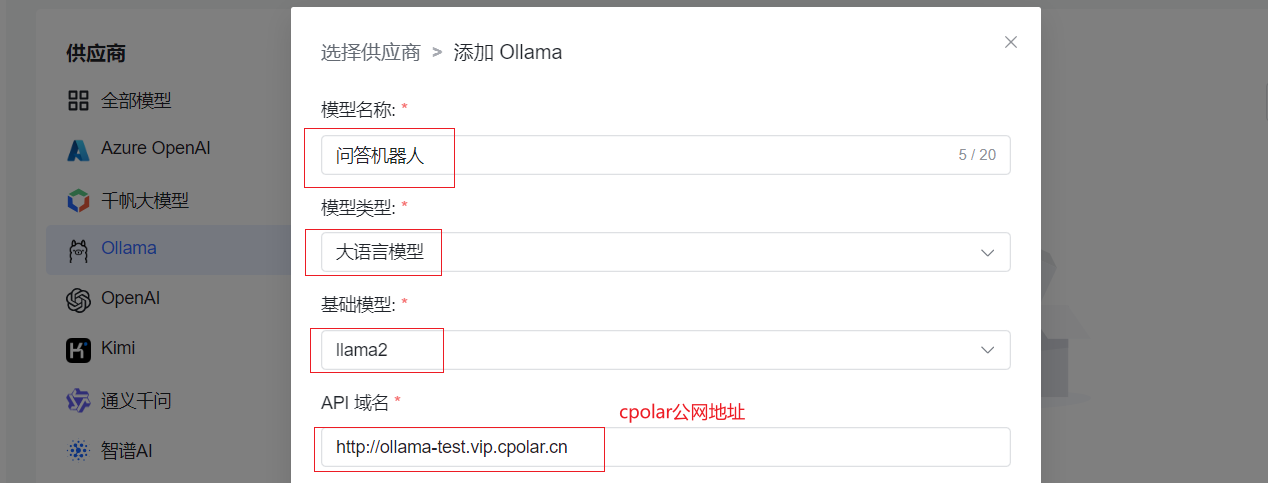

MaxKB是一個基于大語言的問答系統,可以說是一個前端界面,支持對接多個大語言模型,具體可以可以看一下Gitee開源地址了解:https://gitee.com/aqie-project/MaxKB,成功運行MaxKB,登錄進去后,點擊,系統設置,選擇模型設置,再選擇Ollama,然后點擊添加模型

前面4個參數正常填寫選擇即可,模型選擇llama2,目前頁面沒有llama3選項,我們選擇2即可.然后API域名輸入cpolar公網地址,注意,這里只能輸入域名

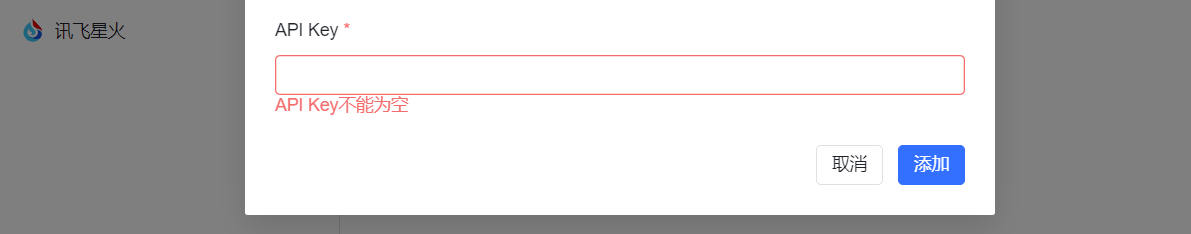

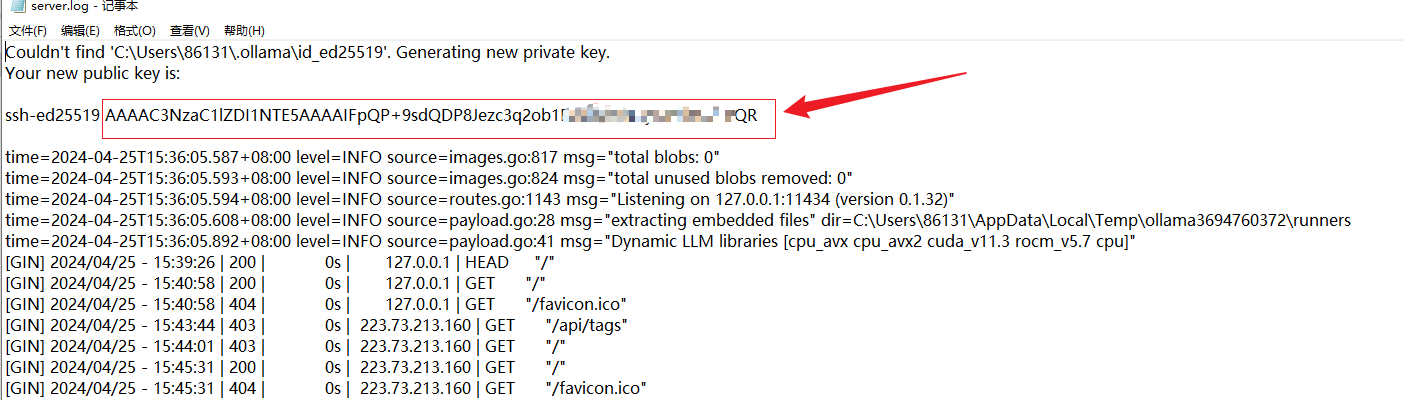

然后看下面API key參數,這里需要一個key,這個key在我們最開始運行Ollama軟件的時候,在運行的日志里面可以找到

在右下角我們可以找到運行的小圖標,右鍵點擊

然后查看日志位置

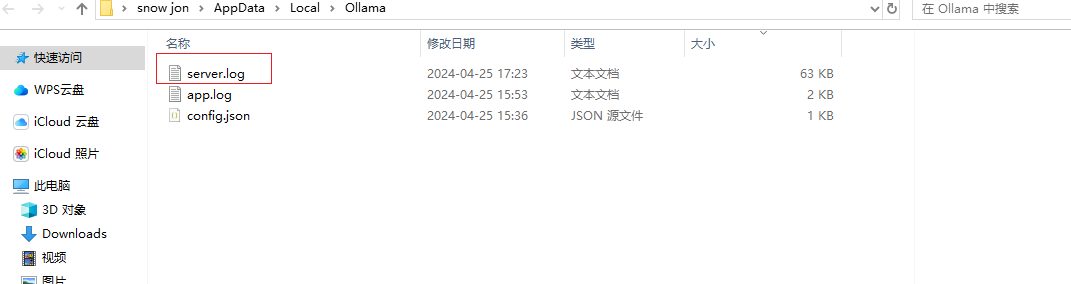

打開這個名稱為server.log的日志文件

在這個文件最開始,我們可以看到key的信息,注意是下面框住的這一部分是key

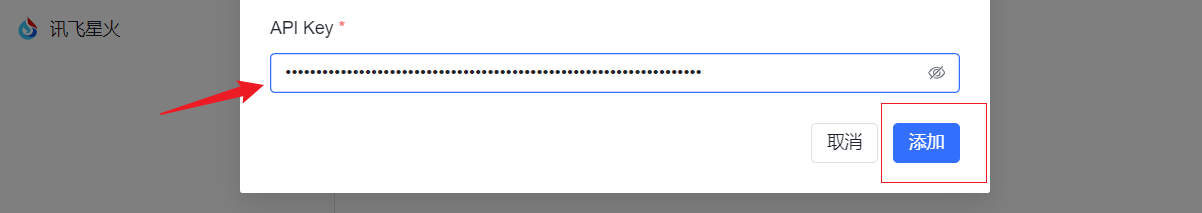

然后把key 輸入到API Key 框里面

然后點擊添加即可

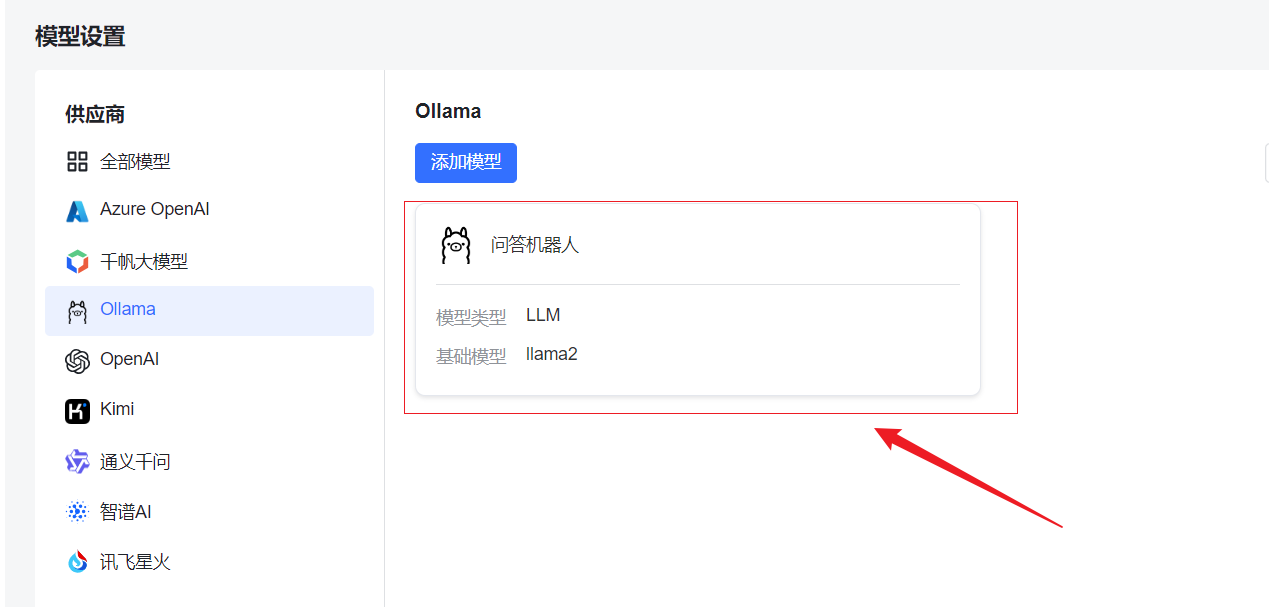

最后我們可以看到成功添加了,如果在添加過程中沒有llama2的大語言模型,這里也會自動下載

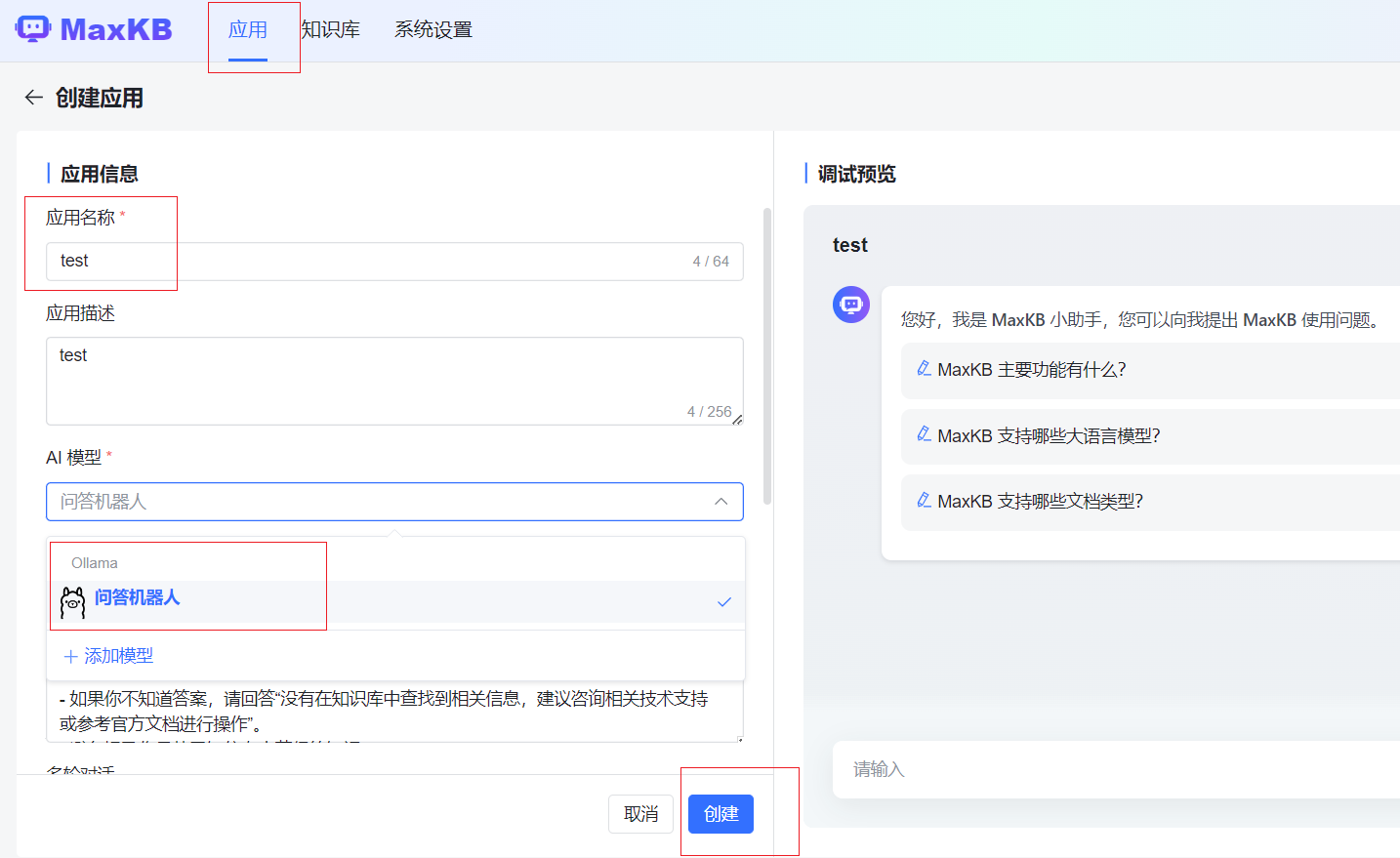

7.創建問答應用

點擊應用,我們創建一個問答應用,模型可以看到選擇我們剛剛添加的大語言模型

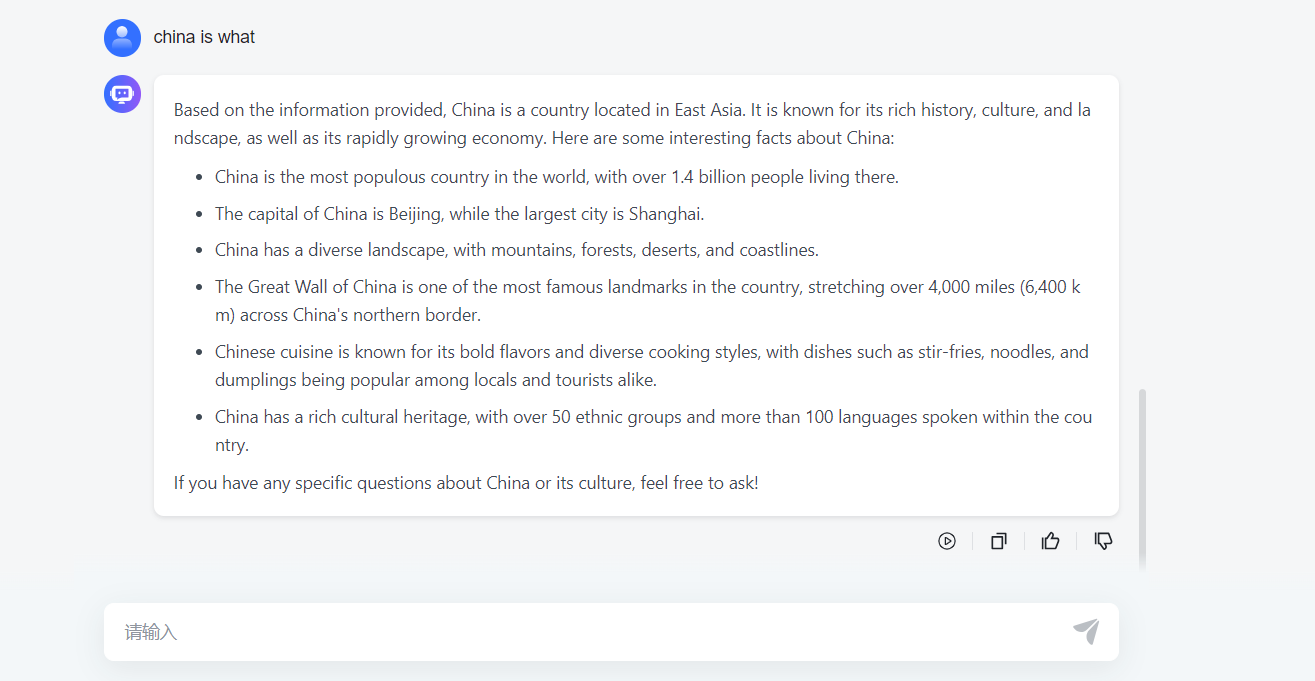

創建完成后,點擊演示,進入問答頁面

然后就可以進行對話了,llama2是一個英文模型,基本的回答都是英文,當然可以自己導入設置其他模型,方式也是一樣的,由于運行在windows設備,設備配置越高,響應越快,這樣一個智能問答應用就設置好了!

通過今天的分享,相信你已經掌握了在Windows上本地搭建大語言模型框架Ollama,并將其集成到MaxKB中創建智能問答應用的方法。利用內網穿透工具cpolar,我們成功解決了無法使用本地或局域網IP的問題,讓你的項目更加靈活和便捷。希望這篇教程能為你帶來啟發和技術上的幫助。如果你有任何疑問或者更好的建議,請在評論區留言交流。讓我們一起探索更多AI的可能性!

——Vue簡介、Vue指令與指令修飾符)

| 學習筆記)

)