文章目錄

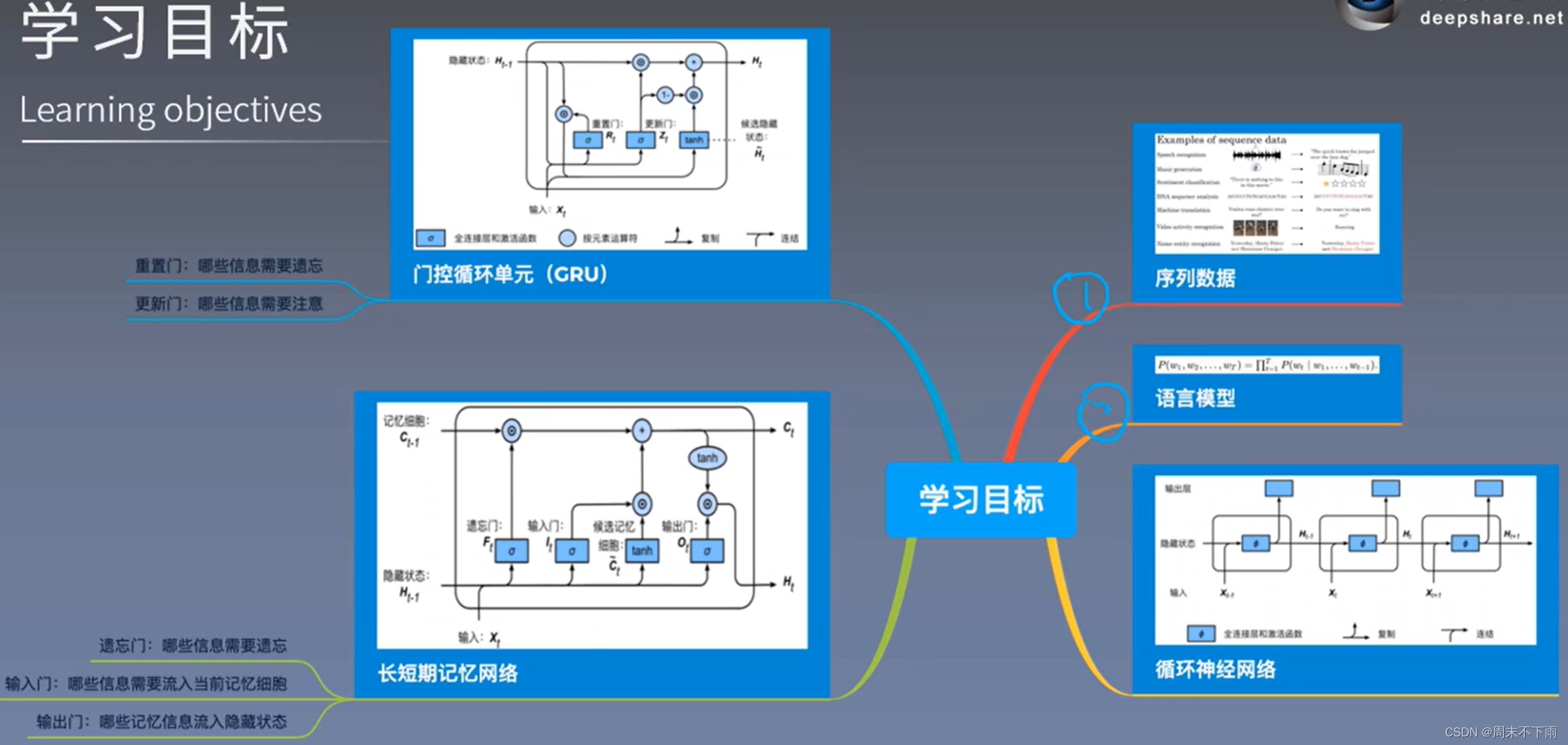

- 一、 學習目標

- 二、序列數據

- 三、語言模型

- 四、循環神經網絡

- 4.1 RNN的反向傳播

- 五、門控循環單元-GNU

- 5.1 候選隱藏狀態

- 六、長短期記憶網絡-LSTM

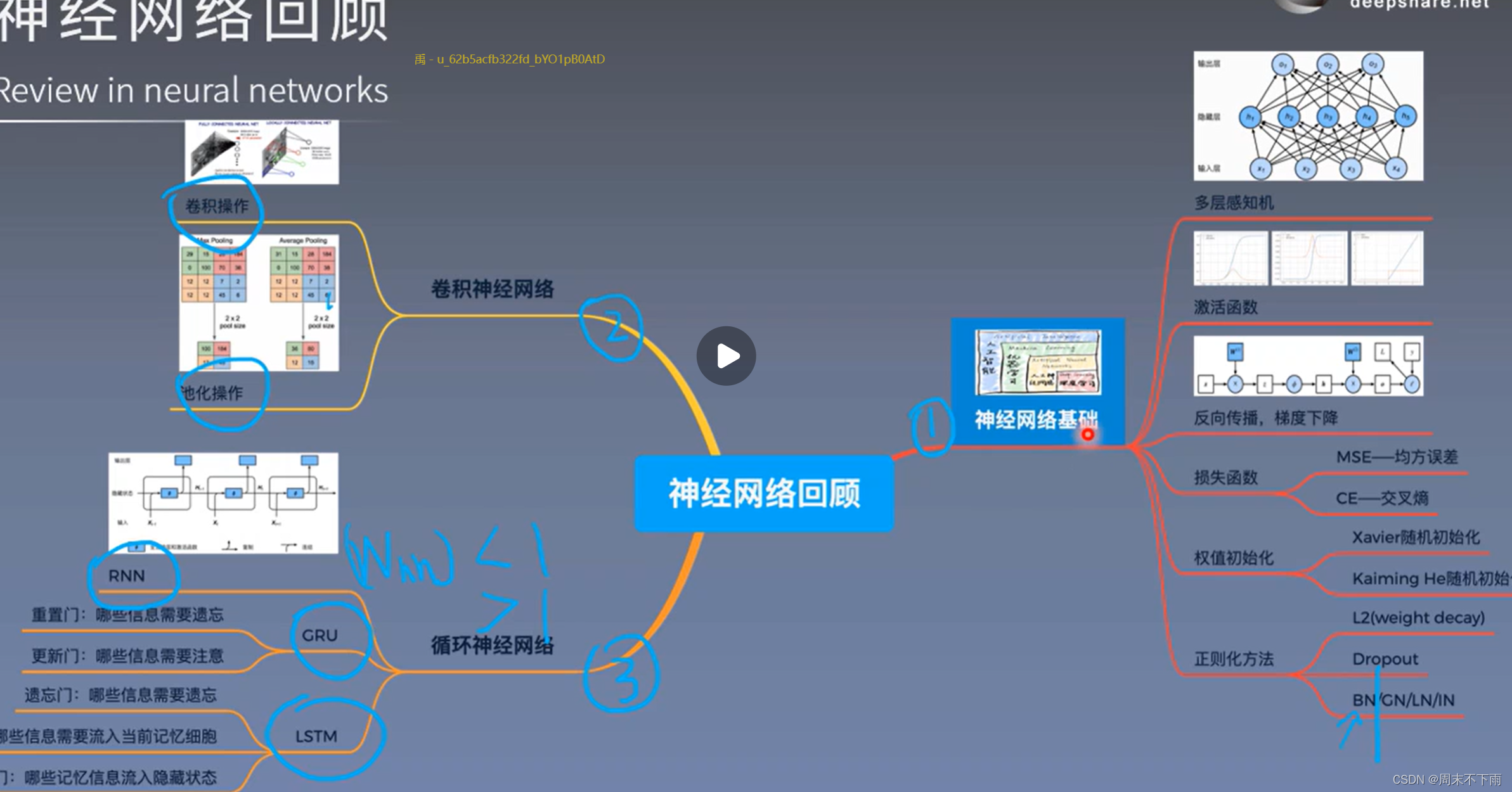

- 七、回顧

一、 學習目標

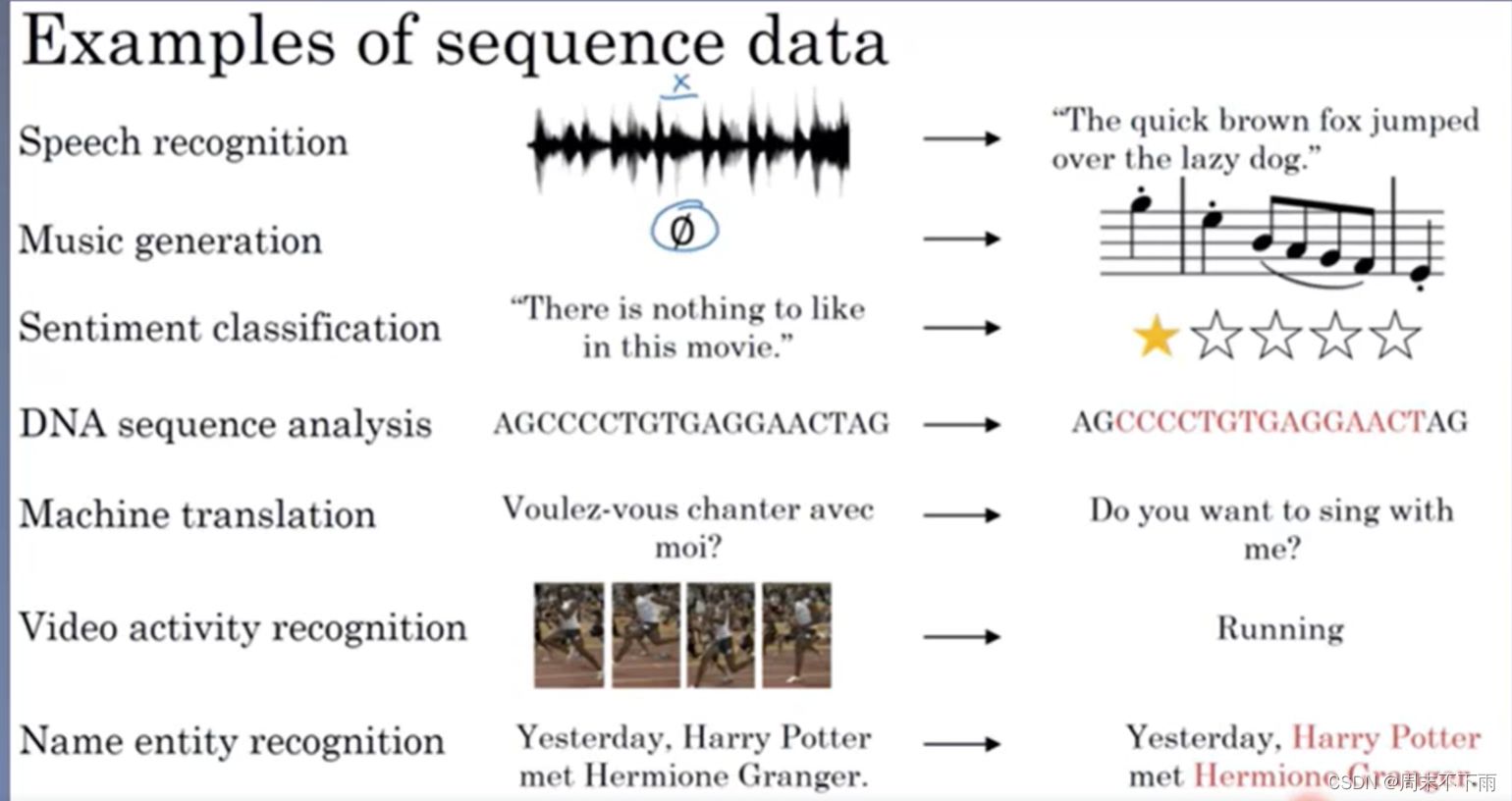

二、序列數據

序列數據是常見的數據類型,前后數據通常具有關聯性

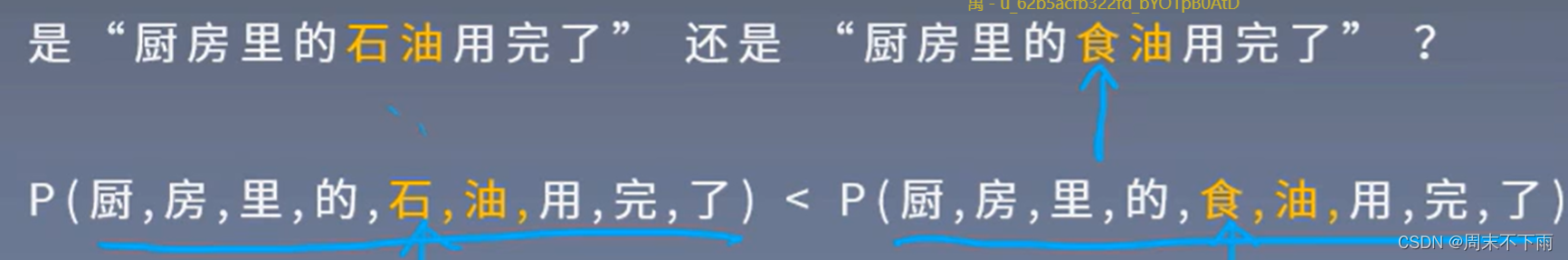

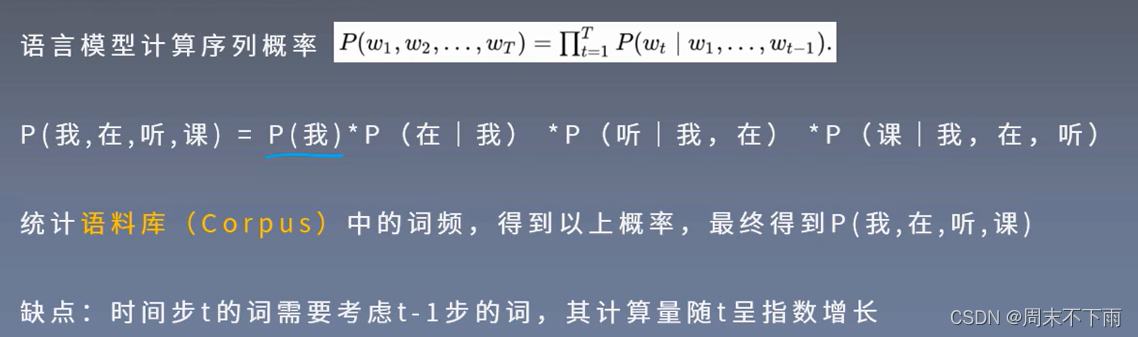

三、語言模型

綜合考慮序列數據的關聯性

如果句子里面的字數一多,那么計算量就會非常大。

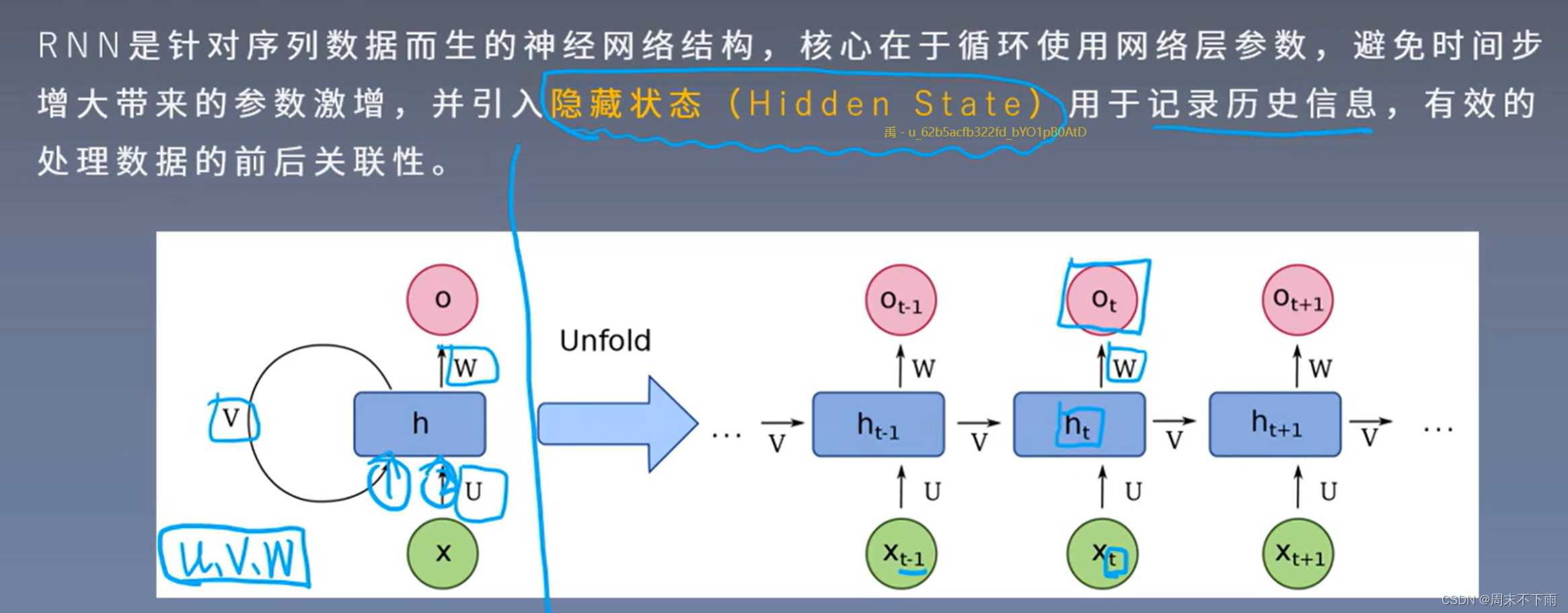

四、循環神經網絡

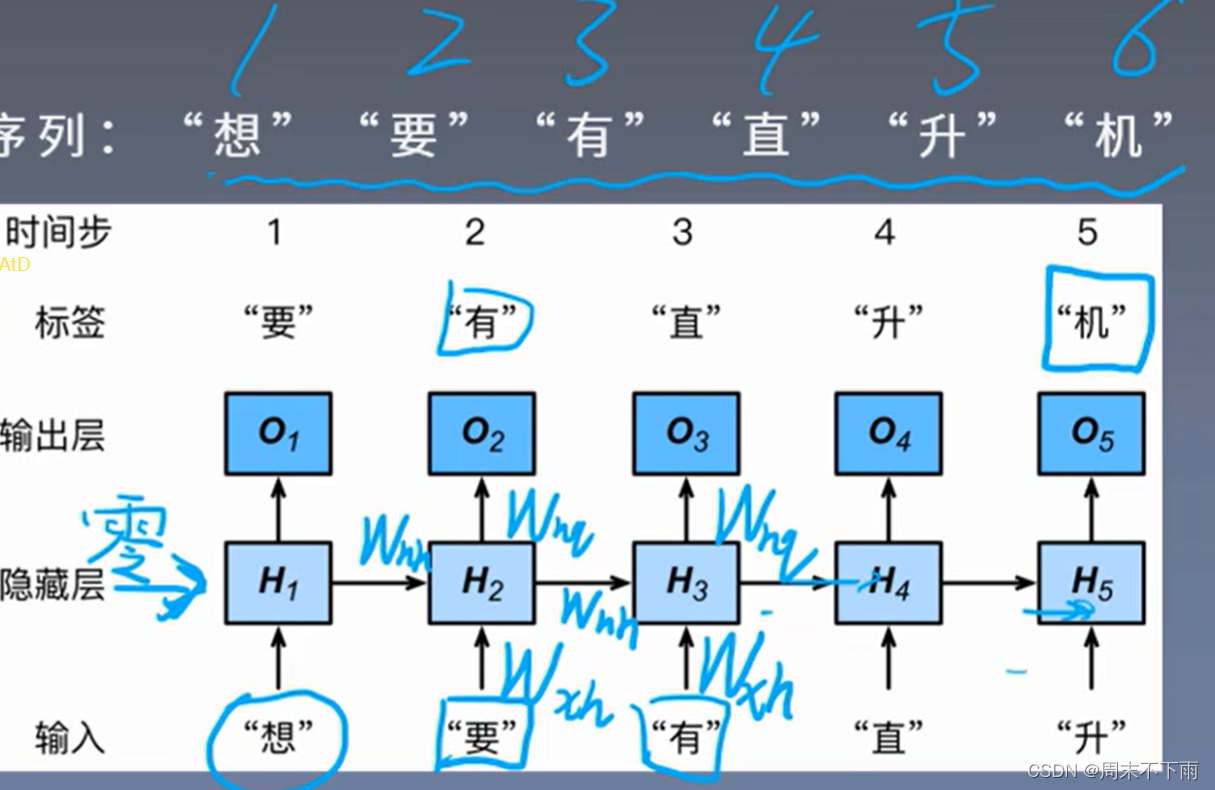

上一個的時間步的隱藏布,會對下一個的時間步的隱藏布產生影響。

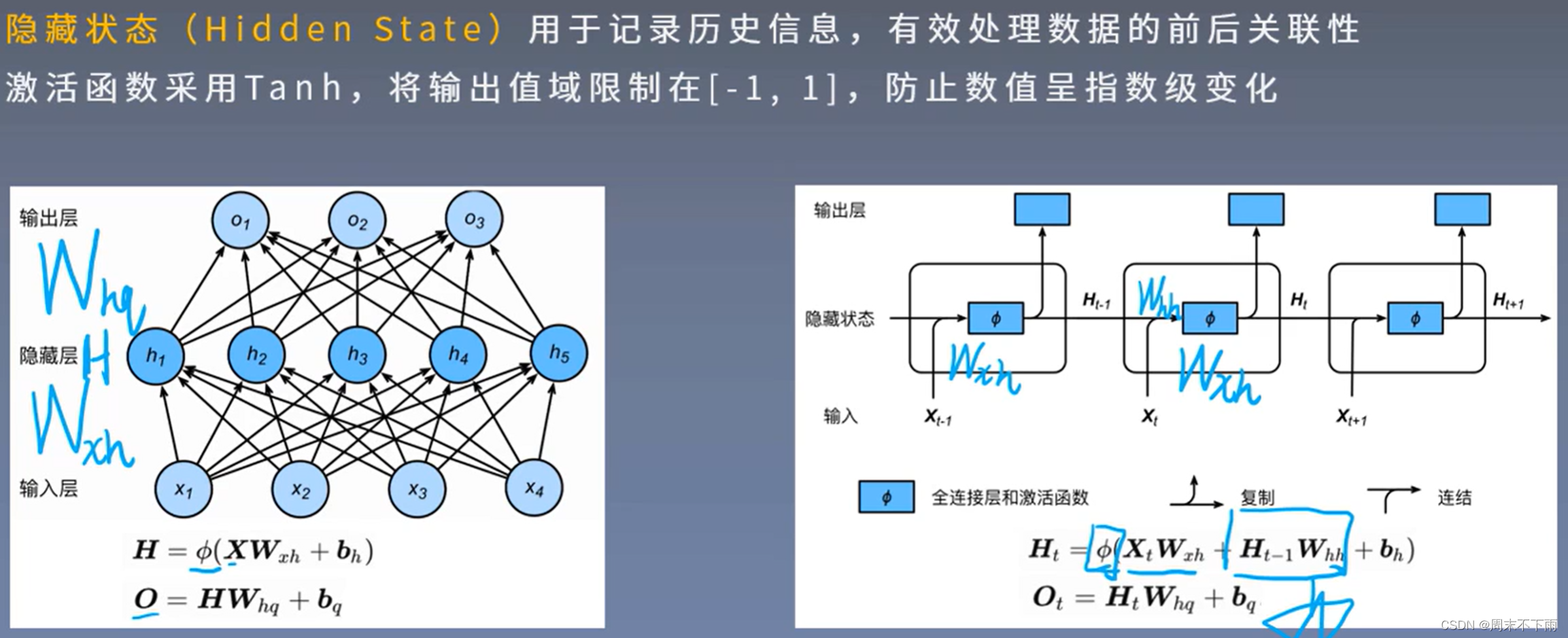

多層感知機和循環神經網絡

循環神經網絡會記錄歷史信息。W權重矩陣是循環使用的,(Wxh、Whh、Whq)這三個是不會變化的

- 循環神經網絡的隱藏狀態可以捕捉截至當前時間步的序列的歷史信息

- 循環神經網絡模型參數的數量不隨時間步的增加而增長

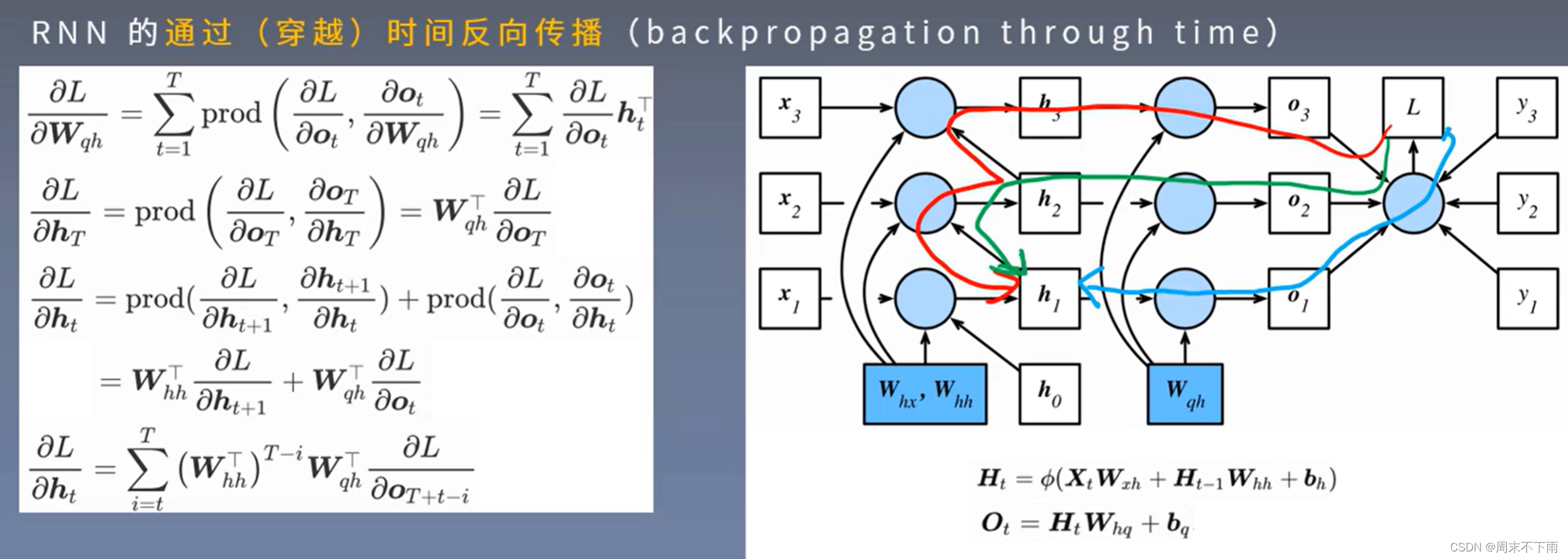

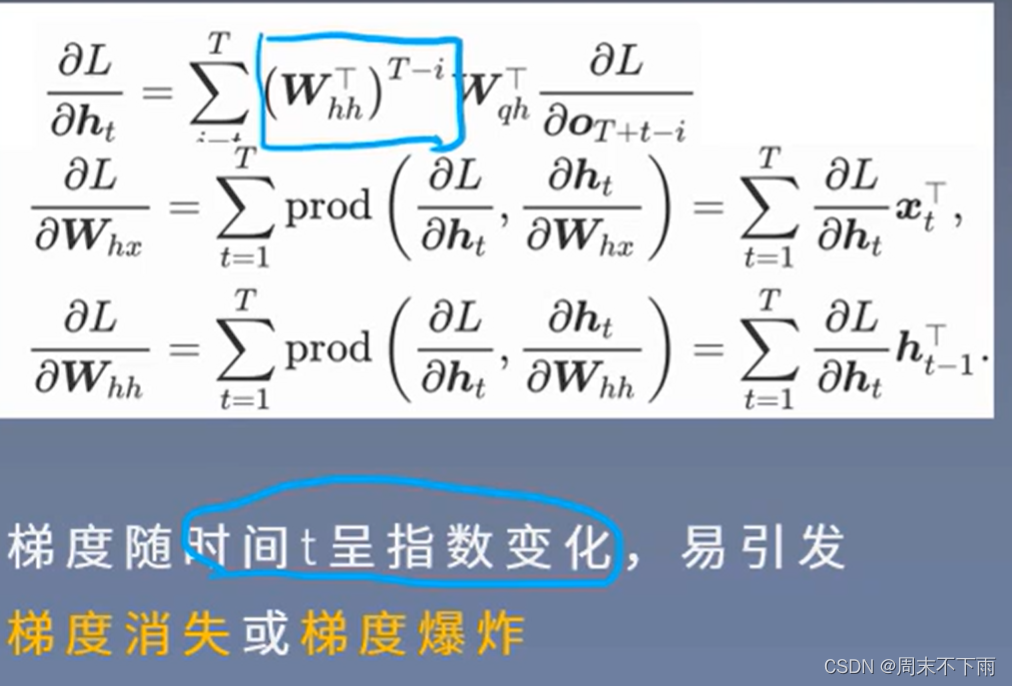

4.1 RNN的反向傳播

也稱穿越時間的反向傳播

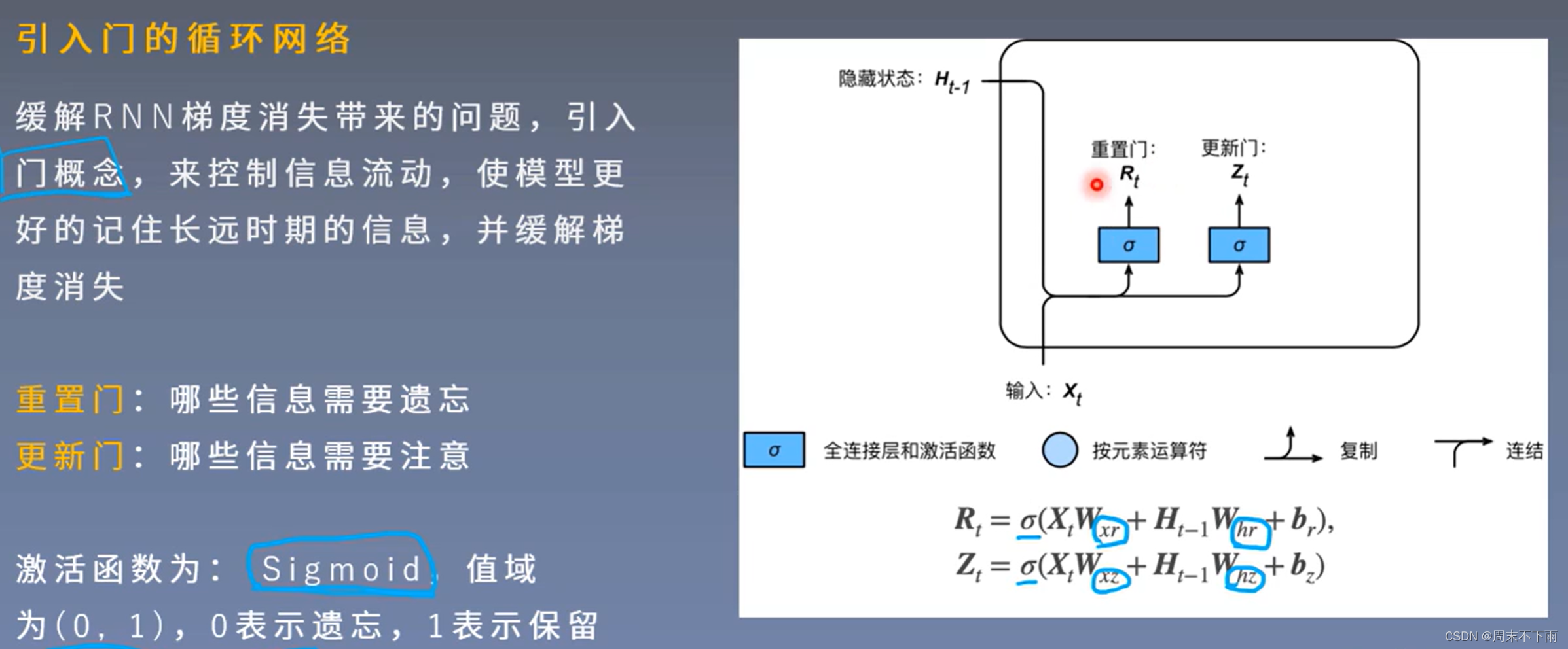

五、門控循環單元-GNU

引入門的原因:防止梯度消失

有重置門、更新門。使用激活函數Sigmoid進行判決

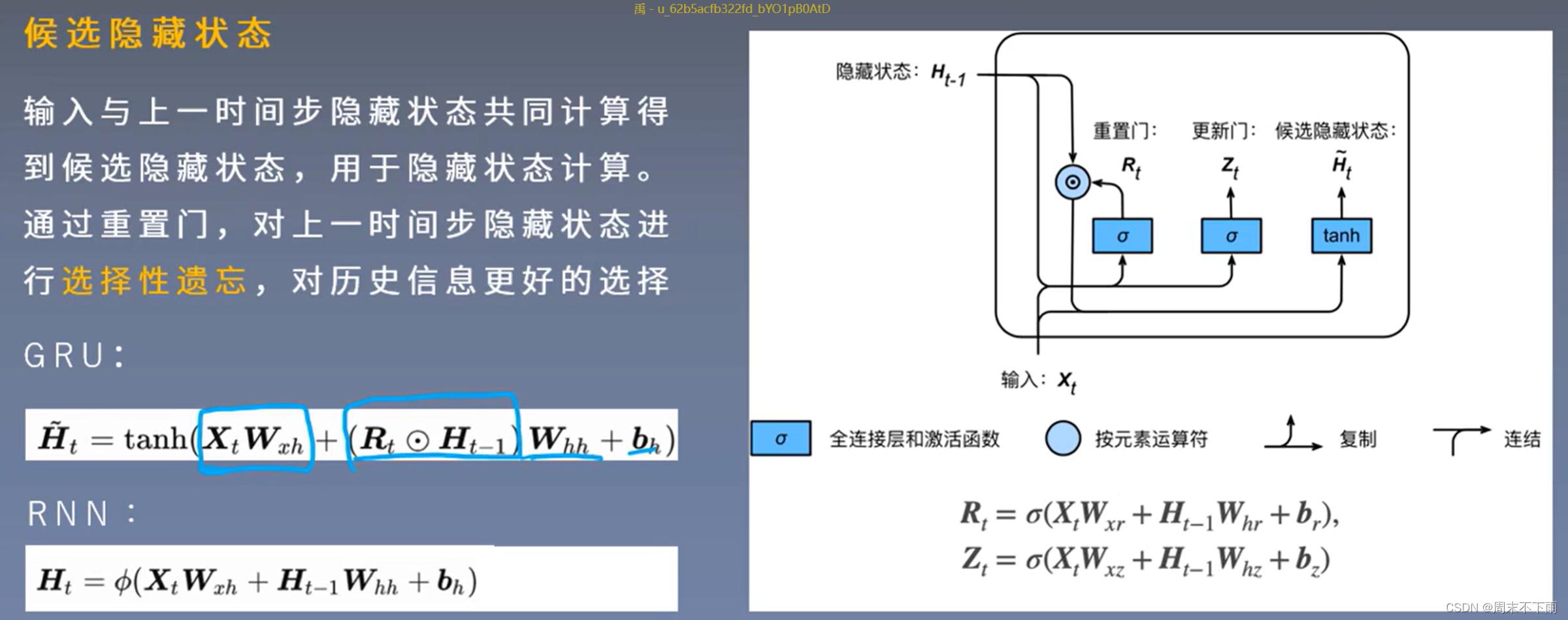

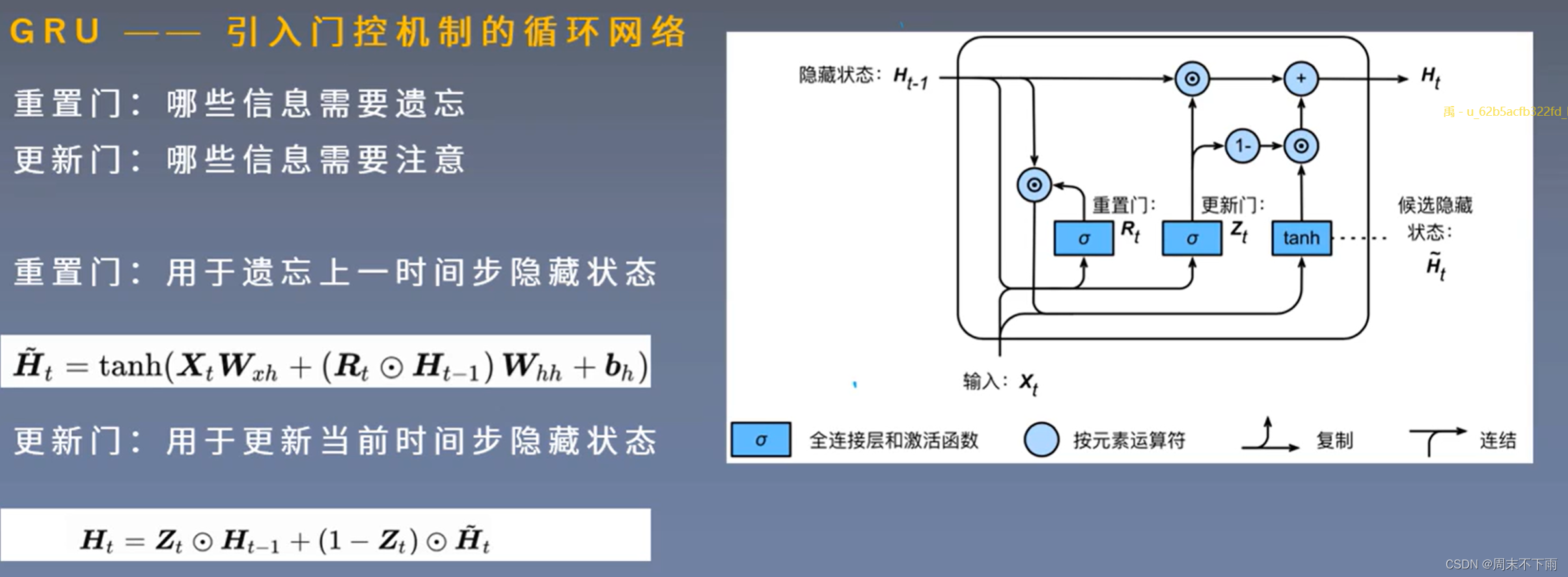

5.1 候選隱藏狀態

與RNN相比,可以判斷是否需要上一個時間布的隱藏狀態,從而得出候選隱藏狀態。

之后候選隱藏狀態與更新門相連接,最后得出下一個隱藏狀態

重置門用于候選隱藏狀態計算過程當中用來控制上一時間步控制隱藏狀態要遺忘哪些信息。

更新門更新當前時間步隱藏狀態的時候去組合上一時間步隱藏狀態H_t-1以及當前時間步的候選隱藏狀態H^~這樣進行組合,得到H_t

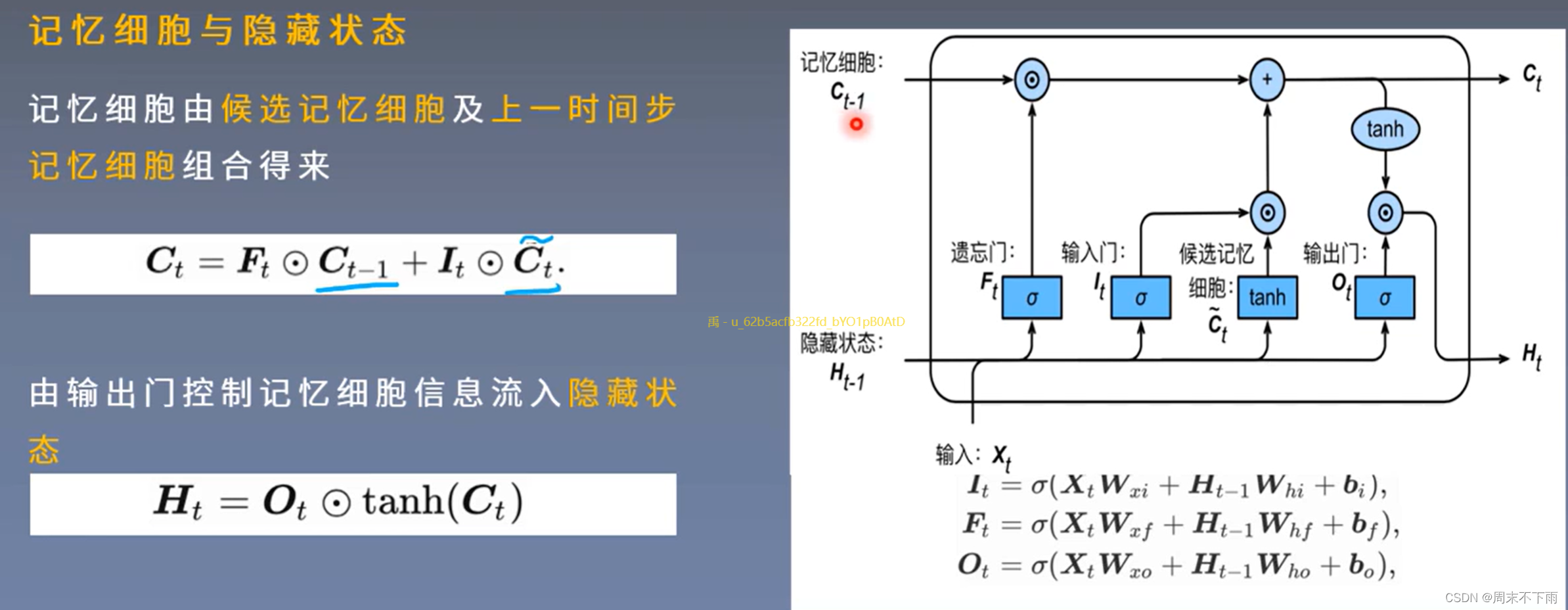

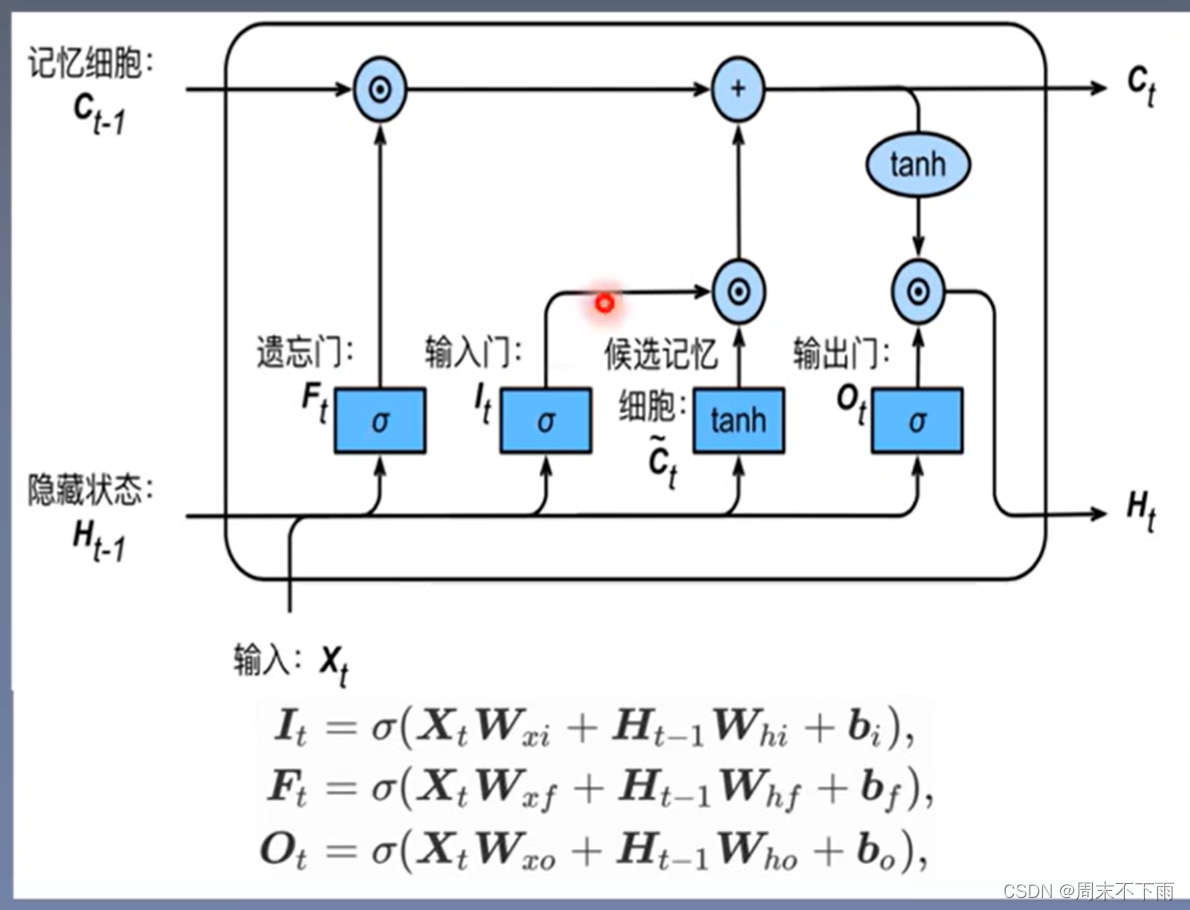

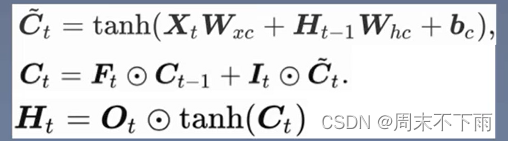

六、長短期記憶網絡-LSTM

個人理解就是長期記憶就是依賴于記憶細胞

主要記住上面這個示意圖就能理解LSTM了。

七、回顧

其中BN后面幾個都是BN的推廣。BN會在baseline里面講到

其核心線程數等參數的可調整性)

java#springboot#mysql校園醫院預約掛號系統32236-計算機畢業設計項目選題推薦)

基礎知識1——命令行入門知識)

)

是什么?有什么用?)