2024年5月13日,OpenAI 在官網正式發布了最新的旗艦模型?GPT-4o

它是一個?多模態模型,可以實時推理音頻、視頻和文本。

* 發布會完整版視頻回顧:https://www.youtube.com/watch?v=DQacCB9tDaw

GPT-4o(“o”代表“omni”,意為“全能”)是邁向更自然的人機交互的一大進步——它能夠接受任意組合的文本、音頻和圖像作為輸入,并輸出各種組合的文本、音頻和圖像。

它能夠在232毫秒內對音頻輸入作出響應,平均響應時間為320毫秒,與人類在對話中的響應時間相近。

在英文和代碼方面,它與GPT-4 Turbo的性能相當,而在非英文語言的文本方面有著顯著的提升。

此外,它在API方面不僅更快,而且成本降低了50%。與現有模型相比,GPT-4o在視覺和音頻理解方面表現尤為出色。

* GPT-4o發布會前的預熱視頻

在這個發布會前的預熱視頻中,OpenAI的員工拿著手機拍攝周圍的場景,GPT-4o非常快就提供了對周圍環境的描述。接著員工讓GPT-4o猜測今天要做什么,它說可能會與OpenAI有關,例如舉辦發布會之類的。

當員工提到這個發布會與“你”有關時,GPT-4o的回答讓人有些驚訝,它竟然表現出人類般的 驚訝?和 停頓,這是 以往任何語音助手都沒有的技術特征。

曾于2013年獲得奧斯卡最佳原創劇本的電影《Her》中,就展現了一場人與AI的愛恨糾葛,而11年后的今天,無所不能的“Her”已經由GPT-4o變成了現實,從今天起我們每個人都能擁有一個“Her”!

01

GPT-4o功能展示

* 以下為部分功能展示,之后我們將在視頻號上公布GPT-4o的功能展示合輯,歡迎大家關注!

值得一提的是,在第四個展示案例中,家長要求GPT-4o?不要直接告訴答案,而是像名師一般,“授之于魚,不如授之于漁”并逐步?引導學生自我思維并最終學會解題思路?的方式。

02

GPT-4o功能評估

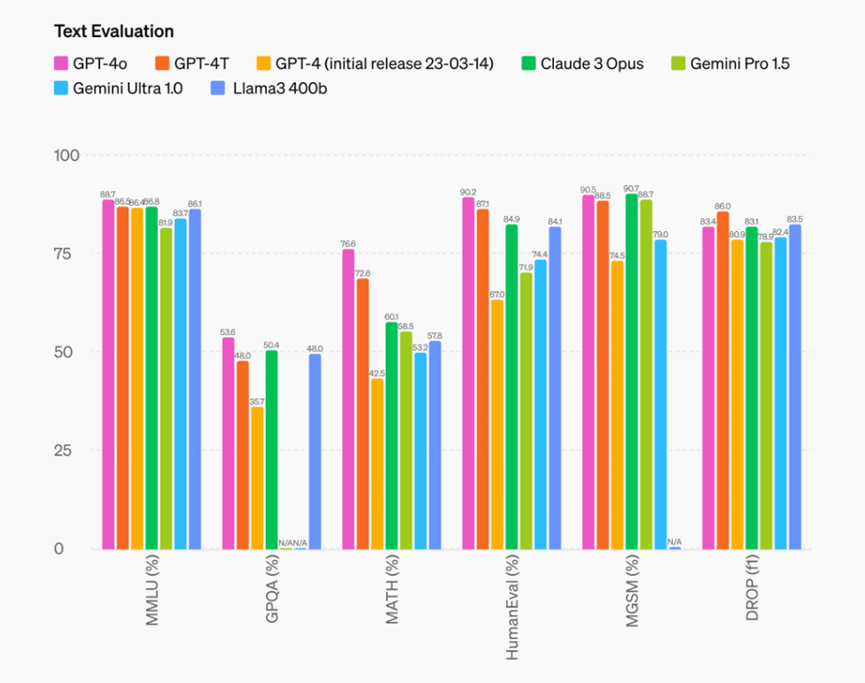

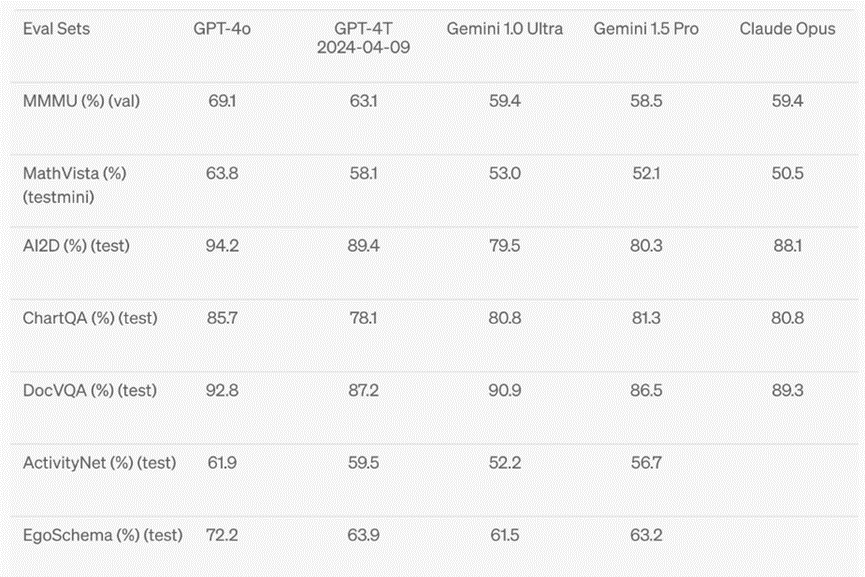

在傳統基準測試中,GPT-4o 在文本、推理和編碼智能方面實現了與 GPT-4 Turbo 相當的性能,同時在多語言、音頻和視覺能力方面設立了新的高水平標桿。

1、文本性能

提升的文本推理能力:GPT-4o在MMLU上取得了 88.7% 的新高分,超過了包括Claude 3 Opus、Gemini Pro 1.5、Gemini Ultra 1.0、Llama3 400b等目前市面上著名大模型。

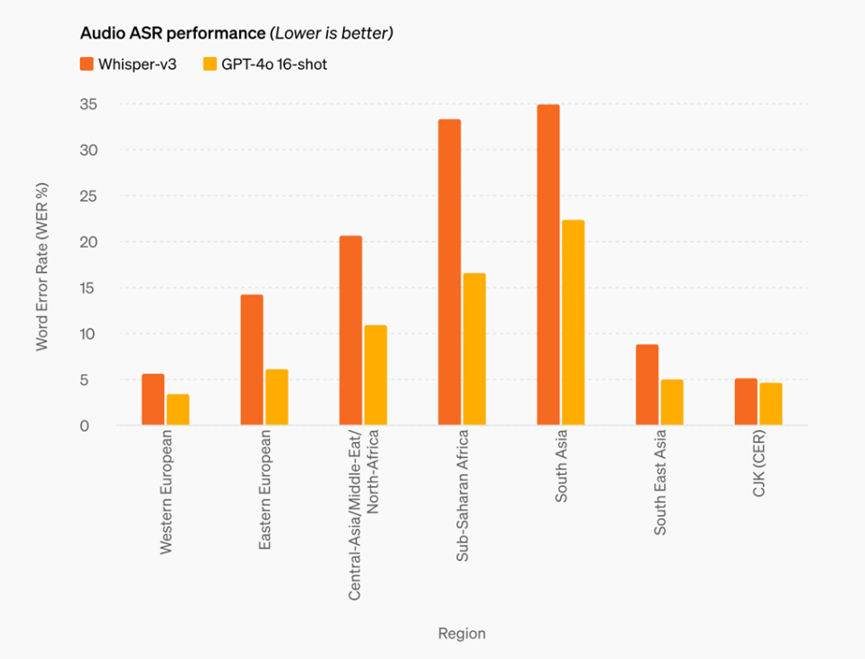

2、音頻ASR性能

音頻ASR性能:GPT-4o 在所有語言上顯著提高了與Whisper-v3的語音識別性能,特別是對于資源較少的語言。

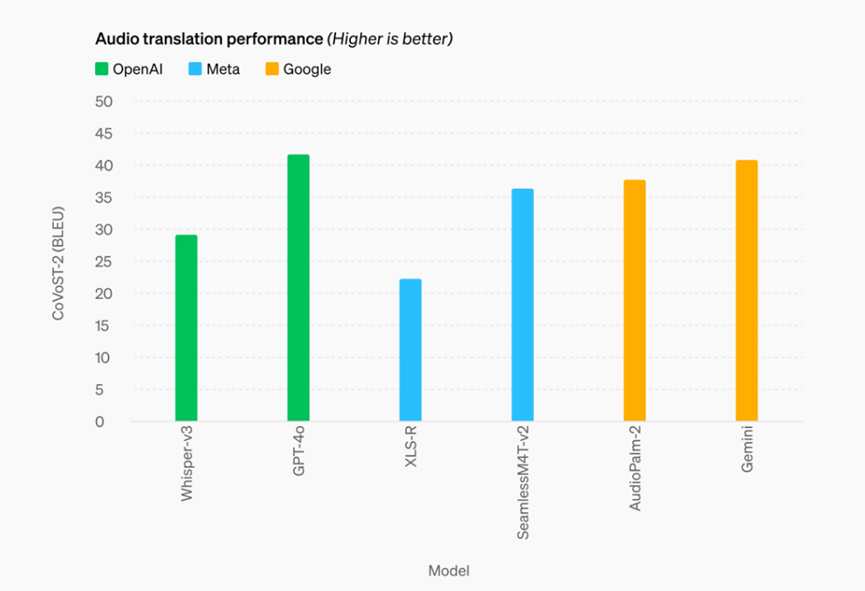

3、音頻翻譯性能

音頻翻譯性能:GPT-4o 在語音翻譯方面取得了新的?最先進水平,并在MLS基準上優于Whisper-v3。

4、視覺理解評估

視覺理解評估:GPT-4o 在視覺感知基準測試上取得了 最先進的性能。

目前,GPT-4o 的文本和圖像功能已經對ChatGPT開放,不久后,OpenAI將在ChatGPT Plus中推出GPT-4o的語音模式的新Alpha版本。讓我們期待更強大的語音助手出現吧。

--- End ---

歡迎關注微軟?智匯AI?官方賬號

一手資訊搶先了解

喜歡就點擊一下?在看?吧~

)

:二叉樹的使用)

)

-- 系統異步化)

_語音識別)

apidoc 的安裝)

多任務高性能執行聚合)

來保序,對ARM和IA而言,RTE_WMB()的實現有何不同)

/PHP://偽協議繞過)