文章目錄

- window安裝docker-desktop

- 下載和啟動lobe-chat

- AI大語言模型的選擇

- lobe-chat設置大模型連接

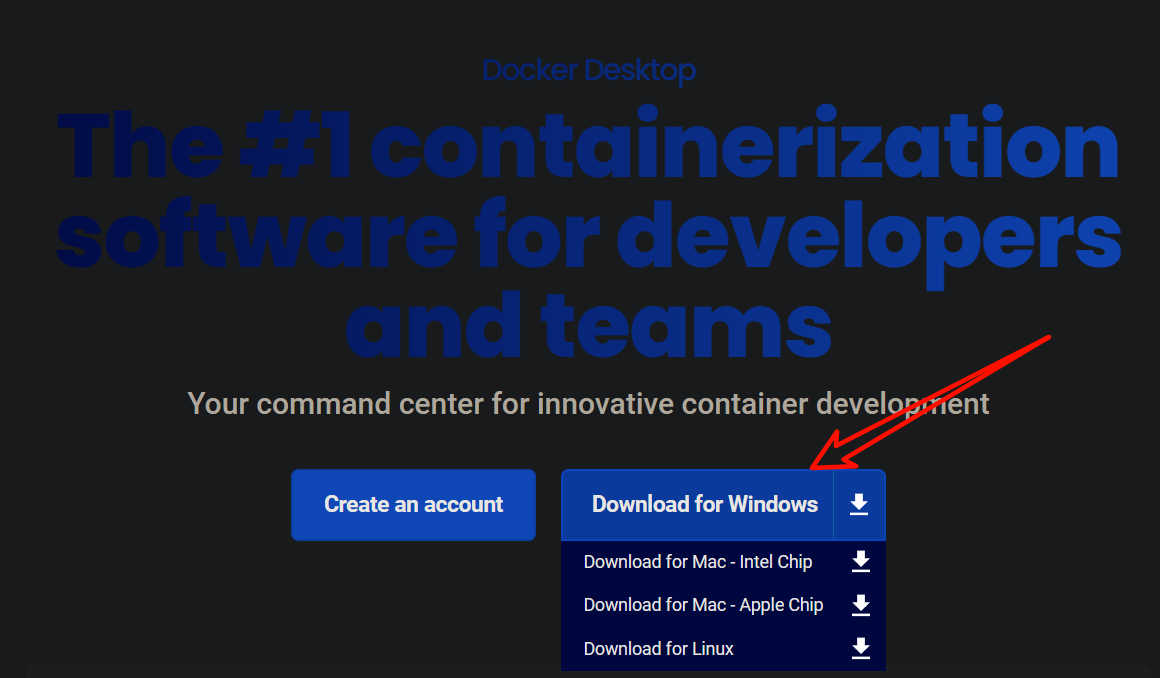

window安裝docker-desktop

- docker-desktop下載地址

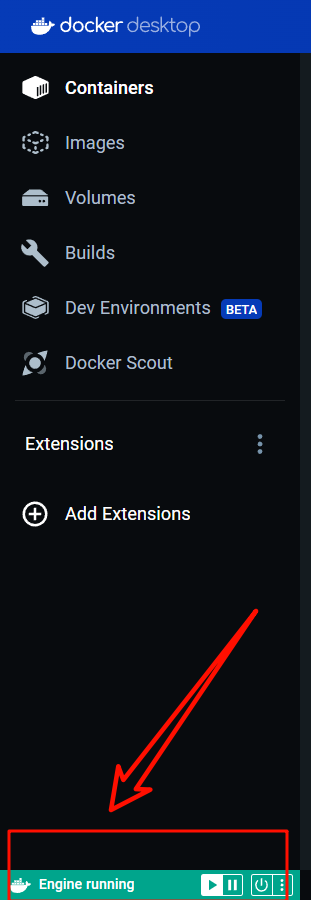

- 正常安裝應用,然后啟動應用,注意啟動docker引擎

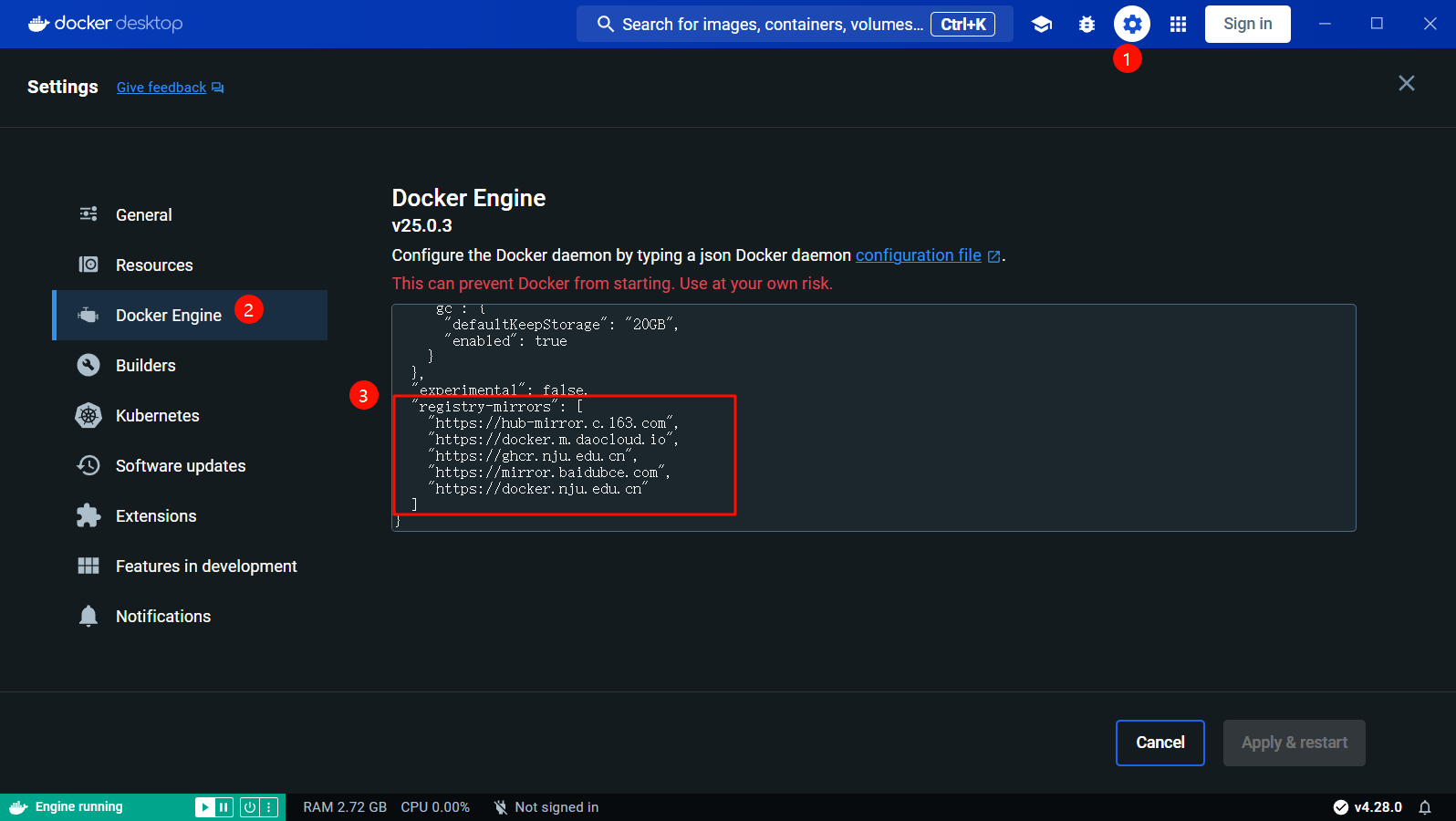

- 打開右上角的設置,進入Docker Engine設置配置鏡像加速地址

- 這里作者的機器配置如下,以供參考,(作者的機器內存比較大一些,所以默認虛擬機內存較大)

{"builder": {"gc": {"defaultKeepStorage": "20GB","enabled": true}},"experimental": false,"registry-mirrors": ["https://hub-mirror.c.163.com","https://docker.m.daocloud.io","https://ghcr.nju.edu.cn","https://mirror.baidubce.com","https://docker.nju.edu.cn"] }

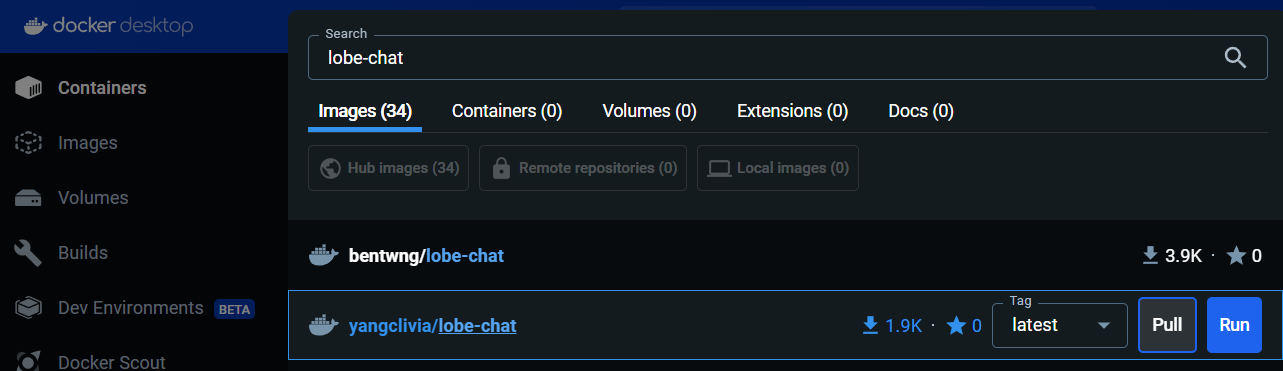

下載和啟動lobe-chat

- 點擊上面中間的搜索框,搜索

lobe-chat,點擊拉取pull

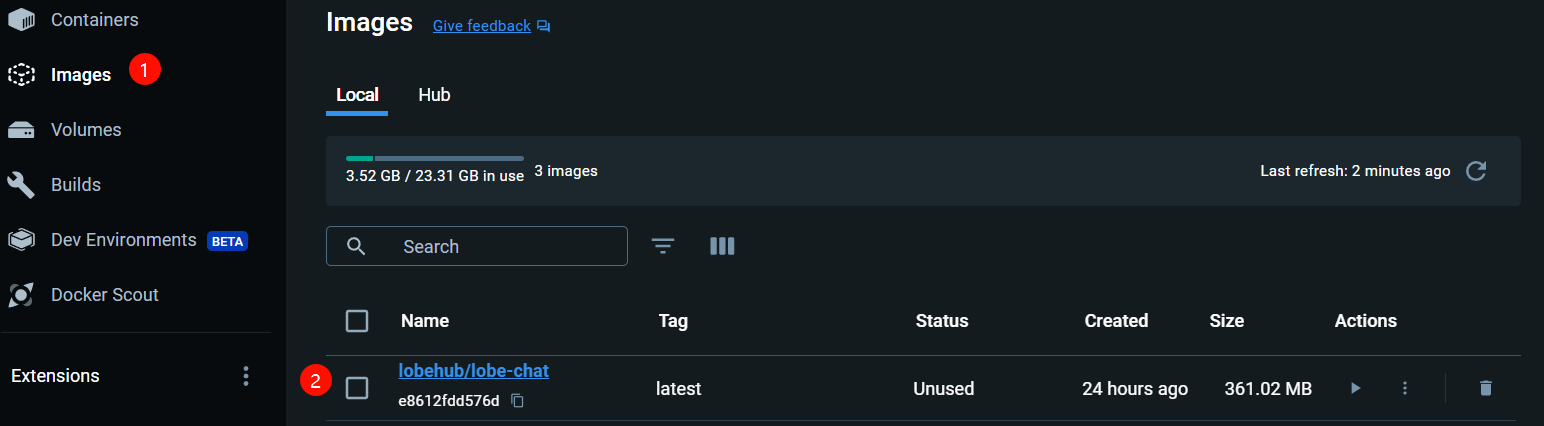

- 拉取成功后,即在

Images中可看到拉取的鏡像文件

Win+R運行窗口,輸入cmd進入終端,輸入以下啟動命令,然后訪問lobe-chat地址http://localhost:3210/- 完整的部署文檔

docker run -d -p 3210:3210 -e OPENAI_KEY=sk-xxx -e ACCESS_CODE=lobe66 --name lobe-chat lobehub/lobe-chat

AI大語言模型的選擇

- AI大語言模型主要分為國外大模型和國內大模型。國外大模型:受限,或者不穩定。國內大模型,穩定,方便。

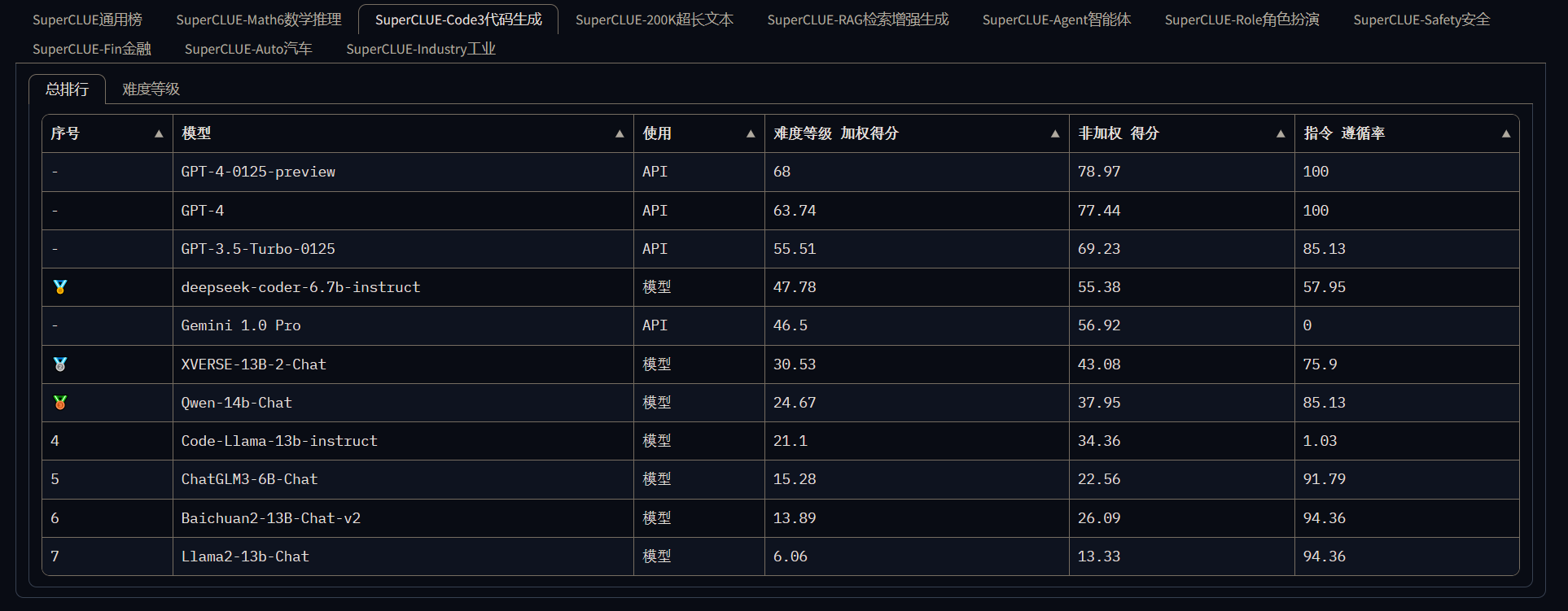

- 國內大模型排行榜:基于中文語言理解測評基準,包括代表性的數據集、基準(預訓練)模型、語料庫、排行榜。選擇一系列有一定代表性的任務對應的數據集,做為測試基準的數據集,這些數據集會覆蓋不同的任務、數據量、任務難度。

lobe-chat設置大模型連接

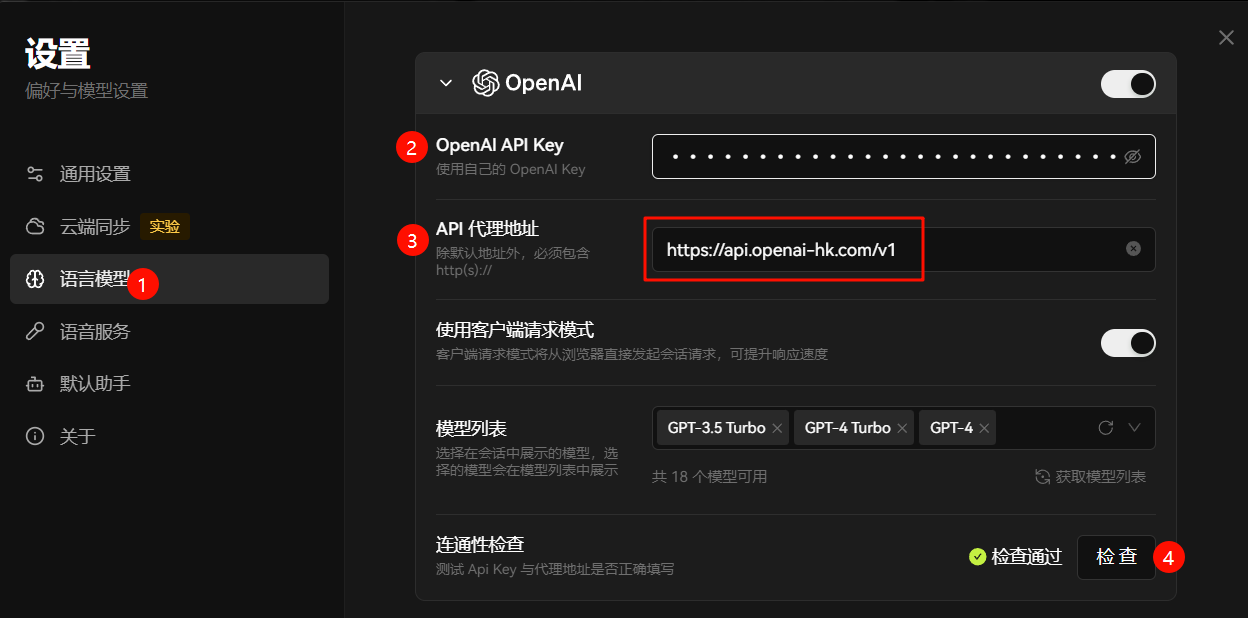

- 在設置中的語言模型中設置OpenAI連接,國內的朋友可以嘗試

openai-hk,然后點擊檢查驗證是否可行

- 注意API代理地址使用

https://api.openai-hk.com/v1

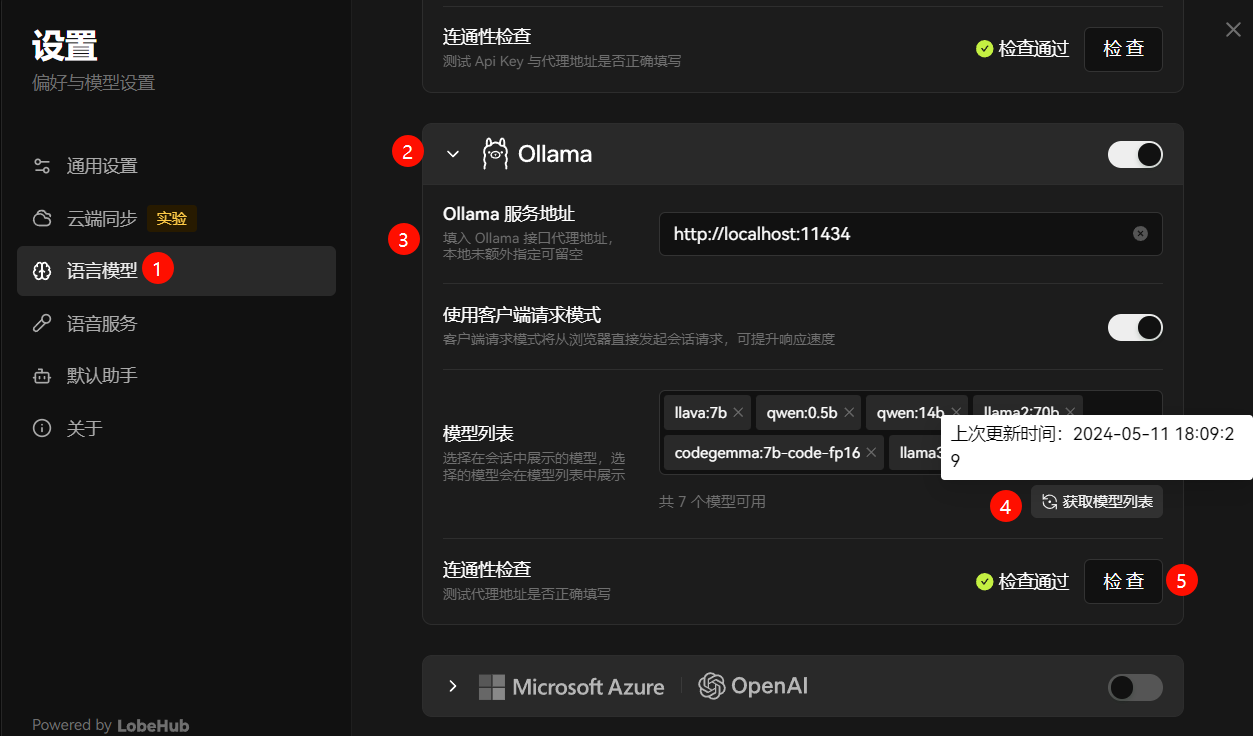

- 本地Ollama大模型服務的連接設置如下,然后點擊檢查驗證是否可行

:區間DP)

)

- 用 C 語言自定義命令)

指南)

)