來gongzhonghao【圖靈學術計算機論文輔導】,快速拿捏更多計算機SCI/CCF發文資訊~

分享一個深度學習領域正在迅速升溫的前沿方向:通用性與魯棒性的深度神經網絡架構創新。隨著大模型在視覺、文本乃至多模態任務中的廣泛應用,體現出深度學習正從高精度走向高可靠、強泛化、跨模態融合的未來趨勢。

本文精選三篇CVPR代表性論文,帶你一覽深度學習范式創新的最新進展與落地思路,助力大家把握研究和應用新機遇。

SURE: SUrvey REcipes for Building Reliable and Robust Deep Networks

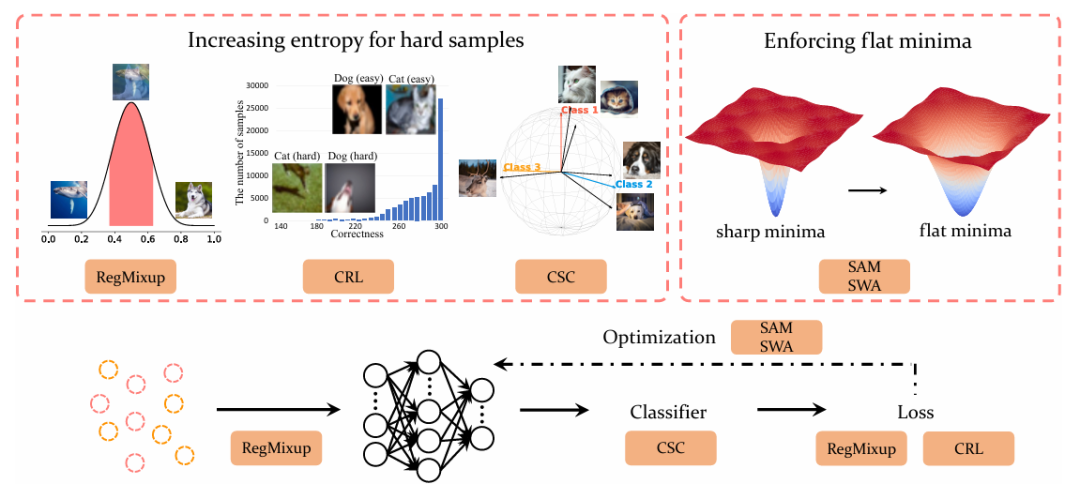

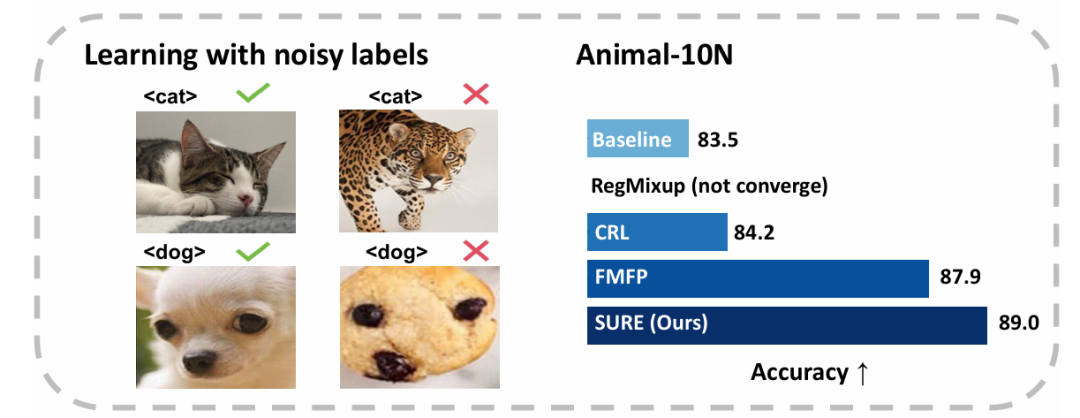

方法:文章首先系統梳理并分析影響深度網絡不確定性表現的關鍵因素,并提出SURE框架將多種不確定性估計技術(如貝葉斯方法、集成學習和校準機制)協同集成。隨后,SURE在訓練階段動態調整模型結構和損失函數,以兼顧準確性和不確定性度量,提升整體魯棒性。最后,作者在多個標準數據集上進行了大規模實驗,證明SURE在不確定性估計準確性、模型穩定性和泛化能力上均優于現有主流方法。

創新點:

首創性地整合多種主流不確定性估計技術,包括貝葉斯深度學習、模型集成和校準方法,在統一框架下協同優化。

設計了分層次、多粒度的評估機制,系統地量化和比較各類方法在不同數據分布和任務場景下的表現。

提出了針對深度網絡脆弱性的新型魯棒性測試標準,有效推動了模型在極端或異常輸入下的可靠性增強。

總結:這篇文章聚焦于提升深度神經網絡在實際環境下的可靠性和魯棒性,通過提出SURE框架,系統性地解決了當前模型在不確定性估計方面存在的準確性不足和穩定性問題,為安全、可信的深度學習應用奠定堅實基礎。

SD-DiT: Unleashing the Power of Self-Supervised Discrimination in Diffusion Transformer

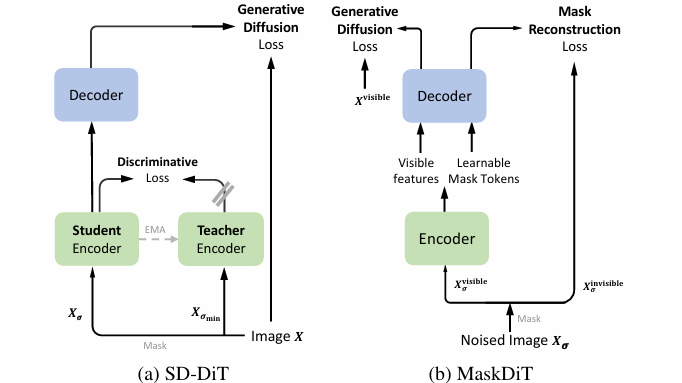

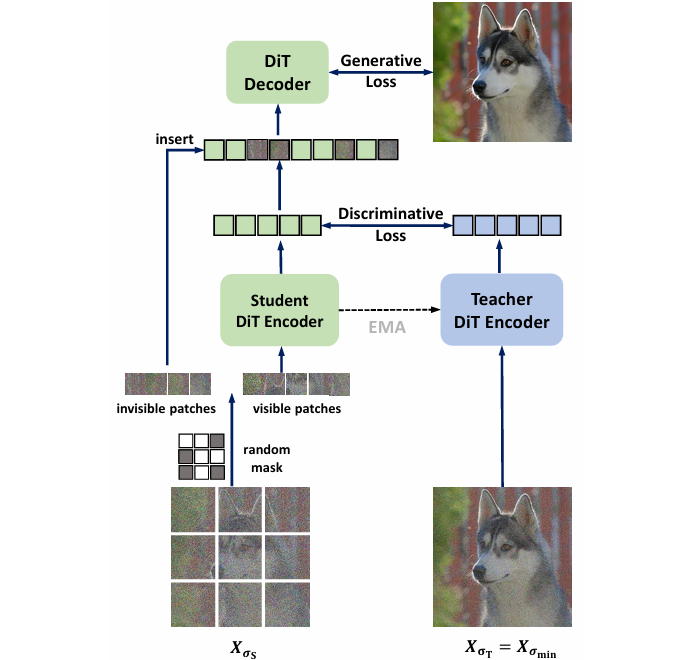

方法:文章首先構建了一個教師-學生判別網絡,通過自監督方式指導學生網絡學習更豐富的特征表示,在擴散過程的每一階段提升生成質量。隨后,作者結合多層次判別信號,將判別損失與原始擴散損失動態融合,從而在訓練過程中實現穩定性與多樣性的雙重提升。最后,SD-DiT在多個主流生成任務和大規模數據集上進行了系統實驗,結果顯示該方法在圖像質量、泛化能力和訓練效率方面均優于現有的擴散Transformer模型。

創新點:

引入教師-學生自監督判別框架,將判別學習融入擴散模型訓練流程,提升生成樣本的分辨率和多樣性。

結合動態自監督目標與分層特征引導,顯著增強了模型對復雜數據分布的適應性和泛化能力。

優化模型架構和訓練策略,在保證高效推理的同時,顯著降低了計算資源消耗。

總結:這篇文章針對當前擴散Transformer(DiT)模型在訓練效率和生成能力上的瓶頸,提出了SD-DiT方法,通過引入自監督判別機制,極大激發了模型在高質量圖像生成和推理上的潛力。

糾結選題?導師放養?投稿被拒?對論文有任何問題的同學,歡迎來gongzhonghao【圖靈學術計算機論文輔導】,獲取頂會頂刊前沿資訊~

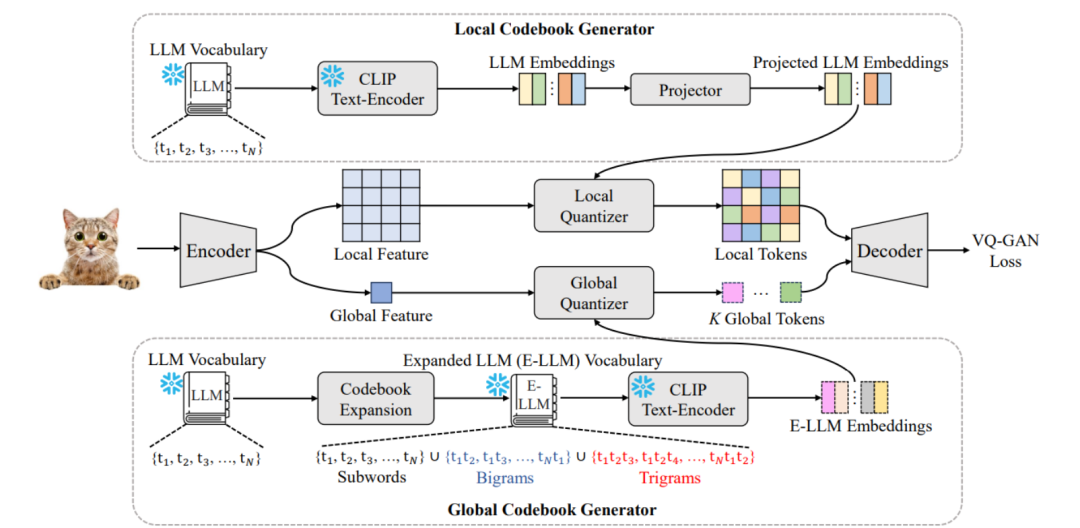

Beyond Text: Frozen Large Language Models in Visual Signal Comprehension

方法:文章首先設計了一種創新的視覺信號編碼器,將原始圖像信息轉化為可被凍結大型語言模型理解的Token序列,保證了語義和細節的完整傳遞。隨后,作者利用凍結的LLM通過自然語言推理機制,對視覺Token進行去噪和修復決策,實現了端到端的無微調視覺任務處理。最后,在多項視覺基準任務上進行實驗,結果顯示該方法不僅簡化了多模態模型訓練流程,還在圖像質量提升和泛化能力上達到了業界領先水平。

創新點:

提出V2T Tokenizer方法,實現了視覺數據到語言模型輸入的高保真映射,使凍結LLM具備視覺感知能力。

展現了無需對語言模型本身進行微調,僅通過前端視覺適配即可完成復雜視覺理解任務,降低了多模態系統的資源成本。

在圖像去噪和修復任務中,首次實現了與專業視覺模型相媲美的性能,驗證了跨模態遷移的可行性與高效性。

總結:這篇文章突破性地探索了如何讓凍結的大型語言模型直接理解和處理視覺信號,通過設計高效的視覺到文本轉換機制,實現了無需微調即可在圖像去噪和修復等任務上展現強大表現,為多模態AI打開了新局面。

關注gongzhonghao【圖靈學術計算機論文輔導】,快速拿捏更多計算機SCI/CCF發文資訊~

)

)

——功能介紹(筆鋒,分頁,縮放,多指,硬件加速等))