運動想象分類學習系列:用于基于腦電圖的運動圖像解碼的多尺度視覺轉換器神經網絡

- 0. 引言

- 1. 主要貢獻

- 2. 方法

- 3. 結果

-

- 3.1 腦電圖數據預處理

- 3.2 解碼性能比較

- 3.3 消融實驗

- 4. 總結

- 歡迎來稿

論文地址:https://ieeexplore.ieee.org/document/10652246

論文題目:MSVTNet: Multi-Scale Vision Transformer Neural Network for EEG-Based Motor Imagery Decoding

論文代碼:https://github.com/SheepTAO/MSVTNet/tree/main

今天介紹一篇有意思的文章,這篇文章在我們自己的數據集下相對于已有的很多方法都達到了一個較高的精度(相對于其它模型有6-8個點的提高)。

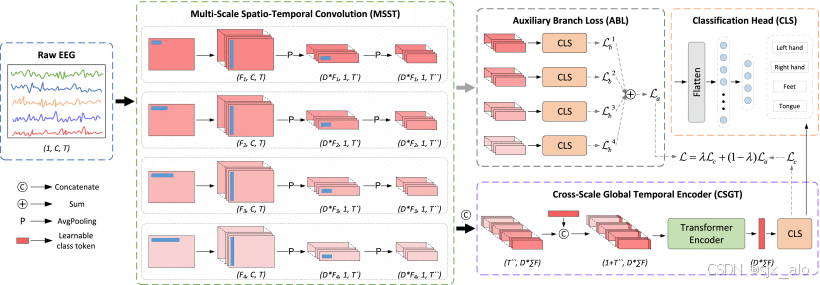

為什么有意思:本質是多尺度的EEGNet+Transformer(對于沒有使用聯合損失而言)。

對比模型:EEGNet、FBCNet、LmdaNet、EEG-Conformer、Labram、Sparcnet。

為什么沒使用更多的最近年來的模型:未開源≈不可用(即使你復現也很難出現效果),所以我們用的基本都是

)