Strong Baseline: Multi-UAV Tracking via YOLOv12 with BoT-SORT-ReID 2025最新無人機跟蹤

自己研一期間的小論文大致上的結構和內容基本上已經完成,到了最后在測試集上測試數據的階段,在跑測試集的時間上就去看一些25年和多目標跟蹤的領域相關的一些內容。掌握一些前言的內容,也可以為之后的實驗和后續的工作提高一些baseline去使用。

熱紅外視頻中多無人機的檢測和跟蹤是一個具有挑戰性的問題,因為目標的對比度低、環境噪聲大、目標尺寸小。

自己所做的論文存在的比較困難的一個地方就是對極小目標的跟蹤上存在困難,檢測器能檢測到,但是提取特征上存在困難。

摘要

文章本身的創新性上感覺參考的價值不大,主要是集中在了從之前使用比較多的YOLOX上轉換到了使用最新的YOLO12的模型來進行替換,整個代碼中yolo12的使用是更有參考價值的。

提出了一個基于YOLOv 12和BoT-SORT的跟蹤框架,而不是依賴于帶有DeepSORT管道的YOLOv5

與傳統的RGB圖像相比,熱紅外視頻具有許多優勢,例如在低光照和惡劣天氣條件下增強了能見度,使其成為安全和監控應用的理想選擇。

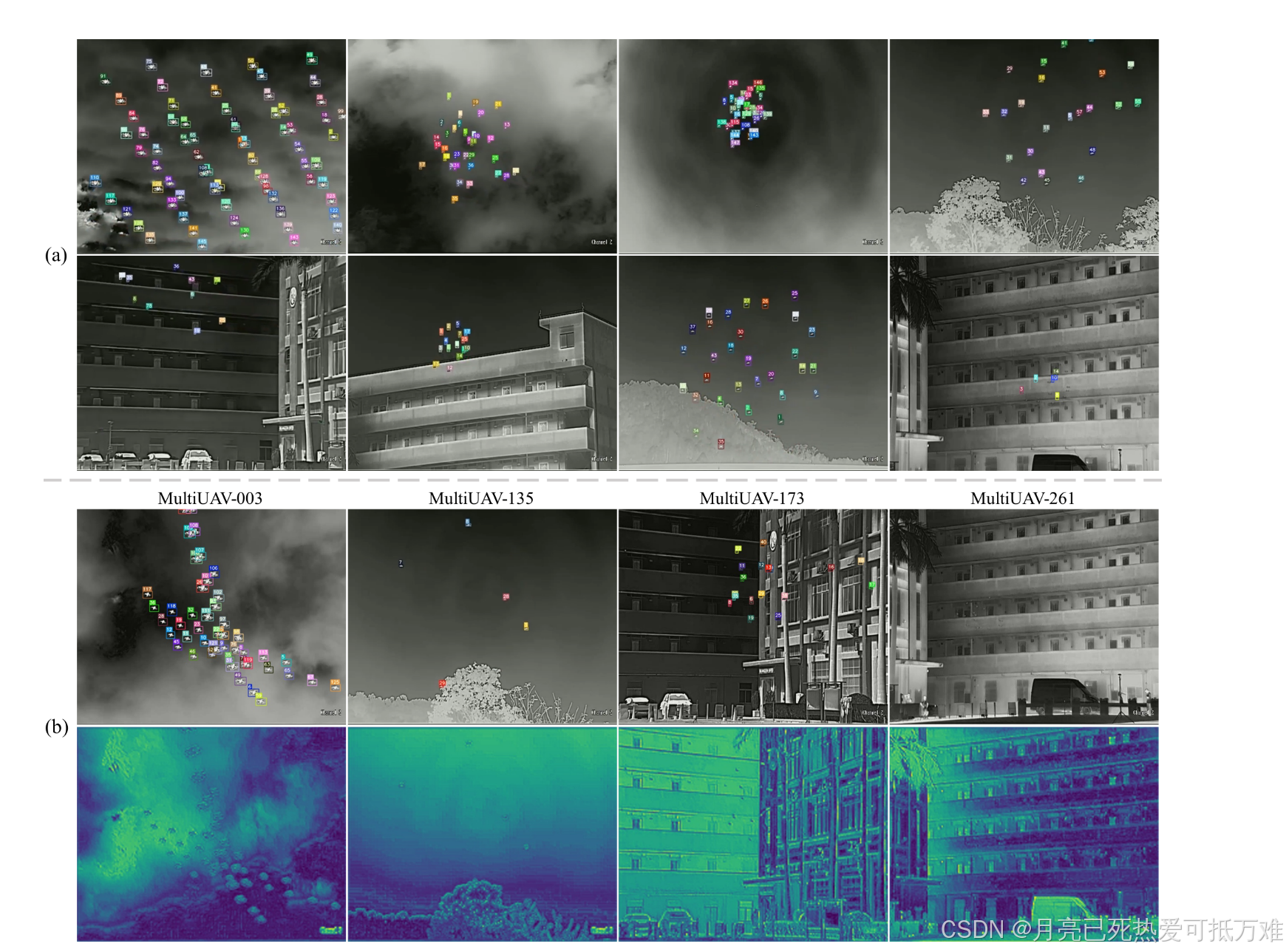

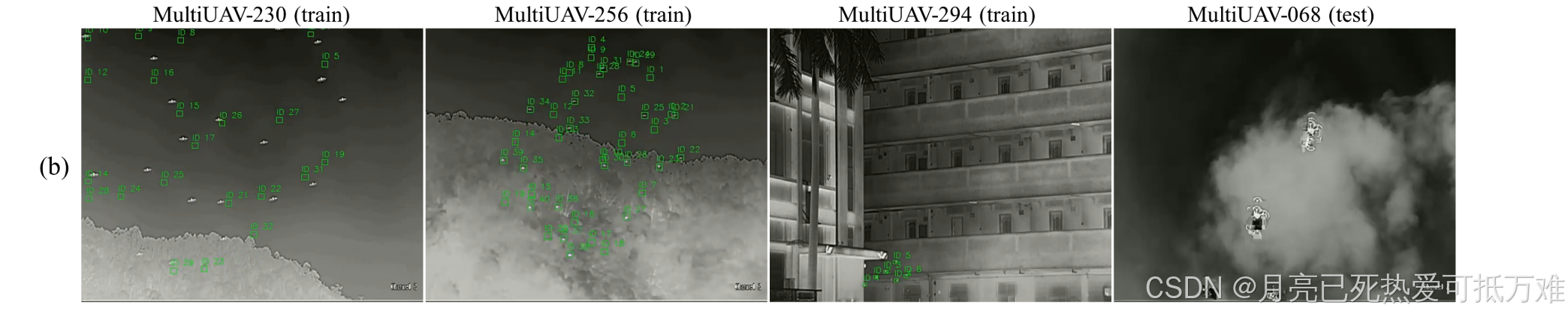

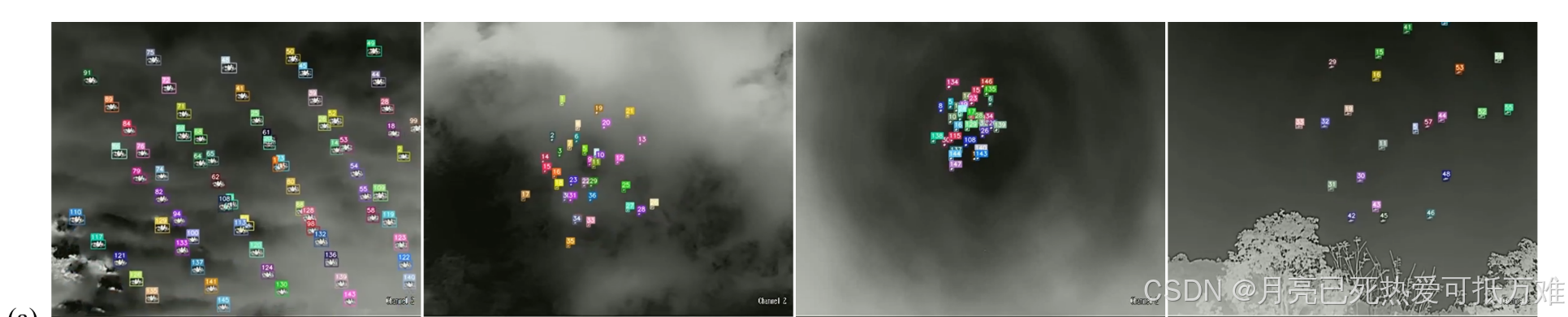

這里論文中給出的圖片信息應該就是熱紅外視頻的跟蹤方法。

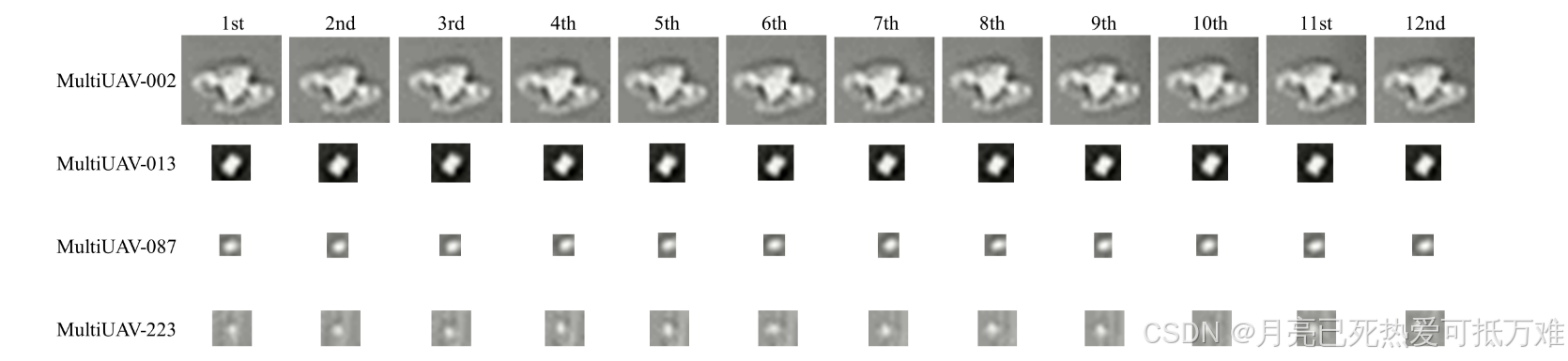

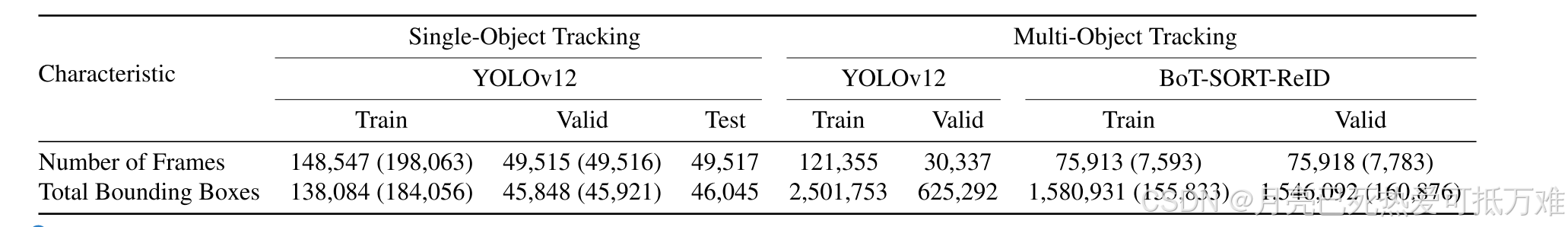

下面的圖像就說明了:從訓練集中的邊界框注釋中裁剪的圖像塊,說明了UAV的不同大小,從幾個像素到個位數像素。我們通過利用最新的YOLOv 12 探測器和BoT-SORT 跟蹤算法構建了一個完整的無人機跟蹤工作流程,其性能優于成熟的YOLOv 5 與DeepSORT的組合。

將文章主要的創新點總結如下:

-

我們建立了一個基于YOLOv 12和BoT-SORT的多無人機跟蹤工作流程,為基于熱紅外視頻的多無人機跟蹤任務奠定了堅實的基礎。

-

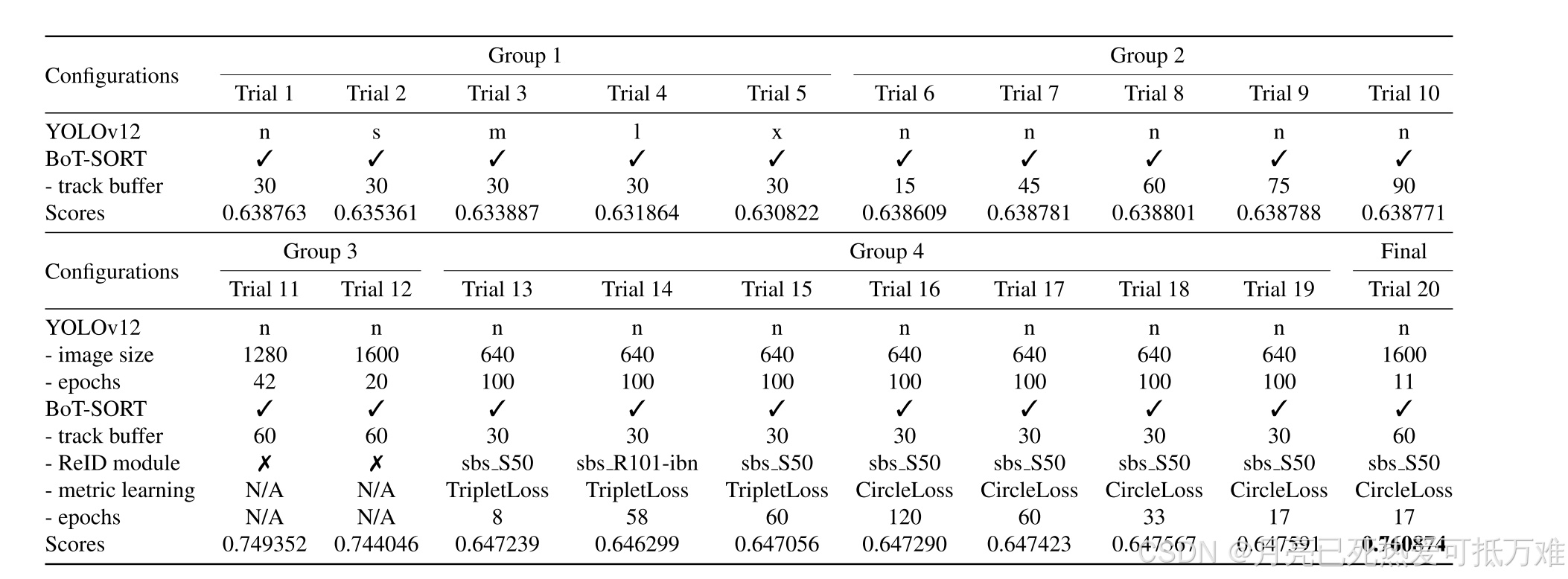

我們對各種試驗調整提供了深入的分析,例如輸入圖像大小和跟蹤器緩沖區調整的影響,并從我們強大的基線開始為未來的改進提供了基本考慮。

感覺這個第二個創新點直觀的看上去我自己水平可能是理解不了,自我感覺是稍微有點水沒提出以些實際有效的模塊或者算法提供出來。

我們的方法通過利用最新的探測器和跟蹤器,設置一個新的基準熱紅外視頻為基礎的無人機跟蹤和指導未來的研究在多無人機跟蹤任務的領域。

Methodology方法論

介紹了主要的檢測模型YOLOv 12和跟蹤算法BoT-SORT,然后詳細介紹了我們的訓練和推理策略。

BOT-SORT對于自己來說是十分熟悉的論文其代碼的形式也是很了解用的比較多。對于最新的YOLO12確實是沒了解過。

- 首先說明了它這個無人機跟蹤算法的主要的三個任務:

挑戰由三個軌道組成,每個軌道對應于不同的場景。航跡1和航跡2是SOT任務,不同之處在于是否給出了UAV的初始位置。航跡3是一個MOT任務,提供了無人機的初始位置。(Single Object Tracking (SOT))

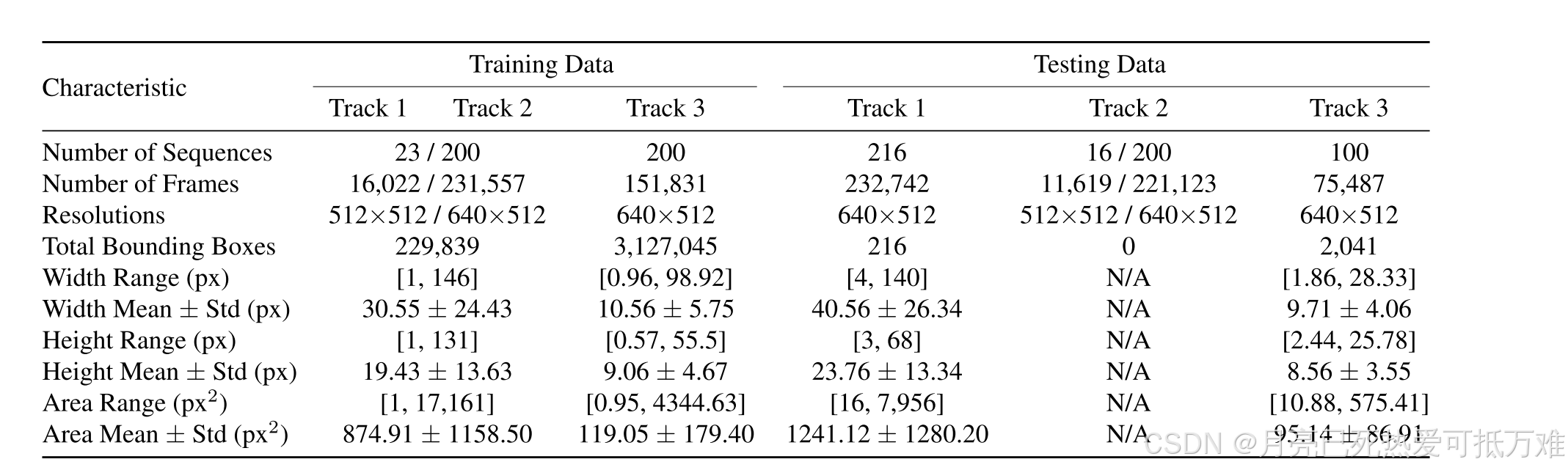

報告了寬度、高度和面積分布,沿著它們的平均值和標準差,為模型超參數調整提供了重要的見解。請注意,與正式發布版本相比,數量可能略有不同,因為我們已刪除了冗余注釋和缺陷案例,如下圖1所示。

后面介紹的主要是實驗訓練和驗證以及設置的一些參數條件。

YOLOv12 with BoT-SORT-ReID for MOT

YOLOv 12因其卓越的上級性能而被選為所有軌道。

YOLOv 12的核心是采用剩余有效層聚合網絡(R-ELAN),該網絡解決了與注意力機制相關的優化挑戰,特別是在大規模模型中。基于ELAN ,R-ELAN引入了具有自適應縮放的塊級殘差設計以及精細的特征聚合策略,以最小的開銷共同促進有效的特征重用和穩定的梯度傳播。

這里自己沒看過YOLO12的論文不做詳細的解釋。

YOLOv12通過將FlashAttention與空間感知模塊相結合,集成了以注意力為中心的架構,從而在保持低延遲的同時增強了上下文建模。引入7×7大核可分離卷積拓寬了感受野并加強了目標定位,特別是對于中小型目標。該架構針對現代GPU內存層次結構進行了優化,在不影響檢測性能的情況下提高了計算效率并縮短了推理時間。這些創新使YOLOv12能夠平衡速度和準確性,使其非常適合實時應用,大規模檢測任務和跟蹤管道。

對BOT-SORT的簡單介紹

BoT-SORT 將卡爾曼濾波器與相機運動補償(CMC)相結合,以在動態條件下穩定跟蹤。CMC通過仿射變換采用全局運動補償(GMC),使用金字塔Lucas-Kanade光流和離群值拒絕跟蹤的圖像關鍵點。

BoT-SORT-ReID通過集成來自四種不同ReID架構的外觀線索來增強多對象跟蹤。Bag of Tricks(Bagtricks)基線采用ResNet-50骨干,具有批量歸一化,三重損失和交叉熵損失,用于魯棒的特征提取。注意力廣義平均池與加權三重損失(AGW)改進。

此外,在ByteTrack [45]之后,具有20幀間隙的線性tracklet插值減輕了遮擋或注釋錯誤的錯過檢測

訓練策略和推理的流程

為了減少YOLOv12檢測器的訓練時間,我們采用了兩階段訓練策略。

- 第一正常的訓練和表中的是一樣的

- 隨后,從這個檢查點開始,我們在MOT數據集或更大的輸入圖像分辨率上微調這些模型。

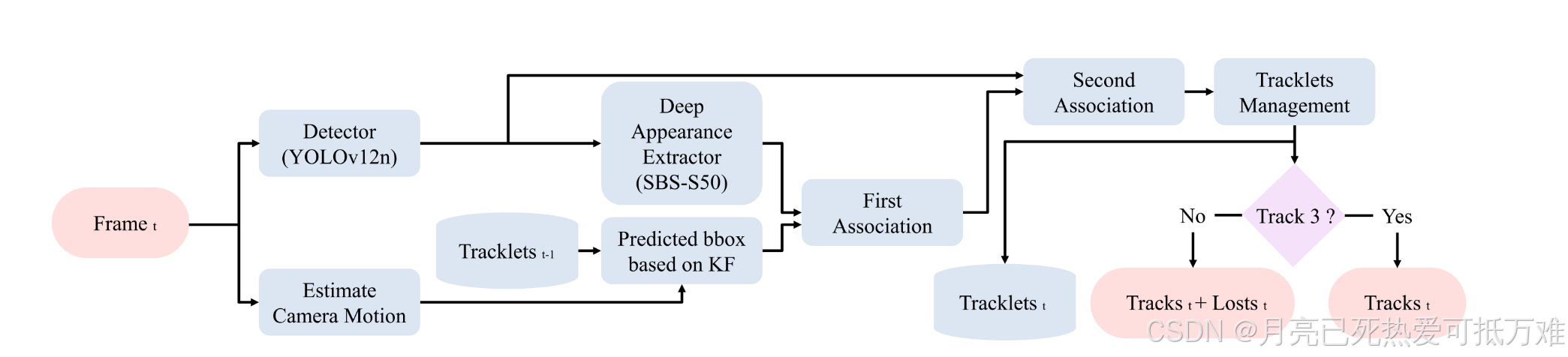

推理工作流程如圖:

帶BoT-SORT-SBS-S50的YOLOv 12 n工作流程圖。該工作流程遵循原始的BoT-SORT,但略有修訂:合并丟失的軌跡以補償無信息幀并提高對象連續性。具體地,對于磁道1和磁道2,丟失的目標信息被用于注釋潛在的對象位置,而磁道3保留BoT-SORT原始輸出。

沒有使用線性軌跡插值,因為由于攝像機運動或快速移動的無人機,ID切換頻繁發生,使得插值對于恢復丟失的檢測無效。相反,對于SOT任務,我們采用的策略基于以下假設:每個幀最多包含一架UAV,并遵循以下優先級順序:

(1)報告在線目標中具有最高置信度得分的UAV,(2)如果沒有在線目標可用,則繼續報告先前ID作為后續跟蹤器緩沖幀中的丟失目標,(3)如果沒有先前ID可用,則報告最后已知位置,直到檢測到新的在線目標。

由于在線和丟失目標之間頻繁的重疊和ID切換,這將導致效果不佳,因此該策略對于MOT任務是不可行的。因此,在本例中,我們保留了Track 3的原始輸出。

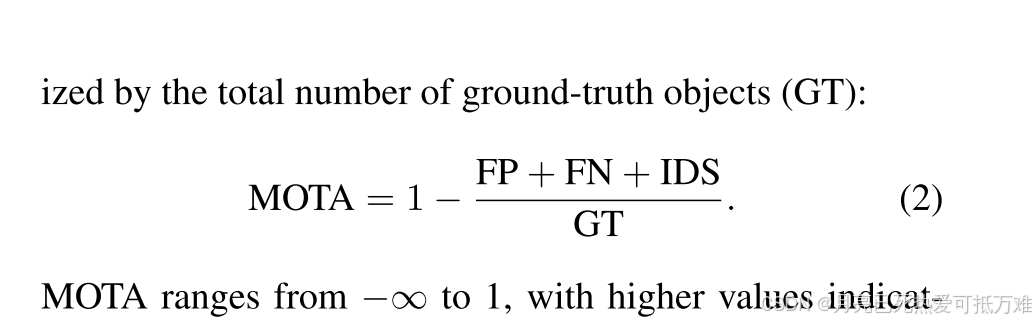

測試的相關指標和MOT17中的指標計算方式上是保持一致的。

最后論文給出的這種應該是類似傳統的消融實驗的結果圖,感覺和其他的一些論文相比較之下缺少和其他一些比較知名算法的對比實驗。

提供的預訓練模型如果是在MOT數據集上訓練的其實對于做傳統的MOT任務的要友好一些,但是代碼中給出的替代YOLOX檢測器的代碼結構還是值得作為后續漲點的一種方式。

https://github.

com/wish44165/YOLOv12-BoT-SORT-ReID

)