目錄

1.前言

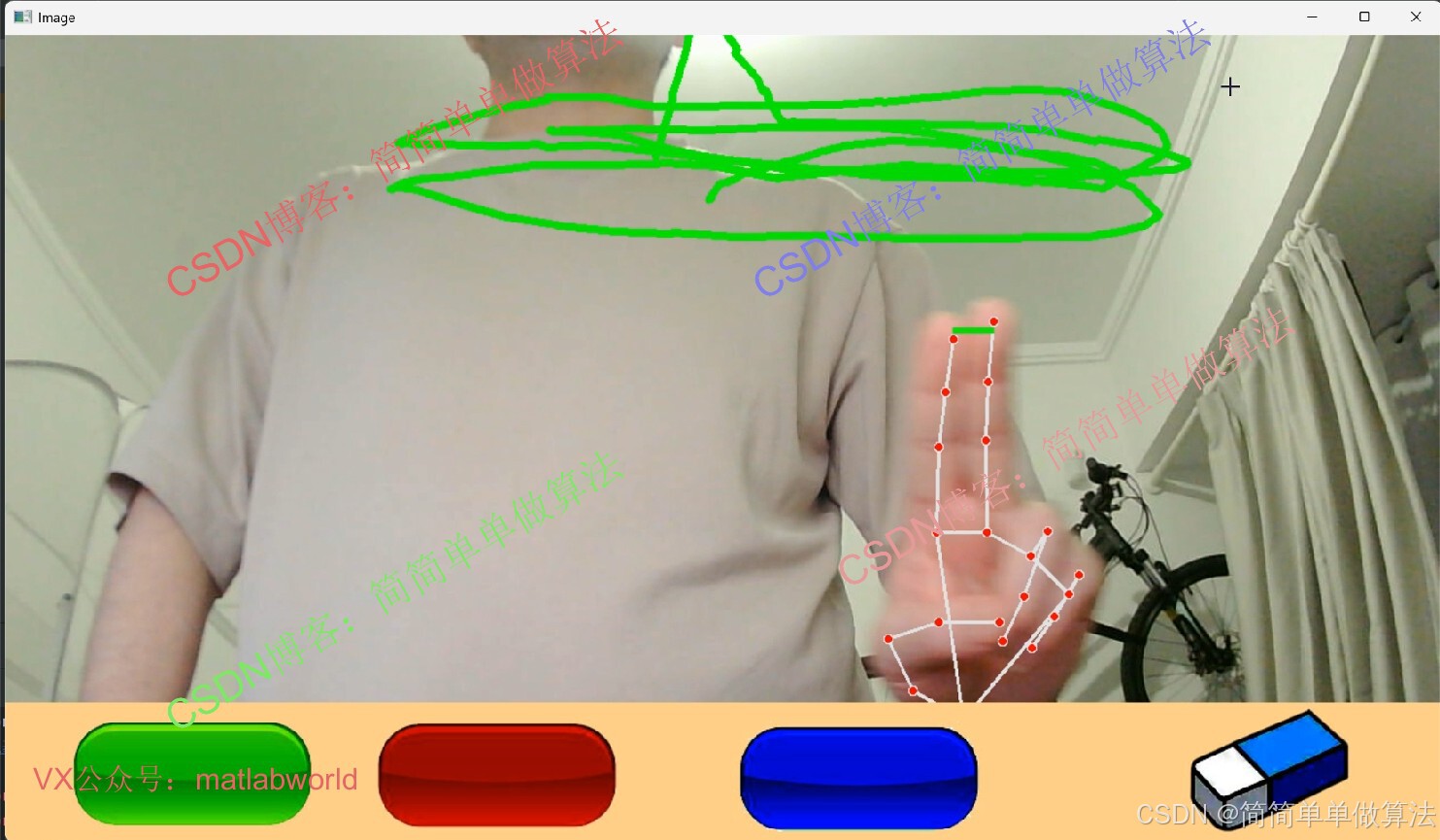

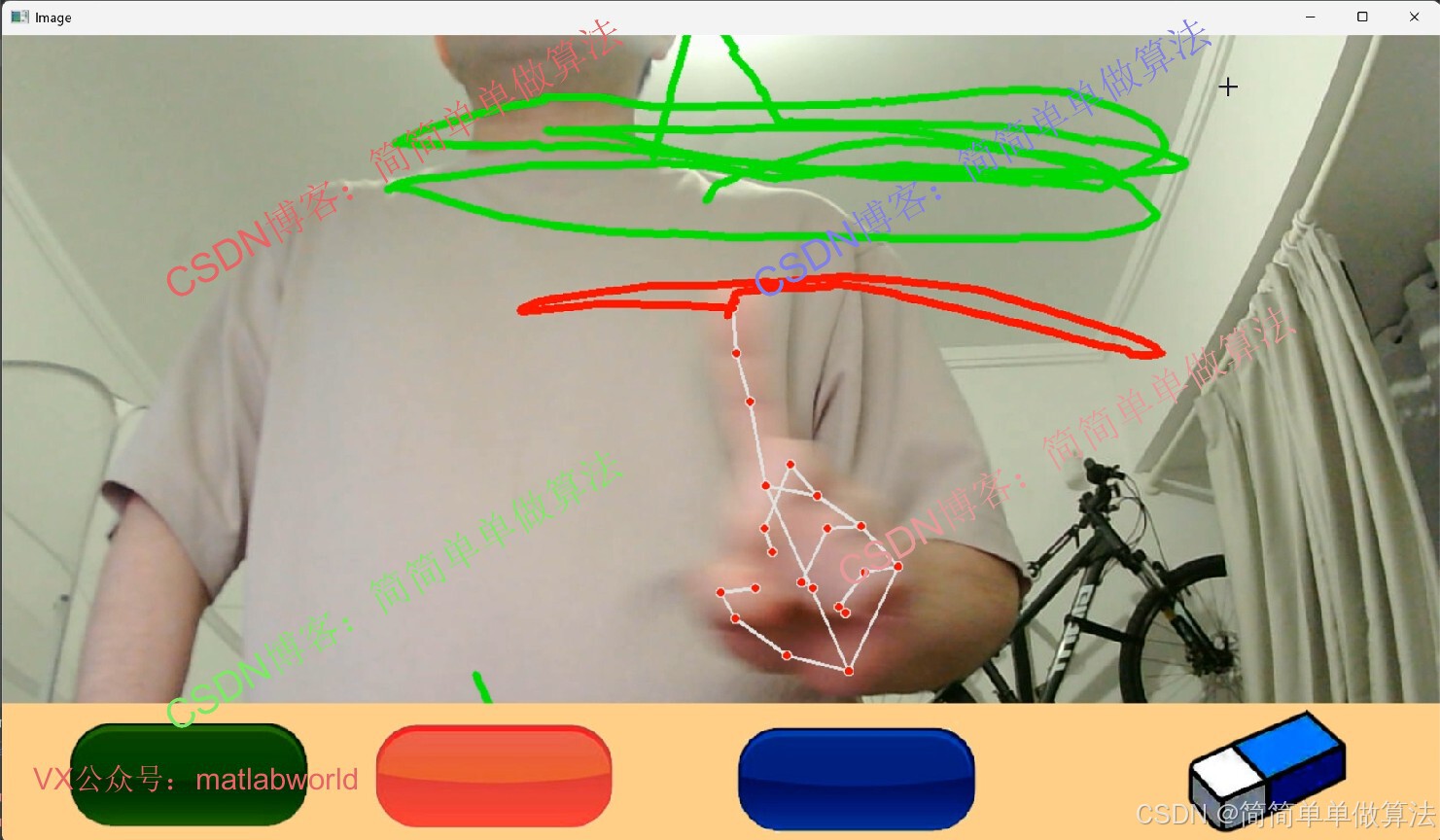

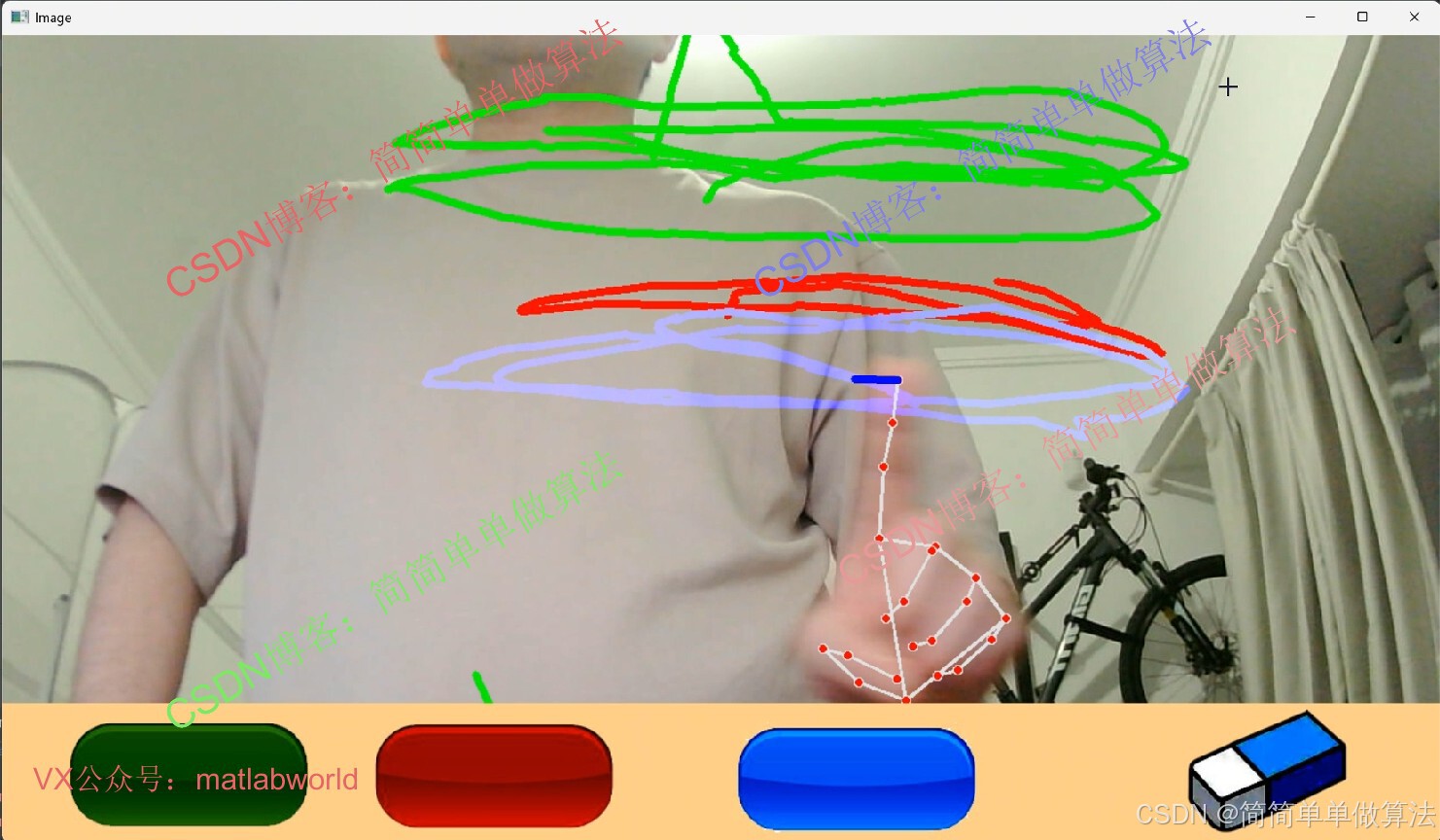

2.算法運行效果圖預覽

3.算法運行軟件版本

4.部分核心程序

5.算法仿真參數

6.算法理論概述

7.參考文獻

8.算法完整程序工程

1.前言

? ? ? ?虛擬畫板系統基于計算機視覺與深度學習技術,通過攝像頭捕獲用戶手部動作,利用 MediaPipe框架實現手部關鍵點檢測與手勢識別,進而將手部運動轉化為虛擬畫筆操作。系統主要流程包括:圖像采集→手部關鍵點檢測→手勢語義解析→坐標映射→繪圖邏輯執行。

2.算法運行效果圖預覽

(完整程序運行后無水印)

3.算法運行軟件版本

人工智能算法python程序運行環境安裝步驟整理_本地ai 運行 python-CSDN博客

4.部分核心程序

def findHands(self,img,draw=True):imgRGB=cv2.cvtColor(img,cv2.COLOR_BGR2RGB)self.results=hands.process(imgRGB)if self.results.multi_hand_landmarks:#get the information of each handfor handLms in self.results.multi_hand_landmarks:if draw:self.mpDraw.draw_landmarks(img,handLms,self.mpHands.HAND_CONNECTIONS)return imgdef findPosition(self,img,handNo=0,draw=True):self.lmList=[]if self.results.multi_hand_landmarks:myHand=self.results.multi_hand_landmarks[handNo]for id,lm in enumerate(myHand.landmark):h,w,c=img.shapecx,cy=int(lm.x*w),int(lm.y*h)self.lmList.append([id,cx,cy])if draw:cv2.circle(img,(cx,cy),8,(255,0,0),cv2.FILLED)return self.lmList 0Y_0075.算法仿真參數

# 指尖檢測器,設置檢測置信度為0.8

# 初始化攝像頭

cap=cv2.VideoCapture(0)

cap.set(3,1280)

cap.set(4,720)pens=5#畫筆寬度

erasers=100#橡皮寬度

6.算法理論概述

? ? ? ?虛擬畫板系統基于計算機視覺與深度學習技術,通過攝像頭捕獲用戶手部動作,利用 MediaPipe框架實現手部關鍵點檢測與手勢識別,進而將手部運動轉化為虛擬畫筆操作。系統主要流程包括:圖像采集→手部關鍵點檢測→手勢語義解析→坐標映射→繪圖邏輯執行。

? ? ?MediaPipe 的Hands模型采用輕量級卷積神經網絡(CNN),結合姿態估計(Pose Estimation)與關鍵點檢測(Keypoint Detection)技術,實現實時手部跟蹤。模型結構包含:

? ? ? ? 輕量化主干網絡:如 MobileNetV3,用于提取圖像特征;

? ? ? ?關鍵點回歸頭:輸出 21 個手部關鍵點(如指尖、指節)的二維坐標與置信度,坐標值通過歸一化處理(范圍 [0,1])映射到圖像尺寸。

通過分析手部關鍵點的相對位置關系,定義不同手勢語義。例如:

畫筆模式:單指(如食指)抬起,其余手指彎曲;

橡皮/畫筆選擇:兩個手指同時伸開,則表示開始選擇畫筆顏色或者橡皮模式

7.參考文獻

[1]陳吳東.基于深度學習的動態手勢檢測與識別算法研究[J].現代信息科技, 2025(8).

[2]范羽,梁梓康,徐明坤,等.基于MediaPipe手勢識別的聾啞人交流系統設計[J].輕工科技, 2024, 40(5):99-102.

[3]孟杰,楊鵬程,楊朝,等.基于Mediapipe的幻影成像裝置自然手勢交互系統設計[J].國外電子測量技術, 2023, 42(3):116-122.DOI:10.19652/j.cnki.femt.2204392.

8.算法完整程序工程

OOOOO

OOO

O

)

)

)

)

SQL 集合查詢 超詳細講解(附帶例題表格對比帶你一步步掌握))