關注我們了解計算機視覺最新動態 !

動態先覽

1

中國科學家設計超薄指尖傳感器,厚度

不到A4紙五分之一

2

谷歌發布地圖「時光機」:100年前,

你家街道長啥樣?

3

仿真環境跟車2分鐘,就讓自動駕駛系

統撞上馬路牙子,攻破率超90%

4

【ISOLABS】最新《圖神經網絡實用

南》2020論文

5

最新《機器學習導論》干貨筆記,65

頁pdf公式推導教程

6

82頁《現代C++教程》:高速上手?

C++11/14/17/20

7

速度堪比Adam,準確率媲美SGD,還

能穩定訓練GAN:全新優化器NeurIPS爆款

8

AI看圖說話首超人類!微軟認知AI團隊

提出視覺詞表預訓練超越Transformer

9

所有Windows 10版本均會受到影響!

微軟發布緊急安全更新

新聞類

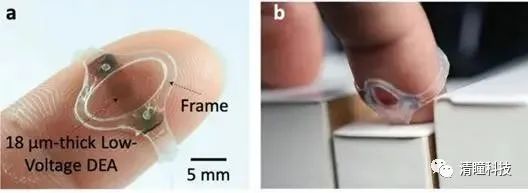

中國科學家設計超薄指尖傳感器,厚度不到A4紙五分之一,最高傳遞500Hz信號,可用于外科微創手術

視頻中只需要用手指觸摸,就可以辨別出紙上的字母。實現這個能力,用的是一個重量僅為 1.3 克的設備。而負責給指尖傳導信號的硅膠薄膜,只有 18 微米厚。這個厚度,薄于一張普通 A4 紙厚度(104 微米)的五分之一,也遠遠小于人體表皮的厚度(數十到上千微米)。

這是中國科學家冀曉斌領銜開發出的新型設備,只用 1.3 克的重量,能夠產生 1 到 500Hz 的震動信號,給手指傳遞不同的觸感。

這個設備的名字叫做 feel-through DEA(下稱 FT-DEA),“盲人摸字”的試驗,只是對其功能的一個驗證。更重要的是,這種輕巧的觸覺傳感器,提供了一種新型的人機交互界面,具有高靈敏度和寬信號頻域,如果跟不同的 VR 或 AR 設備結合,就可以開發出更逼真的虛擬現實或增強現實體驗。

谷歌發布地圖「時光機」:100年前,你家街道長啥樣?

10年前,乃至100年前,你長大的那條街道長什么樣?

現在,除了用AI修復老影像資料,谷歌還發布了新的「時光旅行」方案。

就像這樣,用3D視角,一覽1890年到1970年曼哈頓切爾西區的建筑變化。

是不是有點歷史更迭內味兒了?

這樣一臺「時光機器」的引擎,是谷歌推出的基于瀏覽器的工具集r?(音return),主要由3部分組成:一個眾包平臺,一個時空地圖服務器,一個3D體驗平臺。

官方博客:

https://ai.googleblog.com/2020/10/recreating-historical-streetscapes.html

R?工具集:

https://re.city/#14.25/40.74094/-73.98798

仿真環境跟車2分鐘,就讓自動駕駛系統撞上馬路牙子,攻破率超90%,多傳感器融合系統都失效

自動駕駛領域目前最強的MSF(多傳感器融合)定位算法,再次被攻破了。

攻擊之下,平均30秒內,正常行駛中的自動駕駛汽車就撞上了馬路牙子:

不僅GPS被忽悠瘸,LiDAR、輪速計和IMU一起上都沒能阻止。

并且,攻擊算法的成功率竟然達到了90%以上。

連多傳感器融合定位算法達到SOTA的百度Apollo,在仿真環境也中了招。

這項最新研究,來自加州大學爾灣分校(UCI),目前已發表在信息安全領域四大頂會之一的USENIX Security 2020上。

傳送門:

https://sites.google.com/view/cav-sec/fusionripper

教程類

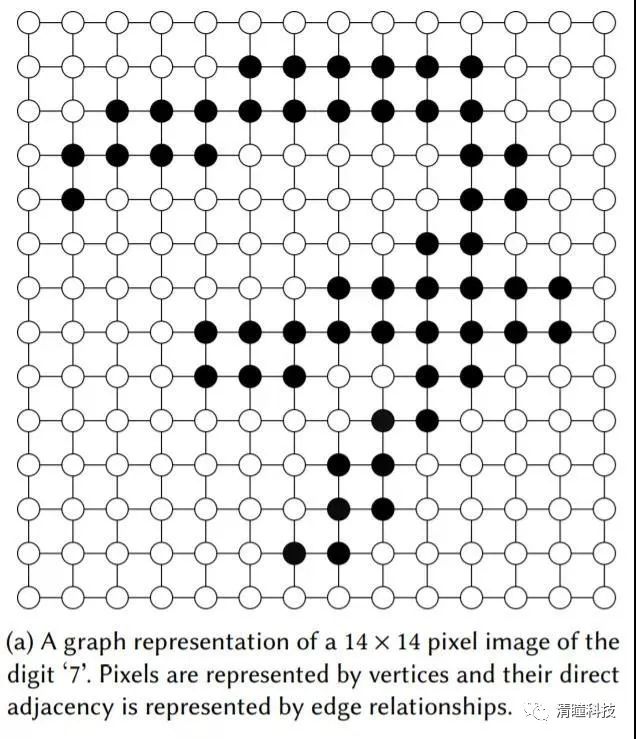

【ISOLABS】最新《圖神經網絡實用指南》2020論文

圖神經網絡(GNNs)最近在人工智能領域變得越來越受歡迎,這是因為它們具有提取相對非結構化數據類型作為輸入數據的獨特能力。盡管GNN體系結構的一些元素在操作上與傳統神經網絡(以及神經網絡變體)的概念相似,但其他元素則不同于傳統的深度學習技術。本教程通過整理和呈現最常見類型的GNNs的動機、概念、數學和應用的詳細信息,向一般深度學習愛好者展示了GNNs的強大功能和新穎之處。重要的是,我們以介紹性的速度簡要地介紹了本教程,并提供了理解和使用GNNs的實用和可訪問的指南。

傳送門:

https://deepai.org/publication/a-practical-guide-to-graph-neural-networks

最新《機器學習導論》干貨筆記,65頁pdf公式推導教程

這門課程是Pr Biau關于統計學習課程的補充,這在兩個方面:

1. 它處理了監督學習和非監督學習;

2. 提出了一種算法的觀點。

這些課堂講稿由三章組成:

第一章:詳細介紹了幾種分類方法,快速填補了兩者之間的差距

第二章:我們考慮了未觀察到的標簽問題,并給出了一些生成的劃分方法

輸入空間

第三章:維數災難

傳送門:

http://www.lpsm.paris/pageperso/sangnier/files/mlM2/notes_student.pdf

82頁《現代C++教程》:高速上手C++ 11/14/17/20

現代 C++ (指 C++11/14/17/20) 的大量特性使得整個 C++ 語言更加現代化。現代 C++ 不僅僅增強了 C++ 語言自身的可用性,auto 關鍵字語義的修改使得我們更加有信心來操控極度復雜的模板類型。同時還對語言運行期進行了大量的強化,Lambda 表達式的出現讓 C++ 具有了匿名函數的閉包特性,而這一特性在現代的編程語言(諸如 Python/Swift/... )中已經司空見慣,右值引用的出現解決了 C++ 長期以來被人詬病的臨時對象效率問題等等。

中文版地址:

https://changkun.de/modern-cpp/pdf/modern-cpp-tutorial-zh-cn.pdf

書籍代碼地址:

https://changkun.de/modern-cpp/code/

習題解答地址:

https://changkun.de/modern-cpp/exercises/

程序員

速度堪比Adam,準確率媲美SGD,還能穩定訓練GAN:全新優化器成為NeurIPS爆款

最常用的深度學習優化器大致可分為自適應方法(如Adam)和加速方案(如帶有動量的隨機梯度下降(SGD))。與 SGD 相比,許多模型(如卷積神經網絡)采用自適應方法通常收斂速度更快,但泛化效果卻較差。對于生成對抗網絡(GAN)這類的復雜情況,通常默認使用自適應方法,因為其具有穩定性。

在 NeurIPS 2020 的一篇 Spotlight 論文中,來自耶魯大學、伊利諾伊大學香檳分校等機構的研究者提出了一種名為「AdaBelief」的新型優化器,可以同時滿足 3 個優點:自適應方法的快速收斂、SGD 的良好泛化性、訓練穩定性。論文代碼也已經放出。

論文地址:

https://arxiv.org/pdf/2010.07468.pdf

GitHub地址:

https://github.com/juntang-zhuang/Adabelief-Optimizer

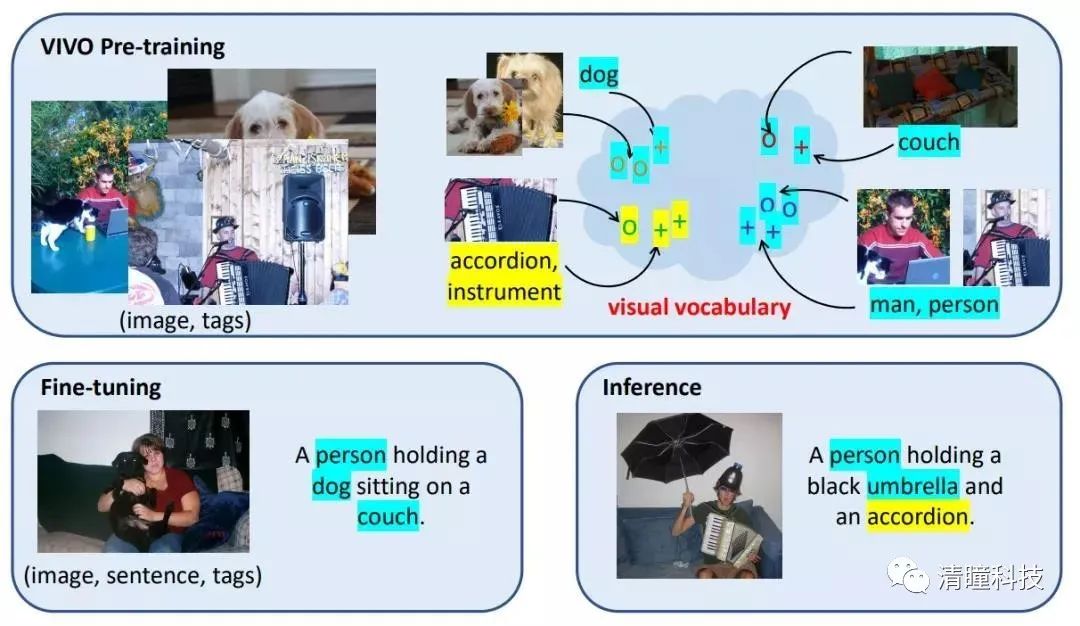

AI看圖說話首超人類!微軟認知AI團隊提出視覺詞表預訓練超越Transformer

能看圖會說話的AI,表現還超過了人類?最近,Azure悄然上線了一個新的人工智能服務,能精準的說出圖片中的內容。而背后的視覺詞表技術,更是超越了基于Transformer的前輩們,拿到nocaps挑戰賽冠軍。

微軟認知服務團隊的研究人員提出了一種名為視覺詞表預訓練(Visual Vocabulary Pre-training,簡稱VIVO)的解決方案。

目前,VIVO 在 nocaps 挑戰中取得了 SOTA效果,并首次超越人類表現。

傳送門:

https://apps.apple.com/us/app/seeing-ai/id999062298

所有Windows 10版本均會受到影響!微軟發布緊急安全更新

微軟周五發布了兩個安全更新,以解決 Windows Codecs 庫和 Visual Studio Code 應用程序中的安全問題。

這兩個更新是在該公司、于本周早些時候發布了每月的安全更新批次之后發布的, 本月補丁了 87 個漏洞。這兩個新漏洞都是“遠程代碼執行”漏洞,使攻擊者可以在受影響的系統上執行代碼。

外媒表示,所有 Windows 10 版本均會受到影響。當前,Windows 10 顯示兩條驅動程序錯誤消息,當驗證過程失敗時,用戶可能就會看到。第一個錯誤消息顯示為“ Windows 無法驗證該驅動程序軟件的發行者”,第二個錯誤消息顯示為“主題中不存在簽名”。這些錯誤消息表示 Windows 在嘗試驗證驅動程序時發現格式不正確的目錄文件,并且安裝過程將失敗。

昨日推薦(左下角閱讀原文)

美團開店首秀:全自動揀貨,95%訂單全無人配送 / TikTok服務器與字節跳動分離:首席安全官透露最新進展 / 理想汽車事故

公眾號ID:清瞳

清瞳時代,用科技讓復雜的世界更簡單

長按識別左邊二維碼關注我們