為什么80%的碼農都做不了架構師?>>> ??

本文由碼農場同步,最新版本請查看原文:http://www.hankcs.com/nlp/cs224n-convolutional-neural-networks.html

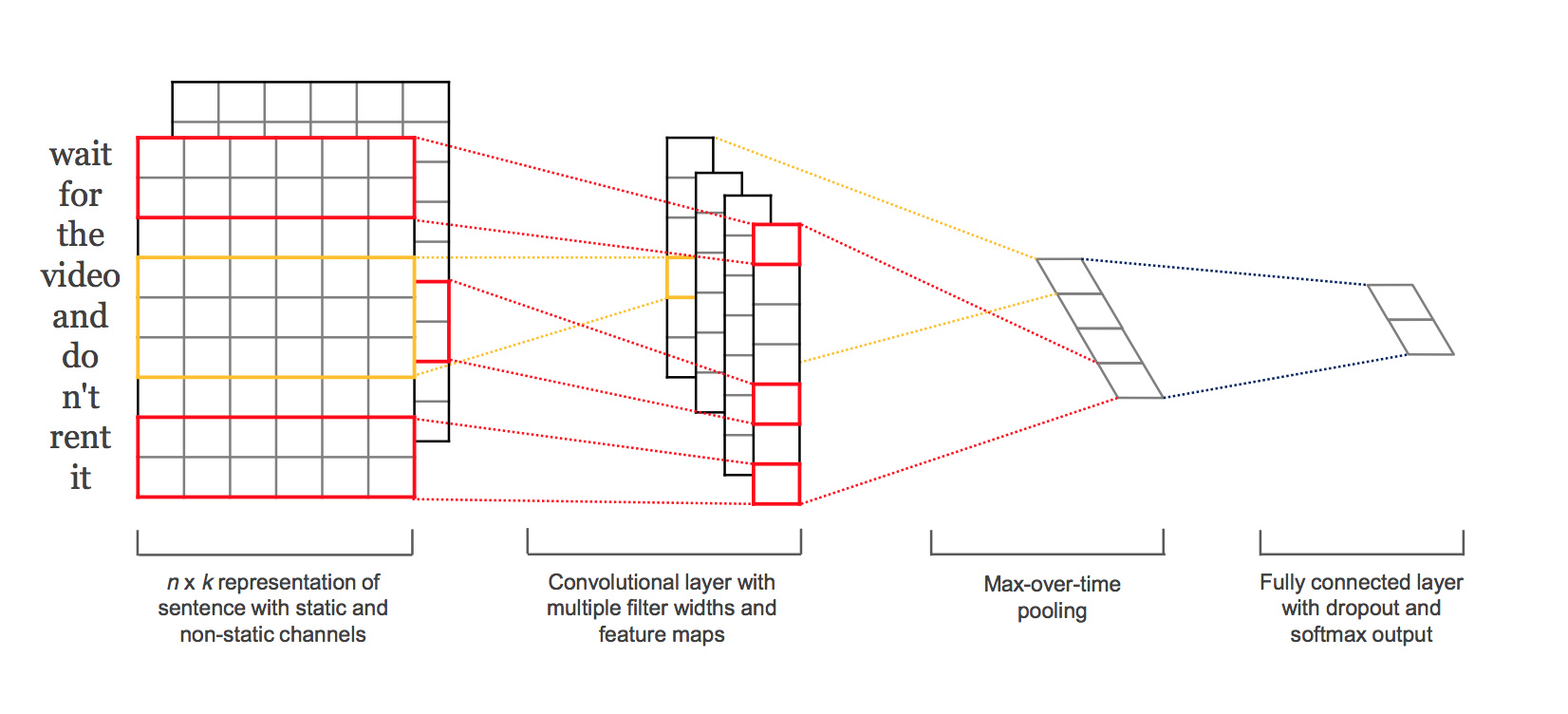

補充了NLP中相對冷門的CNN,談了談調參與發論文的潛規則。從RNN到CNNRNN無法利用未來的特征預測當前單詞,就算是bi-RNN,也不過是雙向重蹈覆轍而已。經常把過多注意力放到最后一個單詞上。比如,如果只想得到my birth的向量,RNN就無能為力了,因為它捕捉的是從左到右的“上文”。與此對應,softmax也是加在最后一個單詞上的CNN的解決思路說來也很簡單粗暴,那就計算相鄰的ngram,不管它到底是不是真正的短語,眉毛胡子一把抓地為它們計算向量。什么是卷積定義在兩個矩陣上的函數,生成另一個矩陣(也...

繼續閱讀:碼農場 ? CS224n筆記13 卷積神經網絡

原文鏈接:http://www.hankcs.com/nlp/cs224n-convolutional-neural-networks.html

感謝閱讀本文,歡迎 查看原文或訪問 碼農場 獲取更多內容

)

- 基礎知識與運行時注解)