codis是豌豆莢開源的分布式server。眼下處于穩定階段。

原文地址:https://github.com/wandoulabs/codis/blob/master/doc/tutorial_zh.md

Codis 是一個分布式 Redis 解決方式, 對于上層的應用來說, 連接到 Codis Proxy 和連接原生的 Redis Server 沒有明顯的差別 (不支持的命令列表), 上層應用能夠像使用單機的 Redis 一樣使用, Codis 底層會處理請求的轉發, 不停機的數據遷移等工作, 全部后邊的一切事情, 對于前面的client來說是透明的, 能夠簡單的覺得后邊連接的是一個內存無限大的 Redis 服務.

基本框架例如以下:

Codis 由四部分組成:

Codis Proxy (codis-proxy)Codis Manager (codis-config)

Codis Redis (codis-server)

ZooKeeper

codis-proxy 是client連接的 Redis 代理服務, codis-proxy 本身實現了 Redis 協議, 表現得和一個原生的 Redis 沒什么差別 (就像 Twemproxy), 對于一個業務來說, 能夠部署多個 codis-proxy, codis-proxy 本身是無狀態的.

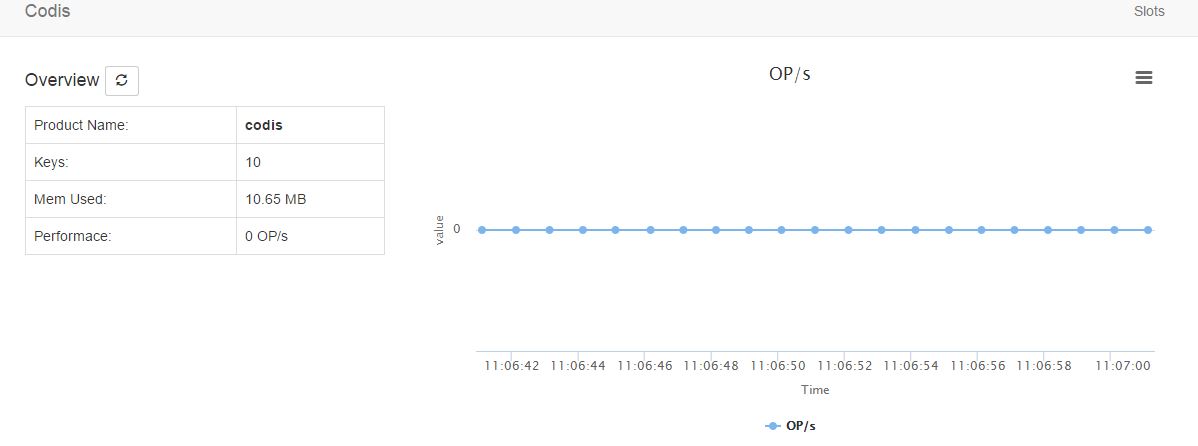

codis-config 是 Codis 的管理工具, 支持包含, 加入/刪除 Redis 節點, 加入/刪除 Proxy 節點, 發起數據遷移等操作. codis-config 本身還自帶了一個 http server, 會啟動一個 dashboard, 用戶能夠直接在瀏覽器上觀察 Codis 集群的執行狀態.codis-server 是 Codis 項目維護的一個 Redis 分支, 基于 2.8.13 開發, 增加了 slot 的支持和原子的數據遷移指令. Codis 上層的 codis-proxy 和 codis-config 僅僅能和這個版本號的 Redis 交互才干正常執行.

ZooKeeper(下面簡稱ZK)是一個分布式協調服務框架。能夠做到各節點之間的數據強一致性。簡單的理解就是在一個節點改動某個變量的值后。在其它節點能夠最新的變化。這樣的變化是事務性的。

通過在ZK節點上注冊監聽器,就能夠獲得數據的變化。

Codis 依賴 ZooKeeper 來存放數據路由表和 codis-proxy 節點的元信息, codis-config 發起的命令都會通過 ZooKeeper 同步到各個存活的 codis-proxy.

注:1.codis新版本號支持redis到2.8.21

2.codis-group實現redis的水平擴展

以下我們來部署環境:

10.80.80.124 ? ? ? zookeeper_1 codis-configcodis-server-master,slave codis_proxy_1

10.80.80.126 ? ? ? zookeeper_2 codis-server-master,slavecodis?_proxy_2

10.80.80.123 ? ? ? zookeeper_3 codis-serve-master,slavecodis?_proxy_3

說明:

1.為了確保zookeeper的穩定性與可靠性。我們在124、126、123上搭建zookeeper集群來對外提供服務;

2.codis-cofig作為分布式redis的管理工具。在整個分布式server中僅僅須要一個就能夠完畢管理任務。

3.codis-server和codis-proxy在3臺服務器提供redis和代理服務。

一.部署zookeeper集群

1.配置hosts(在3臺server上)

10.80.80.124 codis1

10.80.80.126 codis2

10.80.80.123 codis3

2.配置java環境(在3臺server上)

vim /etc/profile

##JAVA###

export JAVA_HOME=/usr/local/jdk1.7.0_71

export JRE_HOME=/usr/local/jdk1.7.0_71/jre

export PATH=$JAVA_HOME/bin:$PATH

export CLASSPATH=.:$JAVA_HOME/lib/dt.jar:$JAVA_HOME/lib/tools.jarsource /etc/profilecd /usr/local/src

wget http://mirror.bit.edu.cn/apache/zookeeper/zookeeper-3.4.6/zookeeper-3.4.6.tar.gz

tar -zxvf zookeeper-3.4.6.tar.gz -C /usr/localvim /etc/profile

#zookeeper

ZOOKEEPER_HOME=/usr/local/zookeeper-3.4.6

export PATH=$PATH:$ZOOKEEPER_HOME/binsource /etc/profile#創建zookeeper的數據文件夾和日志文件夾

mkdir -p /data/zookeeper/zk1/{data,log}

cd /usr/local/zookeeper-3.4.6/conf

cp zoo_sample.cfg zoo.cfg

vim /etc/zoo.cfg

tickTime=2000

initLimit=10

syncLimit=5

dataDir=/data/zookeeper/zk1/data

dataLogDir=/data/zookeeper/zk1/log

clientPort=2181

server.1=codis1:2888:3888

server.2=codis2:2888:3888

server.3=codis3:2888:3888#在124上

cd /data/zookeeper/zk1/data

echo 1 > myid

#在126上

cd /data/zookeeper/zk1/data

echo 2 > myid

#在123上

cd /data/zookeeper/zk1/data

echo 3 > myid/usr/local/zookeeper-3.4.6/bin/zkServer.sh start

8.查看zookeeper全部節點的狀態(在3臺server上)

#124

/usr/local/zookeeper-3.4.6/bin/zkServer.sh status

JMX enabled by default

Using config: /usr/local/zookeeper-3.4.6/bin/../conf/zoo.cfg

Mode: leader

#126

/usr/local/zookeeper-3.4.6/bin/zkServer.sh status

JMX enabled by default

Using config: /usr/local/zookeeper-3.4.6/bin/../conf/zoo.cfg

Mode: follower

#123

/usr/local/zookeeper-3.4.6/bin/zkServer.sh status

JMX enabled by default

Using config: /usr/local/zookeeper-3.4.6/bin/../conf/zoo.cfg

Mode: follower1.安裝go語言(在3臺server上)

tar -zxvf go1.4.2.linux-amd64.tar.gz -C /usr/local/vim /etc/profile

#go

export PATH=$PATH:/usr/local/go/bin

export GOPATH=/usr/local/codissource /etc/profilego get github.com/wandoulabs/codis

cd $GOPATH/src/github.com/wandoulabs/codis

#運行編譯測試腳本,編譯go和reids。./bootstrap.sh make gotest #將編譯好后,把bin文件夾和一些腳本復制過去/usr/local/codis文件夾下 mkdir -p /usr/local/codis/{conf,redis_conf,scripts} cp -rf bin /usr/local/codis/ cp sample/config.ini /usr/local/codis/conf/ cp -rf sample/redis_conf /usr/local/codis cp -rf sample/* /usr/local/codis/scripts

4.配置codis-proxy(在3臺server上。在此以124為例)#124

cd /usr/local/codis/conf

vim config.ini

zk=codis1:2181,codis2:2181,codis3:2181

product=codis

#此處配置圖形化界面的dashboard。注意codis集群僅僅要一個就可以,因此所有指向10.80.80.124:18087

dashboard_addr=192.168.3.124:18087

coordinator=zookeeper

backend_ping_period=5

session_max_timeout=1800

session_max_bufsize=131072

session_max_pipeline=128

proxy_id=codis_proxy_1

#126

cd /usr/local/codis/conf

vim config.ini

zk=codis1:2181,codis2:2181,codis3:2181

product=codis

#此處配置圖形化界面的dashboard,注意codis集群僅僅要一個就可以,因此所有指向10.80.80.124:18087

dashboard_addr=192.168.3.124:18087

coordinator=zookeeper

backend_ping_period=5

session_max_timeout=1800

session_max_bufsize=131072

session_max_pipeline=128

proxy_id=codis_proxy_2

#123

cd /usr/local/codis/conf

vim config.ini

zk=codis1:2181,codis2:2181,codis3:2181

product=codis

#此處配置圖形化界面的dashboard,注意codis集群僅僅要一個就可以,因此所有指向10.80.80.124:18087

dashboard_addr=192.168.3.124:18087

coordinator=zookeeper

backend_ping_period=5

session_max_timeout=1800

session_max_bufsize=131072

session_max_pipeline=128

proxy_id=codis_proxy_3#創建codis-server的數據文件夾和日志文件夾

mkdir -p /data/codis/codis-server/{data,logs}

cd /usr/local/codis/redis_conf

#主庫

vim 6380.conf

daemonize yes

pidfile /var/run/redis_6380.pid

port 6379

logfile "/data/codis_server/logs/codis_6380.log"

save 900 1

save 300 10

save 60 10000

dbfilename 6380.rdb

dir /data/codis_server/data

#從庫

cp 6380.conf 6381.conf

sed -i 's/6380/6381/g' 6381.confecho "vm.overcommit_memory = 1" >> /etc/sysctl.conf

sysctl -pcat /usr/loca/codis/scripts/usage.md

0. start zookeeper

1. change config items in config.ini

2. ./start_dashboard.sh

3. ./start_redis.sh

4. ./add_group.sh

5. ./initslot.sh

6. ./start_proxy.sh

7. ./set_proxy_online.sh

8. open browser to http://localhost:18087/admin因為之前zookeeper已經啟動,以下我們來啟動其它項目。

注:1.在啟動過程中須要指定相關日志文件夾或配置文件文件夾,為便于統一管理。我們都放在/data/codis下;

2.dashboard在codis集群中僅僅須要在一臺server上啟動就可以,此處在124上啟動;凡是用codis_config的命令都是在124上操作,其它啟動項須要在3臺server上操作。

相關命令例如以下:

/usr/local/codis/bin/codis-config -h

usage: codis-config [-c <config_file>] [-L <log_file>] [--log-level=<loglevel>]<command> [<args>...]

options:-c set config file-L set output log file, default is stdout--log-level=<loglevel> set log level: info, warn, error, debug [default: info]commands:serverslotdashboardactionproxy(1)啟動dashboard(在124上啟動)

#dashboard的日志文件夾和訪問文件夾

mkdir -p /data/codis/codis_dashboard/logs

codis_home=/usr/local/codis

log_path=/data/codis/codis_dashboard/logs

nohup $codis_home/bin/codis-config -c $codis_home/conf/config.ini -L $log_path/dashboard.log dashboard --addr=:18087 --http-log=$log_path/requests.log &>/dev/null &通過10.80.80.124:18087就可以訪問圖形管理界面

/usr/local/codis/bin/codis-server /data/codis_server/conf/6380.conf

/usr/local/codis/bin/codis-server /data/codis_server/conf/6381.conf注意:每個 Server Group 作為一個 Redis server組存在, 僅僅同意有一個 master, 能夠有多個 slave, group id 僅支持大于等于1的整數

眼下我們在3臺server上分了3組,因此我們須要加入3組。每組由一主一從構成

#相關命令

/usr/local/codis/bin/codis-config -c /usr/local/codis/conf/config.ini server

usage:codis-config server listcodis-config server add <group_id> <redis_addr> <role>codis-config server remove <group_id> <redis_addr>codis-config server promote <group_id> <redis_addr>codis-config server add-group <group_id>codis-config server remove-group <group_id>

#group 1

/usr/local/codis/bin/codis-config -c /usr/local/codis/conf/config.ini server add 1 10.80.80.124:6380 master

/usr/local/codis/bin/codis-config -c /usr/local/codis/conf/config.ini server add 1 10.80.80.124:6381 slave

#group 2

/usr/local/codis/bin/codis-config -c /usr/local/codis/conf/config.ini server add 2 10.80.80.126:6380 master

/usr/local/codis/bin/codis-config -c /usr/local/codis/conf/config.ini server add 2 10.80.80.126:6381 slave

#group 3

/usr/local/codis/bin/codis-config -c /usr/local/codis/conf/config.ini server add 3 10.80.80.123:6380 master

/usr/local/codis/bin/codis-config -c /usr/local/codis/conf/config.ini server add 3 10.80.80.123:6381 slave

注意:1.點擊“Promote to Master”就會將slave的redis提升為master,而原來的master會自己主動下線。

? ? 2./usr/local/codis/bin/codis-config -c /usr/local/codis/conf/config.ini server add 能夠加入機器到對應組中。也能夠更新redis的主/從角色。

? ? 3.若為新機器,此處的keys應該為空

(4)?設置 server group 服務的 slot 范圍(124上)

#相關命令

/usr/local/codis/bin/codis-config -c /usr/local/codis/conf/config.ini slot

usage:codis-config slot init [-f]codis-config slot info <slot_id>codis-config slot set <slot_id> <group_id> <status>codis-config slot range-set <slot_from> <slot_to> <group_id> <status>codis-config slot migrate <slot_from> <slot_to> <group_id> [--delay=<delay_time_in_ms>]codis-config slot rebalance [--delay=<delay_time_in_ms>]#Codis 採用 Pre-sharding 的技術來實現數據的分片, 默認分成 1024 個 slots (0-1023), 對于每個key來說, 通過下面公式確定所屬的 Slot Id : SlotId = crc32(key) % 1024 每個 slot 都會有一個特定的 server group id 來表示這個 slot 的數據由哪個 server group 來提供。我們在此將1024個slot分為三段,分配例如以下: /usr/local/codis/bin/codis-config -c conf/config.ini slot range-set 0 340 1 online /usr/local/codis/bin/codis-config -c conf/config.ini slot range-set 341 681 2 online /usr/local/codis/bin/codis-config -c conf/config.ini slot range-set 682 1023 3 online

(5)啟動codis-proxy(在3臺服務器上)#codis_proxy的日志文件夾

mkdir -p /data/codis/codis_proxy/logs

codis_home=/usr/local/codis

log_path=/data/codis/codis_proxy/logs

nohup $codis_home/bin/codis-proxy --log-level warn -c $codis_home/conf/config.ini -L $log_path/codis_proxy_1.log --cpu=8 --addr=0.0.0.0:19000 --http-addr=0.0.0.0:11000 > $log_path/nohup.out 2>&1 &

黑線處:codis讀取server的主機名。

注意:若client相關訪問proxy,須要在client加入hosts

(6)上線codis-proxy

codis_home=/usr/local/codis

log_path=/data/codis/codis_proxy/logs

nohup $codis_home/bin/codis-proxy --log-level warn -c $codis_home/conf/config.ini -L $log_path/codis_proxy_1.log --cpu=8 --addr=0.0.0.0:19000 --http-addr=0.0.0.0:11000 > $log_path/nohup.out 2>&1 &注:啟動codis_proxy后。proxy此時處于offline狀態。無法對外提供服務,必須將其上線后才干對外提供服務。

ok,至此codis已經能夠對外提供服務了。

三.HA

codis的ha分為前端proxy的ha以及后端codis-server的ha,在此簡單說下proxy的ha。

對于上層proxy來說,尤其是javaclient來,codis提供jodis(改動過的jedis)來實現proxy的ha。

它會通過監控zk上的注冊信息來實時獲得當前可用的proxy列表,既能夠保證高可用性。也能夠通過輪流請求全部的proxy實現負載均衡;支持proxy的自己主動上線和下線。

)

延時函數、SysTick_Config函數)

)

重映射)

5 seconds ago)

)