YOLOV5s +吸煙目標檢測

參考學習

文章目錄

-

-

- 本原創項目長期更新,旨在完成校園異常行為實時精檢測,作到集成+N次開發+優化(不止局限于調包)為止,近期將不斷更新如下模型+數據+標注文件+教程。關注博主,Star 一下github,一塊兒開始美妙的目標檢測之路吧~~

- 1、項目展現

- 2、項目資源共享

-

- 1:訓練圖片:香煙圖片+吸煙手勢+煙霧

-

- 3、實踐教學

- 3.1環境配置

- 3.2數據標注與預處理

- 3.2.1附上本身的Lablimg簡易教學:

- 3.2.2 幾個本身寫的腳本用于轉換數據集與訓練前準備

- 3.2.3 切分訓練集與測試集:

- 4、開始訓練

- 4.1:開始訓練

- 4.2:訓練過程

- 4.3:訓練優化

- 4.4 訓練參數:

- 5、實時檢測

- 運行detect.py便可

- 6、YOLO系列可視化對比

- 7、寫在后面

- 所有連接傳送門

-

?

? 首先:附上Github傳送門:https://github.com/CVUsers/Smoke-Detect-by-YoloV5/tree/master,而后根據本文手把手配置環境+訓練本身數據,或者使用我訓練好的模型進行使用。用yolov5s訓練好的已經放在了里面,用大模型訓練的因為大小緣由,須要的話能夠戳最下方微信私聊我,免費。python

1、項目展現

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-fwpaKe70-1594698054779)(D:\CSDN\pic\吸煙檢測\0.png)]](https://img-blog.csdnimg.cn/img_convert/ca41ef6f81a92cbfa8eee9192cb6471b.png)

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-hUenvq7F-1594698054781)(D:\CSDN\pic\吸煙檢測\0.5.png)]](https://img-blog.csdnimg.cn/img_convert/78a26f6f4bdb8b47e458ca8766ee5c26.png)

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-JEV7mZfK-1594698054784)(D:\CSDN\pic\吸煙檢測\1.png)]](https://img-blog.csdnimg.cn/img_convert/9415b26af2ba5cb3a7d5adedfdbd8b11.png)

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-Mgb0QwvX-1594698054788)(D:\CSDN\pic\吸煙檢測\1594683546122.png)]](https://img-blog.csdnimg.cn/img_convert/8dbb065a809867e8332dd77093d06d1f.png)

左圖為原圖,右圖為推理后的圖片,以圖片方式展現,視頻流和實時流也能達到這個效果,因為視頻大小緣由,暫不上傳,感興趣的朋友細細往下看,并點個關注喲!git

測試配置:GTX1050ti,不堪入目,可是實驗效果還不錯,再這樣弱的配置下,使用YOLOv5s,YOlov5m等皆能達到30fps。github

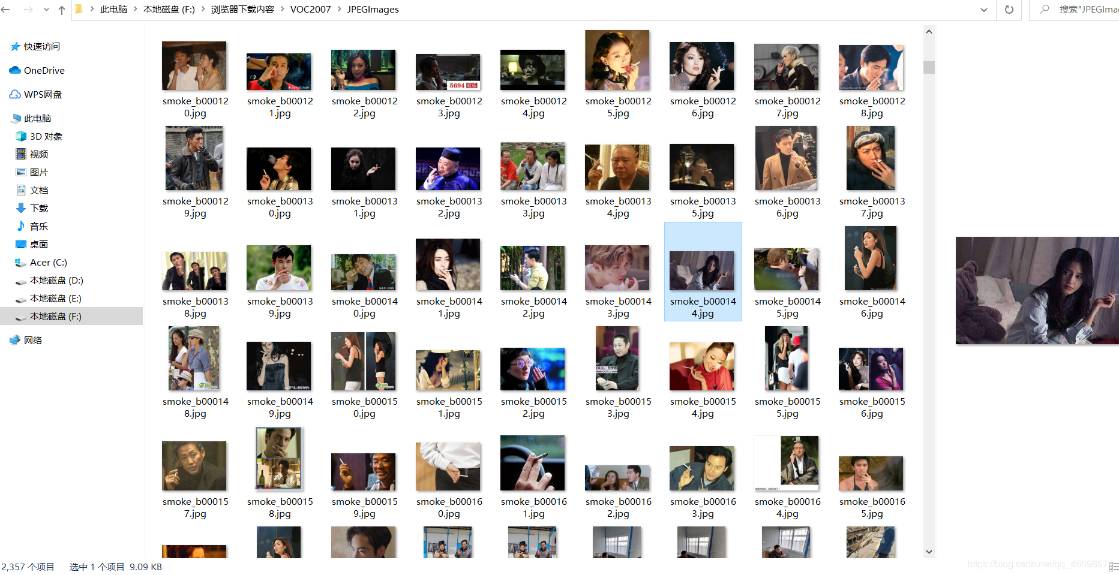

2、項目資源共享

香煙圖片:本身編寫爬蟲爬了1w張,篩選下來有近1000張可用,以及其余途徑獲取到的,總共暫時5k張,將來會愈來愈多,后續須要的能夠私聊我,如今先放出5k張圖片,另外加上本身辛辛苦苦使用Labelimg標注的幾千張圖片的XML文件也一并送上,香煙圖片質量可查傳送門:連接:https://pan.baidu.com/s/1t8u94x51TO7pLciU8AoaiQ

提取碼:n2wr:以下圖web

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-eruZx8Ri-1594698054790)(D:\CSDN\pic\吸煙檢測\3.png)]](https://img-blog.csdnimg.cn/img_convert/e0587d76a260ef82ebd2f62eee012dad.png)

吸煙手勢圖片:算法

火災+煙霧數據集:微信

這個數據集我已經有了10萬左右數據,部分是朋友的,不知能不能開源,我能夠送上本身收集的幾萬數據集。傳送門:框架

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-GFsXlbwe-1594698054792)(D:\CSDN\pic\吸煙檢測\1594687477452.png)]](https://img-blog.csdnimg.cn/img_convert/29bfa795a8e0ad76a058791d6a1fa904.png)

項目框架:YOLOV5——Pytorch實現dom

送上做者源碼傳送門:https://github.com/ultralytics/yolov5,固然也能夠直接使用個人:https://github.com/CVUsers/Smoke-Detect-by-YoloV5/tree/master。ide

標注工具:Labelimgsvg

附上Windows工具:在我上面的github里面有喲:下載好放置桌面比較方便。

3、實踐教學

3.1環境配置

本例以使用YOLov5做者源碼步驟:

Cython

numpy==1.17

opencv-python

torch>=1.4

matplotlib

pillow

tensorboard

PyYAML>=5.3

torchvision

scipy

tqdm

個人是torch 1.5 gpu版

在git clone下做者的v5源碼后: 目錄切至requirement.txt 下而后

pip install -U -r requirements.txt

若是須要使用混合精度模型來作訓練:安裝Apex

git clone https://github.com/NVIDIA/apex && cd apex 而后切換至目錄下

pip install -v --no-cache-dir --global-option="--cpp_ext" --global-option="--cuda_ext" . --user && cd .. && rm -rf apex

3.2數據標注與預處理

以吸煙數據集為例:

在百度網盤下載好個人數據集和XML

如果想從新訓練的話

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-ctuoGjSX-1594698054796)(D:\CSDN\pic\吸煙檢測\7.png)]](https://img-blog.csdnimg.cn/img_convert/f4290b0560b5d299ef4062099b742bf4.png)

標注好會生成XML文件:XML里面包含了四個點坐標和圖片的名字與size。

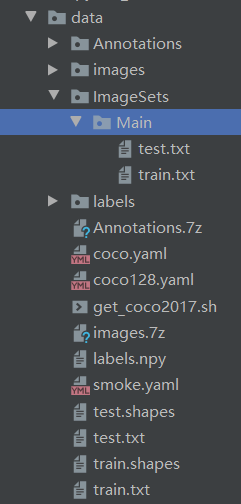

而后在data下新建幾個文件夾:

將咱們的XML文件放至Annotations

將咱們的圖片放到images

在ImageSets中新建Main 和test.txt 和train.txt

再新建labels存放接下來生成的標簽

第一個:XML文件轉label.txt文件

首先寫個os操做讀一下data/images中圖片:這個幾行搞定,要注意要寫成我這樣的喲 (不用生成.jpg)能夠經過split(’.’)再復制到ImageXML中

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-TUcelHlM-1594698054806)(D:\CSDN\pic\吸煙檢測\10.png)]](https://img-blog.csdnimg.cn/img_convert/163530108ac970b37aab5ba9a7601141.png)

而后運行voc_label.py腳本:

# 坐標xml轉txt

import os

import xml.etree.ElementTree as ETclasses = ["smoke"] # 輸入名稱,必須與xml標注名稱一致def convert(size, box):print(size, box)dw = 1. / size[0]dh = 1. / size[1]x = (box[0] + box[1]) / 2.0y = (box[2] + box[3]) / 2.0w = box[1] - box[0]h = box[3] - box[2]x = x * dww = w * dwy = y * dhh = h * dhreturn (x, y, w, h)def convert_annotation(image_id):print(image_id)in_file = open(r'./data/Annotations/%s.xml' % (image_id), 'rb') # 讀取xml文件路徑out_file = open('./data/labels/%s.txt' % (image_id), 'w') # 須要保存的txt格式文件路徑tree = ET.parse(in_file)root = tree.getroot()size = root.find('size')w = int(size.find('width').text)h = int(size.find('height').text)for obj in root.iter('object'):cls = obj.find('name').textif cls not in classes: # 檢索xml中的名稱continuecls_id = classes.index(cls)xmlbox = obj.find('bndbox')b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),float(xmlbox.find('ymax').text))bb = convert((w, h), b)out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')image_ids_train = open('./ImageXML.txt').read().strip().split() # 讀取xml文件名索引for image_id in image_ids_train:print(image_id)convert_annotation(image_id)須要注意,如果有中文路徑的話,請這樣讀文件:

open(r'./data/Annotations/%s.xml' % (image_id), 'rb')

接下來就會在data/labels中看到:全部的txt標簽

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-YGacBoN7-1594698054808)(C:\Users\acer\AppData\Roaming\Typora\typora-user-images\1594690060070.png)]](https://img-blog.csdnimg.cn/img_convert/85679b47b3c868c57b1fb88946ebcc3c.png)

每一個txt文本會生成一共5個數字:第一個是整形的數,表示類別:0表明第一類,以此類推,后面四個數字是坐標經過歸一化后的表示。

執行train_test_split.py

import os

import randomtrainval_percent = 1 # 可自行進行調節

train_percent = 1

xmlfilepath = './data/Annotations'

txtsavepath = './data/ImageSets\Main'

total_xml = os.listdir(xmlfilepath)num = len(total_xml)

list = range(num)

tv = int(num * trainval_percent)

tr = int(tv * train_percent)

trainval = random.sample(list, tv)

train = random.sample(trainval, tr)# ftrainval = open('ImageSets/Main/trainval.txt', 'w')

ftest = open('./data/ImageSets/Main/test.txt', 'w')

ftrain = open('./data/ImageSets/Main/train.txt', 'w')

# fval = open('ImageSets/Main/val.txt', 'w')for i in list:name = total_xml[i][:-4] + '\n'if i in trainval:# ftrainval.write(name)if i in train:ftest.write(name)# else:# fval.write(name)else:ftrain.write(name)# ftrainval.close()

ftrain.close()

# fval.close()

ftest.close()其中trainval_percent = 1表示驗證集比例,1表明1:9 若是有5000張圖片,就會切割成4500張訓練集,和500張驗證集。

trainval_percent = 1 # 可自行進行調節

運行path_trans補全路徑,并寫入train.txt

import xml.etree.ElementTree as ET

import pickle

import os

from os import listdir, getcwd

from os.path import joinsets = ['train', 'test']classes = ['smoke'] # 本身訓練的類別def convert(size, box):dw = 1. / size[0]dh = 1. / size[1]x = (box[0] + box[1]) / 2.0y = (box[2] + box[3]) / 2.0w = box[1] - box[0]h = box[3] - box[2]x = x * dww = w * dwy = y * dhh = h * dhreturn (x, y, w, h)def convert_annotation(image_id):in_file = open('data/Annotations/%s.xml' % (image_id), 'rb')out_file = open('data/labels/%s.txt' % (image_id), 'w')tree = ET.parse(in_file)root = tree.getroot()size = root.find('size')w = int(size.find('width').text)h = int(size.find('height').text)for obj in root.iter('object'):difficult = obj.find('difficult').textcls = obj.find('name').textif cls not in classes or int(difficult) == 1:continuecls_id = classes.index(cls)xmlbox = obj.find('bndbox')b = (float(xmlbox.find('xmin').text), float(xmlbox.find('xmax').text), float(xmlbox.find('ymin').text),float(xmlbox.find('ymax').text))bb = convert((w, h), b)out_file.write(str(cls_id) + " " + " ".join([str(a) for a in bb]) + '\n')wd = getcwd()

for image_set in sets:if not os.path.exists('data/labels/'):os.makedirs('data/labels/')image_ids = open('data/ImageSets/Main/%s.txt' % (image_set)).read().strip().split()list_file = open('data/%s.txt' % (image_set), 'w')for image_id in image_ids:list_file.write('data/images/%s.jpg\n' % (image_id))convert_annotation(image_id)list_file.close()

接下來編寫yaml文本:

見smoke.yaml

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-SNIdxzTn-1594698054813)(D:\CSDN\pic\吸煙檢測\1594691005832.png)]](https://img-blog.csdnimg.cn/img_convert/84bfb6eef849f4c554d7c64770ac9fa8.png)

將咱們上一步生成的train.txt 和test.txt 補全路徑后的這兩個txt路徑寫入到yaml中,而后nc:修改成本身類別的數量,以及names【‘smoke’】

4、開始訓練

4.1:開始訓練

在上面咱們作好數據預處理后,就能夠開始訓練了,上面的一些處理步驟,每一個人均可能不一樣,不過大致上思路是一致的。

接下來咱們能夠進行預訓練,下載官方的預訓練模型:

yolov5s yolov5m yolov5l yolov5x來 我在個人github中方了yolov5s,比較小,只有25mb,專門為移動端考慮了,真好。

固然也能夠不使用預訓練模型,使用與否,在總時間上是差很少的,不過

為何要使用預訓練模型?

做者已盡其所能設計了基準模型。咱們能夠在本身的數據集上使用預訓練模型,而不是從頭構建模型來解決相似的天然語言處理問題。

盡管仍然須要進行一些微調,但它已經為咱們節省了大量的時間:一般是每一個損失降低更快和計算資源節省。

加快梯度降低的收斂速度

更有可能得到一個低模型偏差,或者低泛化偏差的模型

下降因未初始化或初始化不當致使的梯度消失或者梯度爆炸問題。此狀況會致使模型訓練速度變慢,崩潰,直至失敗。

其中隨機初始化,能夠打破對稱性,從而保證不一樣的隱藏單元能夠學習到不一樣的東西

接下來開始訓練:

python train.py --data data/smoke.yaml --cfg models/yolov5s.yaml --weights weights/yolov5s.pt --batch-size 10 --epochs 100解釋一下:

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-vuVhuRvJ-1594698054817)(D:\CSDN\pic\吸煙檢測\1594693318445.png)]](https://img-blog.csdnimg.cn/img_convert/2750504d69ac6f4b614aef26716e0b71.png)

咱們–data data/smoke.yaml 中就是在smoke.yaml中撰寫的訓練代碼路徑和類別等data,經過這個獲取訓練的圖片和label標簽等。

而后-cfg models/yolov5s.yaml 和 --weights weights/yolov5s.pt是獲取配置和預訓練模型權重

batch-size 10 你們都懂,default是16,你們能夠改為16,在yolov5s中模型參施很少,百萬左右,因此顯存消耗很少,個人配置不好,顯存4g,在使用yolov5m中以及不能調到16。

會報cuda out of memory 報錯,就把batch size下降就行。

而后最后是epoch,這個也不用解釋,我在使用yolov5m訓練5k張圖片在100epoch中花費 了24小時,一個epoch13分鐘。

訓練過程當中,會慢慢在runs中生成tensorboard,可視化損失降低

固然也能夠在本地稍微看看:![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-tSjJFqPI-1594698054819)(D:\CSDN\pic\吸煙檢測\1594694078732.png)]](https://img-blog.csdnimg.cn/img_convert/49ca2a9ac5bc28ad989cd35d8e48ebb1.png)

這幅圖中,咱們的類別只有1個,第三幅圖顯示了咱們數據中的寬高比,歸一化后,廣泛在0.1左右,說明數據確實很小,也會面臨模糊問題,致使數據質量下降。

4.2:訓練過程

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-AwsYh6Fd-1594698054821)(D:\CSDN\pic\吸煙檢測\1594694802784.png)]](https://img-blog.csdnimg.cn/img_convert/70421123b3ca26248603b4076b6cf4ff.png)

分別是epoch,顯存消耗…其余的你們能夠查看源碼

4.3:訓練優化

使用混合精度模型

在前面配置好環境后:

mixed_precision = True

try: # Mixed precision training https://github.com/NVIDIA/apexfrom apex import amp

except:print('Apex recommended for faster mixed precision training: https://github.com/NVIDIA/apex')mixed_precision = False # not installed

判斷是否可用apex作混合精度模型訓練

而后

if mixed_precision:model, optimizer = amp.initialize(model, optimizer, opt_level='O1', verbosity=0)

在optimizer中amp初始化一下 o1表明級別,注意是歐 不是零。

接著:

if mixed_precision:with amp.scale_loss(loss, optimizer) as scaled_loss:scaled_loss.backward()

優化反向傳播。

組裝到cuda訓練

opt.img_size.extend([opt.img_size[-1]] * (2 - len(opt.img_size))) # extend to 2 sizes (train, test)device = torch_utils.select_device(opt.device, apex=mixed_precision, batch_size=opt.batch_size)if device.type == 'cpu':mixed_precision = False

4.4 訓練參數:

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-BRPhpP1F-1594698054825)(D:\CSDN\pic\吸煙檢測\1594695858251.png)]](https://img-blog.csdnimg.cn/img_convert/c92c59b0be388866611a6cbb06938e08.png)

詳情參見注釋。

5、實時檢測

運行detect.py便可

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-kxk153R0-1594698054828)(D:\CSDN\pic\吸煙檢測\1594696030729.png)]](https://img-blog.csdnimg.cn/img_convert/8c195168fe88cf428ad83953586e4116.png)

其中,推理一張圖片,那么就在–source中的default寫上圖片路徑,

也能夠如圖寫上整個圖片文件夾,這樣會檢測全部圖片。

也能夠寫上視頻地址和視頻文件夾,檢測全部視頻,存放于inference 的out中。

改為0 就是實時檢測了~默認電腦攝像頭,固然也能夠改為手機。這個也很簡單,須要的能夠私聊我,微信會放在最下方。

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-gaXEwy1a-1594698054830)(D:\CSDN\pic\吸煙檢測\1594696346542.png)]](https://img-blog.csdnimg.cn/img_convert/90041ffaccc4862f026bf78f156c8707.png)

幀率很高,普通設備也能達到30+,可謂是速度極快,要是你們設備好一些,能夠試一下YOLOv5L和YOLOV5x,跑完了能夠私聊分享一下,與我交流。

6、YOLO系列可視化對比

類別100類

每類300張圖片

測試圖片1087張,閥值0.5 ,預測正確

yolov3-tiny yolov4 yolov5

預測結果 737 954 955

模型大小 33.97M 246.19M 28.99M(yolov5s.pt)

yolov5s的精度和yolov4差很少,但模型大小只有yolov4的11.77%(我的數據集,數據可能有點誤差,但仍是能說明問題的)

實時對比

![[外鏈圖片轉存失敗,源站可能有防盜鏈機制,建議將圖片保存下來直接上傳(img-soSpEIJF-1594698054832)(D:\CSDN\pic\吸煙檢測\1594697092978.png)]](https://img-blog.csdnimg.cn/img_convert/9f351dbea883d1831d835364963fbd75.png)

附上視頻:https://www.bilibili.com/video/av328439400/

7、寫在后面

這篇文章大體介紹了yolov5的自訓練,接下來咱們能夠進行調優。已經作消融對比實驗,慢慢的更熟悉目標檢測。繼續我會在下篇中介紹文中的一些技術棧,讓你們知根知底。

所有連接傳送門

最后再發一次全部的連接!

香煙數據集:連接:https://pan.baidu.com/s/1t8u94x51TO7pLciU8AoaiQ

提取碼:n2wr

吸煙手勢數據集:連接:https://pan.baidu.com/s/1BSH4yn3GBzF3hDTWAqKzDQ

提取碼:9r8t

煙霧數據集:連接:https://pan.baidu.com/s/1RKvkkmfpHiPunkFMAEdoAQ

提取碼:ag0x

YOLOv5 原做者github:https://github.com/ultralytics/yolov5

個人github :https://github.com/CVUsers/Smoke-Detect-by-YoloV5/tree/master?歡迎star ,將長期更新!

最后還有不少知識點沒分享,關注一下博主,下次分享。

另外歡迎加入深度學習算法交流群,與群內工程師朋友門一塊兒交流學術,共商算法,加油!

?

)

![[Vijos 1143]三取方格數](http://pic.xiahunao.cn/[Vijos 1143]三取方格數)

)

和反斜杠( \ )的區別)

的返評)