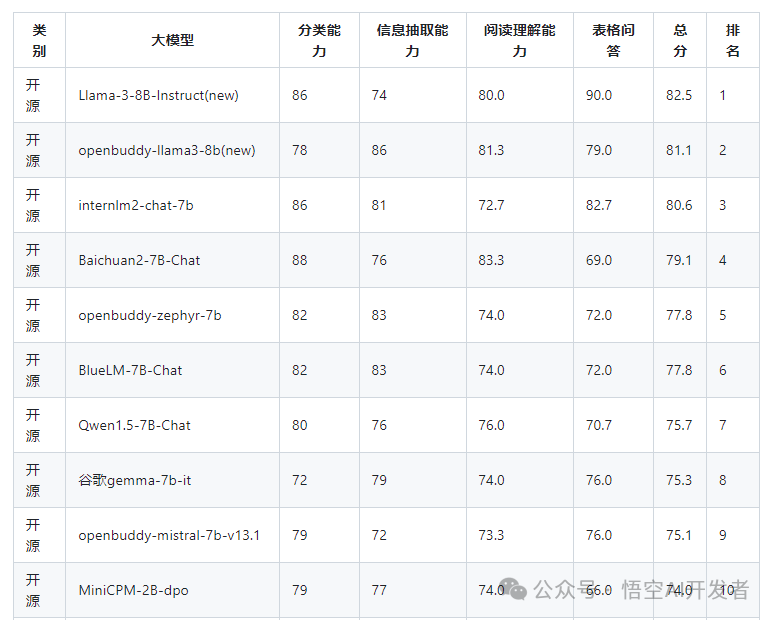

????????今天給大家帶來 AI 大模型領域的國產之光 - InternLM2,在10B量級開源大模型領域取得了全球 Top 3 的成績,僅次于 Meta 發布的 Llama-3,在國內則是第一名的存在!

簡介

??? InternLM2是由上海人工智能實驗室和商湯科技聯合研發的一款大型語言模型(LLM),它在多個基準測試中展現出卓越的性能,尤其在長文本處理和開放式主觀評估方面。以下是InternLM2的幾個關鍵特點:

-

長文本處理能力:InternLM2特別設計了長上下文處理能力,能夠處理長達200k個令牌的文本,這使得它在處理長篇幅內容時表現出色。

-

開源和免費商用:InternLM2模型及其全鏈條開源工具體系面向公眾全面開源,并且可以免費商用,這促進了其在學術和工業界的廣泛應用。

-

多階段訓練:模型的訓練包括預訓練、監督微調(SFT)和基于人類反饋的強化學習(RLHF)。這些階段確保了模型在遵循指令和符合人類價值觀方面的性能。

-

技術創新:InternLM2采用了分組查詢注意力(GQA)技術來減少長序列推斷時的內存占用,并通過位置編碼外推技術進一步提升了模型的上下文長度處理能力。

-

性能提升:通過條件在線RLHF(COOL RLHF)技術,InternLM2能夠協調多樣但可能沖突的偏好,并通過多輪Proximal Policy Optimization(PPO)來減少獎勵作弊問題。

-

社區貢獻:InternLM2的貢獻不僅在于其高性能,還在于提供了全面的數據準備指南和創新的RLHF訓練技術,為社區提供了深入理解和進一步研究的基礎。

-

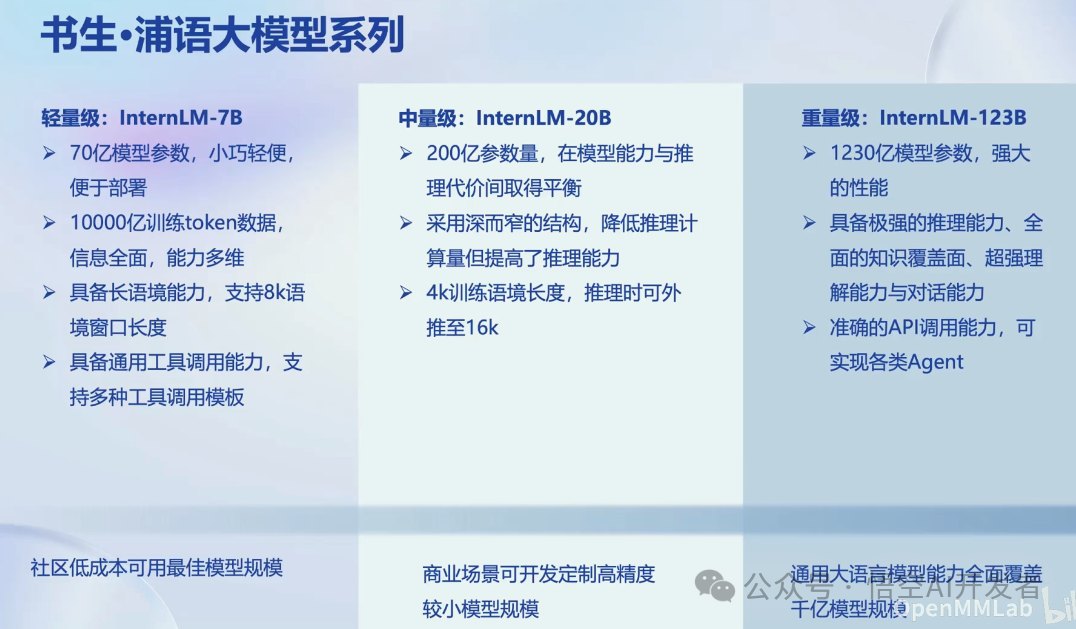

模型規模:InternLM2發布了不同規模的模型,包括18億、70億和200億參數的版本,以適應不同的研究和應用需求。

分類

按照模型大小分類

7B:為輕量級的研究和應用提供了一個輕便但性能不俗的模型

20B:模型的綜合性能更為強勁,可有效支持更加復雜的使用場景

按照模型命名分類

InternLM2-Base:高質量和具有很強可塑性的模型基座,是模型進行深度領域適配的高質量起點

InternLM2:在Base基礎上,在多個能力方向進行了強化,在評測中成績優異,同時保持了很好的通用語言能力,是我們推薦的在大部分應用中考慮選用的優秀基座

InternLM2-Chat:在Base基礎上,經過SFT和RLHF,面向對話交互進行了優化,具有很好的指令遵循,共情聊天和調用工具等能力

技術生態

訓練&評測數據

模型微調

模型評測

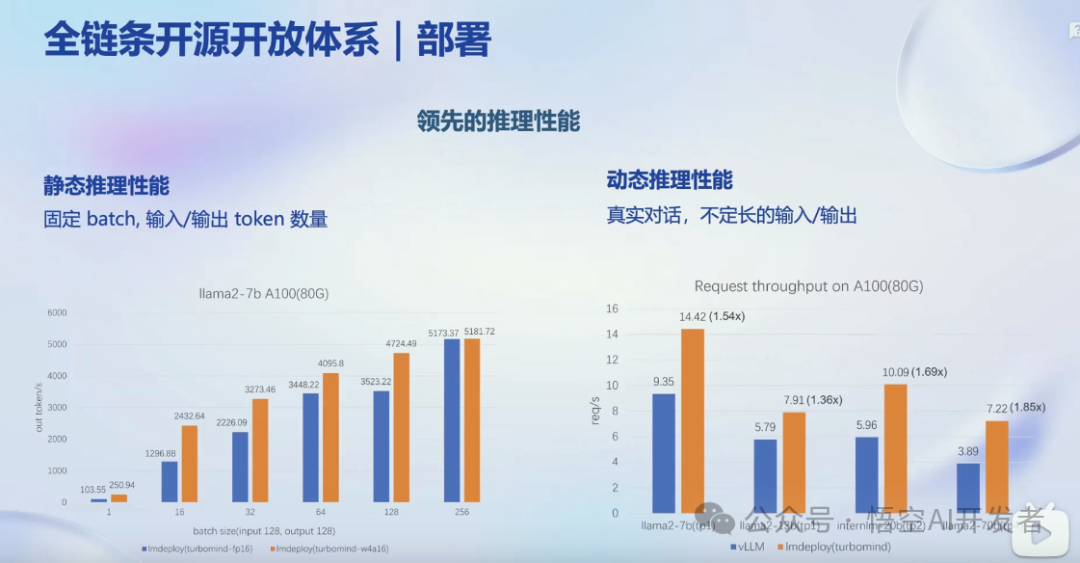

模型部署

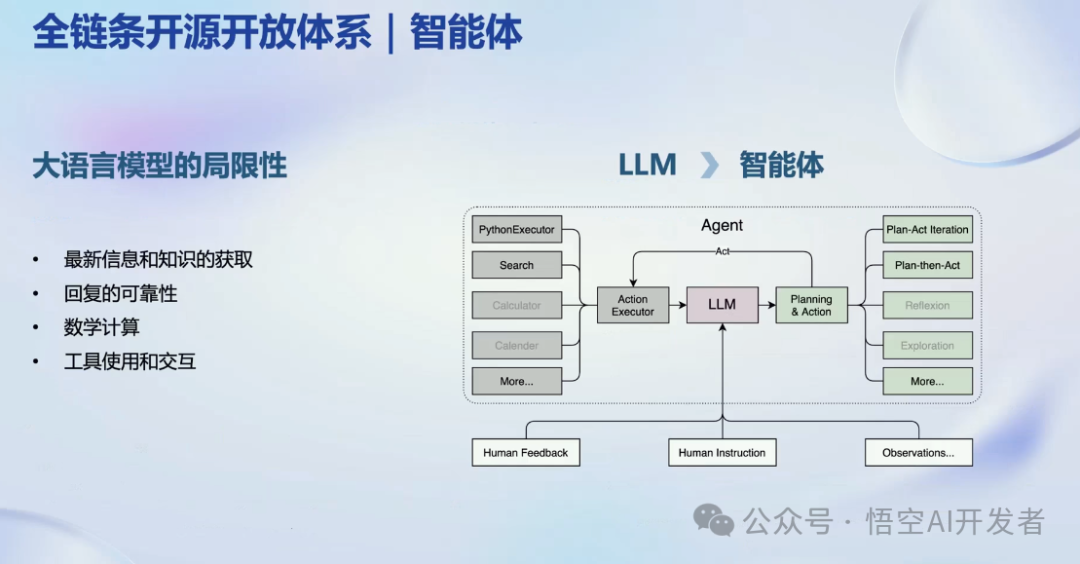

AI 智能體

????接下來的文章將詳細講解如何用 internLM2 訓練我們自己的 chatGPT,感興趣的可以點贊收藏關注!

)

:靜態、友元和內部類)