論文鏈接:https://arxiv.org/pdf/2303.17472

源碼鏈接:https://github.com/QitaoZhao/PoseFormerV2

Abstract

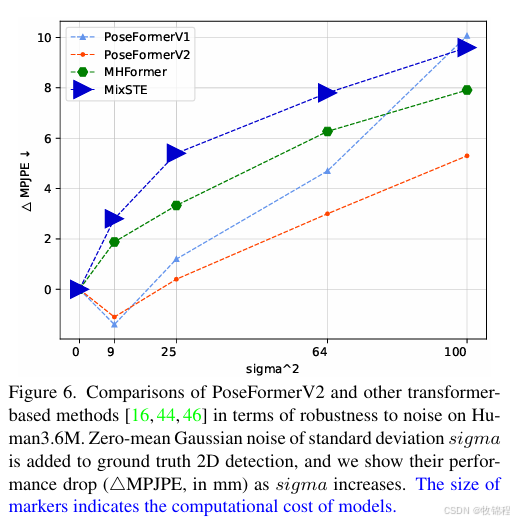

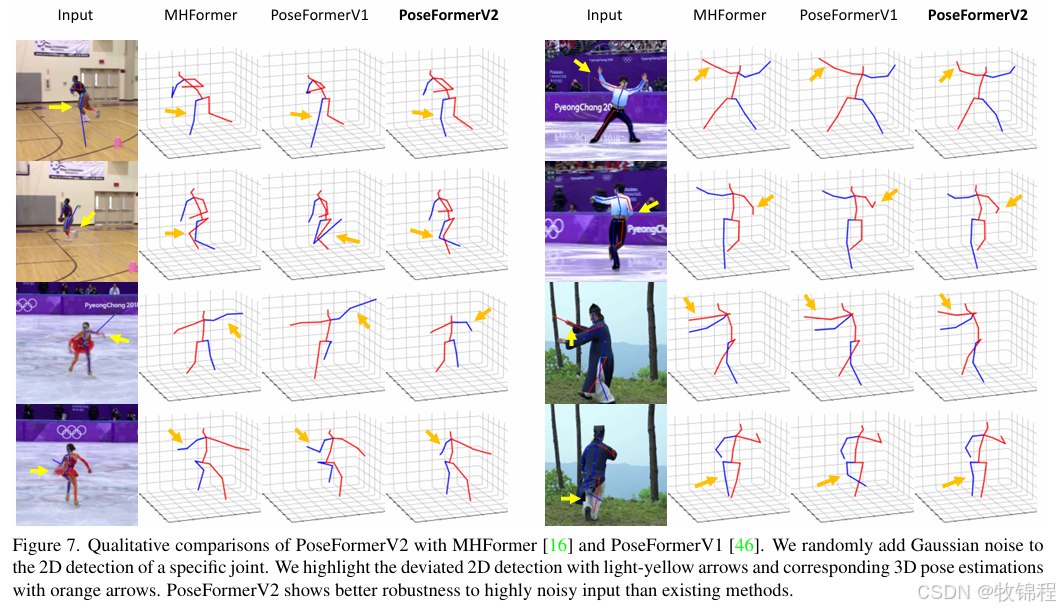

本文提出了 PoseFormerV2,通過探索頻率域來提高 3D 人體姿態估計的效率和魯棒性。PoseFormerV2 利用離散余弦變換(DCT)將骨骼序列轉換為低頻系數,顯著減少了計算量并提高了對噪聲的抵抗力。實驗表明,PoseFormerV2 在速度-精度權衡和魯棒性方面顯著優于 PoseFormer 和其他 Transformer 方法。

Introduction

-

目標:3D 人體姿態估計(HPE)旨在通過單目視頻或 2D 關節序列估計人體關節的三維位置。

-

主流方法:隨著 2D 姿態檢測器的普及和 2D 表示的輕量性,2D-to-3D lifting 方法成為主流。

-

Transformer 的優勢:Transformer 方法因其在建模離散關節和長時序依賴方面的優勢,成為 3D 姿態估計的首選。

-

現有問題:

-

處理長序列時計算負擔重。

-

對噪聲 2D 檢測缺乏魯棒性。

-

-

具體問題示例:PoseFormer 在 Human3.6M 數據集上使用真實 2D 檢測時 MPJPE 為 31.3 mm,而使用 CPN 檢測時性能下降至 44.3 mm。

-

解決方案:PoseFormerV2 引入頻率域表示,通過離散余弦變換(DCT)將長序列壓縮為低頻系數,顯著減少計算量并增強魯棒性。

-

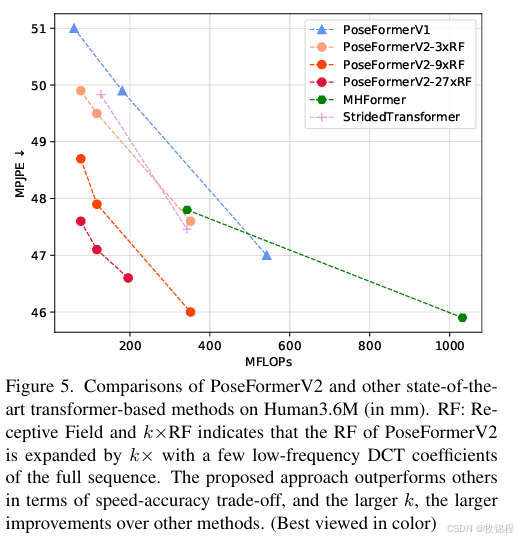

實驗結果:PoseFormerV2 在速度和精度上優于其他方法,包括原始 PoseFormer 和其他 Transformer 變體。

Related Work

Transformer-based 3D Human Pose Estimation

-

oseFormer:首個將 Transformer 應用于 3D 人體姿態估計的方法,通過時空編碼器提取特征,顯著優于傳統卷積方法。

-

效率問題:PoseFormer 在處理長序列時效率低下,計算負擔隨幀數增加而顯著增加。

-

魯棒性問題:PoseFormer 對噪聲 2D 關節檢測敏感,性能受 2D 檢測質量影響較大。

-

后續改進:

-

MHFormer:引入多假設生成技術,模擬身體部位的深度模糊和 2D 檢測器的不確定性,提升魯棒性。

-

P-STMO:采用掩碼關節建模技術,通過自監督學習提高性能。

-

StridedTransformer:通過步進卷積減少計算量,但犧牲了部分性能。

-

Einfalt et al.:通過下采樣輸入視頻幀減少計算量,但可能影響精度。

-

-

現存問題:盡管有改進,但現有方法仍未同時解決效率和魯棒性問題。

Frequency Representation in Vision

-

頻率域表示:在計算機視覺中已有廣泛應用,如 JPEG 圖像壓縮和基于 DCT 的特征提取。

-

低頻系數的作用:

-

捕捉輸入序列的主要特征。

-

過濾高頻噪聲,提升模型對噪聲的抵抗力。

-

-

PoseFormerV2 的創新:

-

將頻率域表示應用于 3D 人體姿態估計。

-

通過離散余弦變換(DCT)將骨骼序列轉換為低頻系數,顯著減少計算量。

-

提出時間-頻率特征融合模塊,結合時間域和頻率域特征,提升模型性能。

-

Method

Preliminaries of PoseFormerV1

-

特征提取分階段:PoseFormerV1 將 2D 關節序列的特征提取分為兩個階段:

-

空間編碼器:用于建模單幀內關節關系,捕捉幀內關節的相互依賴。

-

時間編碼器:用于建模跨幀人體運動,捕捉幀間的時間依賴。

-

-

計算復雜度:PoseFormerV1 在處理長序列時計算復雜度高,因為自注意力機制對所有幀進行密集建模。

-

對噪聲敏感:PoseFormerV1 對 2D 關節檢測噪聲敏感,性能受輸入質量影響較大。

PoseFormerV2

Frequency Representation of Skeleton Sequence

-

離散余弦變換(DCT):PoseFormerV2 通過 DCT 將骨骼序列轉換為低頻系數,利用少量低頻系數表示整個序列。

-

減少輸入長度:低頻系數顯著減少了輸入長度,降低了計算復雜度。

-

過濾高頻噪聲:低頻系數過濾了高頻噪聲,增強了模型對噪聲的抵抗力。

-

實驗驗證:實驗表明,僅需少量低頻系數即可捕捉序列的主要特征,同時保持較高的精度。

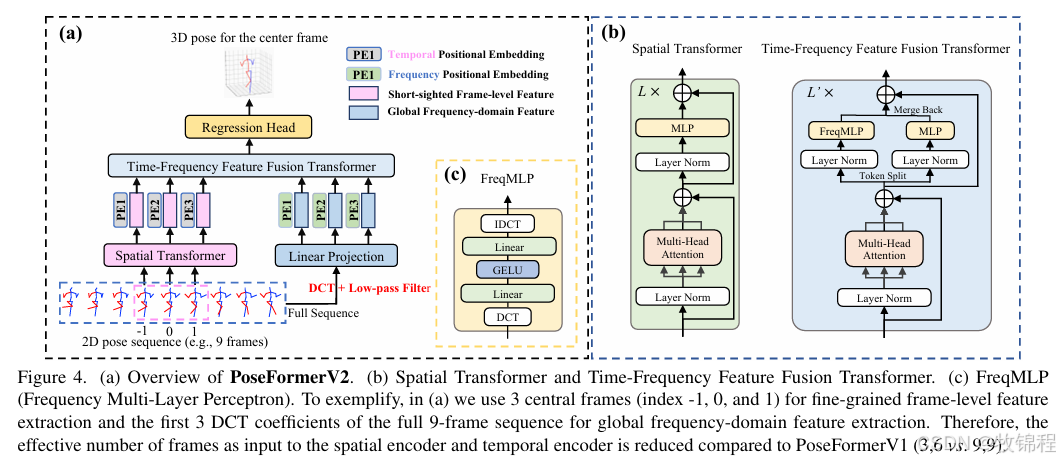

Architecture

-

空間 Transformer 編碼器:

-

僅處理少量中心幀,減少計算量。

-

提取幀內關節的高維特征。

-

-

時間-頻率特征融合模塊:

-

結合時間域和頻率域特征,增強模型對長序列的處理能力。

-

使用 FreqMLP 調整頻率特征權重,補充時間域特征的細節信息。

-

-

回歸頭:

-

通過 1D 卷積層聚集時間信息。

-

輸出中心幀的 3D 姿態。

-

-

整體優勢:PoseFormerV2 在時間域和頻率域之間進行有效的特征融合,顯著減少了計算量,同時保持了更好的速度-精度權衡。

Experiments

Datasets and Evaluation Metrics

數據集

Human3.6M:最常用的室內 3D 姿態估計數據集,包含 11 名演員的 15 種動作,從 4 個不同視角拍攝,共 360 萬幀。

MPI-INF-3DHP:更具挑戰性的室內外場景數據集,包含復雜背景和多種動作,提供 6 個不同場景的測試集。

評價指標

MPJPE(Mean Per Joint Position Error):預測的 3D 姿態與真實值之間的平均歐幾里得距離。

P-MPJPE(Procrustes Mean Per Joint Position Error):對預測的 3D 姿態進行剛性對齊后的 MPJPE。

PCK(Percentage of Correct Keypoints):在 150mm 范圍內的正確關節點的百分比。

AUC(Area Under Curve):曲線下面積。

Implementation Details and Analysis

實現框架

基于 PyTorch,使用 AdamW 優化器,學習率設置為 8e-4,并采用指數衰減策略。

超參數調整

輸入幀數(f)和 DCT 系數數量(n)是關鍵超參數,實驗中通過調整這些參數展示了模型在速度和精度之間的靈活權衡。

例如,當 f = 3、n = 3 時,模型在 Human3.6M 數據集上達到了 47.9 mm 的 MPJPE,計算量為 117.3 MFLOPs。

硬件配置

實驗在單個 NVIDIA RTX 3090 GPU 上進行,支持高效的訓練和推理。

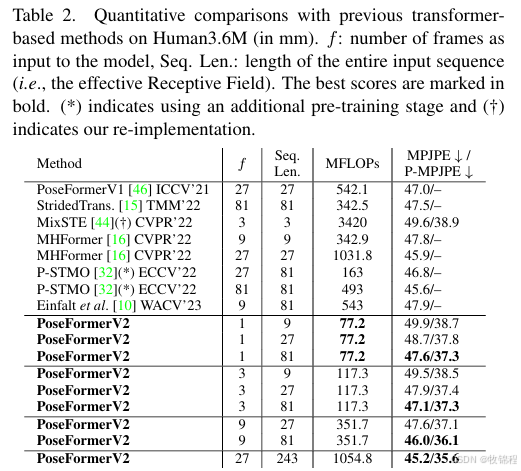

Comparisons with State-of-the-art Methods

Human3.6M 數據集

PoseFormerV2

81 幀輸入,77.2 MFLOPs,MPJPE 為 47.6 mm。

243 幀輸入,1054.8 MFLOPs,MPJPE 為 45.2 mm。

其他方法

PoseFormerV1:81 幀輸入,1.36 GFLOPs,MPJPE 為 47.0 mm。

MHFormer:81 幀輸入,342.9 MFLOPs,MPJPE 為 47.8 mm。

P-STMO:243 幀輸入,493 MFLOPs,MPJPE 為 45.6 mm。

結論

PoseFormerV2 在速度和精度之間取得了更好的權衡,尤其是在處理長序列時表現出更高的效率。

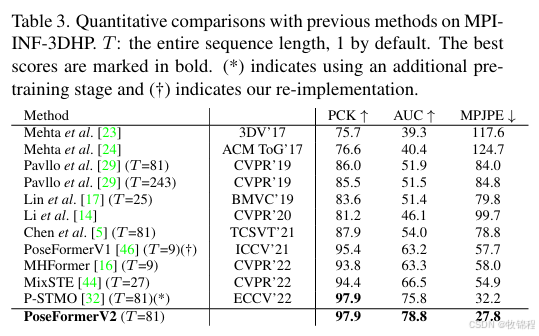

MPI-INF-3DHP 數據集

PoseFormerV2

PCK 為 97.9%,AUC 為 78.8%,MPJPE 為 27.8 mm。

其他方法

PoseFormerV1:PCK 為 95.4%,AUC 為 63.2%,MPJPE 為 57.7 mm。

P-STMO:PCK 為 97.9%,AUC 為 75.8%,MPJPE 為 32.2 mm。

結論

PoseFormerV2 在 MPI-INF-3DHP 數據集上也取得了最佳性能,驗證了其在復雜場景下的魯棒性和準確性。

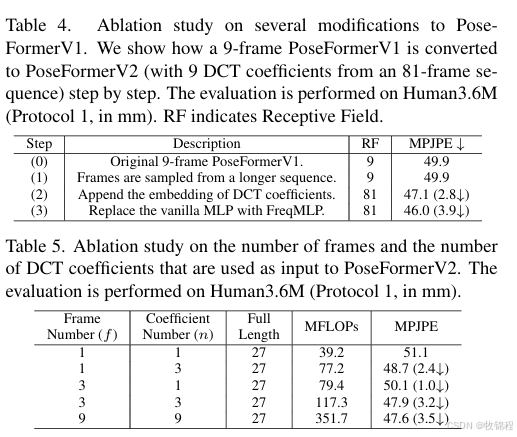

Ablation Study

逐步改進

原始 PoseFormerV1:9 幀輸入,MPJPE 為 49.9 mm。

引入低頻 DCT 系數:81 幀輸入,MPJPE 降低到 47.1 mm。

引入 FreqMLP:MPJPE 進一步降低到 46.0 mm。

輸入幀數和 DCT 系數數量的影響

實驗證明,增加輸入幀數和 DCT 系數數量可以顯著提高精度。例如,使用 3 個中心幀和 9 個 DCT 系數時,MPJPE 為 47.9 mm,計算量為 117.3 MFLOPs。

結論

僅需少量中心幀和低頻系數即可顯著提高精度和魯棒性,同時保持較低的計算量。

Generalization Ability

推廣到其他方法

MixSTE:引入低頻 DCT 系數后,MPJPE 從 46.2 mm 降低到 45.3 mm,計算量從 30.8 GFLOPs 降低到 15.4 GFLOPs。

MHFormer:引入低頻 DCT 系數后,魯棒性顯著提升,計算量減少。

結論

PoseFormerV2 的頻率域表示方法可以推廣到其他 Transformer 基方法,顯著提升效率和魯棒性。

Conclusion

PoseFormerV2 通過引入頻率域表示,顯著提高了 3D 人體姿態估計的效率和魯棒性。具體貢獻如下:

效率提升:PoseFormerV2 利用離散余弦變換(DCT)將長骨骼序列壓縮為低頻系數,顯著減少了輸入長度和計算量。實驗表明,PoseFormerV2 在處理長序列時的計算效率遠高于其他方法,例如在 81 幀輸入下僅需 77.2 MFLOPs,而 MHFormer 需要 342.9 MFLOPs。

魯棒性增強:低頻系數過濾了高頻噪聲,增強了模型對噪聲 2D 關節檢測的抵抗力。實驗表明,PoseFormerV2 在噪聲環境下仍能保持較高的估計精度。

性能提升:在 Human3.6M 和 MPI-INF-3DHP 兩個基準數據集上,PoseFormerV2 均取得了優于其他 Transformer 基方法的性能,驗證了其在速度和精度之間的良好權衡。

通用性:PoseFormerV2 的方法可以推廣到其他 Transformer 基方法,如 MixSTE 和 MHFormer,通過引入低頻 DCT 系數,這些方法在效率和魯棒性方面也得到了提升。

Future Work

自動優化超參數:目前,PoseFormerV2 的超參數(如輸入幀數和 DCT 系數數量)是基于實驗結果手動調整的。未來工作將探索如何將這些參數設置為可學習的,從而自動優化模型性能。

擴展到其他任務:PoseFormerV2 的頻率域表示方法不僅適用于 3D 人體姿態估計,還可以推廣到其他需要處理長序列的任務,如動作識別和行為分析。

理論分析:進一步理論分析頻率域表示在 3D 姿態估計中的優勢,為未來的研究提供更深入的理論支持。

PoseFormerV2 為 3D 人體姿態估計領域提供了新的視角,通過頻率域表示解決了效率和魯棒性問題,為實際應用提供了更強大的工具。

硬性的標準其實限制不了無限可能的我們,所以啊!少年們加油吧!

和收斂)

)

)