LLM面試題及講解 4

目錄

- LLM面試題及講解 4

-

-

- 題目講解

- 一、基礎概念與理論

- 二、模型訓練與優化

- 三、應用與實踐

- 四、前沿研究與趨勢

-

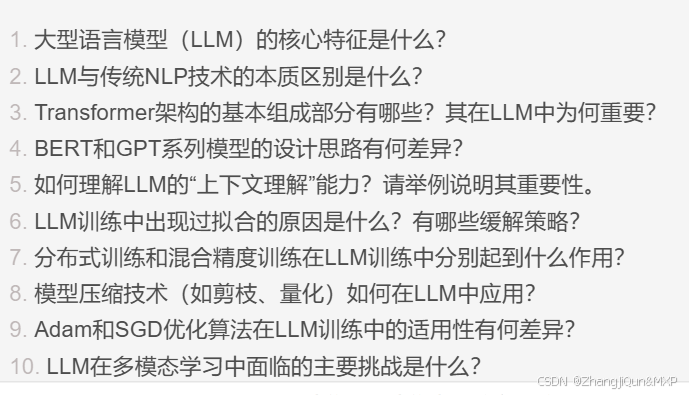

- 大型語言模型(LLM)的核心特征是什么?

- LLM與傳統NLP技術的本質區別是什么?

- Transformer架構的基本組成部分有哪些?其在LLM中為何重要?

- BERT和GPT系列模型的設計思路有何差異?

- 如何理解LLM的“上下文理解”能力?請舉例說明其重要性。

- LLM訓練中出現過擬合的原因是什么?有哪些緩解策略?

- 分布式訓練和混合精度訓練在LLM訓練中分別起到什么作用?

- 模型壓縮技術(如剪枝、量化)如何在LLM中應用?

- Adam和SGD優化算法在LLM訓練中的適用性有何差異?

- LLM在多模態學習中面臨的主要挑戰是什么?

題目講解

-

大型語言模型(LLM)的核心特征是什么?

LLM的核心特征包括:- 參數量龐大(通常數十億至數千億),能夠捕捉復雜的語言規律和世界知識;

- 基于Transformer架構,通過自注意力機制實現對長文本上下文的深度理解;

- 具備強泛化能力,可通過零樣本或少樣本學習完成未專門訓練的任務(如未訓練過“寫劇本”

)

)

在心血管研究中的多元應用)