? ? 上節內容講解了wan2.2 fun control本節內容對wan2.2 fun系列模型的camera鏡頭控制模型與lnp首尾幀視頻模型進行測試與講解。

? ? ?Wan2.2-Fun-Camera-Control是阿里基于Wan2.2框架推出的圖生視頻運鏡控制模型 。它支持512、768、1024等多分辨率的視頻預測,以81幀、每秒16幀視頻數據集訓練,還支持多語言預測。該模型能實現豐富運鏡效果,包括搖鏡上移、左移、右移、下移,推鏡、拉鏡,以及搖鏡上移與左移或右移的組合等。借助它,創作者無需復雜提示詞,就能精準實現復雜運鏡視頻控制,極大提升視頻創作中鏡頭語言的表現力 。?

? ? Wan2.2-Fun-Inp是阿里巴巴PAI團隊開源的視頻首尾幀生成模型,采用Apache 2.0許可協議,支持商業使用。它允許用戶輸入首幀與尾幀圖像,模型自動補全中間過渡動畫,有效提升視頻連貫性與創作自由度。基于先進的Wan2.2架構,它能輸出影視級高質量視頻,在畫面細節、光影和色彩表現上十分出色。并且,該模型支持512×512、768×768、1024×1024等多分辨率視頻生成,可滿足廣告制作、影視創作、短視頻制作等不同場景需求 。(wan2.2基礎模型也具備首尾幀視頻功能,詳見wan2.2基礎模型對應文章內容)

? ? 文末附相關模型的網盤下載地址。

1 模型下載

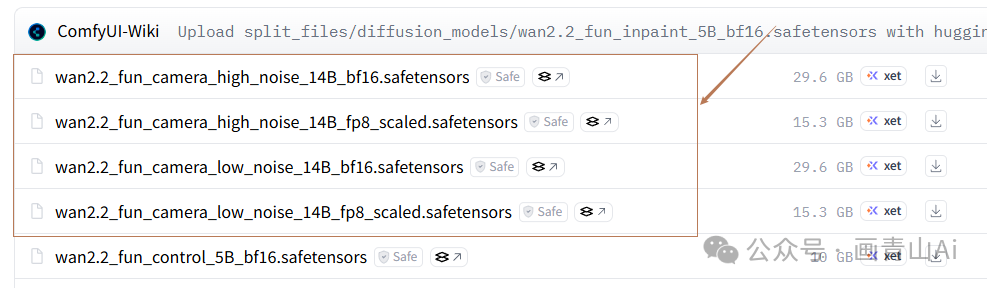

1.1 wan2.2 fun camera鏡頭控制模型

模型下載地址(需科學上網):

https://huggingface.co/Comfy-Org/Wan_2.2_ComfyUI_Repackaged/tree/main/split_files/diffusion_models

模型分為5B和14B模型兩種規格。

14B模型劃分為高噪聲模型與低噪聲模型,且每類模型又分為fp16與fp8兩種模型。

模型安裝位置:..\ComfyUI\models\diffusion_models

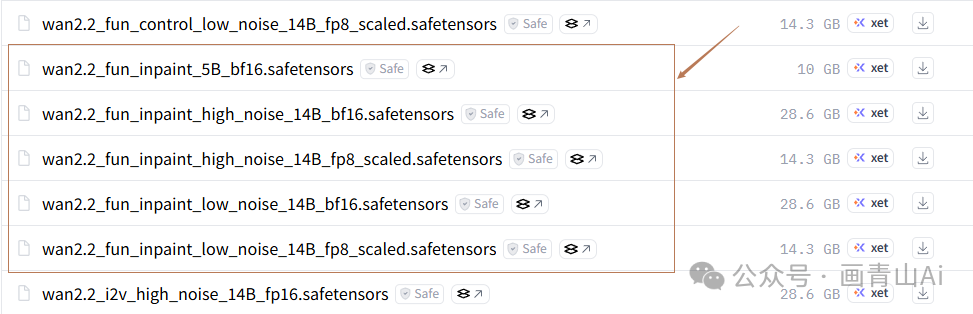

1.2?Wan2.2-Fun-Inp首尾幀視頻模型

上述模型下載地址中,下載名稱為wan2.2funinpaint相關模型。

模型安裝位置:..\ComfyUI\models\diffusion_models

注:wan2.2系列模型對應的VAE等模型使用方式一致,如已按前文內容下載VAE等模型,則后續模型無需再重復下載。

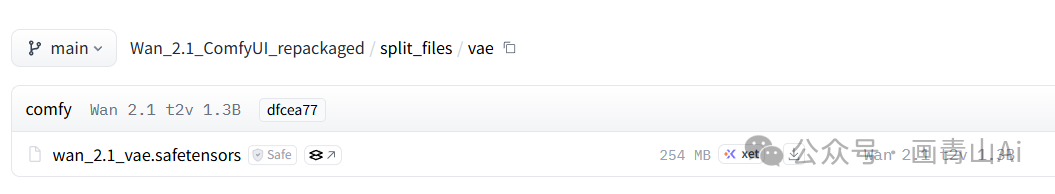

1.3?VAE模型

(1)14B版本模型工作流中所使用的VAE模型仍是wan2.1版本的VAE模型。

下載地址:

https://huggingface.co/Comfy-Org/Wan_2.1_ComfyUI_repackaged/tree/main/split_files/vae

文件存放目錄:..\comfyui\models\vae

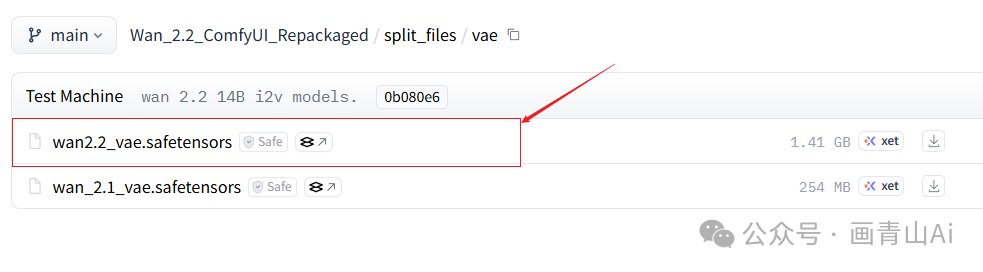

(2)5B混合模型使用wan2.2專用VAE模型,下載地址:

wan2.2_vae.safetensors

模型下載地址(需科學上網):

https://huggingface.co/Comfy-Org/Wan_2.2_ComfyUI_Repackaged/tree/main/split_files/vae

模型安裝位置:..\comfyui\models\vae

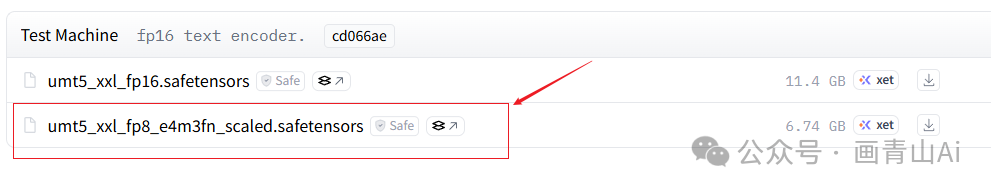

1.4Text Encoder文本編碼器

umt5_xxl_fp8_e4m3fn_scaled.safetensors

模型下載地址(需科學上網):

https://huggingface.co/Comfy-Org/Wan_2.2_ComfyUI_Repackaged/tree/main/split_files/text_encoders

注:該模型與wan2.1/2.2系列模型共用,如已使用過wan模型則無需重復下載。

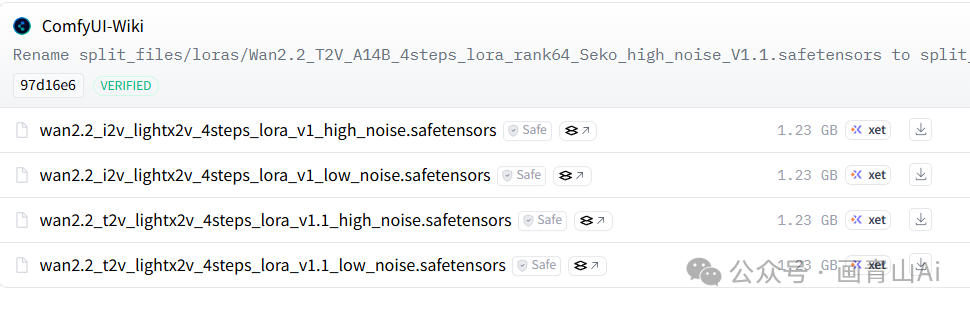

1.5加速lora模型(lightx2v_4steps_lora)

模型下載地址(需科學上網):

https://huggingface.co/Comfy-Org/Wan_2.2_ComfyUI_Repackaged/tree/main/split_files/loras

模型安裝目錄:..\comfyui\models\loras

高噪聲和低噪聲模型加載器后均需鏈接對應版本的加速lora模型。

使用了 lightx2v 的?Wan2.2-Lightning?4 步 LoRA : 但可能導致生成的視頻動態會有損失,但速度會更快。下面是comfyorg官方使用RTX4090D 24GB顯存GPU 測試的結果 640*640 分辨率,81 幀長度的用時對比:

| 模型類型 | 分辨率 | 顯存占用 | 首次生成時長 | 第二次生成時長 |

| fp8_scaled | 640×640 | 83% | ≈ 524秒 | ≈ 520秒 |

| fp8_scaled + 4步LoRA加速 | 640×640 | 89% | ≈ 138秒 | ≈ 79秒 |

2 工作流

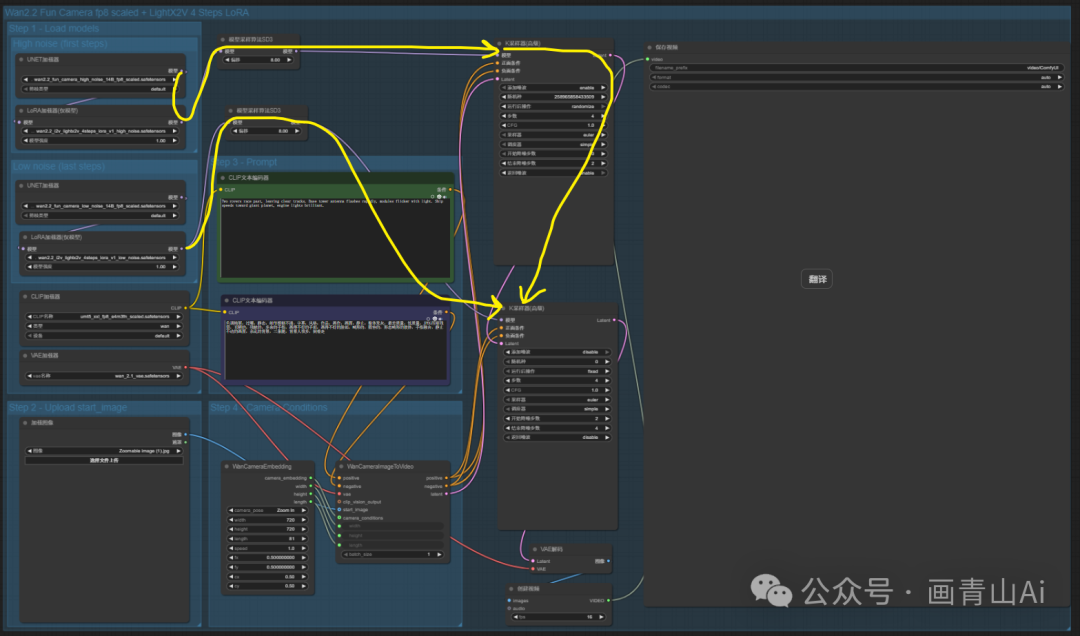

2.1 wan2.2 fun camera鏡頭控制模型

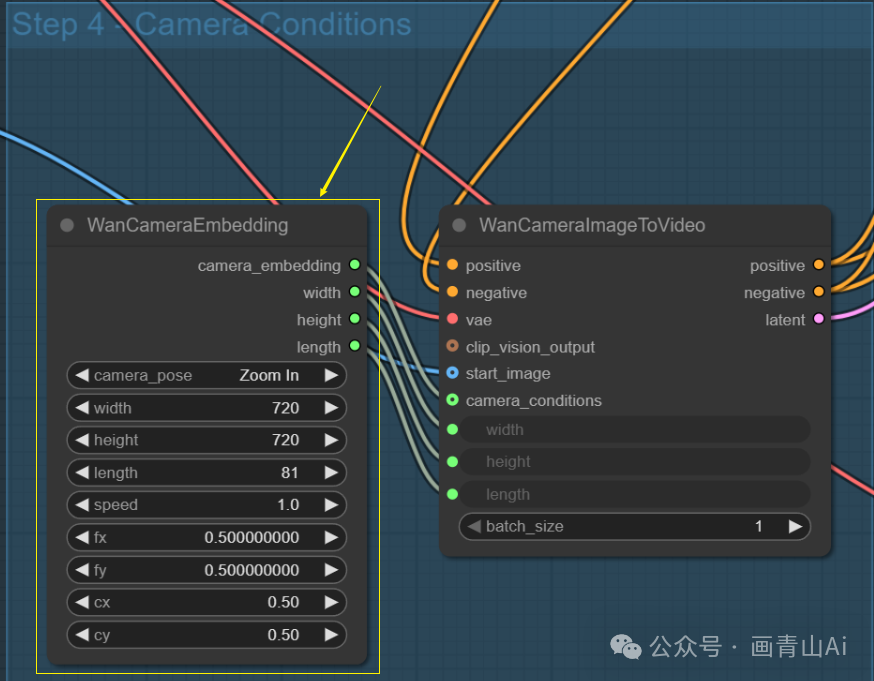

在 WanCameraEmbedding 節點設置相機控制參數:

Camera Motion: 選擇相機運動類型(Zoom In、Zoom Out、Pan Up、Pan Down、Pan Left、Pan Right、Static 等)

Width/Height: 設置視頻分辨率

Length: 設置視頻幀數(默認81幀)

Speed: 設置視頻速度(默認1.0)

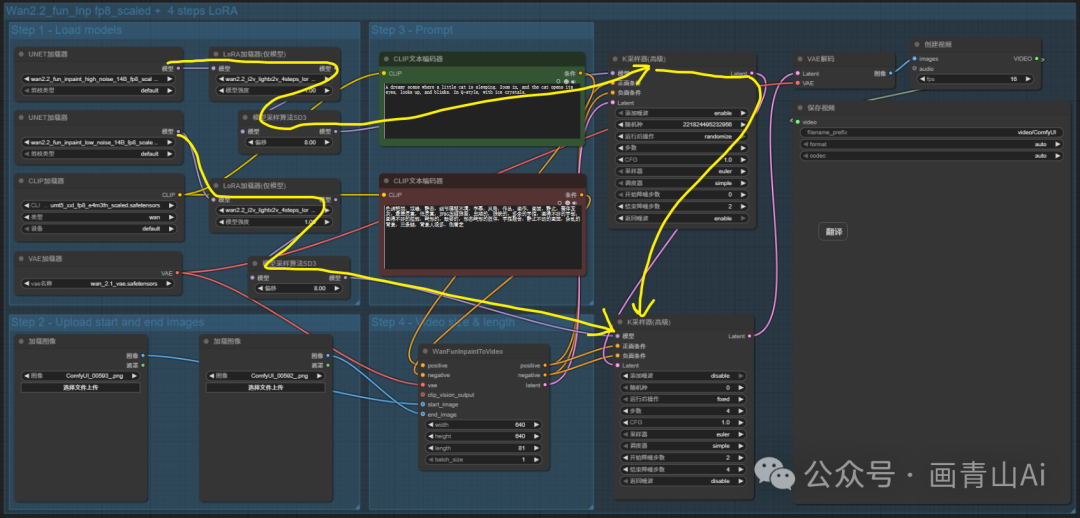

2.2wan2.2 fun lnp首尾幀視頻模型

(1)首尾幀圖片上傳,分別上傳首尾幀圖片素材

(2)WanFunInpaintToVideo 節點尺寸和視頻長度調整:

調整 width 和 height 的尺寸,默認為 640, 我們設置了較小的尺寸你可以按需進行修改:

調整 length, 這里為視頻總幀數,當前工作流 fps 為 16, 假設你需要生成一個 5 秒的視頻,那么你應該設置 5*16 = 80

3 附件

? ? 本節內容涉及模型網盤地址:https://pan.quark.cn/s/0062f602f8b4

? ? 模型文件已進行整理,網盤內包含工作流獲取方式,適合不方便科學上網的的小伙伴下載使用。模型文件數量較多且尺寸較大,為避免下載中斷等問題,可先轉存再下載。

??? ? ?歡迎正在學習comfyui等ai技術的伙伴V加 huaqs123 進入學習小組。在這里大家共同學習comfyui的基礎知識、最新模型與工作流、行業前沿信息等,也可以討論comfyui商業落地的思路與方向。 歡迎感興趣的小伙伴,群共享資料會分享博主自用的comfyui整合包(已安裝超全節點與必備模型)、基礎學習資料、高級工作流等資源……

? ? 致敬每一位在路上的學習者,你我共勉!Ai技術發展迅速,學習comfyUI是緊跟時代的第一步,促進商業落地并創造價值才是學習的實際目標。

?

——畫青山Ai學習專欄———————————————————————————————

零基礎學Webui:

https://blog.csdn.net/vip_zgx888/category_13020854.html

Comfyui基礎學習與實操:

https://blog.csdn.net/vip_zgx888/category_13006170.html

comfyui功能精進與探索:

https://blog.csdn.net/vip_zgx888/category_13005478.html

系列專欄持續更新中,歡迎訂閱關注,共同學習,共同進步!

--Java版)

視頻剪裁)

的防護效果確實會受到陪測設備中去耦網絡(Decoupling Network,DN)的顯著影響)