補充:梳理超參數調整流程(邏輯)

超參數調節的流程邏輯可以總結為以下幾個步驟:

1. 明確目標

確定你要優化的模型和評估指標(如準確率、F1值、AUC等)。

2. 選擇要調節的超參數

列出模型中影響較大的超參數,比如:

- 決策樹:max_depth, min_samples_split

- LightGBM:num_leaves, learning_rate, n_estimators 等

3. 確定參數搜索空間

為每個超參數設定一個合理的取值范圍(如 learning_rate 在 0.01~0.2 之間)。

4. 選擇調參方法

常見方法有:

- 網格搜索(Grid Search):遍歷所有參數組合

- 隨機搜索(Random Search):隨機采樣參數組合

- 貝葉斯優化等智能搜索方法

5. 劃分數據集

將數據分為訓練集、驗證集(或使用交叉驗證),不能用測試集調參。

6. 運行調參

在訓練集上訓練模型,在驗證集上評估每組參數的效果,記錄結果。

7. 選擇最優參數

根據驗證集上的評估指標,選出表現最好的參數組合。

8. 最終評估

用最優參數在測試集上評估模型,得到最終結果。

總結流程圖:

確定目標 → 選超參數 → 定范圍 → 選方法 → 劃分數據 → 運行調參 → 選最優 → 測試集評估

這樣可以保證模型既不過擬合,也能達到最優效果。

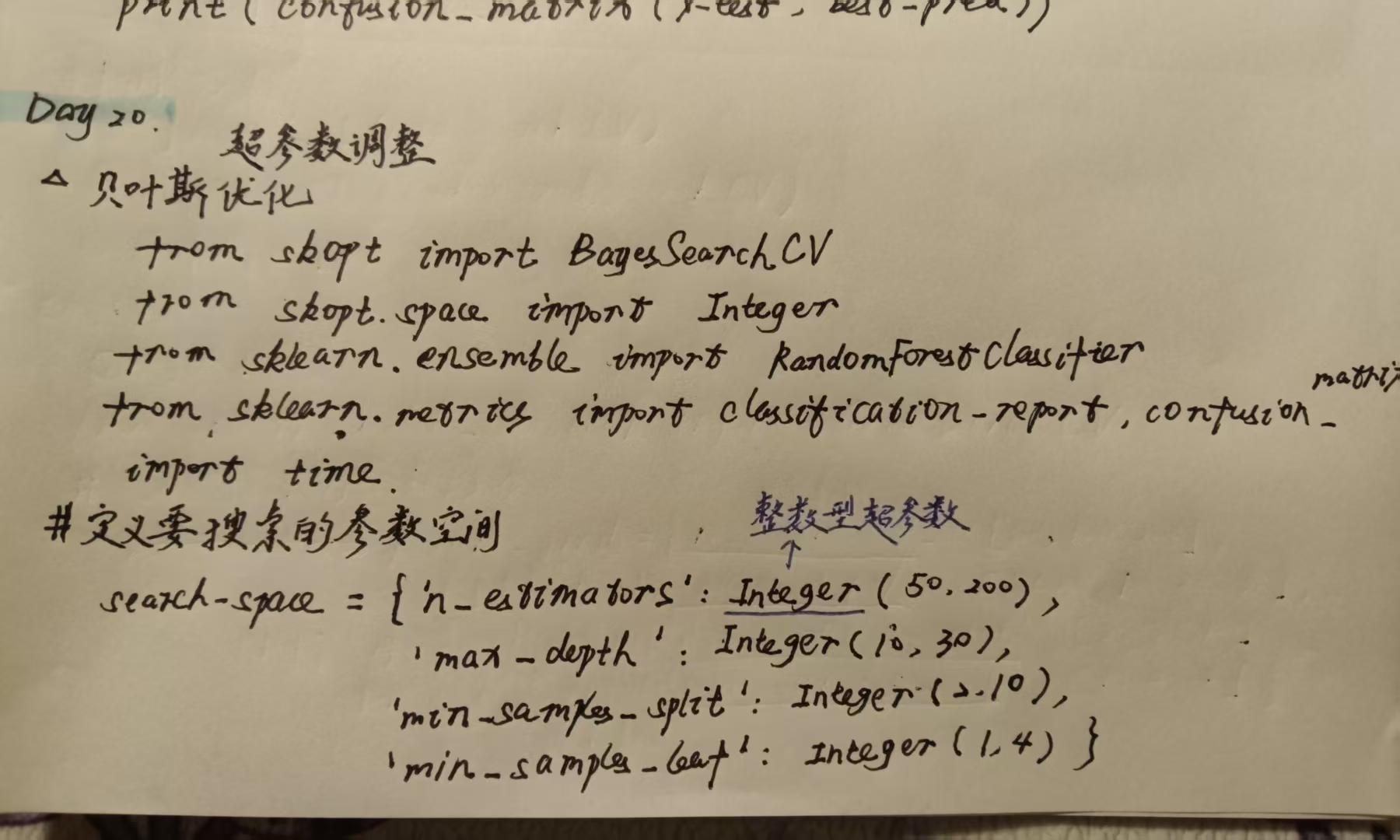

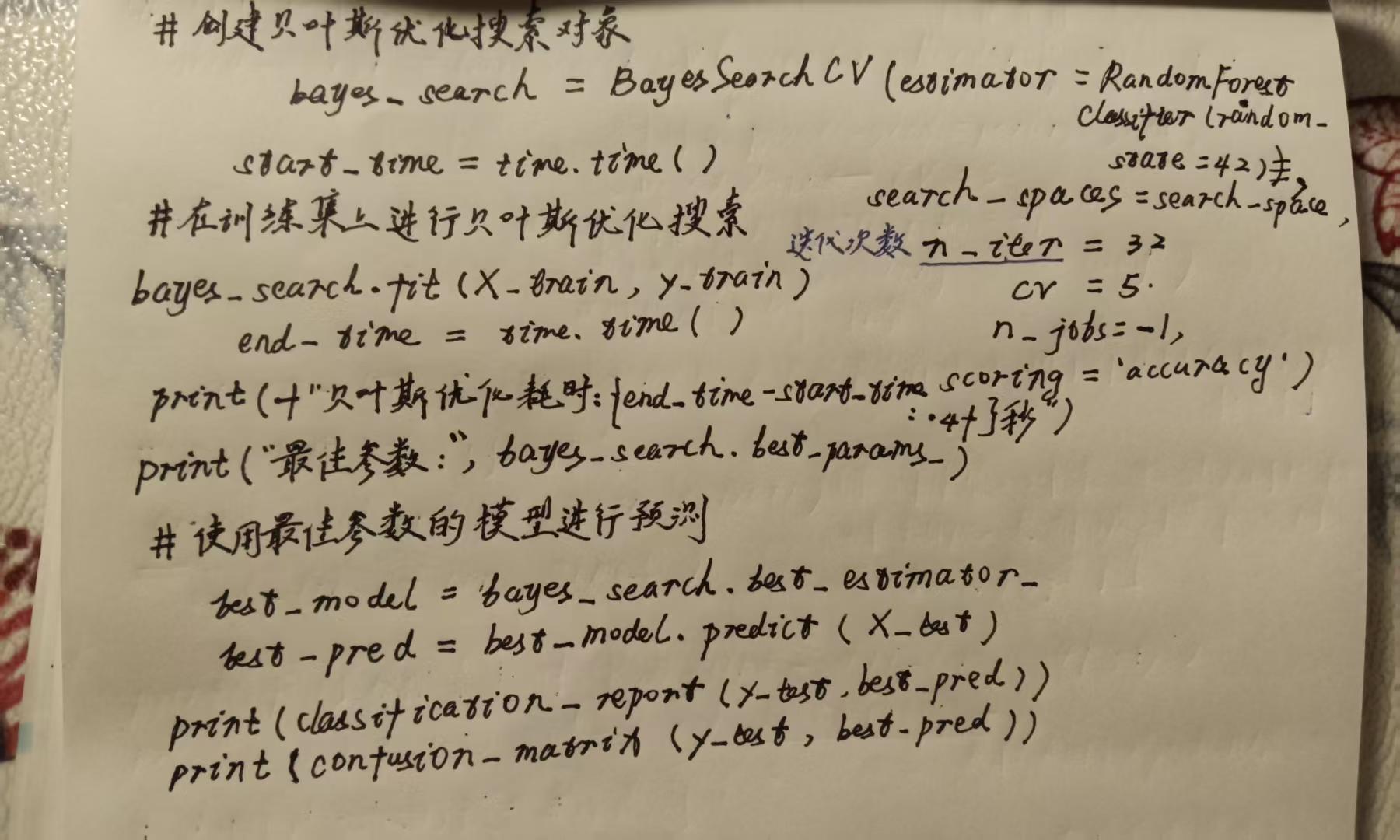

手寫筆記復習(貝葉斯優化)

今日復習到這里,明日繼續加油!!!@浙大疏錦行

)

:手搓 tk 錄制工具)

)

- Monkey指令操作手機)

稀疏自編碼器)