一、基本概念與核心作用

Canny邊緣檢測是計算機視覺中最經典的邊緣檢測算法之一,由John Canny于1986年提出。其核心目標是在噪聲圖像中提取精確、單像素寬、連續的邊緣,廣泛應用于:

- 目標檢測預處理(如Robomaster中燈條、裝甲板的邊緣提取)。

- 輪廓分析(輪廓檢測的前置步驟)。

- 圖像分割(通過邊緣定位目標邊界)。

- 特征提取(如邊緣方向直方圖HOG)。

與其他邊緣檢測算法的對比:

| 算法 | 優勢 | 劣勢 |

|---|---|---|

| Canny | 多階段處理(去噪+非極大抑制+雙閾值),邊緣質量高 | 計算復雜度較高 |

| Sobel | 快速,可同時計算梯度 magnitude/direction | 邊緣較粗,單閾值易漏檢/多檢 |

| Laplacian | 對孤立噪聲敏感,適合二階導數檢測 | 抗噪能力差,邊緣定位不準 |

二、算法原理與步驟解析

Canny算法包含5個關鍵步驟,每個步驟均有明確的數學邏輯和優化目標:

1. 高斯模糊去噪(噪聲抑制)

- 作用:使用高斯核卷積平滑圖像,減少噪聲對后續梯度計算的干擾。

- 數學原理:

高斯核公式:

G ( x , y , σ ) = 1 2 π σ 2 e ? x 2 + y 2 2 σ 2 G(x,y,\sigma) = \frac{1}{2\pi\sigma^2}e^{-\frac{x^2+y^2}{2\sigma^2}} G(x,y,σ)=2πσ21?e?2σ2x2+y2?

常用核大小:3x3、5x5, σ \sigma σ 通常取1~2( σ \sigma σ越大,圖像越模糊,邊緣定位精度下降)。 - 實現細節:在OpenCV中通過

cv2.GaussianBlur()完成,需在Canny前調用。

2. 梯度計算(邊緣強度與方向)

- 作用:計算圖像中每個像素的梯度幅值(Edge Strength)和梯度方向(Orientation)。

- 實現方法:

- 梯度算子:使用

Sobel算子分別計算水平( G x G_x Gx?)和垂直( G y G_y Gy?)方向的一階導數。

G x = [ ? 1 0 + 1 ? 2 0 + 2 ? 1 0 + 1 ] ? I , G y = [ ? 1 ? 2 ? 1 0 0 0 + 1 + 2 + 1 ] ? I G_x = \begin{bmatrix} -1 & 0 & +1 \\ -2 & 0 & +2 \\ -1 & 0 & +1 \end{bmatrix} * I, \quad G_y = \begin{bmatrix} -1 & -2 & -1 \\ 0 & 0 & 0 \\ +1 & +2 & +1 \end{bmatrix} * I Gx?= ??1?2?1?000?+1+2+1? ??I,Gy?= ??10+1??20+2??10+1? ??I - 梯度幅值:

M ( x , y ) = G x 2 + G y 2 ( L2范數,OpenCV中‘L2gradient=True‘時使用 ) M(x,y) = \sqrt{G_x^2 + G_y^2} \quad (\text{L2范數,OpenCV中`L2gradient=True`時使用}) M(x,y)=Gx2?+Gy2??(L2范數,OpenCV中‘L2gradient=True‘時使用)

或近似為:

M ( x , y ) = ∣ G x ∣ + ∣ G y ∣ ( L1范數,默認‘L2gradient=False‘ ) M(x,y) = |G_x| + |G_y| \quad (\text{L1范數,默認`L2gradient=False`}) M(x,y)=∣Gx?∣+∣Gy?∣(L1范數,默認‘L2gradient=False‘) - 梯度方向:

θ ( x , y ) = arctan ? ( G y G x ) ∈ [ ? π , π ] \theta(x,y) = \arctan\left(\frac{G_y}{G_x}\right) \in [-π, π] θ(x,y)=arctan(Gx?Gy??)∈[?π,π]

量化為4個主方向:0°(水平)、45°、90°(垂直)、135°,用于非極大值抑制。

- 梯度算子:使用

3. 非極大值抑制(NMS,邊緣細化)

- 作用:將梯度幅值圖像細化為單像素寬的邊緣,僅保留局部最大值。

- 算法流程:

- 對每個像素,沿其梯度方向的兩個相鄰像素(插值得到)進行比較。

- 若當前像素幅值小于任一相鄰像素,則抑制(置為0),否則保留。

- 關鍵點:梯度方向需映射到最近的主方向(如30°映射到0°方向,60°映射到45°方向),以確定比較的相鄰像素。

4. 滯后閾值處理(雙閾值篩選邊緣)

- 作用:通過高低雙閾值(

threshold1和threshold2)區分強邊緣、弱邊緣、非邊緣,解決單閾值易漏檢或多檢的問題。 - 規則:

- 強邊緣( M > threshold2 M > \text{threshold2} M>threshold2):直接保留,必為邊緣。

- 弱邊緣( threshold1 < M < threshold2 \text{threshold1} < M < \text{threshold2} threshold1<M<threshold2):若與強邊緣連通則保留,否則抑制。

- 非邊緣( M < threshold1 M < \text{threshold1} M<threshold1):直接抑制。

- 閾值比例:通常取

threshold2:threshold1 = 2:1或3:1(如threshold1=50,threshold2=100)。

5. 邊緣連接(基于8鄰域的連通性分析)

- 作用:將弱邊緣中與強邊緣相連的部分連接成完整邊緣,斷開孤立的弱邊緣。

- 實現:通過廣度優先搜索(BFS)或深度優先搜索(DFS)遍歷弱邊緣像素,判斷是否與強邊緣連通。

三、OpenCV函數cv2.Canny詳解

1. 函數原型(Python)

edges = cv2.Canny(image, threshold1, threshold2, apertureSize=3, L2gradient=False)

- 參數說明:

image:必須為單通道灰度圖(輸入前需用cv2.cvtColor()轉灰度)。threshold1:低閾值,弱邊緣的下限。threshold2:高閾值,強邊緣的下限。apertureSize:Sobel算子核大小,取值3/5/7(需為奇數,默認3)。L2gradient:是否使用L2范數計算梯度(默認False,使用L1范數)。

- 返回值:單通道二進制圖像,邊緣像素為255,非邊緣為0。

2. 關鍵參數調優技巧

| 參數 | 作用與影響 | 推薦取值(Robomaster場景) |

|---|---|---|

threshold1 | 過低會保留過多噪聲,過高會漏檢弱邊緣 | 20~100(視圖像對比度調整) |

threshold2 | 決定強邊緣的起點,需大于threshold1 | 40~200(通常為threshold1的2-3倍) |

apertureSize | 核越大,梯度計算越平滑,但邊緣定位精度下降 | 3(平衡速度與精度) |

L2gradient | 精度更高,計算量略增,適合高精度場景(如小目標邊緣檢測) | False(默認即可) |

3. 自動閾值策略(進階用法)

- Otsu’s算法自動獲取閾值:

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY) _, thresh = cv2.threshold(gray, 0, 255, cv2.THRESH_BINARY + cv2.THRESH_OTSU) edges = cv2.Canny(gray, thresh//2, thresh) # 低閾值設為Otsu閾值的一半 - 自適應閾值:根據局部區域調整閾值(適用于光照不均場景)。

四、代碼示例與實戰應用

1. 基礎用法(Python)

import cv2

import numpy as np# 讀取圖像并預處理

img = cv2.imread("armor_plate.jpg")

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY)

blur = cv2.GaussianBlur(gray, (5, 5), 0) # 高斯去噪# 調用Canny

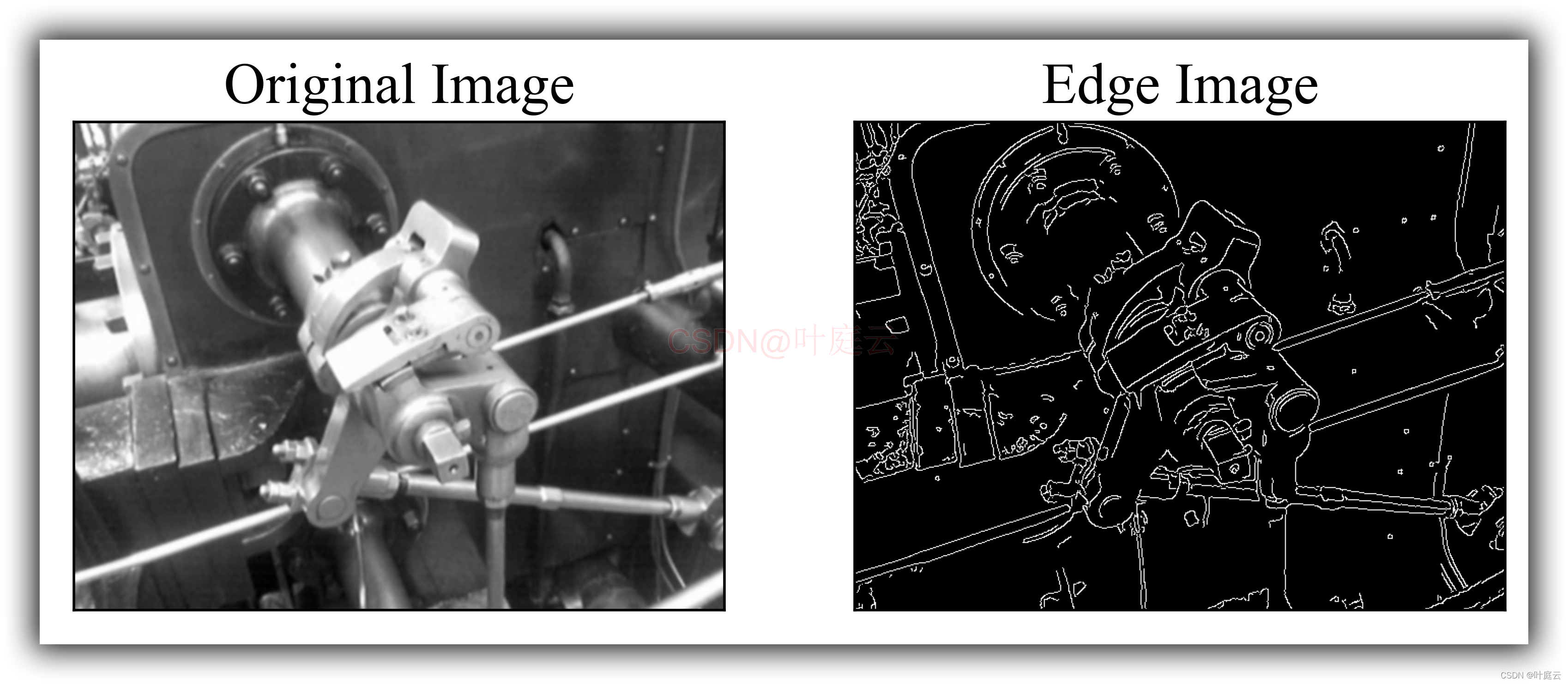

edges = cv2.Canny(blur, threshold1=50, threshold2=150, apertureSize=3)# 可視化結果

cv2.imshow("Original", img)

cv2.imshow("Canny Edges", edges)

cv2.waitKey(0)

2. Robomaster燈條檢測場景(結合輪廓提取)

# 假設輸入為ROI區域(燈條候選區域)

roi = img[100:300, 200:400]

gray_roi = cv2.cvtColor(roi, cv2.COLOR_BGR2GRAY)

# 針對性預處理:增強對比度 + 高斯模糊

clahe = cv2.createCLAHE(clipLimit=2.0, tileGridSize=(8,8))

enhanced = clahe.apply(gray_roi)

blur = cv2.GaussianBlur(enhanced, (3, 3), 0)

# 低閾值Canny檢測弱邊緣(燈條邊緣可能較暗)

edges = cv2.Canny(blur, threshold1=30, threshold2=90)

# 輪廓檢測

contours, _ = cv2.findContours(edges, cv2.RETR_EXTERNAL, cv2.CHAIN_APPROX_SIMPLE)

# 過濾小輪廓,保留燈條候選

for cnt in contours:if cv2.contourArea(cnt) > 50:x, y, w, h = cv2.boundingRect(cnt)cv2.rectangle(roi, (x, y), (x+w, y+h), (0, 255, 0), 2)

3. C++版本實現

#include <opencv2/opencv.hpp>

using namespace cv;int main() {Mat img = imread("armor_plate.jpg");Mat gray, blur, edges;cvtColor(img, gray, COLOR_BGR2GRAY);GaussianBlur(gray, blur, Size(5,5), 0); // 高斯模糊Canny(blur, edges, 50, 150, 3); // Canny邊緣檢測// 繪制邊緣Mat edge_img;cvtColor(edges, edge_img, COLOR_GRAY2BGR);imshow("Canny Edges", edge_img);waitKey(0);return 0;

}

五、注意事項與常見誤區

-

輸入圖像必須為灰度圖:

- 錯誤用法:直接對BGR圖像調用

cv2.Canny(),會返回錯誤或異常邊緣。 - 正確流程:

BGR -> 灰度轉換 -> 高斯模糊 -> Canny。

- 錯誤用法:直接對BGR圖像調用

-

高斯模糊的必要性:

- 若跳過此步驟,噪聲會導致梯度計算錯誤,產生大量虛假邊緣。

- 核大小建議:噪聲大時用

5x5,否則用3x3。

-

閾值設置的邏輯:

threshold2必須大于threshold1,否則算法失效。- 若邊緣斷裂,可降低

threshold1或增大threshold2(需成比例調整)。

-

邊緣方向與目標形態匹配:

- 檢測細長目標(如燈條)時,可通過旋轉圖像使目標方向與Sobel算子方向對齊,增強響應。

-

多尺度Canny(MS-Canny):

- 使用不同 σ \sigma σ的高斯核生成多組邊緣,合并后可提升復雜場景下的邊緣完整性。

六、數學原理深度推導(補充知識)

1. 高斯核的離散化實現

- 對于

kSize=5x5, σ = 1.5 \sigma=1.5 σ=1.5的高斯核,其離散化權重如下(總和為1):

[ 1 4 7 4 1 4 16 26 16 4 7 26 41 26 7 4 16 26 16 4 1 4 7 4 1 ] × 1 273 \begin{bmatrix} 1 & 4 & 7 & 4 & 1 \\ 4 & 16 & 26 & 16 & 4 \\ 7 & 26 & 41 & 26 & 7 \\ 4 & 16 & 26 & 16 & 4 \\ 1 & 4 & 7 & 4 & 1 \\ \end{bmatrix} \times \frac{1}{273} ?14741?41626164?72641267?41626164?14741? ?×2731?

2. 非極大值抑制的插值計算

- 當梯度方向為 θ = 30 ° \theta=30° θ=30°(靠近0°方向),需比較當前像素在0°方向的兩個相鄰像素(通過線性插值估算亞像素位置的幅值)。

3. 滯后閾值的連通性分析

- 采用8鄰域連通性(而非4鄰域),以提高邊緣連接的魯棒性,避免因小斷裂導致邊緣斷開。

七、跨語言差異(C++ vs Python)

| 特性 | C++(cv::Canny) | Python(cv2.Canny) |

|---|---|---|

| 輸入圖像類型 | cv::Mat(單通道) | numpy數組(單通道) |

| 輸出圖像類型 | cv::Mat(CV_8U) | numpy數組(uint8) |

| 參數順序 | image, edges, threshold1, threshold2, ... | image, threshold1, threshold2, ... |

| 內存管理 | 手動釋放(非必須) | 自動垃圾回收 |

八、應用場景與優化策略

| 場景 | 優化方法 |

|---|---|

| 低對比度圖像 | 先進行直方圖均衡化(cv2.equalizeHist)或CLAHE增強對比度 |

| 強噪聲圖像 | 增大高斯核大小(如7x7)或使用中值濾波(cv2.medianBlur) |

| 實時性要求高 | 降低圖像分辨率、使用apertureSize=3、關閉L2gradient |

| 多方向目標檢測 | 對圖像進行多方向旋轉,分別運行Canny,合并結果(如文本檢測中的傾斜文本) |

九、常見問題與調試技巧

-

邊緣斷斷續續:

- 原因:閾值過高或高斯模糊過度導致邊緣斷裂。

- 解決:降低

threshold1和threshold2,減少高斯核大小。

-

噪聲邊緣過多:

- 原因:閾值過低或未進行足夠去噪。

- 解決:增大高斯核大小,提高

threshold1,或使用雙邊濾波保留邊緣同時去噪。

-

關鍵邊緣未檢測到:

- 原因:目標與背景對比度低,梯度幅值不足。

- 解決:預處理增強對比度,或使用自適應閾值。

-

調試工具:

- 可視化中間結果:高斯模糊后的圖像、梯度幅值圖(

M(x,y))、非極大抑制后的圖像,定位問題階段。

# 計算梯度幅值(Python示例) sobelx = cv2.Sobel(blur, cv2.CV_64F, 1, 0, ksize=3) sobely = cv2.Sobel(blur, cv2.CV_64F, 0, 1, ksize=3) mag, ang = cv2.cartToPolar(sobelx, sobely, angleInDegrees=True) - 可視化中間結果:高斯模糊后的圖像、梯度幅值圖(

十、總結與擴展

Canny算法的優勢:通過多階段處理平衡了邊緣檢測的完整性、精確性、抗噪性,是工業級視覺系統的首選方案。

局限性:參數需手動調整,對復雜場景(如多尺度目標、極端光照)適應性不足,可結合深度學習邊緣檢測算法(如Holistically-Nested Edge Detection)進一步提升性能。

在Robomaster比賽中,合理運用Canny邊緣檢測可顯著提升目標檢測的魯棒性,尤其是在光照變化劇烈的賽場上,通過預處理(如自適應直方圖均衡化)與參數調優,可有效提取燈條、裝甲板等關鍵目標的邊緣,為后續輪廓擬合、旋轉矩形檢測奠定基礎。

)

Java/python/JavaScript/C/C++/GO最佳實現)

)