? ? ?看到這篇文章的人,想必對野生鋼鐵俠-稚暉君,都有所了解。作為華為的天才少年,獲得了很多的榮譽,作為B站有名的鴿王,在沉浮一段時間后終于要帶著新的東西和大家見面了。動態-嗶哩嗶哩 https://b23.tv/Jv7tIjg

https://b23.tv/Jv7tIjg

? ? ? 眾所周知,稚暉君從華為離職后曾透漏出自己的方向依舊是AI+控制相關的方向,機器人正是符合他的興趣點,從海報可以看出,其主要方向是人形機器人,紅色的心則顯露出其“不簡單”。最早在上半年4月份左右,從稚暉發布的狀態可以看到,雙輪與雙足切換結構超越了很多人的思考,其“哪吒”除了有炫酷的外觀,巧妙地設計之外,AR等技術也有蘊含其中。

? ? ? ?

? ? ? ?想必對于明天發布會,鴿王會給大家帶來一些令人稍微驚艷一些的內容。近一段機器人可謂是占據了熱搜的前沿,眾所周知機器人已經逐步在我們日常中顯現出重要的作用,從工廠機械化的流水線生產,到家庭中的智能助手,機器人已經成為我們生活中不可或缺的一部分。從事相關行業的人,這一段時間都看到了雷老板公司團隊研發的CyberDog第二代。

? ? ? ?其全身搭載多個攝像頭和傳感器,采用多個處理器分別進行AI計算、運動控制以及語音交互處理。

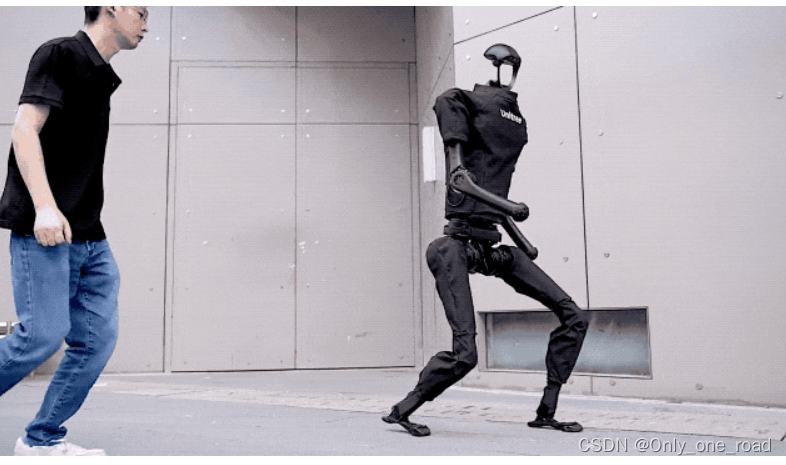

? ? ? 緊跟其后,宇樹發布通用人形機器人H1,剛滿半歲,身高1米8,體重47公斤。其單腿自由度為5,包括3個髖關節,1個膝關節和1個踝關節。

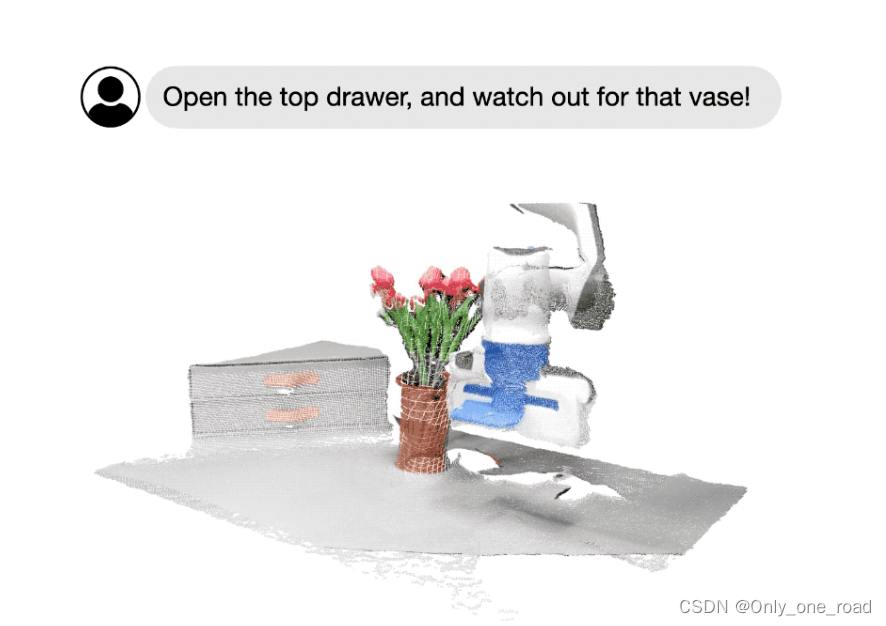

? ? ? ?隨著大模型的涌現,語言模型的的理解能力有了巨大的提升,隨之機器人的理解執行能力也在不斷提升。國外的李飛飛團隊將大模型與機器人結合,展示了隊具身智能最新成果。機器人可以理解用戶的指令并做出相應的動作,如:

打開上面的抽屜,小心花瓶!

? ? ? ?大語言模型+視覺語言模型就能從3D空間中分析出目標和需要繞過的障礙,幫助機器人做行動規劃。整個系統命名為VoxPoser,首先是給定環境信息和用戶指令,其次接著,大模型根據這些內容生成代碼,并與VLM(視覺語言模型)進行交互,指導系統生成相應的操作指示地圖。

? ? ? ?此外,馬薩諸塞大學阿默斯特分校和MIT-IBM Watson AI Lab的淦創團隊提出在大模型加持下,智能體不光能聽懂人話,還學會相互合作或與人合作。

? ? ? 該研究中的LLM智能體包含了觀察、信念、交流、推理和規劃五個模塊,可謂是將langchain與LLM進行了整合。

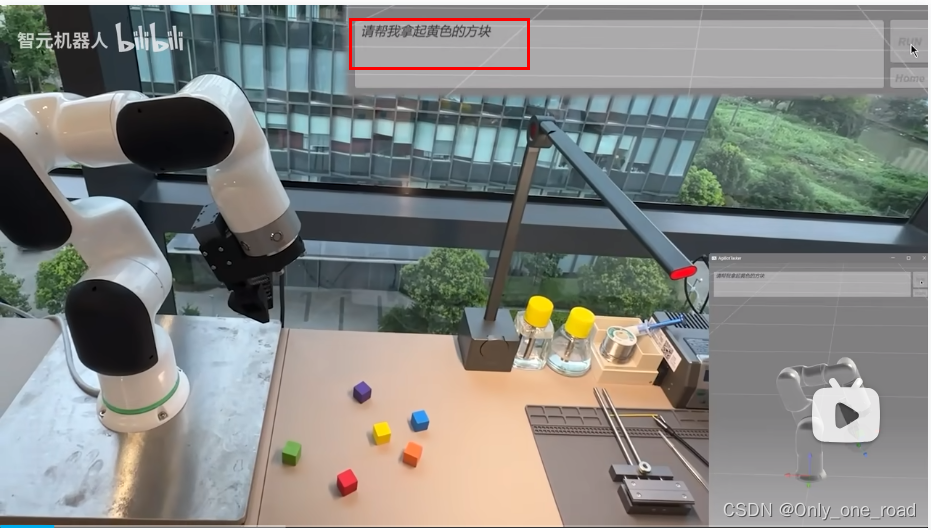

? ? ? 緊隨國外的研究熱點,國內也有較多的一些成果,并且有不錯的效果,如清華的Toolllm,西北工業大學的四軸、機器狗、機械臂的任務編排,鋼鐵俠稚暉君也有一些動作

? ? ? 可以看到機器人能夠理解意圖并做出相應的動作,復雜任務的堆疊都可以實現。主要的核心點事基于大語言模型的機器人行為自動編排和任務執行。

? ? ?大模型在機器人領域能夠達到什么樣的效果,我們拭目以待,同時期待“遠征”的首現。

? ? ?立于皓月之邊,不弱星光之勢,傍于巨人身側,不頹好勝之心。

Reference:

1.https://voxposer.github.io/voxposer.pdf

2.Building Cooperative Embodied Agents Modularly with Large Language Models

)

_nmap使用及案例)

|ChatGLM2-6B基于UCloud UK8S的創新應用)

![034_小馳私房菜_[問題復盤] Qcom平臺,某些三方相機拍照旋轉90度](http://pic.xiahunao.cn/034_小馳私房菜_[問題復盤] Qcom平臺,某些三方相機拍照旋轉90度)

)

)