聚類

聚類屬于非監督式學習(無監督學習),往往不知道因變量。

通過觀察學習,將數據分割成多個簇。

回歸

回歸屬于監督式學習(有監督學習),知道因變量。

通過有標簽樣本的學習分類器

聚類和回歸的區別

在數據分類過程中,我們可以直接知道回歸對應的具體類別名,但是在聚類過程中,我們只能知道聚類對應的類別與xxx是同一種類別。

比如:我們在使用分類處理一些水果時,我們可以知道某一個水果具體是什么水果,但是聚類我們只能知道這個水果和其他的某些水果是同一種水果,但是我們卻不能知道具體的水果類型名是什么。

聚類的基本方法有三大類:

劃分方法(K均值、K-Means)

通過反復迭代,先隨機分配均值點,?根據均值點形成聚簇,形成聚簇之后,再調整均值點。調整均值點后,再進一步反復進行迭代,最后找到我們相應的聚簇。

層次方法(層次聚類法)

凝聚的(agglomeration)和分裂的(divisive)層次聚類圖示

層次聚類有兩種方法,一種是自底向上的方法,這種方法稱為凝聚法。另一種方法是自下而上的方法,該方法又稱為劃分的方法。

?凝聚法的過程:我們通過水來凝結成冰。首先根據數據進行相似性計算,把相似的數據形成一個簇,形成了各種小簇,進一步計算簇和簇之間的相似性,如果簇和簇之間的相似性更高,將他們合并形成更大的簇。從?向上凝聚,形成我們想要的一個聚簇的一個結束條件時,得到我們想要的一個聚簇(層次聚類的結束條件有很多方法,比如從?向上進行聚類時,當聚到第k個聚簇的時候,我們就停止迭代;另外一種,我們當進行迭代時,我們數據的相似性足夠高,越往上走,聚簇和聚簇的相似性就會越來越低,當相似性的閾值低到一定程度時,就可以認為我的一個層次聚類停止,如此一來就得到了相應的聚簇,即為我們的層次聚類)

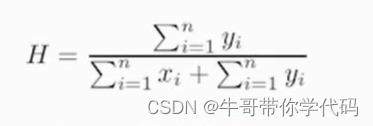

霍普金斯統計量

假如求出來的霍普金斯統計量數據接近1,這說明比較符合聚類的要求;若霍普金斯統計量接近0.5,則說明數據接近于均勻分布,不適合對其進行?均勻分布。

聚類的大致流程:

1、通過計算霍普金斯統計量判斷數據質量,判斷當前數據是否需要聚類

2、通過使用一些方法,如:肘方法。來計算我們需要聚簇的k的數量。

3、在了解了k的數量以后,使用相應的k均值,或者是層次聚類法進行聚類

4、聚類結束后,對聚類的結果進行評估,對于聚類的評估方法通常有兩種方法,一種是外在方法,類似于分類,需要有一個基準,用來評價聚類結果的準確率;一種是內在方法,通過我們的輪廓系數,來評價聚類質量的好壞。輪廓系數越接近1,聚類的效果就越好;第三種,聚類中常見的四種特征。

)

)