- 作者:Ferran Gebelli 1 ^{1} 1, Lavinia Hriscu 2 ^{2} 2, Raquel Ros 1 ^{1} 1, Séverin Lemaignan 1 ^{1} 1, Alberto Sanfeliu 2 ^{2} 2, Anais Garrell 2 ^{2} 2

- 單位: 1 ^{1} 1PAL Robotics, 2 ^{2} 2IRI (UPC-CSIC)

- 論文標題:Personalised Explainable Robots Using LLMs

- 論文鏈接:https://ieeexplore.ieee.org/abstract/document/10974125

主要貢獻

- 提出了一種基于大語言模型(LLMs)的架構,用于在人機交互(HRI)中提供個性化的可解釋性,填補了當前XHRI研究中個性化解釋的空白。

- 通過在老年醫院巡邏機器人的用例中進行模擬,展示了該架構在實際場景中的可行性,能夠根據不同用戶類型和交互歷史生成針對性的解釋。

- 提供了未來研究方向,包括強化學習、不確定性感知以及向異構和變化群體提供解釋等,為后續研究提供了思路和方向。

研究背景

- 在人機交互(HRI)領域,解釋性被認為是增強人類對機器人行為和決策過程理解的關鍵機制。然而,目前大多數研究集中在如何使機器人行為可解釋,而較少關注個性化解釋。

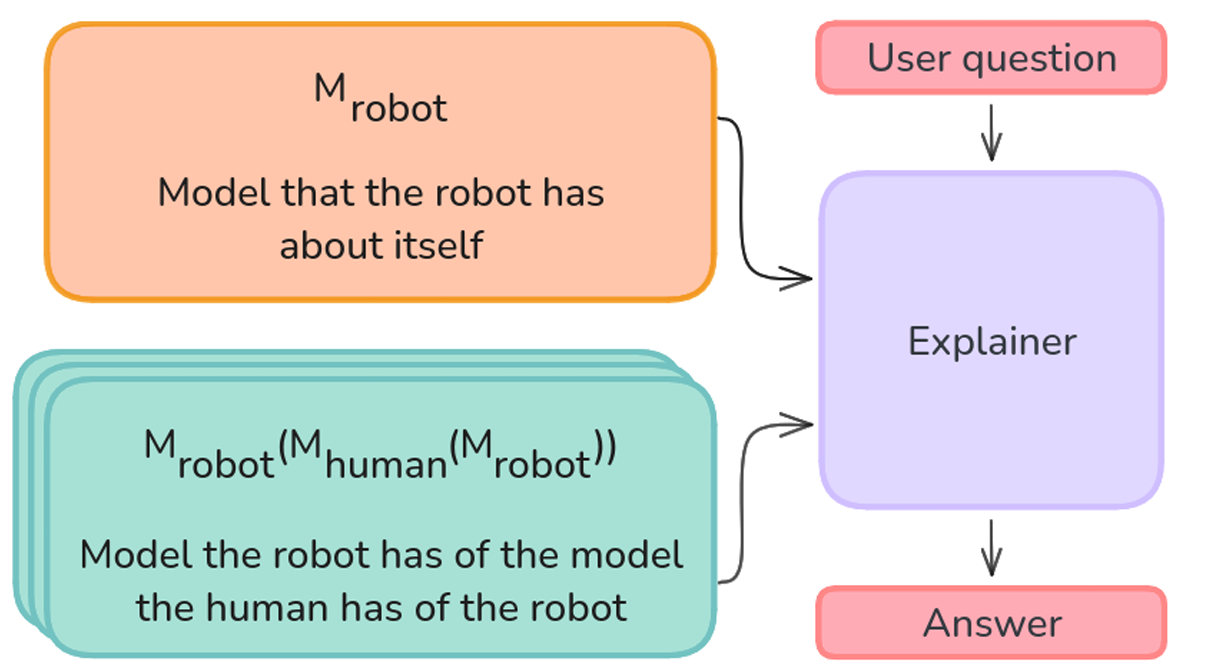

- 從心理理論(ToM)的角度來看,可解釋的HRI(XHRI)被概念化為一個模型協調問題,即機器人需要估計用戶對機器人的心理模型,并與自身的內部心理模型進行比較,以識別潛在的不匹配并生成溝通行為來彌合差距。

- 由于機器人需要為每個用戶估計不同的心理模型,因此個性化至關重要。然而,現有研究中很少有針對XHRI中的個性化問題進行探討。

研究方法

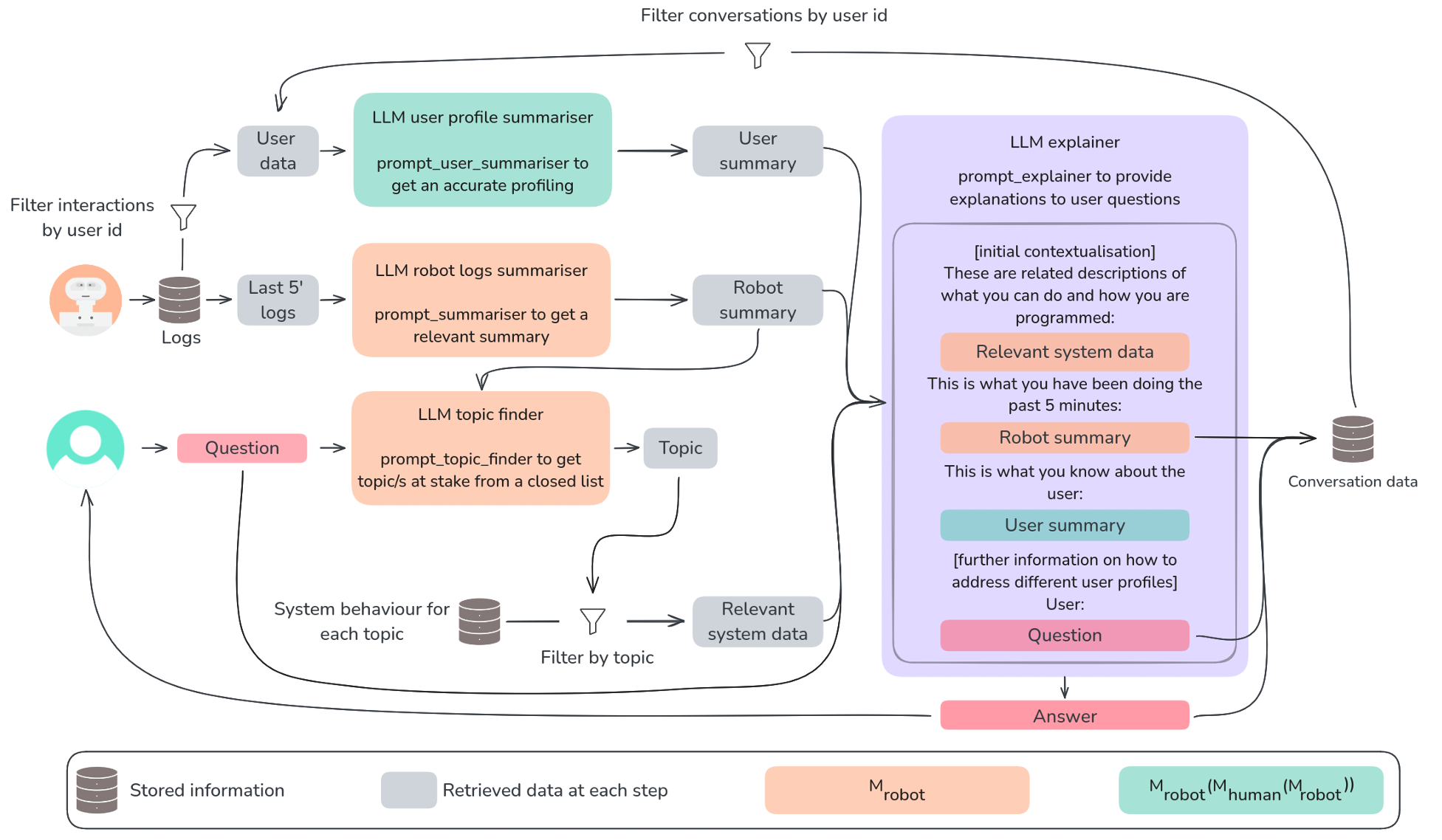

- 架構設計:提出了一種基于LLMs的架構,通過整合結構化知識來解釋決策和行為。該架構包括以下幾個關鍵部分:

- Mrobot表示:結合了機器人過去行為的總結和針對不同主題或情境的預定義行為規則。其中,過去行為的總結通過LLM從最近5分鐘的活動日志中提取相關信息生成;主題查找器通過LLM識別用戶問題所涉及的主題;并根據主題從數據庫中檢索相應的預定義行為規則。

- M r o b o t ( M h u m a n ( M r o b o t ) M_{robot}(M_{human}(M_{robot}) Mrobot?(Mhuman?(Mrobot?)表示:利用LLM對用戶進行建模,基于用戶與機器人的過往交互數據(包括對話、日志摘要以及任務相關交互)生成用戶畫像,反映用戶對機器人的知識水平和潛在的認知差距。

- LLM解釋器:結合靜態知識(行為規則)、動態知識(最近5分鐘的日志總結)以及用戶畫像來回答用戶問題,實現個性化解釋。

- 模型選擇:采用OpenAI的gpt-4o-mini模型作為基礎LLM。

實驗

- 用例設置:以在老年醫院巡邏的機器人作為實驗場景,該機器人的主要任務是監測患者房間并在檢測到潛在危險情況(如患者跌倒、患者獨自站立、門未按要求打開等)時向護理人員發出警報。實驗記錄了機器人兩個月的高級日志,包括日程變更、行為狀態轉換和警報觸發等信息,以及護理人員通過移動應用與機器人的交互記錄。

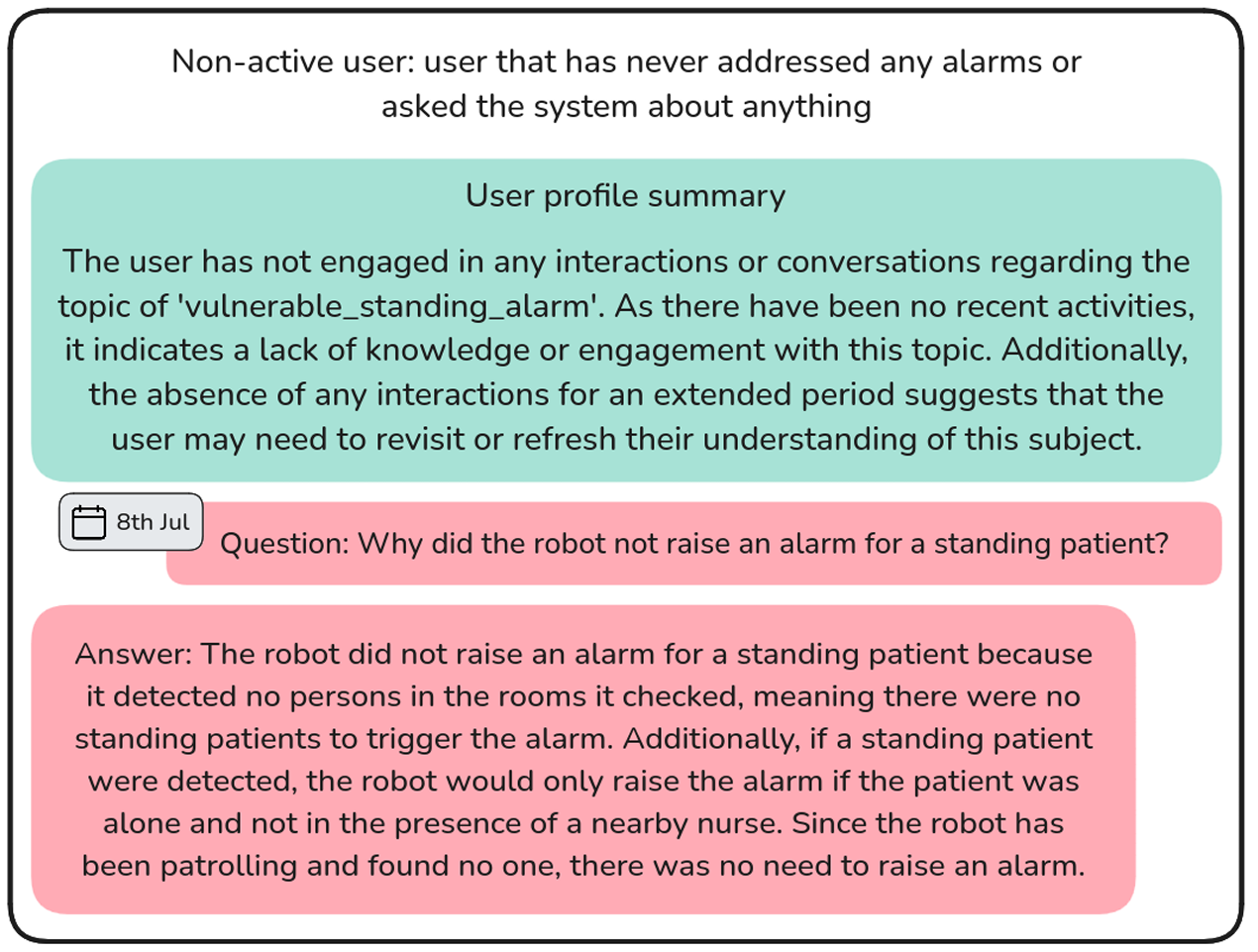

- 模擬交互:利用記錄的日志模擬不同用戶在指定時間點向機器人提出關于警報觸發或未觸發的可解釋性問題。根據用戶的交互歷史和知識水平,將用戶分為以下幾種類型:

- 非活躍用戶:未與系統進行過積極互動或對話,對于此類用戶,系統提供了詳細的解釋,以幫助其更好地理解機器人未觸發警報的原因。

- 活躍用戶:在一段時間內與機器人有過多次互動,系統能夠根據用戶的活躍度提供簡潔的回答,避免過多重復信息。

- 活躍用戶但有時間間隔:曾與機器人有過頻繁互動,但在一段時間(如一個月)內未進行任何交互。對于這種用戶,系統不僅考慮了過去的活動,還考慮了時間間隔,生成的解釋既參考了之前的討論,又提供了足夠的細節以彌補知識的可能遺忘。

結論與未來工作

- 結論:通過將用戶過去的對話總結、機器人高級日志總結以及相關系統數據相結合,該基于LLMs的架構能夠提供針對機器人決策和行為的個性化解釋。在老年醫院巡邏機器人的用例中展示了其可行性和有效性。

- 未來工作:

- 用戶研究與模型改進:進行用戶研究,比較不同表示、更新和檢索Mrobot和Mrobot(Mhuman(Mrobot)的方法,并整合多模態輸入。探索檢索增強生成(RAG)技術以優化信息檢索過程,減少對5分鐘時間窗口的依賴。

- 實時性優化:通過并行化某些步驟和比較不同提供商的LLM模型,確保系統的實時性要求。

- 強化學習:通過從用戶反饋中進行強化學習來微調LLMs,以實現更深入的個性化解釋。

- 不確定性感知:探索在Mrobot和Mrobot(Mhuman(Mrobot)中加入模型不確定性的估計,并讓LLM根據不確定性生成相應的回答。

- 面向異構和變化群體的解釋:研究如何向不同用戶群體提供解釋,考慮群體成員的變化以及信息共享的情況。

)

)

)

練習題)