文章目錄

- 前言

- 一、人臉檢測—haar特征

- 二、人臉檢測---級聯分類器

- 1、級聯分類器

- 2、如何訓練級聯分類器

- 3、已存在的級聯分類器

- 三、代碼分析

- 1、人臉檢測的簡單使用

- 2、人臉微笑檢測

- (1) 初始化視頻源

- (2)主循環處理每一幀

- (3) 加載分類器

- (4)人臉檢測

- (5)人臉標注與微笑檢測

- (6)顯示與退出控制

- 總結

前言

在人工智能技術飛速發展的今天,計算機視覺(Computer Vision)正悄然改變我們的生活。從手機解鎖到安防監控,從虛擬美顏到人機交互,人臉檢測(Face Detection)作為這一領域的核心技術,始終扮演著“第一雙眼睛”的角色。它不僅是理解人類身份、表情與行為的關鍵入口,更是邁向更復雜視覺任務(如人臉識別、姿態分析)的基石。

要實現人臉識別首先要判斷當前圖像中是否出現了人臉,這就是人臉檢測。只有檢測到圖像中出現了人臉,才能據此判斷這個人到底是誰。

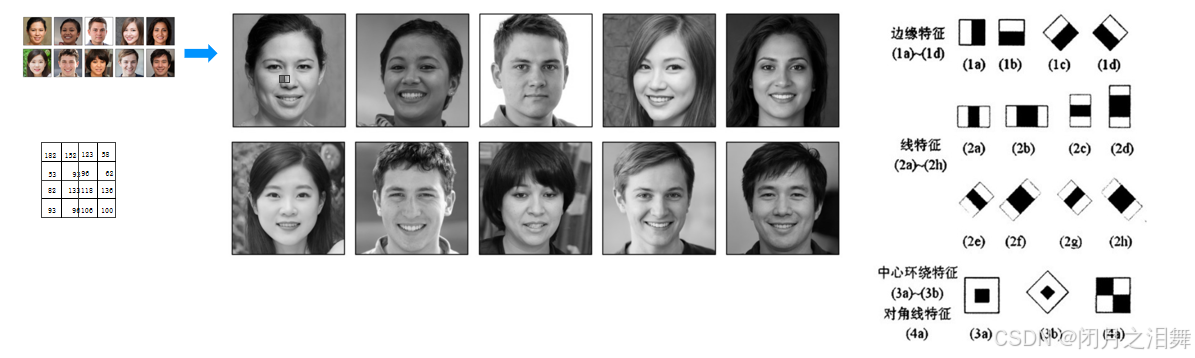

一、人臉檢測—haar特征

調用 OpenCV 中訓練好的分類器實現人臉檢測。OpenCV 提供了訓練好的haar級聯分類器,OpenCV 還提供了使用 HOG 特征(主要用于行人檢測)和 LBP 算法的級聯分類器。

特征值 = ∑特征區域中白色區域的像素值-黑色區域像素值

Haar特征反映的是圖像的灰度變化

關于 Harr 特征中的矩形框,有如下 3 個變量:

? 矩形框位置: 矩形框要逐像素點地劃過(遍歷) 整個圖像獲取每個位置的特征值。

? 矩形框大小: 矩形的大小可以根據需要進行任意調整。

? 矩形框類型: 包含垂直、水平、對角等不同類型。

二、人臉檢測—級聯分類器

1、級聯分類器

分類器需要對圖像的多個特征進行識別。例如,在識別一個動物是狗(正類)還是其他動物(負類)時,直接根據多個條件進行判斷,流程是非常煩瑣的。如果先判斷該動物有幾條腿。有四條腿的動物被判斷為可能為狗,并對此范圍內的對象繼續進行分析和判斷。沒有四條腿的動物直接被否決,即不可能是狗。只通過比較腿的數目就能排除樣本集中大量的負類(如雞、鴨、鵝等不是狗的動物的實例)。級聯分類器就是基于這種思路將多個簡單的分類器按照一定的順序級聯而成的。

2、如何訓練級聯分類器

OpenCV 提供了opencv_createsamples.exe 和opencv_traincascade.exe 文件,這兩個 exe 文件可以用來訓練級聯分類器。

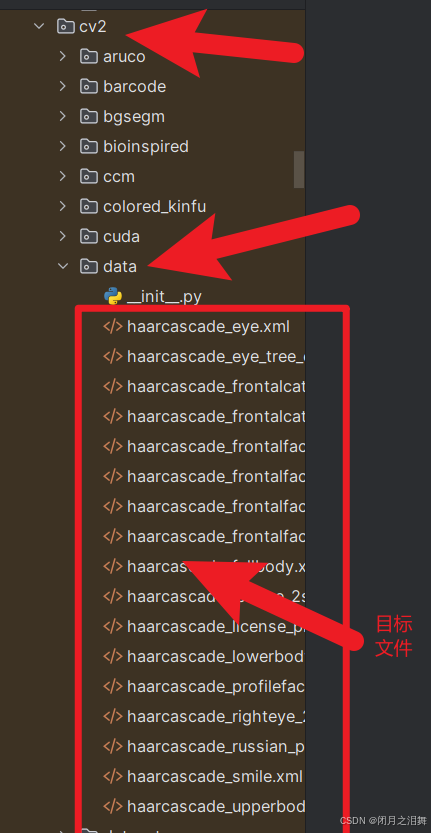

3、已存在的級聯分類器

訓練級聯分類器很耗時,如果訓練的數據量較大,可能需要幾天才能完成。OpenCV 提供了一些訓練好的級聯分類器供用戶使用。這些分類器可以用來檢測人臉、臉部特征(眼睛、鼻子)、人類和其他物體。這些級聯分類器以XML 文件的形式存放在 OpenCV 源文件的 data 目錄下,加載不同級聯分類器的 XML 文件就可以實現對不同對象的檢測。

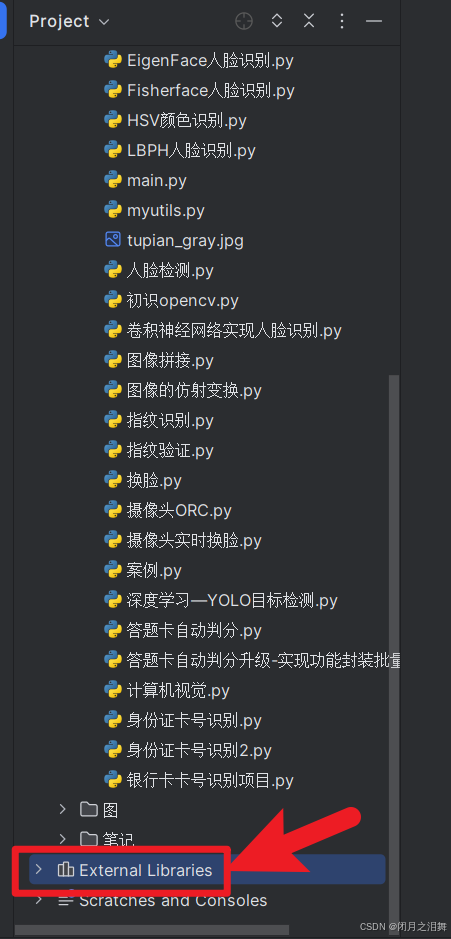

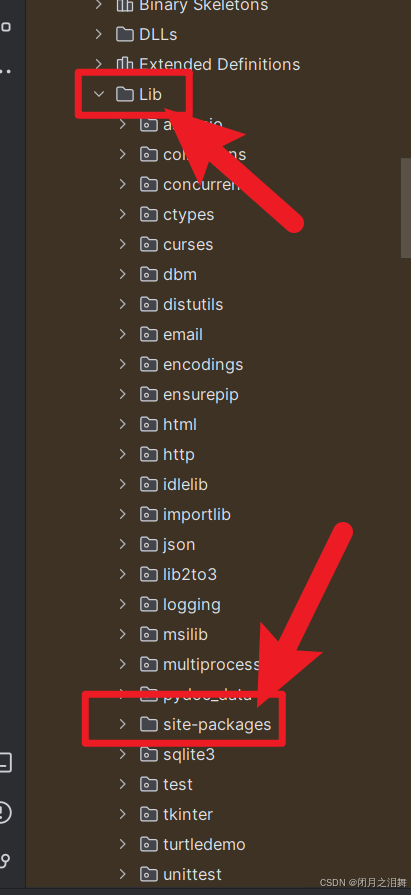

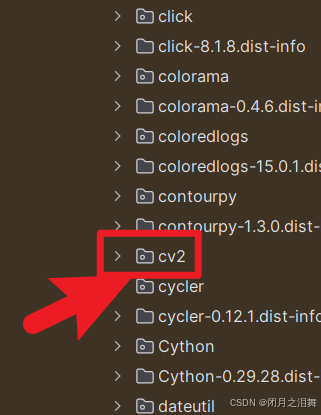

cv2庫中的人臉檢測模型

外部庫(external libraries)—>Lib->SitePackages->cv2->data

(1)

(2)

(3)

(4)可以將data中的文件復制一份到項目文件夾下

三、代碼分析

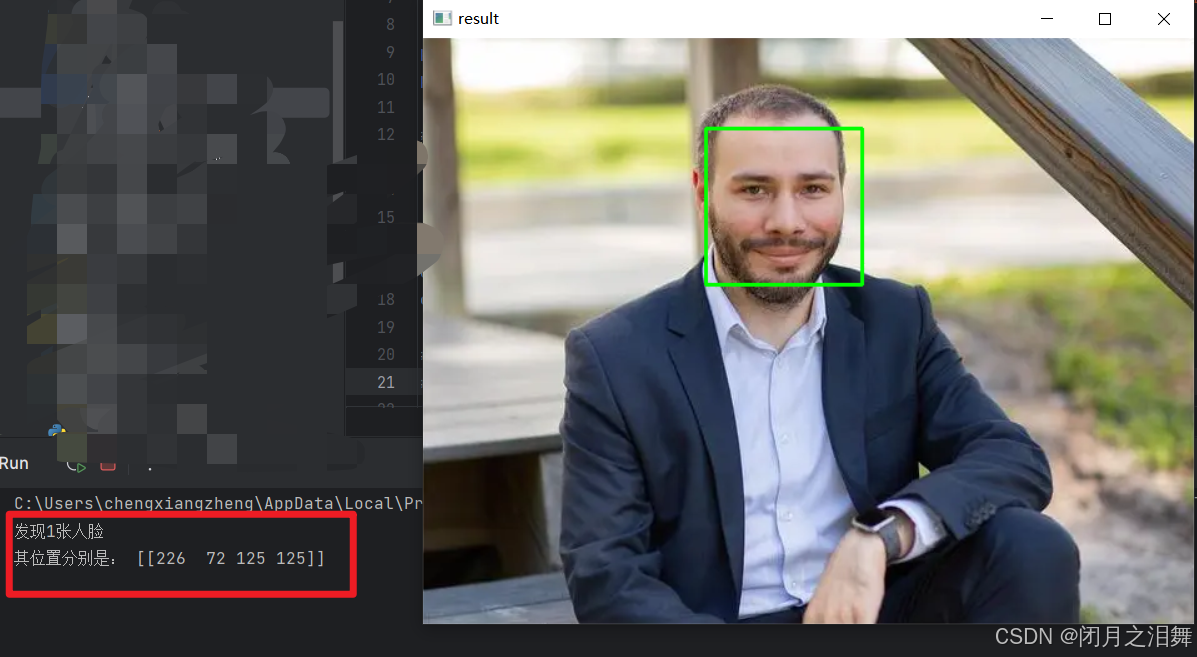

1、人臉檢測的簡單使用

import cv2 # 導入OpenCV庫# 加載預訓練Haar級聯模型

face_cascade = cv2.CascadeClassifier(cv2.data.haarcascades + 'haarcascade_frontalface_default.xml')# 讀取圖像

img = cv2.imread('test.jpg')

gray = cv2.cvtColor(img, cv2.COLOR_BGR2GRAY) # 轉換為灰度圖# 檢測人臉

faces = face_cascade.detectMultiScale(gray, scaleFactor=1.1, # 圖像縮放因子(用于多尺度檢測)minNeighbors=5 # 候選框保留閾值(值越大檢測越嚴格)

)# 繪制矩形框

for (x, y, w, h) in faces:cv2.rectangle(img, (x, y), (x+w, y+h), (255, 0, 0), 2) # 藍色邊框,線寬2像素cv2.imshow('Result', img) # 顯示結果

cv2.waitKey(0) # 等待按鍵關閉窗口

2、人臉微笑檢測

(1) 初始化視頻源

import cv2

# cap = cv2.VideoCapture(r'../data/xiao.mp4') # 從視頻文件讀取

cap = cv2.VideoCapture(0) # 從攝像頭讀取(0表示默認攝像頭)if not cap.isOpened():print("視頻打開失敗")exit()

關鍵點:

VideoCapture()支持視頻文件路徑或攝像頭ID(0通常為內置攝像頭)。

isOpened()檢查視頻源是否成功打開。

(2)主循環處理每一幀

while True:ret, frame = cap.read()frame = cv2.flip(frame, 1) # 水平翻轉(鏡像效果)gray = cv2.cvtColor(frame, cv2.COLOR_BGR2GRAY) # 轉換為灰度圖

關鍵點:

cap.read()返回ret(讀取是否成功)和frame(當前幀圖像)。

flip(1)實現水平鏡像,適合自拍場景。

灰度轉換減少計算量(Haar檢測需要灰度輸入)。

(3) 加載分類器

faceCascade = cv2.CascadeClassifier(r'./myface-detect/haarcascade_frontalface_alt.xml')smiles = cv2.CascadeClassifier(r'./myface-detect/haarcascade_smile.xml')

重復加載分類器:每次循環都重新加載XML文件,浪費資源(應移出循環外)。

(4)人臉檢測

faces = faceCascade.detectMultiScale(gray, scaleFactor=1.05, minNeighbors=14, minSize=(8,8))

參數分析:

scaleFactor=1.05:縮小比例較小(檢測更細致但速度更慢)。

minNeighbors=14:較高的合并閾值(減少誤檢,但可能漏檢密集人臉)。

minSize=(8,8):允許檢測極小的人臉(可能導致噪聲誤檢)。

(5)人臉標注與微笑檢測

for (x, y, w, h) in faces:cv2.rectangle(frame, (x, y), (x + w, y + h), (0, 255, 2), 2) # 綠色框標記人臉roi_face = frame[y:y+h, x:x+w] # 提取人臉區域(ROI)cv2.imshow('roi_face', roi_face) # 單獨顯示人臉區域# 在ROI區域內檢測微笑smile = smiles.detectMultiScale(roi_face, scaleFactor=1.5, minNeighbors=2, minSize=(50,50))for (sx, sy, sw, sh) in smile:a, b = x + sx, y + sy # 轉換坐標到原始圖像cv2.rectangle(frame, (a, b), (a+sw, b+sh), (0,0,255), 2) # 紅色框標記微笑cv2.putText(frame, 'smile', (x,y), cv2.FONT_HERSHEY_SIMPLEX, 1, (0,2,155), 2)

關鍵邏輯:

先檢測人臉 → 截取ROI → 在ROI內檢測微笑 → 坐標轉換回原圖。

顯示ROI窗口:頻繁調用cv2.imshow()可能影響性能。

(6)顯示與退出控制

cv2.imshow('dect', frame)if not ret:breakif cv2.waitKey(1) == 27: # 按ESC鍵退出breakcap.release()

cv2.destroyAllWindows()

關鍵點:

waitKey(1)控制幀率(1ms延遲),按ESC鍵退出。

釋放資源(cap.release())。

效果展示:

總結

人臉檢測作為計算機視覺的“起點”,既承載著基礎研究的智慧沉淀,也驅動著現實場景的創新落地。從Haar級聯的快速響應到MTCNN的多任務協同,從OpenCV的輕量級工具到云服務的強大API,技術的迭代始終圍繞“精準”與“高效”展開。

然而,技術的進步也伴隨著新的思考:如何在提升檢測精度的同時保護用戶隱私?如何在小算力設備上實現實時檢測?這些問題將指引未來研究的方向。無論是開發者還是普通用戶,理解人臉檢測的原理與應用,都將幫助我們更好地擁抱智能時代,在技術創新與倫理責任之間找到平衡。

期待未來,隨著算法的持續優化與跨學科融合,人臉檢測將在更多領域開啟“看見”與“理解”的新可能。

)

安裝Redis7)

)

風雨波折投稿路)

激情開賽)

Java/python/JavaScript/C++/C語言/GO六種最佳實現)

| 數組(線性結構))