基于大模型多模態的人體體型評估:從“尺碼測量”到“視覺-感受”范式

摘要:傳統體型識別依賴CV骨架/關鍵點與像素量尺,容易受衣物、發型、姿態、光照影響,且“厘米級數值”與穿衣體驗、審美感受之間存在鴻溝。本文提出一種基于大模型多模態(VLM)的體型評估新范式:以前/側/后三視圖的整體線條感為主,輔以結構化提示詞與心理感受標定,輸出質化體型分類 + 簡要依據,而非具體尺寸。該模式在干擾條件下更穩健,也更貼合服裝推薦與形象管理等實際場景。

1. 背景與問題

傳統方案(骨架點+像素測量)存在共性難題:

- 遮擋與形變:長發、寬松衣物、口袋/褶皺會改變邊緣,骨架擬合產生系統性偏差。

- 視角與相機內參:微小相機高度/焦距差異導致換算誤差;多視圖配準耗時。

- “數值-體驗”落差:腰臀差10cm究竟在穿衣體驗上意味著什么?傳統算法難以表達“線條感”與“視覺重心”。

應用側真實需求:

- 服裝試穿/搭配、形象咨詢、健身與康復等,更需要視覺上是否勻稱、哪一段更突出之類的感知型判斷,而不是精確厘米數。

2. 新范式:視覺-感受驅動的多模態體型評估

核心思想:讓多模態大模型(如 VLM)直接理解“整體輪廓與線條關系”,并以自然語言規則約束其輸出一個結構化、質化結論(體型類別 + 簡短理由),避免陷入“被衣物誤導的厘米級估算”。

2.1 質化體型標簽體系

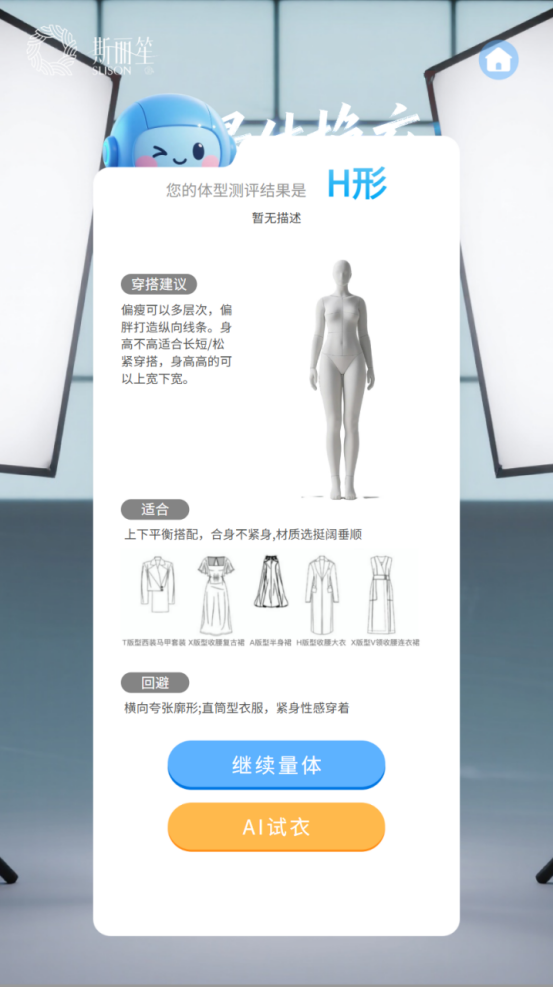

- 女性:T/A/O/X/H(基于肩-腰-臀的視覺關系與腰線收窄感)

- 男性:長條/三角/倒三角/長方/橢圓(基于上身量感、腰腹圓潤度與V形感)

- 可擴展:支持“混合型/傾向型”,承認邊界模糊性,符合人類主觀評估習慣。

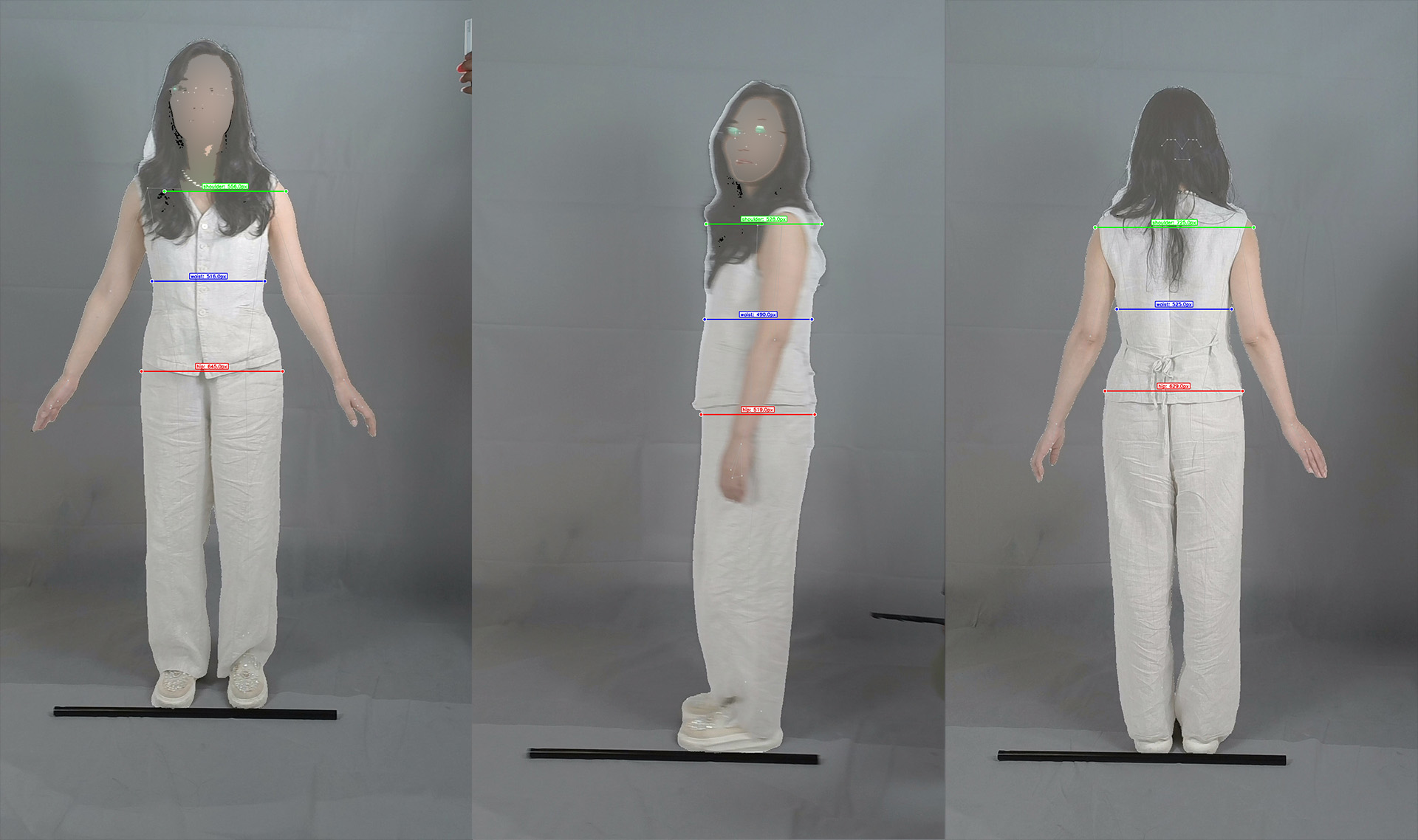

2.2 多視圖輸入

- 前、側、后三視圖同步輸入,聚焦外輪廓與線條,弱化紋理、褶皺與局部噪聲。

- 模型通過跨視角比對,形成更穩定的“形體印象”。

2.3 結構化提示詞(System Prompt)

將評估邊界、標簽定義與輸出格式寫進提示詞,讓模型“只談線條感、不報尺寸”。

示例(可直接用于系統Prompt):

你是專業的體型評估專家。請先依據照片判斷人物性別,然后按對應標準給出體型分類與簡要說明。評估只基于可見的整體輪廓與前/側/后視線條感,避免使用任何具體數值或尺寸。女性體型分類(質化描述):

T形:肩部視覺上明顯寬于臀部,上身存在感強,腰部收緊感弱或中等。

A形:臀部與大腿外側視覺上寬于肩部,下身存在感強,肩部較窄。

O形:腹部與腰側視覺上更飽滿圓潤,肩與臀看起來接近,整體中段更突出。

X形:肩與臀視覺上均衡,腰線收窄清晰,呈"沙漏"感。

H形:肩與臀視覺上均衡,腰線收窄不明顯,整體更趨直線感。男性體型分類(質化描述):

長條形:整體修長單薄,胸肩與臀部較窄,四肢細長。

三角形:肩部窄于臀部,中段與腹部更飽滿,重心偏向腰腹。

倒三角形:肩部明顯寬于臀部,向下收窄呈V形,腰部緊致。

長方形:肩、腰、臀視覺上接近,側廓直線感強,線條變化小。

橢圓形:肩與臀接近,但腰腹更圓潤飽滿,腹部前凸感明顯。輸出要求(僅輸出JSON,不要包含其他文字):

{"body_type": "體型名稱", "body_explanation": "用一兩句話說明判定依據與可見特征。可在不確定時說明傾向或混合特征。"}

要點:禁止數值、強制JSON、明確定義,可顯著降低幻覺與離散風格輸出。

{"data": {"body_type": {"body_type": "H形","description": "肩與臀視覺上均衡,但腰線收窄不明顯,整體更趨直線感。"},"gender": "female","method": "ai_body_type_assessment","processing_time": 8.723},"message": "AI體型評估成功","method": "ai_body_type_assessment","status": "success"

}

3. 系統架構設計

-

輸入管理層

- 采集協議:正面/側面/背面三視圖;自然站姿;手臂微外展;盡量露出頸肩線;背景簡潔。

- 審核與降噪:人形摳邊(可選)、亮度/對比度標準化、反光點簡單修復。

- 元數據:相機位姿可選,僅用于質控,不進入模型判斷。

-

感知理解層(VLM)

- 多圖拼接或多輪上下文:將三視圖按“正-側-背”順序輸入,并在文本中說明“只看線條感”。

- 約束式推理:用上節Prompt,必要時加入2~3條少樣本示例(few-shot)強化邊界。

-

結構化輸出層

- JSON Schema 校驗(缺字段/錯別字自動修正)。

- 不確定性標注:允許“X形傾向H形”“T/H混合”等,保留人類評估的灰度。

-

心理感受映射層(可選)

- 將質化標簽映射到穿衣建議/鏡頭建議/塑形建議等“體驗層”指標(如“上身量感強→避免厚肩墊”“下身量感強→上淺下深配色”)。

- 支持品牌/風格私有知識庫對接。

-

持續學習與標定

- 多評一致性:引入專業造型師/量體師標注。

- 用戶主觀反饋閉環:收集“是否認同評估”的二分類反饋以微調提示詞與判定閾值。

4. 與傳統CV方案的互補關系

| 維度 | 傳統骨架/量尺 | 多模態質化評估(本文) |

|---|---|---|

| 抗衣物/發型干擾 | 較弱 | 較強(關注整體線條) |

| 輸出形態 | 連續數值(cm) | 質化類別+依據 |

| 與穿衣體驗關聯 | 間接 | 直接(基于觀感) |

| 設備依賴 | 需標尺/標定更敏感 | 普通相機即可 |

| 可解釋性 | 中等(算法黑箱) | 高(文本依據) |

| 適配應用 | 尺寸下單/制版 | 穿搭建議、形象管理、健身目標 |

最佳實踐:雙軌并行。當確需厘米精度(制版/定制)時仍用量尺;當面向搭配與形象建議時用多模態質化評估,必要時兩者互證。

5. 訓練與評測方案

5.1 數據與標注

- 數據形態:多樣人群、三視圖、不同衣著/發型/場景;遵循隱私與授權合規。

- 標注策略:體型類別 + 1~2句依據;至少2名標注者;沖突樣本進入復審池。

- 難例庫:寬松衣物、強背光、發量遮擋、道具/包袋;用于魯棒性回歸測試。

5.2 評測指標

- 主要:準確率/宏平均F1、Kappa一致性。

- 人感一致性:與專業造型師的一致率;與目標受眾(消費者)的一致率。

- 穩健性:遮擋/低對比/姿態偏差下的性能下降曲線。

6. 推理與工程細節

6.1 推理約束要點

- 嚴格僅輸出JSON,避免多余敘述。

- 明確“不使用任何尺寸/數值”。

- 鼓勵“傾向/混合”表述以降低過度自信。

6.2 偽代碼(推理側)

def evaluate_body_type(front, side, back, vlm, prompt):# 1) 預處理(可選)imgs = [normalize(front), normalize(side), normalize(back)]# 2) 多圖輸入 + 結構化提示詞response = vlm.generate(images=imgs, prompt=prompt, temperature=0.2)# 3) JSON校驗與修正result = force_json(response, schema={"body_type": str, "body_explanation": str})# 4) 置信度與合規檢查result["confidence"] = estimate_confidence(result["body_explanation"])return result

6.3 不確定性與人機協作

- 若模型給出“混合/傾向”,前端可提示用戶拍一張更貼身/束發的照片再評估。

- 支持人類復核按鈕;復核樣本自動進入難例庫。

7. 采集規范(影響最大、成本最低的優化)

- 三視圖:正/側/背,鏡頭胸口略高;保持自然站姿,手臂微外展,腳跟與標尺或地線對齊。

- 服裝:輕薄、貼身、無厚肩墊;長發盡量束起,露出頸肩輪廓。

- 背景/光線:中性純色背景、柔光正面 + 微側補光,避免強背光與硬陰影。

- 質控:允許輕度后處理(對比度、去斑點),但不改變形體輪廓。

8. 隱私、偏見與合規

- 最小化數據:只存儲推理必要的三視圖與結構化結果;到期自動清除原圖(可配)。

- 可解釋:輸出“判定依據”的一句話,便于用戶理解與申訴。

- 偏見控制:數據多樣性、跨年齡與身高體重分布;定期做群體公平性審計。

- 本地化/邊緣推理(可選):在端側進行特征提取,僅上傳匿名向量或最終JSON。

9. 參考實現:API與前端

9.1 API(示意)

-

POST /v1/body-type/evaluate- 輸入:

images: [front, side, back],mode: "qualitative" - 輸出:

{"body_type": "...", "body_explanation": "...", "confidence": 0.0~1.0}

- 輸入:

9.2 前端交互

- 上傳三視圖 → 結果JSON → 顯示體型標簽與一句話依據;

- 展示穿搭建議卡片(由“心理感受映射層”生成);

- 提供“我更認同 ×× 類型”反饋按鈕以閉環學習。

10. 實戰成效與典型場景

- 線上換裝/穿搭推薦:在衣物遮擋明顯的用戶照中仍能給出穩定的“上/下身量感”判斷,讓推薦更貼近視覺體驗。

- 形象管理/短視頻拍攝:根據體型標簽給出鏡頭高度/鏡頭焦段/服裝結構線建議。

- 健身與康復:關注線條感變化(如腰線清晰度、肩臀均衡度)的質化追蹤,弱化體重/圍度帶來的心理壓力。

11. 展望

- 多模態對比學習:引入“人類主觀看法”對比損失,讓模型更貼近大眾審美與穿衣感受。

- 跨域遷移:將體型標簽遷移到3D虛擬人體/試衣中,用少量控制點驅動形體參數。

- 可控解釋:把“依據文本”結構化為“肩/腰/臀三個部位的置信度條”,實現更細顆粒的可視化。

結語

這套“大模型多模態 + 結構化提示詞 + 心理感受映射”的體型評估,把焦點從厘米轉向線條與觀感,更貼近真實穿著與鏡頭表達。它不是對傳統量尺的否定,而是面向穿搭/形象/內容創作等應用的一次范式升級。在合規與隱私保護前提下,這一模式可低成本落地,并通過用戶反饋持續進化。

)

方法)

—PyTorch使用(6)—張量拼接操作】)

-- 網絡編程及常見問題篇)

)