關注gongzhonghao【CVPR頂會精選】

在深度學習賽道里,別只盯著堆模型卷參數了。最近不少高分工作都在打“可解釋”這張牌,把原本難以理解的黑箱模型用輕量方法剖開,既能增強學術價值,還能拓展落地場景。

更妙的是,這類研究門檻其實比想象中低,往往是將經典模型或分析方法遷移到視覺新領域,再結合任務痛點提出改進,就能快速產出有影響力的成果。對想在CVPR領域突圍的同學來說,這是一個既實用又高產的方向。今天小圖給大家精選3篇CVPR有深度學習方向的論文,供大家借鑒和參考。

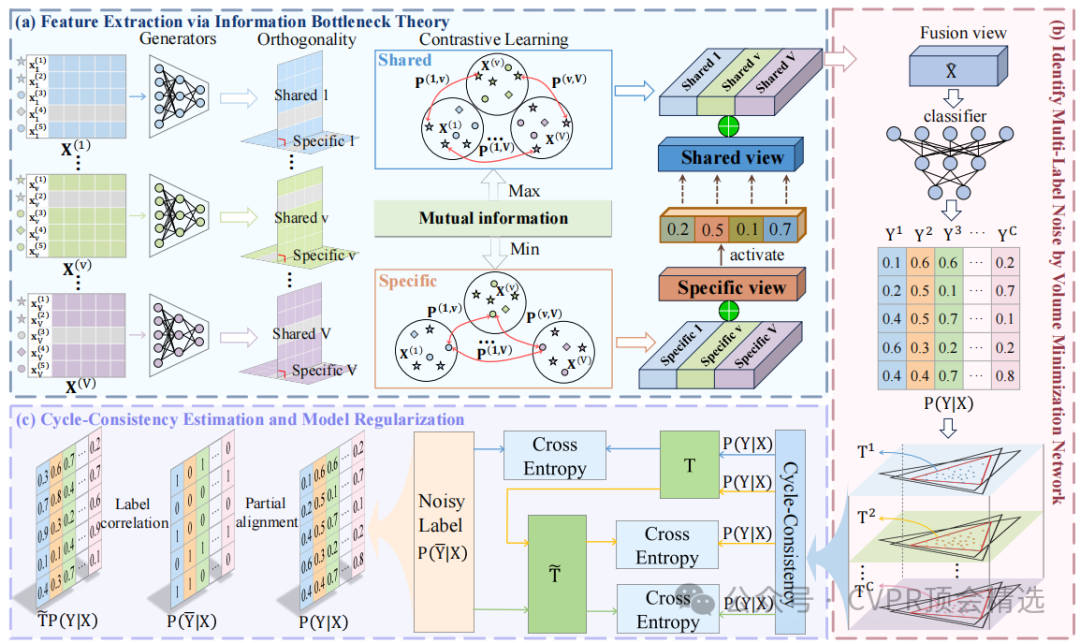

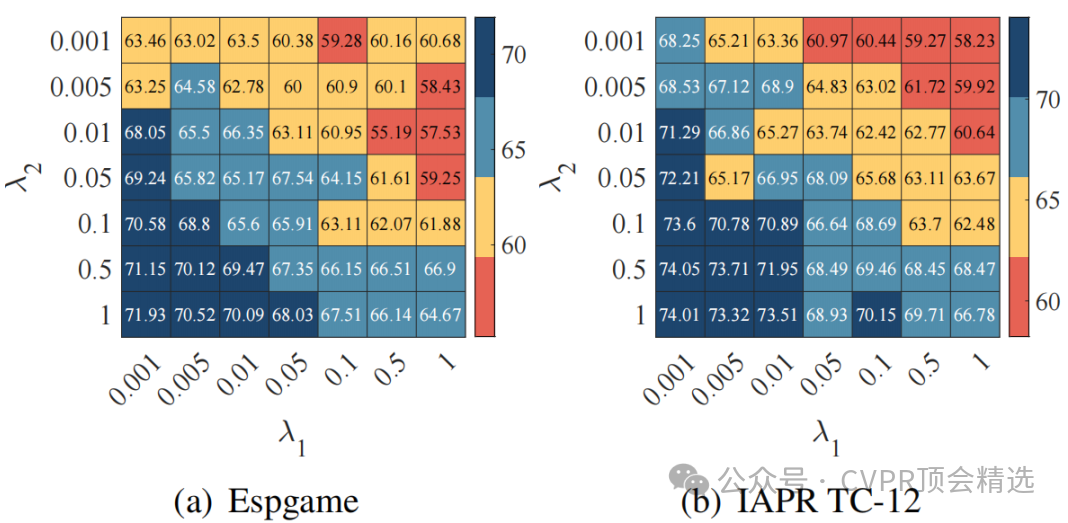

論文一:Theory-Inspired Deep Multi-View Multi-Label Learning with Incomplete Views?and Noisy Labels

方法:

文章首先利用信息瓶頸理論構建特征提取模塊,通過優化互信息模型及其理論上限,實現對共享特征和特定特征的有效提取與區分;接著在噪聲轉換矩陣體積最小化網絡中,利用幾何屬性進行噪聲識別,通過循環一致性估計框架提升估計穩定性;最后,結合噪聲數據中的真實語義信息和隱藏的標簽相關性作為模型正則化,降低過擬合風險,從而完成整個模型的訓練與優化。

創新點:

這篇文章首次提出了一個能夠同時處理視圖缺失和標簽噪聲的多視圖多標簽學習框架,填補了這一領域的研究空白。

實驗從有限視圖中提取語義上具有區分性的表示,有效促進了任務相關共享信息的合成,同時保留了各個視圖獨特特征的獨立性。

理論上證明了最小化噪聲轉換矩陣體積與分類器訓練之間的統計一致性,并設計了循環一致性估計方法來增強轉換矩陣估計,進一步提高了多標簽噪聲識別的穩定性。

論文鏈接:

https://cvpr.thecvf.com/virtual/2025/poster/34682

圖靈學術科研輔導

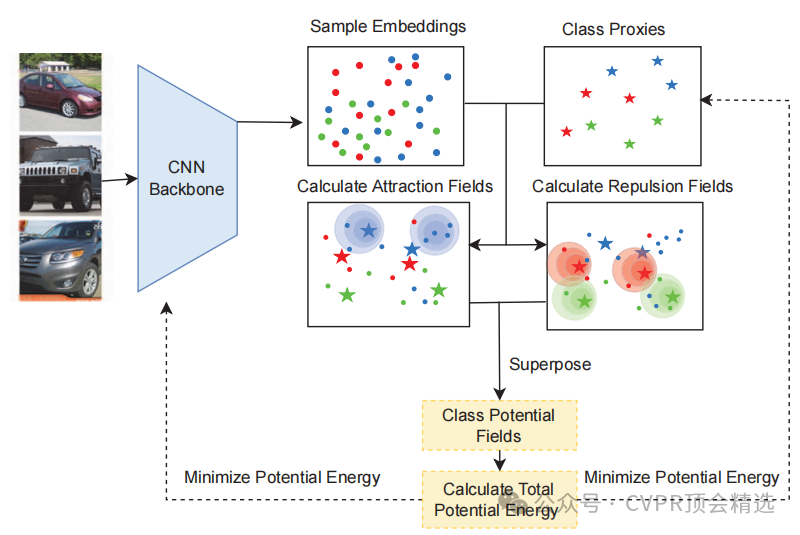

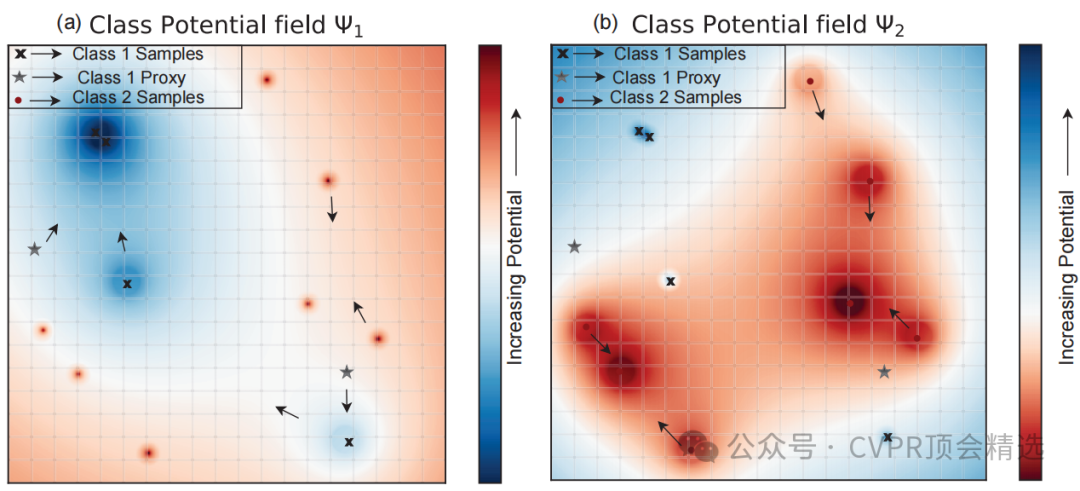

論文二:Potential Field Based Deep Metric Learning

方法:

文章首先定義了每個樣本產生的吸引場和排斥場,通過這些場的疊加形成全局勢場,以此來建模樣本間的相互作用。接著,利用梯度下降法訓練網絡,通過最小化所有樣本和代理點在全局勢場中的總勢能來優化網絡參數和代理點位置。最后,在三個標準的深度度量學習基準數據集上驗證了該方法的有效性,結果表明其在標準無噪聲場景以及更貼近現實的標簽噪聲場景下均優于現有的最先進方法。

創新點:

提出了基于勢場的深度度量學習框架,用連續勢場代替傳統的樣本間直接交互,能夠全面建模所有樣本的相互作用。

逆轉了樣本間相互作用隨距離增強的傳統模型,顯著提升了在真實世界數據集中面對標簽噪聲時的魯棒性。

在三個標準的深度度量學習基準數據集上,在無噪聲的標準場景下超越了現有最先進方法,有效提高模型7%的性能。

論文鏈接:

https://cvpr.thecvf.com/virtual/2025/poster/33305

圖靈學術科研輔導

論文三:Rashomon Sets for Prototypical-Part Networks: Editing Interpretable Models in?Real-Time

方法:

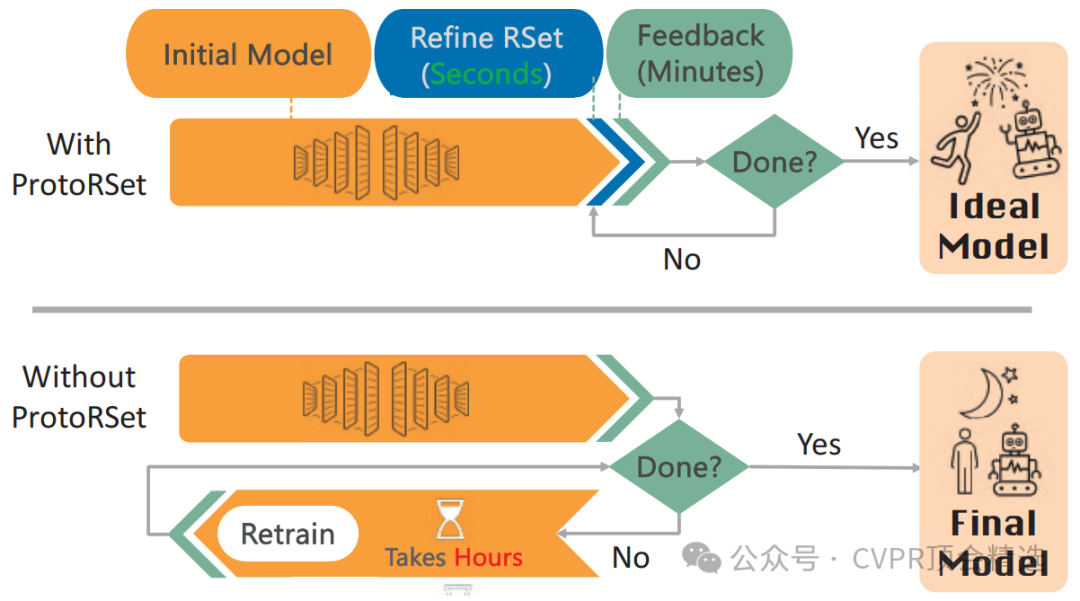

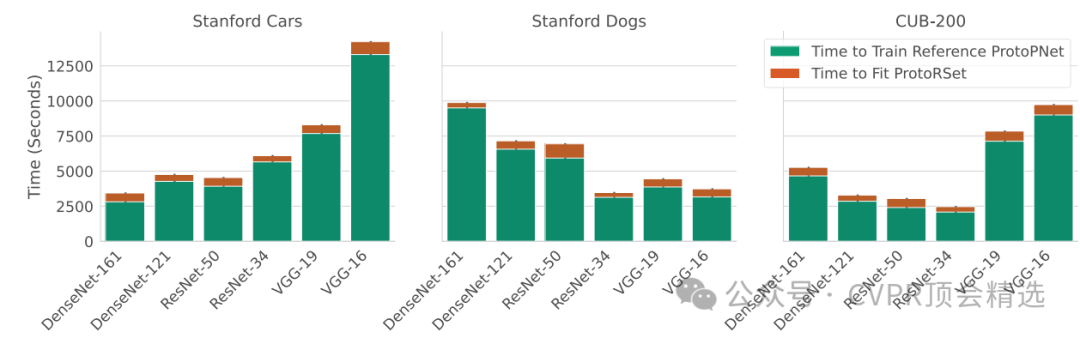

文章回顧ProtoPNets的結構與訓練,并定義其Rashomon集,提出利用二階泰勒展開近似計算的方法,將問題簡化為多類邏輯回歸的Rashomon集。隨后介紹Proto-RSet的三種交互方式:模型采樣、不使用特定原型的子集、以及使用特定原型且系數≥α的子集。實驗結果表明,該方法能在多數據集與不同CNN骨干下高效生成滿足用戶約束的準確模型。

創新點:

首次將 Rashomon 集合方法引入計算機視覺,支持在復雜視覺任務中快速探索等效優良模型。

提出 Proto-RSet,可在秒級別生成滿足用戶約束的 ProtoPNet,避免傳統耗時的重新訓練。

在真實場景中驗證方法,展示其在消除偏差與增強可靠性上的實用價值。

論文鏈接:

https://cvpr.thecvf.com/virtual/2025/poster/32669

本文選自gongzhonghao【CVPR頂會精選】

基于Nginx+PHP 驅動 Web 應用(上):配置文件與虛擬主機篇)

)

詳細講解)

AI應用--百度智能云TTS語音合成)

的三維熱傳導方程求解器MATLAB)