作者:Xiaobei Zhao, Xingqi Lyu, Xiang Li

單位:中國農業大學

論文標題:AgriVLN: Vision-and-Language Navigation for Agricultural Robots

論文鏈接:https://arxiv.org/pdf/2508.07406v1

代碼鏈接:https://github.com/AlexTraveling/AgriVLN

主要貢獻

提出了A2A基準測試,這是一個覆蓋6種常見農業場景(農場、溫室、森林、山區、花園和村莊)的視覺語言導航(VLN)基準測試,包含1560個episode,所有真實RGB視頻都是由四足機器人前端攝像頭在0.38米高度拍攝的,與實際部署條件一致。

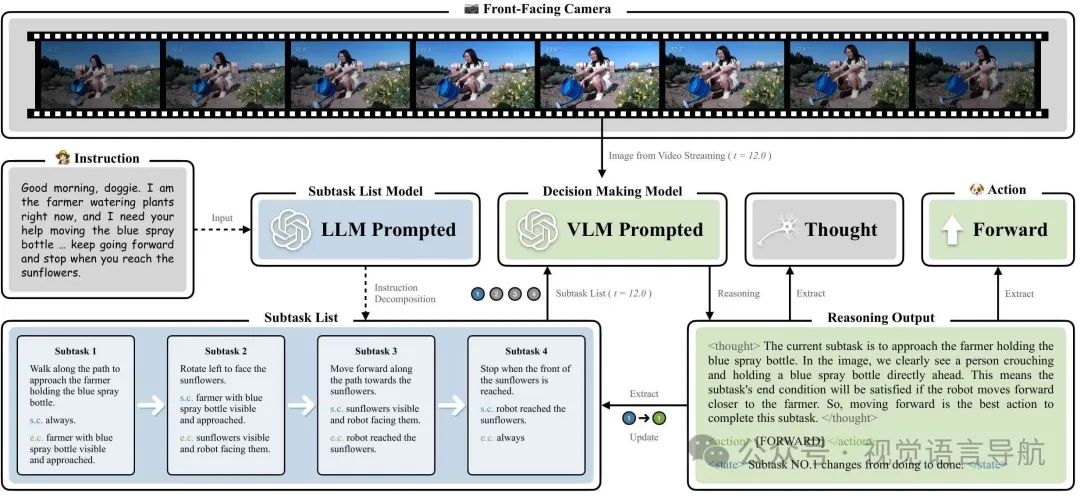

提出了視覺語言導航農業機器人(AgriVLN)基線方法,基于視覺語言模型(VLM),通過精心設計的模板提示,能夠理解給定的指令和農業環境,為機器人控制生成適當的低級動作。

提出了子任務列表(STL)指令分解模塊,并將其集成到AgriVLN中,在A2A基準測試上,與基線相比,完整模型將成功率(SR)從0.305提高到0.417,并且進一步與其他現有VLN方法進行比較,證明了其在農業領域視覺語言導航方面的最新性能。

研究背景

農業機器人在農業任務中發揮著重要作用,但目前大多數農業機器人的移動仍然依賴于人工操作或固定的軌道,這限制了它們的機動性和適應性。

視覺語言導航(VLN)能夠使機器人根據自然語言指令導航到目標位置,并且在多個領域表現出色,但現有的基準測試和方法都沒有專門針對農業場景設計。

現有的VLN基準測試主要集中在室內環境或城市街道等場景,而農業場景具有其獨特性,如不同的地形、植被分布和光照條件等,因此需要一個專門針對農業場景的VLN基準測試來評估農業機器人的導航能力。

A2A基準

任務定義

視覺語言導航(VLN)在農業機器人中的任務定義如下:在每個實驗場景(episode)中,模型被賦予一條自然語言指令?,其中??是單詞的數量。在每個時間步?,模型接收前向RGB圖像?。模型的目標是理解指令??和圖像?,從而選擇最佳的低級動作?(動作空間包括:前進、左轉、右轉、停止),引導機器人從起點導航到目標位置。

數據集收集

數據收集涵蓋了6種不同的農業場景分類:農場、溫室、森林、山脈、花園和村莊,這些場景涵蓋了所有常見的農業場景。

指令生成:在每個實驗場景中,專家重現實際的農業活動,并提取人類移動的軌跡,然后精心設計一條準確的指令來描述該軌跡。與傳統VLN基準測試中精致簡潔的指令不同,A2A中的指令更加隨意且冗長,包含許多無意義和誤導性的內容,以更真實地還原農業工人說話的語氣。

機器人控制:選擇Unitree Go2Air四足機器狗作為實驗農業機器人。在每個實驗場景中,專家手動控制機器人沿著從起點到終點的最佳路徑行走,以完成相應的指令。

視頻錄制:使用Unitree Go2Air四足機器狗內置的前向RGB攝像頭作為視頻錄制設備。在每個實驗場景中,專家手動控制攝像頭記錄整個時間線的前向視圖。每個視頻流以1280×720的分辨率、約14FPS的幀率和約1100kbps的碼率進行捕獲。

數據標注:對于每個時間步?,專家根據機器人的實際行走狀態手動標注機器人的真值動作。將相鄰相同的動作序列 ({a_{t1}, a_{t1+1}, \dots, a_{t2}}) 聚合成一個時間間隔,并以字典格式保存。每個實驗場景由多個這樣的時間間隔組成,以JSON格式存儲。

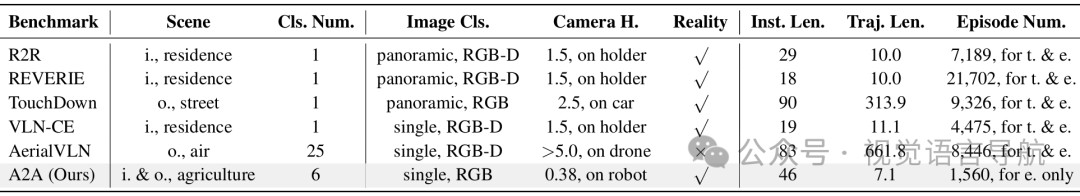

數據集評估

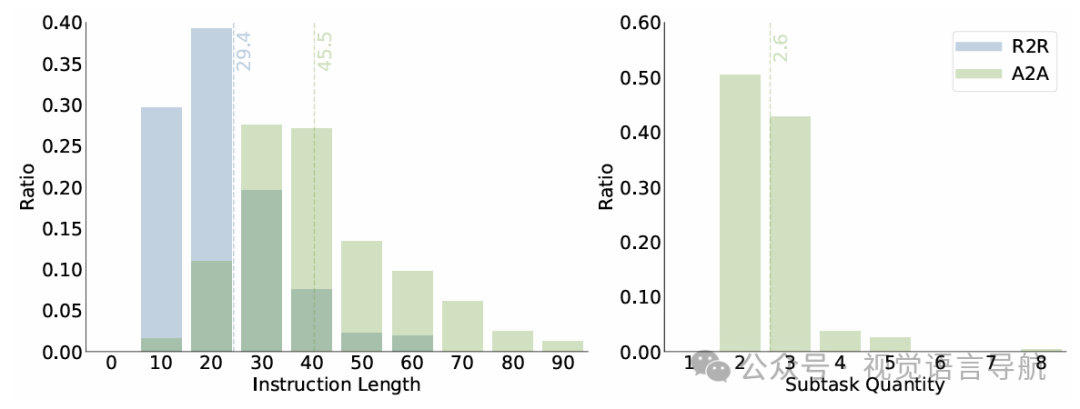

數據規模與分布:A2A基準測試共收集了1560個實驗場景,分布在6種不同的場景分類中,包括農場372個、溫室258個、森林384個、山脈198個、花園258個和村莊90個。指令長度從10到99不等,平均長度為45.5,子任務數量從2到8不等,平均為2.6。

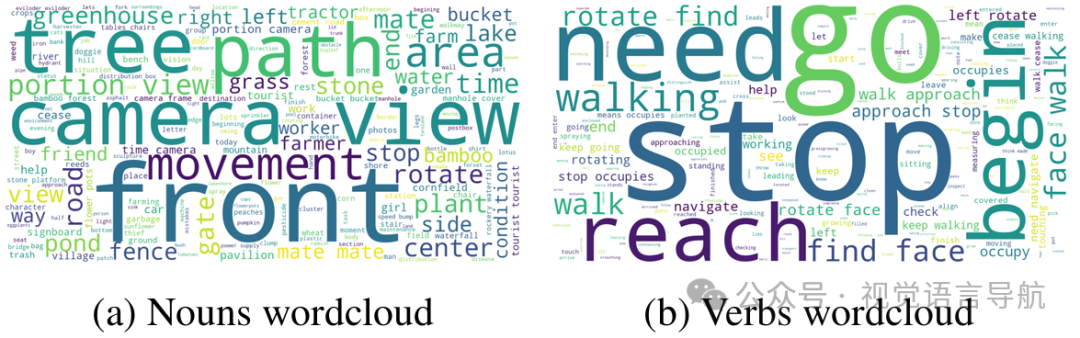

詞匯分布:A2A中的指令詞匯包含893個單詞,其中“front”、“camera”和“view”是常用的名詞,而“go”、“stop”和“need”是常用的動詞。這些詞匯都是日常生活中常見的,證明了A2A指令與農業工人對話的語氣一致性。

與其他基準測試的比較:A2A在多個方面與其他主流VLN基準測試進行了比較,包括場景多樣性、圖像質量和數據規模。A2A涵蓋了所有常見的農業場景,圖像采集條件與實際農業機器人一致,并且提供了更長的指令以更好地評估模型對長文本的理解能力。

評估指標

成功率(SR):成功完成任務的實驗場景比例。

導航誤差(NE):機器人最終位置與目標位置之間的距離。

獨立成功率(ISR):每個子任務的成功率,計算公式為:其中??和??分別是實驗場景??中成功的子任務數量和總子任務數量,?是評估實驗場景的集合。

方法

子任務列表

子任務列表模塊將指令分解為一系列子任務,使模型能夠逐步完成復雜的導航任務。具體步驟如下:

指令分解:將指令??分解為子任務列表?,每個子任務??包含四個參數:步驟順序(ID)、具體描述(D)、開始條件(SC)、結束條件(EC)和當前狀態(σ)。

大型語言模型(LLM):使用LLM??實現指令分解,公式為:其中??是LLM的提示,遵循以下三個原則:

顆粒原則:任何子任務都不能進一步分解為更細的子任務。

同義詞原則:子任務列表傳達的語義必須與原始指令等價,確保不遺漏或添加任何信息。

連接原則:下一個子任務的開始條件必須與上一個子任務的結束條件對齊。

決策制定

決策制定模塊使用視覺語言模型(VLM)??來實現,具體步驟如下:

輸入與輸出:在每個時間步?,VLM接收當前攝像頭視圖??和子任務列表?,并輸出最佳低級動作?、狀態轉換??和推理過程?:其中??是VLM的提示。

狀態轉換機制:子任務的狀態分為三種:待處理(pending)、進行中(doing)和已完成(done)。狀態轉換遵循以下原則:

待處理 → 進行中:當且僅當上一個子任務已完成,并且VLM認為當前子任務應該開始。

進行中 → 已完成:當且僅當當前子任務處于進行中狀態,并且VLM認為當前子任務已完成。

注意力聚焦:在每個時間步?,VLM只需要關注一個子任務,具體如下:

如果存在一個子任務??的狀態為進行中,則VLM關注該子任務。

如果沒有子任務的狀態為進行中,則VLM關注第一個待處理的子任務?。

實驗

實驗設置

為了確保實時處理能力,論文選擇了輕量級的?GPT-4.1mini?作為指令分解的大型語言模型(LLM)和決策模型的視覺語言模型(VLM),并通過API訪問。這種選擇是為了確保模型在實際農業機器人上的實時性和高效性。

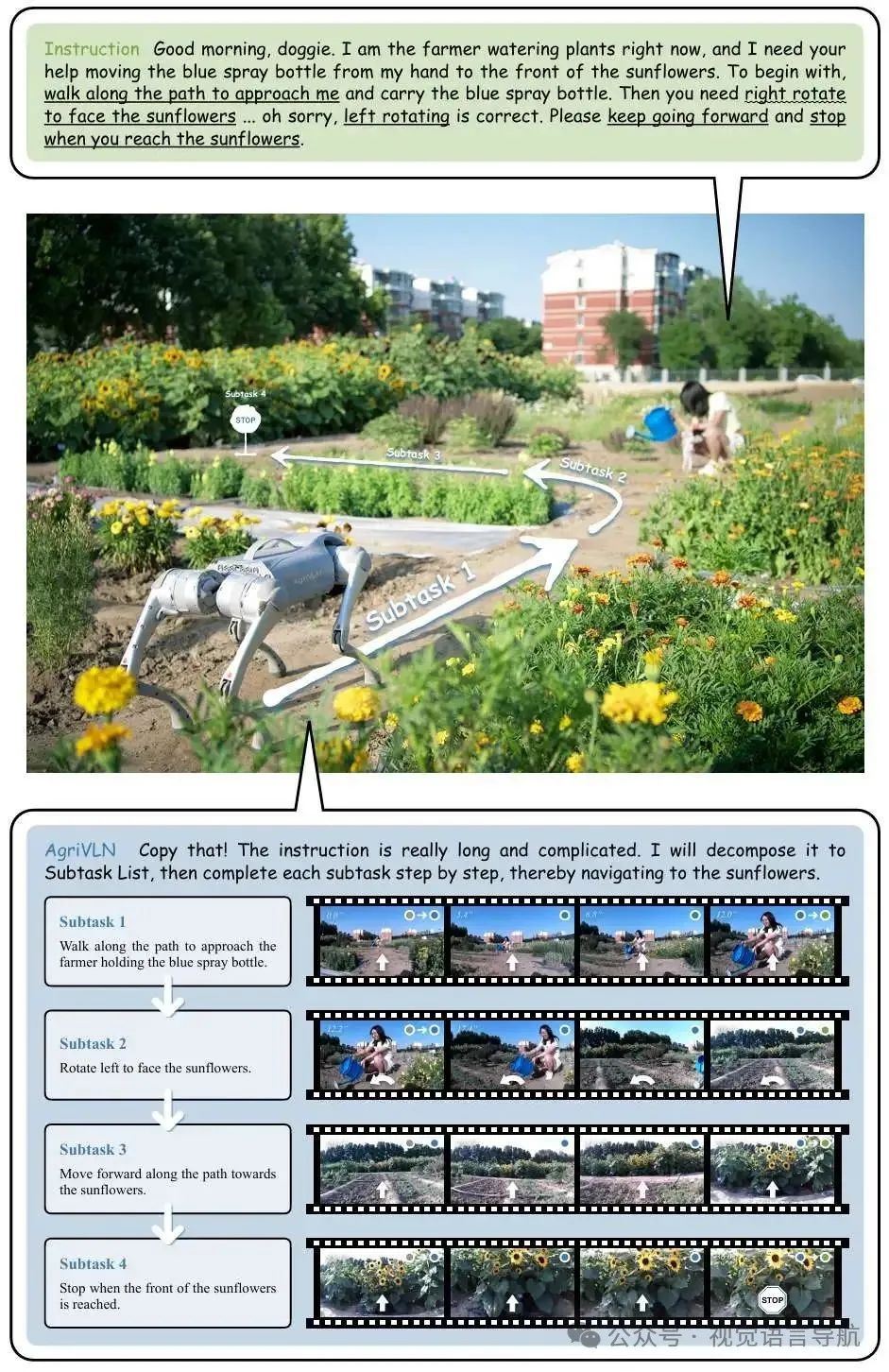

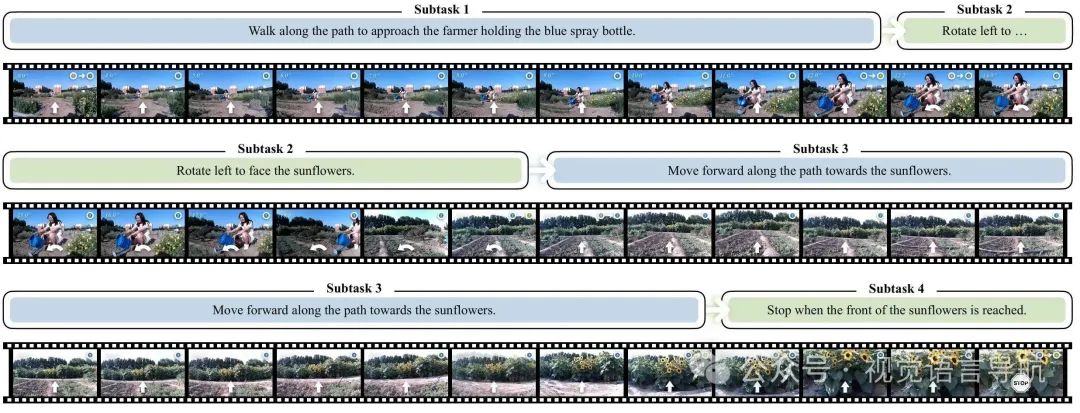

定性實驗

為了幫助讀者更好地理解AgriVLN方法,論文通過一個具體的實驗場景進行了定性實驗。實驗中,AgriVLN將指令分解為子任務列表,然后按順序完成每個子任務,從而實現整個指令的導航任務。具體步驟如下:

指令分解:將復雜的指令分解為多個子任務,每個子任務都有明確的開始和結束條件。

逐步執行:模型依次執行每個子任務,直到完成所有子任務,從而實現從起點到目標位置的導航。

上圖展示了定性實驗的一個代表性場景,其中AgriVLN成功地將指令分解為子任務,并按順序完成每個子任務。論文還提供了五個更多的例子,以展示AgriVLN在不同場景下的表現。

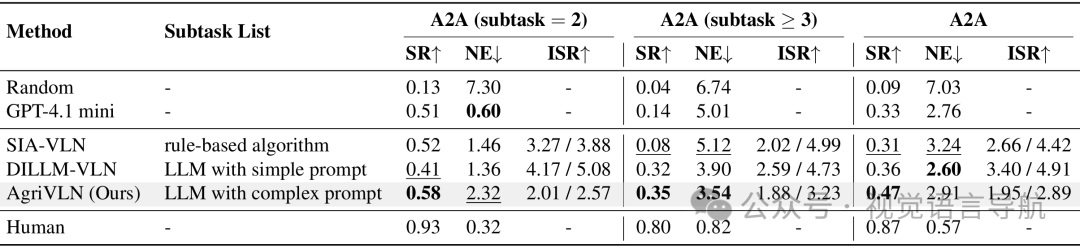

比較實驗

論文將AgriVLN與多種基線方法和最新方法進行了比較,以驗證其性能。具體設置如下:

基線方法:

Random:隨機選擇動作。

GPT-4.1mini with prompt:僅使用GPT-4.1mini進行決策,不使用子任務列表。

Human:人類專家的性能,作為參考標準。

最新方法:

SIA-VLN(Hong et al. 2020):基于規則的指令分解方法。

DILLM-VLN(Wang et al. 2025a):基于LLM的指令分解方法。

結果分析

Random:隨機方法的性能極差,證明了基準測試的有效性和公平性。

Human:人類專家的性能接近完美,證明了基準測試的合理性。

GPT-4.1mini with prompt:僅使用GPT-4.1mini進行決策時,成功率(SR)為0.33,導航誤差(NE)為2.76。

SIA-VLN:在簡單指令(子任務數量為2)時表現良好,但在復雜指令(子任務數量≥3)時性能下降。

DILLM-VLN:在簡單指令時表現良好,但在復雜指令時性能保持穩定,證明了LLM在指令分解中的有效性。

AgriVLN:在所有實驗場景中,AgriVLN的SR為0.47,NE為2.91,綜合性能超過了所有現有方法,盡管與人類表現仍有差距,但已展現出在農業領域視覺語言導航中的最佳性能。

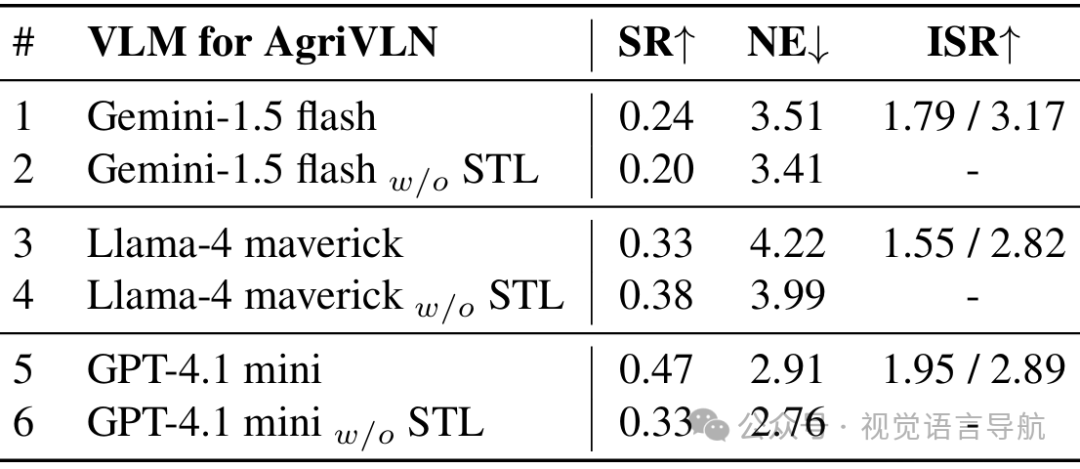

消融實驗

不同視覺語言模型的影響

論文測試了三種輕量級VLM:Gemini-1.5 flash、Llama-4 maverick?和?GPT-4.1mini。結果表明,GPT-4.1mini在成功率(SR)和導航誤差(NE)上均優于其他兩種VLM,因此被選為AgriVLN的VLM。

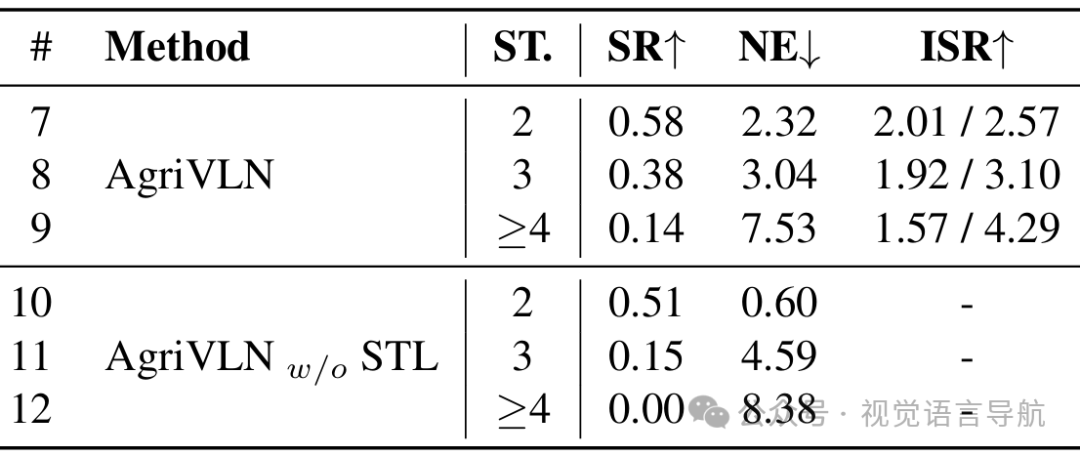

子任務列表模塊的影響

論文通過消融實驗驗證了子任務列表(STL)模塊的重要性。實驗結果表明,當子任務數量增加時,STL模塊對性能的提升作用愈發明顯。

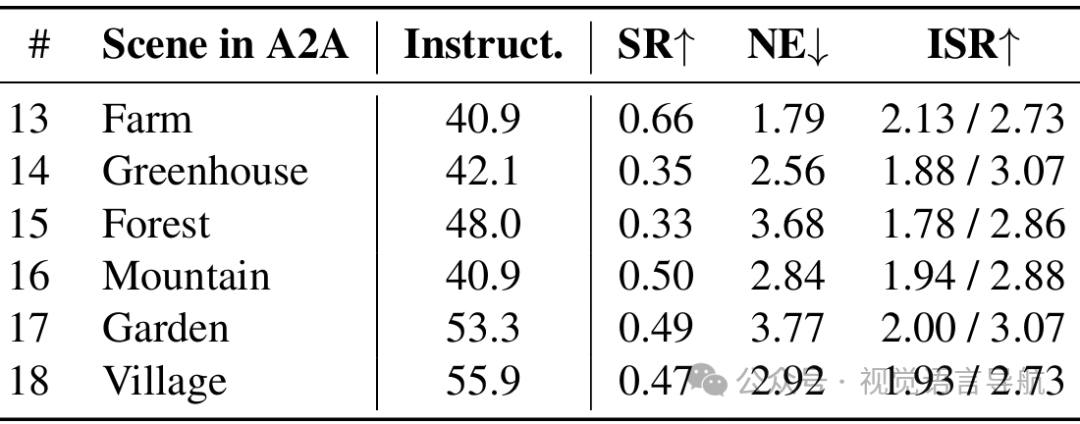

不同場景分類下的性能

論文還統計了AgriVLN在A2A不同場景分類下的性能,發現盡管不同場景的指令平均長度相對一致,但AgriVLN在不同場景下的表現存在顯著差異。這可能是由于場景分類之間的細微差異(如背景雜亂、障礙物密度和光照條件)對模型的視覺感知能力提出了不同程度的挑戰。

結論與未來工作

結論:

該論文提出了A2A基準測試和AgriVLN方法,通過引入子任務列表(STL)模塊,有效地提高了農業機器人在視覺語言導航任務中的性能,特別是在處理長指令時。

然而,AgriVLN仍然存在一些不足之處,如對模糊指令的理解不準確和對空間距離的識別不準確。

未來工作:

未來的工作將致力于改進這些缺點,并進一步探索在實際農業場景中部署該方法,以提高農業機器人的自主性和適應性。

)

詳解)

數據庫遷移實戰:Spring Boot項目完整遷移指南)

的用途)